作者 | 李一鸣

编辑 | 杨怡(AI科技评论)

抓取是人类和物体最基础的交互方式,机器人和物体之间的关系也是一样。然而,让机器人具有比肩人类的抓取能力并非易事,尤其是杂乱场景下对通用物体的抓取能力,该方向的研究也引起了学术界和工业界的广泛关注。

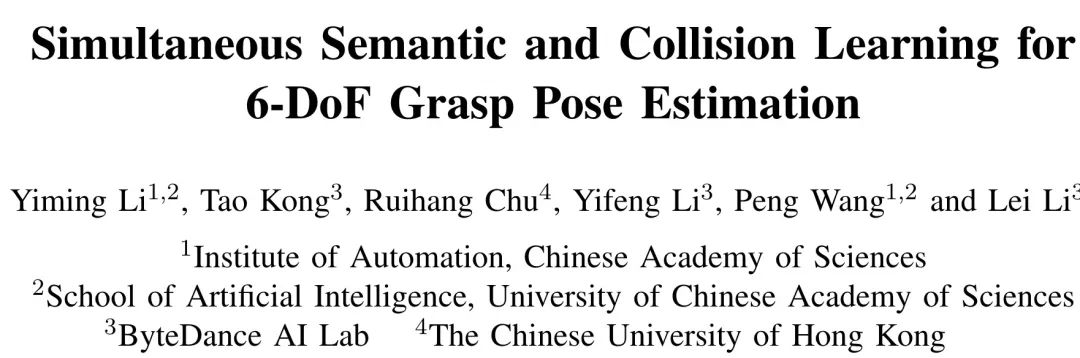

就整理桌面而言,机器人看到杂乱的桌面场景,需要确认待抓取的物体,估计准确的抓取姿态,进行无碰撞的抓取规划并最终执行,是一项非常具有挑战性的任务。

本文将介绍的这篇工作便致力于提升机器人在杂乱场景下的语义理解及抓取能力,文本提出一种带语义及碰撞检测的机器人抓取姿态估计方法,能够端到端地从单视角点云中同时学习实例分割、抓取姿态及可能存在的碰撞,输出物体级别的无碰撞抓取配置,最终交由机器人执行。

论文地址:

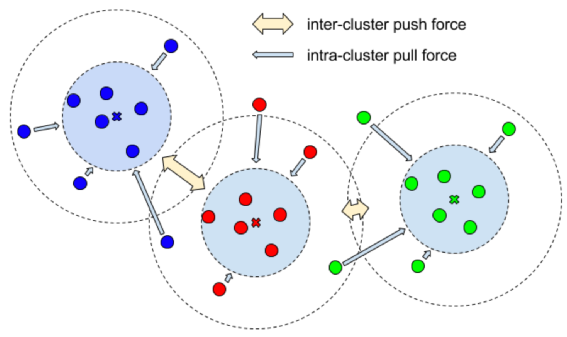

Simultaneous Semantic and Collision Learning for 6-DoF Grasp Pose Estimation (IROS 2021)

https://arxiv.org/abs/2108.02425

研究背景

机器人抓取物体的通常做法是从视觉角度出发,对目标物体进行检测、识别和定位,然后将机械臂移动到目标位置实施抓取。然而,由于物体的形状、类别具有不确定性,该做法往往只适用于已知的物体的抓取,缺乏一定的通用性。此外,物体在实际场景的摆放经常具有一定的杂乱性,在实际抓取过程中,还需要考虑机器人的运动规划及控制等问题。

图1 联合实例分割及碰撞检测的机器人抓取姿态估计示意图

具体方法

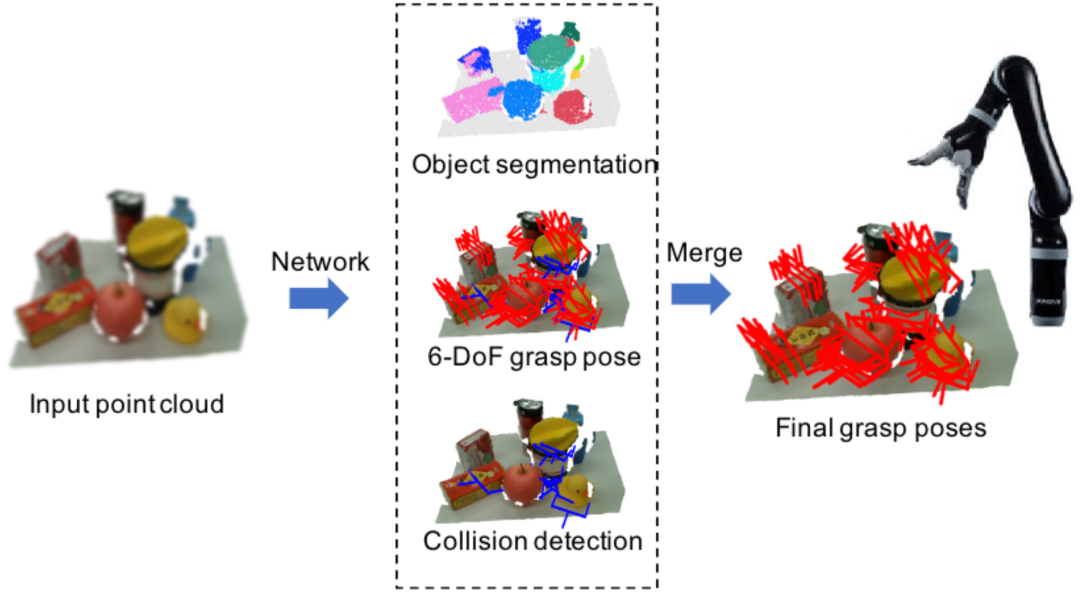

算法将杂乱场景下的机器人抓取作为一个多任务学习的问题,通过实例分割、抓取姿态和碰撞检测三个分支进行联合优化。

图2 联合实例分割及碰撞检测的机器人抓取姿态估计算法框图

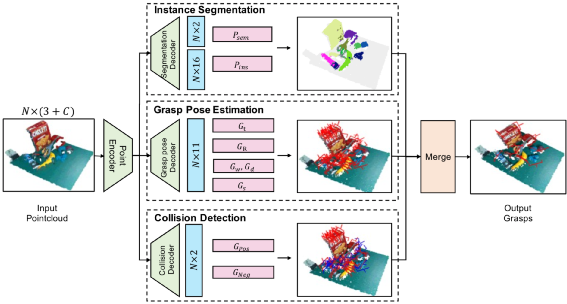

作者采用先提取特征后聚类的方式进行桌面物体的实例分割。具体做法是,同时提取场景点云的语义特征和实例特征,其中语义特征用来进行前景和背景的分割。对于前景点,使用判别损失函数对其类别进行监督。该判别损失函数由类内方差、类间距离及正则化项组成。类内方差约束属于同一物体的点特征尽可能相近,类间距离约束不同物体的特征中心尽可能远,正则化项用于约束特征中心接近于原点以确保可以被激活。

图3 用于实例分割的判别损失函数图解

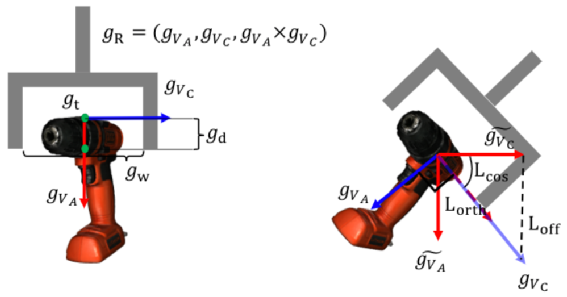

对于六自由度抓取姿态估计,作者将三维空间中的抓取配置用可抓取点坐标、旋转矩阵、抓取深度、抓取宽度及抓取质量表示,同时将点云分为可抓点和不可抓点两种。作者假定每个可抓点只对应一个最优的抓取配置。训练阶段,只有可抓点的抓取配置用于监督。作者采用交叉熵损失函数监督场景点云中每个点是否可抓。对每个可抓点,使用均方误差损失函数监督抓取深度、抓取宽度及抓取质量。对于三维旋转,作者将旋转矩阵分解为夹爪趋近方向(Approach)和闭合方向(Close)的单位向量,分别施加位置约束、余弦距离约束和正交约束。

图 4 六自由度抓取配置示意图

作者还增加了一个碰撞检测的分支,用于预测夹爪和场景可能存在的潜在碰撞,并通过交叉熵损失函数进行监督。最终生成的抓取由实例分割、抓取姿态估计和碰撞检测三个分支合并加上物体级的非极大值抑制得到。

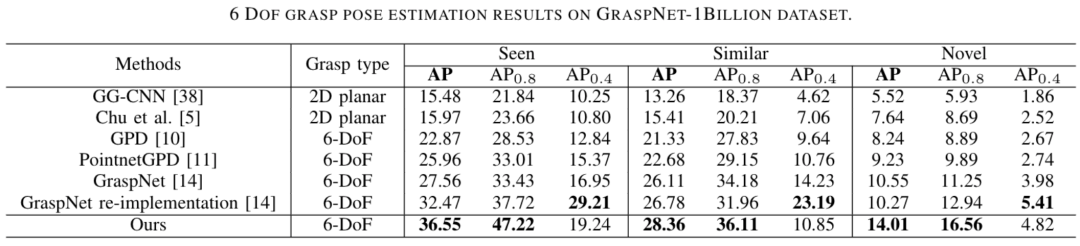

算法在公开数据集 Graspnet-1Billion 上评测,达到了业界领先水平:

图 5 GraspNet-1Billion数据集实验结果

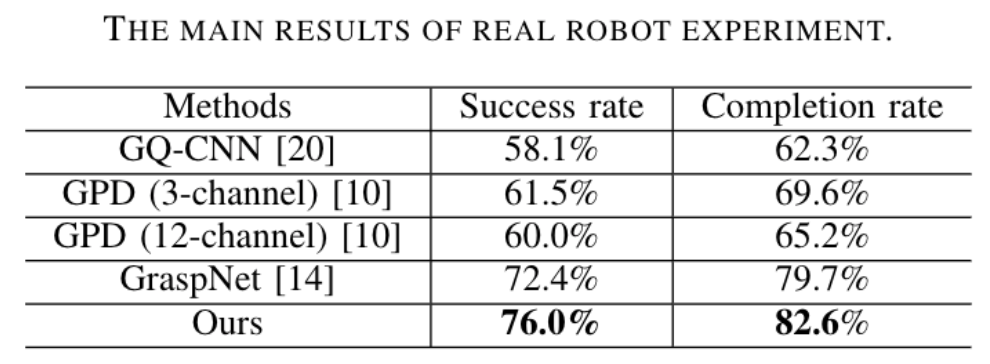

同时作者使用Kinova Jaco2机器人及Realsense在真实场景中进行评测,同样优于 Baseline 方法:

图 6 实际机器人平台实验结果

总结

这篇工作将杂乱场景下的机器人抓取问题分为实例分割、抓取姿态估计及碰撞检测三个子任务并进行联合优化学习。实验表明,算法能够在杂乱场景中准确地估计出物体级别、无碰撞的六自由度抓取姿态,达到业界领先水平。

参考文献

[1] Fang, Hao-Shu, et al. "Graspnet-1billion: A large-scale benchmark for general object grasping."

Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2020.

[2] Qin, Yuzhe, et al. "S4g: Amodal single-view single-shot se (3) grasp detection in cluttered scenes." Conference on robot learning. PMLR, 2020.

[3] Ten Pas, Andreas, et al. "Grasp pose detection in point clouds." The International Journal of Robotics Research 36.13-14 (2017): 1455-1473.

[4] De Brabandere, Bert, Davy Neven, and Luc Van Gool. "Semantic instance segmentation with a discriminative loss function." arXiv preprint arXiv:1708.02551 (2017).

本文仅做学术分享,如有侵权,请联系删文。

3D视觉精品课程推荐:

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码)

3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进

4.国内首个面向工业级实战的点云处理课程

5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解

6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦

7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化

8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近4000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

182

182

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?