点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信号:CVer111,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

转载自:极市平台 |作者:phantom(系投稿)

导读

本文提出了首个能够渲染 X 光的 3D Gaussian Splatting 框架以用于 X 光的新视角合成 (Novel View Synthesis, NVS)。值得一提的是,我们的方法无需计算耗时的 Structure-from-Motion (SfM) 算法来进行初始化。

本文介绍我们在 ECCV 2024 上的新工作

《Radiative Gaussian Splatting for Efficient X-ray Novel View Synthesis》

本文提出了首个能够渲染 X 光的 3D Gaussian Splatting 框架以用于 X 光的新视角合成 (Novel View Synthesis, NVS)。值得一提的是,我们的方法无需计算耗时的 Structure-from-Motion (SfM) 算法来进行初始化。我们的工作还被推特科研风向标的 AK 和 MrNeRF 大佬转发报道

paper: https://arxiv.org/abs/2403.04116

code: https://github.com/caiyuanhao1998/X-Gaussian

video: https://www.youtube.com/watch?v=v6FESb3SkJg&t=28s

media report by AK: https://x.com/_akhaliq/status/1765929288044290253?s=46

media report by MrNeRF: https://x.com/janusch_patas/status/1766446189749150126?s=46

目前所有的代码、数据、高斯点云模型、训练日志均已开源,欢迎大家来使用或是提交 issue

1. X 光新视角合成任务介绍

X 光由于其强大的穿透力而被广泛地应用于医疗、安检、考古、生物、工业检测等场景的透射成像。然而,X 光的辐射作用对人体是有害的,受试者与测试者都会受到暴露于 X 光下的影响。为了减少 X 光对人体的伤害,本文研究稀疏视角下的 X 光三维重建任务 —— 新视角生成。即只拍摄少数几张 X 光片,剩下视角的 X 光片通过渲染得到,用以帮助医生进行诊断分析。

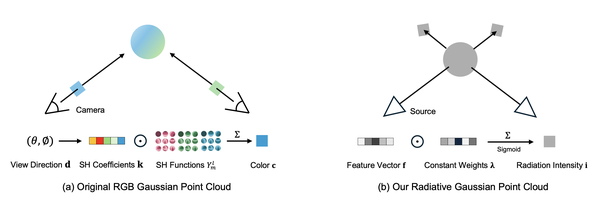

NeRF 类重建方法由于需要密集地采集射线,并在射线上采样多个 3D 点,计算后通过再通过 volume rendering 渲染得到 2D projection。这一过程非常消耗时间。当前正火的 3D Gaussian Splatting (3DGS) 因为其高度平行化的渲染方法 —— Rasterization 而有着比 NeRF 更快的渲染速度。然而 3DGS 是针对自然光成像设计的。直接将 3DGS 用于 X 光成像会遇到两个问题:(i)首先,如图 2 所示,自然光成像主要依靠于光线在物体表面的反射,这使得从不同角度看,物体表面的颜色会有差异。为了拟合这一各向异性的特点,3DGS 采用球谐函数(Spherical Harmonics,SH)来模拟自然光的分布。然而在 X 光成像中,X 光穿透物体并衰减,然后落在探测器上成像。X光无论从各个角度穿透同一物质点,其衰减都是一样的。直接使用 SH 很难拟合 X 光成像的这一各向同性的特点。(ii)其次,3DGS 的初始化需要通过计算 Structure-from-Motion (SfM) 算法来得到各个视角的相机内外参数以及一个稀疏点云作为起始。这个算法十分耗时,增加了患者和医生的等待时间。

本文针对上述这些问题展开研究,做出了以下四点贡献:

针对 X 光新视角合成任务,本文提出首个基于 3D Gaussian Splatting 的技术框架 — X-Gaussian。

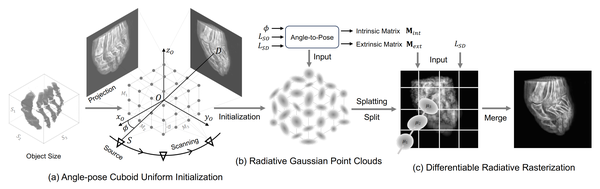

我们设计了一个全新的辐射高斯点云模型(Radiative Gaussian Point Cloud Model),基于该模型我们又设计了一个可微的辐射光栅化渲染方法(Differentiable Radiative Rasterization)。

针对我们的高斯点云模型,我们提出了一种初始化方法 — Angle-pose Cuboid Uniform Initialization(ACUI),这种初始化方法能够通过 X 光扫描仪的设备参数和旋转角直接计算出相机内外参数和初始稀疏点云,这使得我们方法免于计算 SfM,从而大幅提升训练速度。

我们的 X-Gaussian 在性能上超过当前最好 NeRF 方法 6.5 dB 的情况下,推理速度还达到了 73 倍。同时我们在传统算法上也验证了,通过我们方法合成的新视角 X 光片能够提升 CT 重建的图像质量。

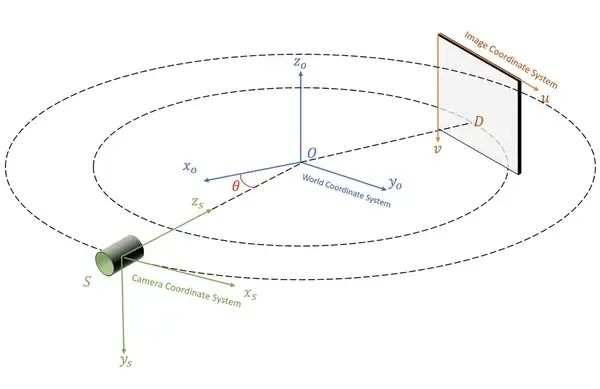

2. 空间坐标系的转换

我们在圆形扫描轨迹锥形 X 光束扫描(circular cone-beam X-ray scanning)场景下研究三维重建问题。空间坐标系的变换关系如图 3 所示。被扫描物体的中心 O 为世界坐标系的原点。扫描仪的中心 S 为相机坐标系的中心。探测器 D 的左上角为图像坐标系的原点。整个空间坐标系的变换遵循 OpenCV 三维视觉的标准。

3. 本文方法

我们算法的流程图如图4所示,首先通过图 4(a)中的 Angle-pose Cuboid Uniform Initialization(ACUI)来计算出 X 光源(Source)在对应旋转角 下的相机内外参矩阵并计算出初始稀疏点云。然后,我们针对 X 光各向同性的成像特点设计了辐射高斯点云模型(Radiative Gaussian Point Cloud Model),如图 4(b)所示。针对这一点云模型,我们还设计了一个可微的辐射光栅化(Differentiable Radiative Rasterization,DRR)渲染方法,用于三维高斯点云的泼溅渲染,如图 4(c)所示。本节我们先介绍辐射高斯点云模型,然后是可微的辐射光栅化,最后介绍 ACUI 初始化方法。

3.1 辐射高斯点云模型

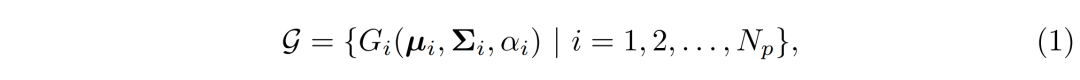

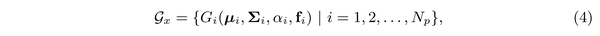

本小节我们首先回顾一下 3DGS 的基本知识。3DGS 将一个物体或场景用 个高斯点云表示如下

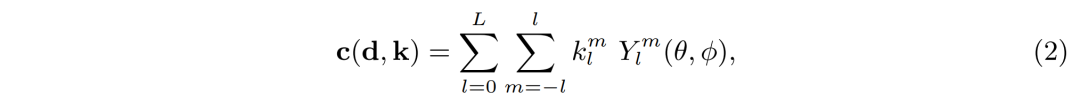

其中的 表示第 个高斯点云, 分别表示高斯点云的中心位置,协方差,和不透明度。协方差控制高斯点云椭球的三轴大小,即控制点云的形状。3DGS 对每一个高斯点云采用球谐函数来拟合其颜色如下:

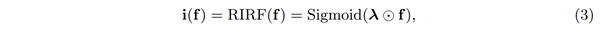

其中, 表示颜色, 表示观测视角, 表示球谐函数系数, 表示球谐函数,将球面上的点映射成一个实数值。然而, 如我们前面的分析, 球谐函数并不适合用来模拟各向同性的 X 光成像。为此, 我们设计了一个辐射强度响应函数 (Radiation Intensity Response Function, RIRF) 来替代球谐函数。具体而言, 我们让每一个高斯点云学一个特征向量 其固有的辐射属性, 如辐射密度等。然后该点云的辐射强度 便可以被表示为

其中 表示一组常数。因此, 我们的辐射高斯点云模型 可以被表示为

其中 为可学习参数, 表示分配给第 个高斯点云的特征向量。

3.2 可微的辐射光栅化方法

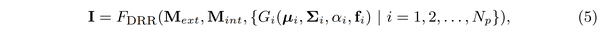

基于我们提出的这个高斯点云模型,我们还设计了一个可微的辐射光栅化方法(Differentiable Radiative Rasterization,DRR)。我们将整个 DRR 的过程 总结如下:

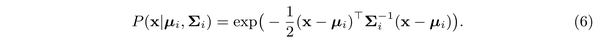

其中 表示被渲染的图像, 和 分别表示内外参矩阵。接着我们介绍 的细节。首先, 我们计算第 个高斯分布上的 点 的概率如下

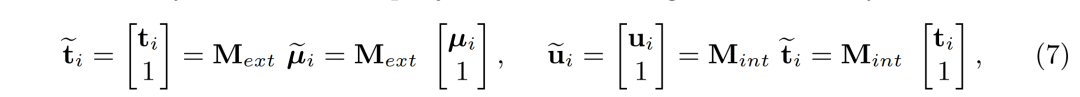

接着,我们将 3D 高斯点云从世界坐标系中投影到相机坐标系,进而再投影到图像坐标系上:

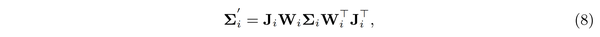

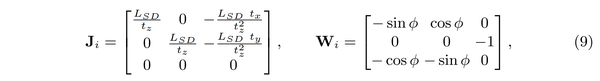

其中的 表示相机坐标, 表示图像坐标。三维的协方差矩阵 也被对应地投影到相机坐标系上:

其中 是投影变换(projective transformation)的仿射近似的雅克比矩阵。 是 viewing transformation。

其中的 表示 光扫描仪中 光源(source)和探测器(detector)之间的距离。 表示 X 光源的旋转角。然后在图像坐标系下的二维协方差矩阵是直接取 的前两行前两列。将 2D projection 分割成互补重叠的 titles。每一个三维高斯点云都按照其对应投影所落在的位置分配到对应的 tiles 上。这些 3D 高斯点云按照与二维探测器+平面的距离进行排序。那么, 在 2D projection 上像素点 上的辐射强度便是混合 个与 重叠的排好序的 3D 点得到的, 如下公式所示

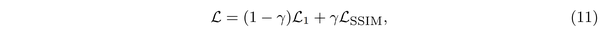

其中的 表示落在像素 上的 X 射线与高斯点云之间的交点, 表示 的辐射强度。模型训练的监督函数是一范数损失与SSIM 损失之间的加权和:

其中的 是加权稀疏,可调的超参。

3.3 角度位姿立方体均匀初始化

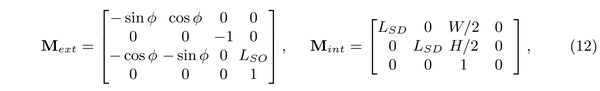

常规的 3DGS 使用 SfM 算法来计算每一个视角的相机内外参数以及初始的稀疏点云。SfM 算法的原理是检测不同视角投影之间的特征匹配点。对于 X 光片这种低对比度的图像来说,SfM 的检测精度会降低。同时运行 SfM 非常耗时,对几十张图像计算 SfM 可能需要耗费几个小时。这大大延长了病人和医生的等待时间。为此,我们设计了角度位姿立方体均匀初始化(Angle-pose Cuboid Uniform Initialization, ACUI)算法。ACUI 首先直接使用 X 光扫描仪的参数来计算相机的内外参矩阵:

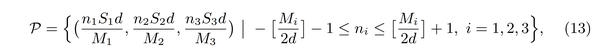

其中的 表示外参矩阵, 表示 X 光源与物体之间的距离。 表示相机内参, 表示渲染图像的宽度和高度。然后我们设置一个尺寸为 的立方块使其能够完全包裹被扫描的物体,然后我们将其分割成一个 (voxel) 的网格。最后, 我们按照间隔 来采样得到初始的稀疏点云:

4. 实验结果

4.1 新视角生成

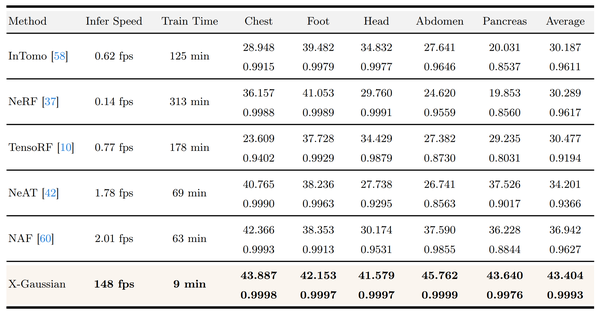

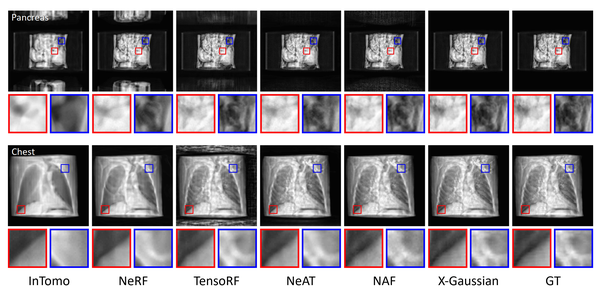

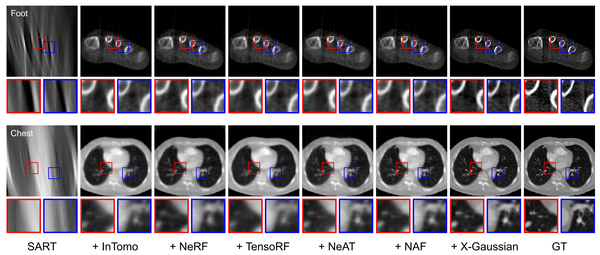

在新视角生成任务上,我们的方法与之前方法的定量与定性对比分别如表 1 和图 5 所示。我们的方法在比当前最好的 NeRF 类算法要高出 6.5 dB 的情况下,还达到了 73 倍的渲染速度,并且可以渲染更多的结构细节。

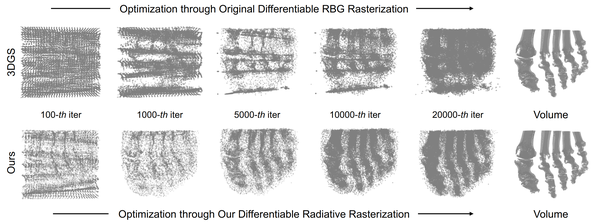

我们做了视觉分析,将 3DGS 与我们的 X-Gaussian 训练的各个 iteration 的 高斯点云进行可视化。如图 6 所示,我们的 X-Gaussian 收敛得更快,噪声更少,更加贴合被扫描物体(脚趾)的形状。

4.2 稀疏视角 CT 重建

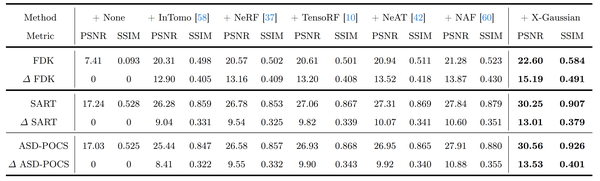

采用我们的 X-Gaussian 为传统方法在稀疏视角下渲染更多 X 光片视图以进行 CT 重建,定量对比如表 2 所示

我们的方法能够更好地辅助不同传统方法进行稀疏视角的 CT 重建,PSNR 性能上的涨幅都超过了 10 dB。

5. 总结

本文提出了首个能渲染 X 光的 3DGS 方法 — X-Gaussian。我们重新设计了一个辐射高斯点云模型,并基于该模型设计了一个可微的辐射光栅化渲染方法,能够在 GPU 上高效地并行计算。同时为求出不同视角下的相机内外参矩阵和初始稀疏点云,我们设计了 ACUI 初始化方法。最终,我们的 X-Gaussian 在比当前最好 NeRF 方法要高出 6.5 dB 的情况下速度还达到了 73 倍速。同时我们还在稀疏视角 CT 重建任务上验证了我们方法的实用价值。

本文使用的数据来自我们 CVPR 2024 的工作 SAX-NeRF,这是一个能够同时做 X 光新视角合成和 CT 重建的 Instant-NGP。感兴趣的小伙伴欢迎阅读下面的链接来了解更多细节:

https://zhuanlan.zhihu.com/p/702702109

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集Mamba和3DGS交流群成立

扫描下方二维码,或者添加微信号:CVer111,即可添加CVer小助手微信,便可申请加入CVer-Mamba、3DGS微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、3DGS+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer111,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请赞和在看

168

168

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?