在现代人工智能的发展中,预训练语言模型(LLM)已成为各种自然语言处理任务中的关键技术。这些模型通常具有数十亿甚至数千亿的参数,因此需要巨大的计算和存储资源来进行微调。QLoRA提出了一种新方法,使得在单个48GB的GPU上微调具有65B参数的大模型成为可能,并且保持了16-bit微调任务的性能。本文将详细介绍QLoRA的方法及其带来的变革。

一、 FFT vs LoRA vs QLoRA

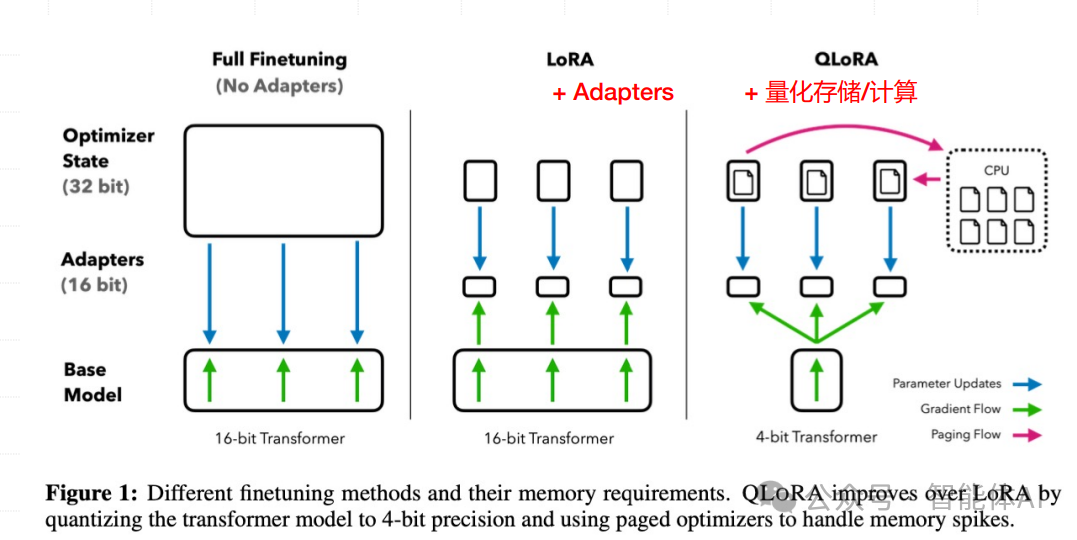

在讨论QLoRA之前,有必要了解全量微调(Full Fine-Tuning,FFT)和低秩适配器(Low-Rank Adaptation,LoRA)这两种现有的方法。

1.1 全量微调(FFT)

全量微调是一种传统的方法,要求对预训练模型的所有参数进行更新。这意味着每次微调任务都需要大量的计算和存储资源。虽然这种方法可以在微调任务中达到最佳性能,但在处理大规模模型时,其资源消耗非常高。例如,微调一个具有数十亿参数的模型可能需要多个高性能GPU和大量的时间。

1.2 LoRA

LoRA提出了一种低秩适配器的方法,通过引入低秩矩阵来调整预训练模型的参数,从而减少需要更新的参数数量。这样做的好处是显著降低了计算和存储需求,使得在相对有限的硬件资源上也能进行有效的微调。然而,LoRA在某些情况下的性能可能不如全量微调,因为它只对部分参数进行了调整。

1.3 QLoRA

QLoRA在LoRA的基础上进一步优化,通过引入量化技术,使得在单个48GB GPU上微调65B参数模型成为可能。QLoRA通过冻结int4量化预训练语言模型,并将梯度反向传播到低秩适配器LoRA,实现了高效的微调。这种方法既保留了LoRA的低秩适配优势,又通过量化技术降低了计算和存储需求。

二、 QLoRA 提出新数据类型 4-bit NormalFloat (NF4)

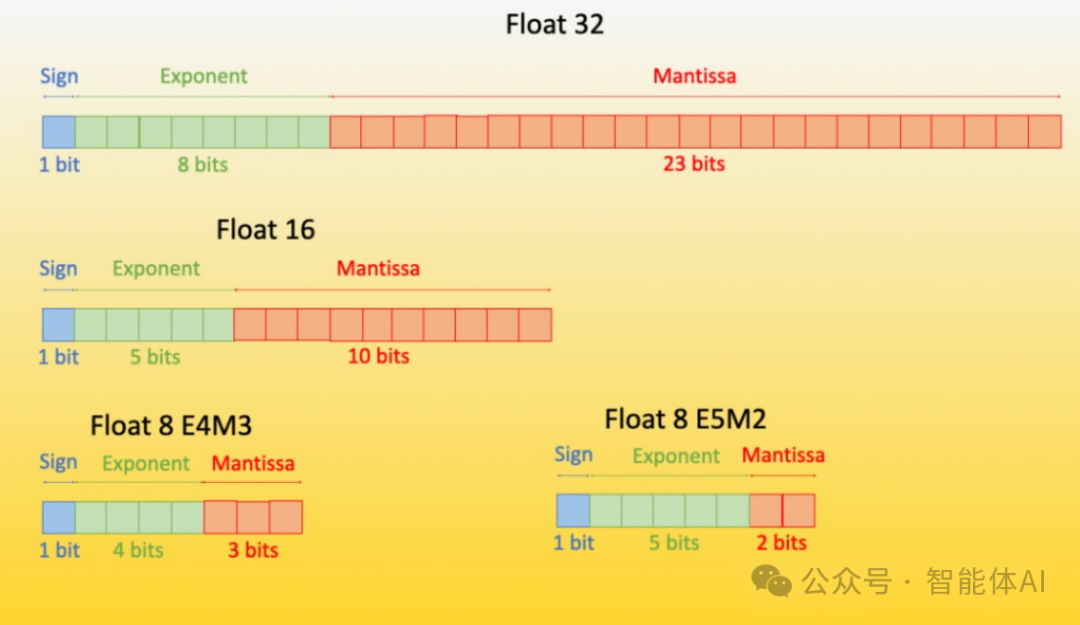

QLoRA的一个关键创新在于其量化技术,尤其是新提出的4-bit NormalFloat (NF4) 数据类型。

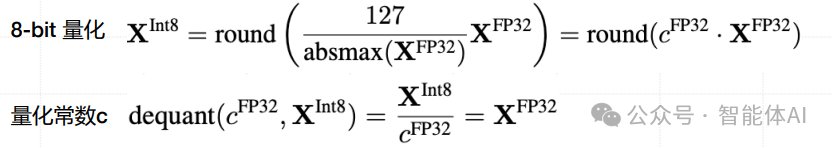

2.1 8-bit 量化和量化常数c

在传统的量化方法中,8-bit量化是一种常见的技术。它通过一个量化常数c将输入张量的值映射到8-bit的范围内,从而实现数据压缩。然而,8-bit量化在处理大规模模型时仍然需要大量的存储空间和计算资源。

2.2 NormalFloat (NF) 数据类型

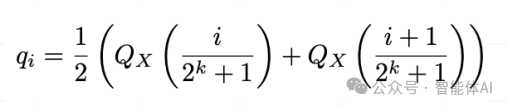

NormalFloat (NF) 数据类型建立在分位数量化(Quantile Quantization)基础上。这是一种信息论最优的数据类型,能够确保每个量化区间中具有相同数量的值。分位数量化通过经验累积分布函数(ECDF)估计输入张量的分位数,虽然分位数估计过程较为昂贵,但快速分位数近似算法(如SRAM分位数)可以有效解决这一问题。

2.3 4-bit NormalFloat (NF4)

由于预训练神经网络的权重通常具有标准差为σ的零中心正态分布,通过缩放σ可以将所有权重转换为单个固定分布,使其符合NF4的数据范围。在QLoRA中,NF4的数据范围被设定为[-1, 1]。通过归一化,神经网络权重的分位数能够匹配这一范围,从而实现高效的量化。具体来说,NF4通过以下步骤实现:

- 估计标准正态分布N(0,1)的分位数,得到正态分布的k位分位数量化数据类型。

- 将这些分位数值归一化到[-1, 1]范围内。

- 将输入权重张量归一化到[-1, 1]范围内进行量化。

三、QLoRA 提出双量化技术:量化(量化常数)

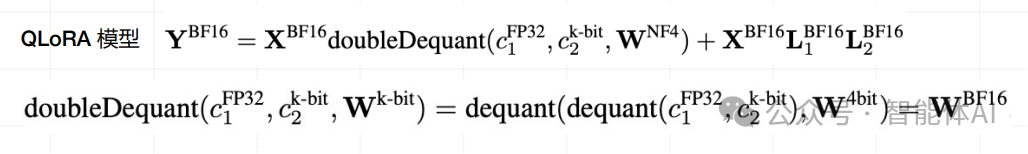

除了数据类型的创新,QLoRA还提出了双量化技术,这种技术设计了存储数据类型(4-bit NormalFloat)和计算数据类型(16-bit BrainFloat)。

3.1 双量化技术的应用

在QLoRA中,权重从存储数据类型(4-bit NormalFloat)反量化为计算数据类型(16-bit BrainFloat),以进行前向和后向传播。然而,只有16-bit BrainFloat的LoRA参数的权重梯度会被计算,这样一来,权重只有在需要时才会解压缩。这种方法在训练和推理期间保持了较低的内存使用率。

3.2 优化内存使用

双量化技术的应用使得在单个GPU上进行大规模模型的微调成为可能,同时显著降低了内存使用率。这对于资源有限但需要处理大规模模型的应用场景来说,具有重要意义。通过这种方法,可以在有限的硬件资源上实现高效的模型微调和推理,极大地提高了计算资源的利用效率。

四、总结

QLoRA通过引入4-bit NormalFloat数据类型和双量化技术,成功在低资源条件下实现了大规模预训练模型的高效微调。这种方法不仅保留了LoRA的低秩适配优势,还进一步优化了内存使用和计算效率,为大规模模型的实际应用提供了新的可能性。未来,QLoRA有望在更多的自然语言处理任务中发挥重要作用,推动人工智能技术的进一步发展。

如何转行/入门AI产品经理?

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,转行/入门AI产品经理,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

我已将重要的AI大模型资料包括市面上AI产品经理入门手册、AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI产品经理入门手册

三、AI大模型视频教程

四、AI大模型各大学习书籍

五、AI大模型各大场景实战案例

六、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。

2984

2984

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?