摘要:过去几年,我们见证了自动驾驶的快速发展。然而,由于复杂和动态的驾驶环境,目前实现完全自动驾驶仍然是一项艰巨的任务。因此,自动驾驶汽车配备了一套传感器来进行强大而准确的环境感知。随着传感器的数量和类型不断增加,将它们融合来更好地感知环境正在成为一种趋势。到目前为止,还没有文章对基于多传感器融合的3D目标检测进行深入调研。为了弥合这一差距并推动未来的研究,本文致力于回顾最近利用多个传感器数据源(尤其是相机和 LiDAR)的基于融合的 3D 检测深度学习模型。首先,本文介绍了自动驾驶汽车中常用的传感器,包括它们的通用数据表示以及基于每种类型的传感器数据的3D目标检测网络。接下来,我们讨论一些多模态3D目标检测中流行的数据集,重点介绍每个数据集中包含的传感器数据。然后我们从三个方面来深入回顾最近的多模态3D检测融合网络:融合位置、融合数据表示和融合粒度。最后,本文总结了现有的开放式挑战并指出可能的解决方案。

1. 引言

自动驾驶感知模块

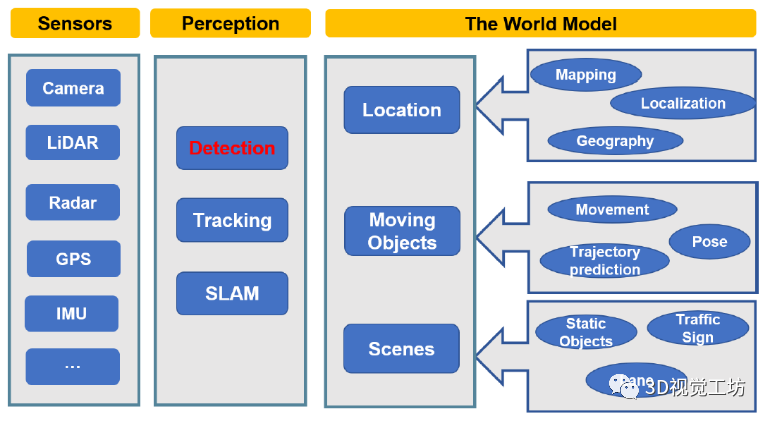

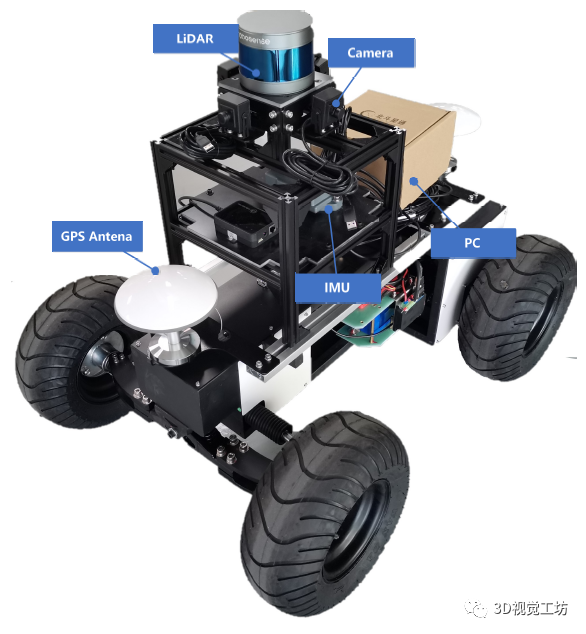

如图1,自动驾驶汽车(AV)通常配备一个感知子系统来实时检测和跟踪运动目标。感知子系统是将来自一组传感器的数据作为输入,经过一系列的处理步骤后,输出关于环境、其他物体(如汽车)以及自动驾驶汽车本身的知识。如图2所示,AV上的传感器通常包括摄像头、激光雷达(Light Detection And Ranging sensor,LiDAR)、雷达(Radio detection and ranging,Radar)、GPS(Global Positioning System)、惯性测量单元(inertial measurement units)等。

具体来说,感知子系统有三个基本要求。

首先,它需要是准确的,并给出了驾驶环境的准确描述。

其次,具有鲁棒性。能在恶劣天气下、甚至当一些传感器退化甚至失效时保证AV的稳定与安全。

第三,实时性,能提供快速的反馈。

为了满足上述需求,感知子系统同时执行多个重要任务,如3D目标检测、跟踪、同步定位与映射(SLAM)等。

图1:一个典型的自动驾驶感知子系统

图2:自动驾驶汽车Sonic

3D目标检测

3D目标检测是感知子系统的一项重要任务,其目的是在传感器数据中识别出所有感兴趣的物体,并确定它们的位置和类别(如车辆、自行车、行人等)。在3D目标检测任务中,需要输出参数来指定物体周围的面向3d的边界框。如图3所示,为了绘制红色的三维包围盒,我们需要预测中心三维坐标c,长度l,宽度w,高度h,物体偏转角度θ。显然,2D目标检测无法满足自动驾驶环境感知的需求,因为缺少现实三维空间下的目标位置。接下来介绍自动驾驶的3D目标检测任务,根据传感器的使用类型,包括使用相机、使用LiDAR以及使用Radar等一些单模态方法。在第二章中会详细介绍。

结果例子(分别对应绿框、红框)

多

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

627

627

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?