基于SLAM14讲13.3中提到的单目稠密重建方法,重建自己的单目相机图片的深度图。

我们已经制作了自己的数据集,而且我们现在也根据合适的算法得到了对应的相机位姿。那么就已经达到了单目相机深度估计的要求。下面这些例程使用的是公开的REMODE测试数据集。

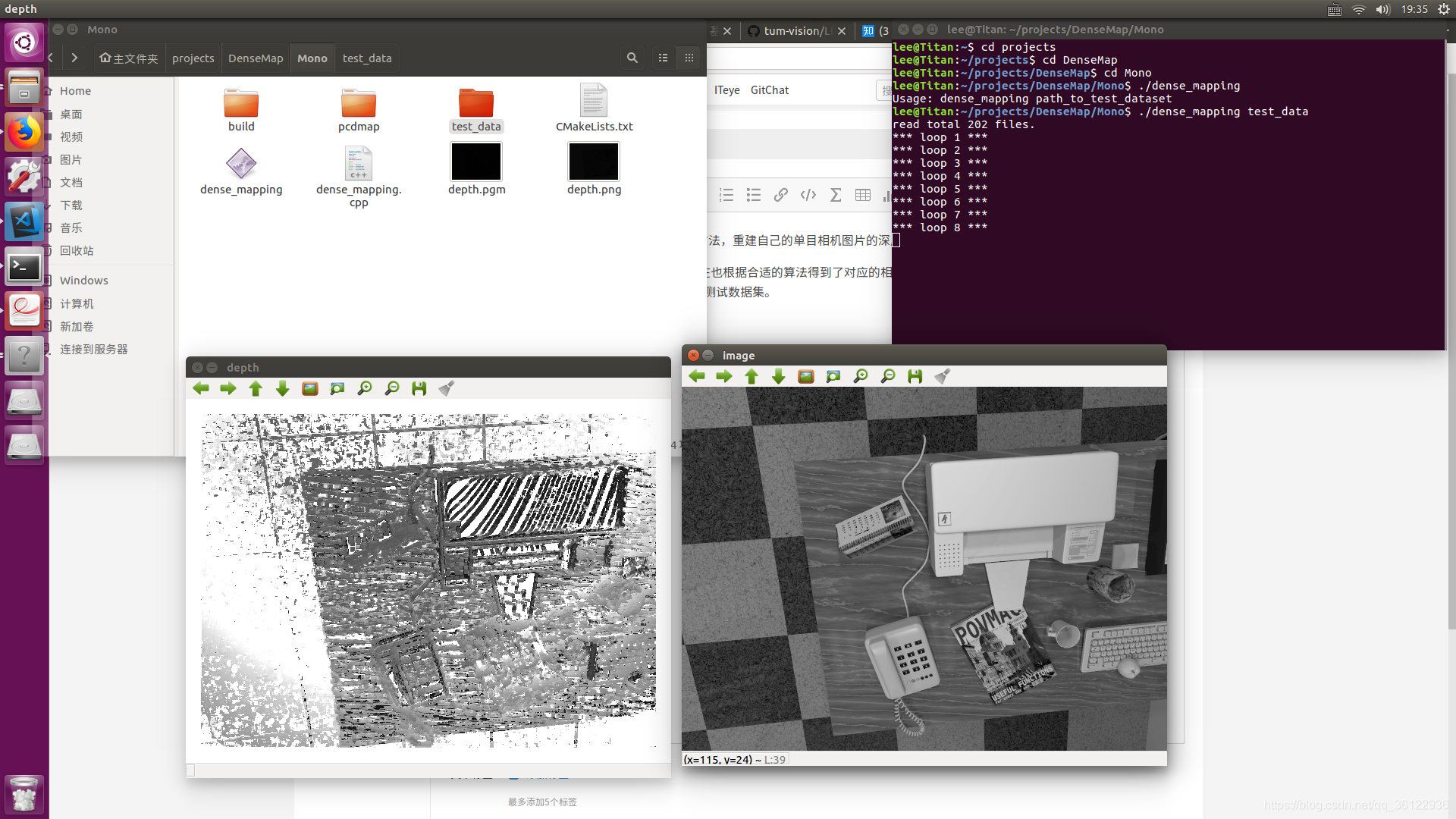

例程效果如下

dense_mapping.cpp 主程序如下所示

#include <iostream>

#include <vector>

#include <fstream>

using namespace std;

#include <boost/timer.hpp>

// for sophus

#include <sophus/se3.h>

using Sophus::SE3;

// for eigen

#include <Eigen/Core>

#include <Eigen/Geometry>

using namespace Eigen;

#include <opencv2/core/core.hpp>

#include <opencv2/highgui/highgui.hpp>

#include <opencv2/imgproc/imgproc.hpp>

using namespace cv;

/**********************************************

* 本程序演示了单目相机在已知轨迹下的稠密深度估计

* 使用极线搜索 + NCC 匹配的方式,与书本的 13.2 节对应

* 请注意本程序并不完美,你完全可以改进它——我其实在故意暴露一些问题。

***********************************************/

// ------------------------------------------------------------------

// parameters

const int boarder = 20; // 边缘宽度

const int width = 640; // 宽度

const int height = 480; // 高度

const double fx = 481.2f; // 相机内参

const double fy = -480.0f;

const double cx = 319.5f;

const double cy = 239.5f;

const int ncc_window_size = 2; // NCC 取的窗口半宽度

const int ncc_area = (2*ncc_window_size+1)*(2*ncc_window_size+1); // NCC窗口面积

const double min_cov = 0.1; // 收敛判定:最小方差

const double max_cov = 10; // 发散判定:最大方差

// ------------------------------------------------------------------

// 重要的函数

// 从 REMODE 数据集读取数据

bool readDatasetFiles(

const string& path,

vector<string>& color_image_files,

vector<SE3>& poses

);

// 根据新的图像更新深度估计

bool update(

const Mat& ref,

const Mat& curr,

const SE3& T_C_R,

Mat& depth,

Mat& depth_cov

);

// 极线搜索

bool epipolarSearch(

const Mat& ref,

const Mat& curr,

const SE3& T_C_R,

const Vector2d& pt_ref,

const double& depth_mu,

const double& depth_cov,

Vector2d& pt_curr

);

// 更新深度滤波器

bool updateDepthFilter(

const Vector2d& pt_ref,

const Vector2d& pt_curr,

const SE3& T_C_R,

Mat& depth,

Mat& depth_cov

);

// 计算 NCC 评分

double NCC( const Mat& ref, const Mat& curr, const Vector2d& pt_ref, const Vector2d& pt_curr );

// 双线性灰度插值

inline double getBilinearInterpolatedValue( const Mat& img, const Vector2d& pt ) {

uchar* d = & img.data[ int(pt(1,0))*img.step+int(pt(0,0)) ];

double xx = pt(0,0) - floor(pt(0,0));

double yy = pt(1,0) - floor(pt(1,0));

return (( 1-xx ) * ( 1-yy ) * double(d[0]) +

xx* ( 1-yy ) * double(d[1]) +

( 1-xx ) *yy* double(d[img.step]) +

xx*yy*double(d[img.step+1]))/255.0;

}

// ------------------------------------------------------------------

// 一些小工具

// 显示估计的深度图

void p

本文介绍了在Ubuntu16.04上利用SLAM技术进行单目相机的稠密重建过程,包括数据集制作、相机位姿获取和深度图重建。通过运行dense_mapping.cpp主程序,实现了对REMODE测试数据集的处理,展示了单目相机深度估计的实际效果。

本文介绍了在Ubuntu16.04上利用SLAM技术进行单目相机的稠密重建过程,包括数据集制作、相机位姿获取和深度图重建。通过运行dense_mapping.cpp主程序,实现了对REMODE测试数据集的处理,展示了单目相机深度估计的实际效果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?