GSD: View-Guided Gaussian Splatting Diffusion for 3D Reconstruction

1 背景

标题:GSD: View-Guided Gaussian Splatting Diffusion for 3D Reconstruction用于三维重建的视角引导高斯溅射扩散模型

作者:Yuxuan Mu, Xinxin Zuo, Chuan Guo, Yilin Wang, Juwei Lu, Xiaofeng Wu, Songcen Xu, Peng Dai, Youliang Yan, Li Cheng

机构:University of Alberta, Edmonton AB T6G 2R3, Canada

Huawei Noah’s Ark Lab

原文链接:https://arxiv.org/abs/2407.04237

官方网站:https://yxmu.foo/GSD/

GSD就是Gaussian Splatting Diffusion的缩写

2 摘要

作者介绍了一种名为GSD(View-Guided Gaussian Splatting Diffusion)的新方法,该方法旨在通过单个视角图像来重建三维物体。

GSD利用了高斯溅射(Gaussian splatting, GS)表示法,其中三维物体被描述为一组椭球集合。这种方法通过将细粒度的二维特征,经由设计的溅射函数和引导去噪采样过程,映射到三维空间中的对应位置,从而实现从2D到3D的转换。

为了确保重建物体的高质量,GSD还引入了一个二维扩散模型,用于增强渲染图像的真实感,即对生成的图像进行进一步的优化和再处理,以改善最终输出的视觉质量。

3 简介

对于单视图图像的三维重建问题,有三个关键方面。

1.要有一个适当的3D表示,能够编码高保真的3D信息,同时与各种级别的量化兼容。

2.与人类感知系统类似,能够生成具有物体背面不同外观的物体,并忠于输入视图。

3.能够高效、精准地将3D物体渲染成任意视图。

但是现有的水平难以解决上面一个或多个方面。

比如:

| 方法 | 优点 | 缺陷和不足 |

|---|---|---|

| 2D新视图合成方法 | 在保持3D一致性方面存在不足 | |

| 显示的3D表示(体素、点云和网格) | 提供一致的3D渲染 | 粗糙的几何形状和渲染质量(3D特征的低分辨率和稀疏性质) |

| 隐式3D表示 | 在规范(正则)空间中单视图重建有着卓越的质量 | 在三维几何提取和视图渲染上有着繁琐的工作 |

| 作者的GSD框架 | 实现高质量的单视图三维重建 |

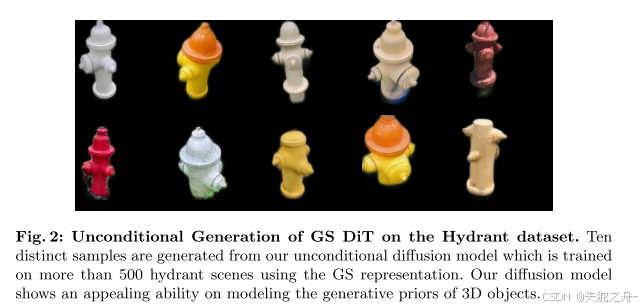

当没有输入图像时,作者的扩散模型学习生成具有不同几何形状和纹理的高保真3D物体。

当提供输入图像时,使用相同的扩散模型来重建特定的3D对象。每个去噪步骤的GS目标通过基于可微分溅射的渲染 投影到给定视图中。然后将渲染图像与参考图像之间的差异梯度反向传播到相应的GS样本中,在当前步骤中不断细化3D对象,类似于分类器引导。

我觉得类似于3DGS原理里中,可微光栅化渲染得到图像,把渲染图像和GT图像求损失值,反向传播更新3D高斯里的参数,不断迭代。

主要贡献有:

1.提出的GSD是第一个直接模拟原始GS表示的扩散模型,捕获其3D生成先验的单视图重建。

2.GS DiT带有视图引导采样策略,使用溅射功能从给定视图中提取细粒度特征。

3.与最先进的方法相比,CO3D数据集已经证实了方法的优越性。

4 相关工作

相关工作的大致框架分为三个点:

1.条件视角的三维重建和生成

2.新视图合成

3.基于SDS创建三维资产

4.1 条件视角的三维重建和生成

View-Conditioned 3D Reconstruction and Generation.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

292

292

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?