上海 AI lab 化学大模型团队基于自建ChemData化学专业数据集,在2024年初发布的浦科·化学基础上,更新发布了ChemLLM-1.5化学大模型,并在新构建的ChemBench测评数据集上进行了全面的测评。更新后,ChemLLM在核心化学任务上的效果与GPT-4相当,是首个兼备推理、对话等通用能力和化学专业能力的开源大模型。相比于现有的其他大模型,ChemLLM对化学空间进行了有效建模,在产物预测、名称转化和化学性质预测等核心化学任务上表现优异。而在通用任务上与尺寸相近的语言模型难分伯仲,欢迎到wisemodel开源社区进行在线体验。

huggingface开原链接: https://huggingface.co/AI4Chem/ChemLLM-7B-Chat

文章链接:[2402.06852] ChemLLM: A Chemical Large Language Model

科学大语言模型的机遇与挑战

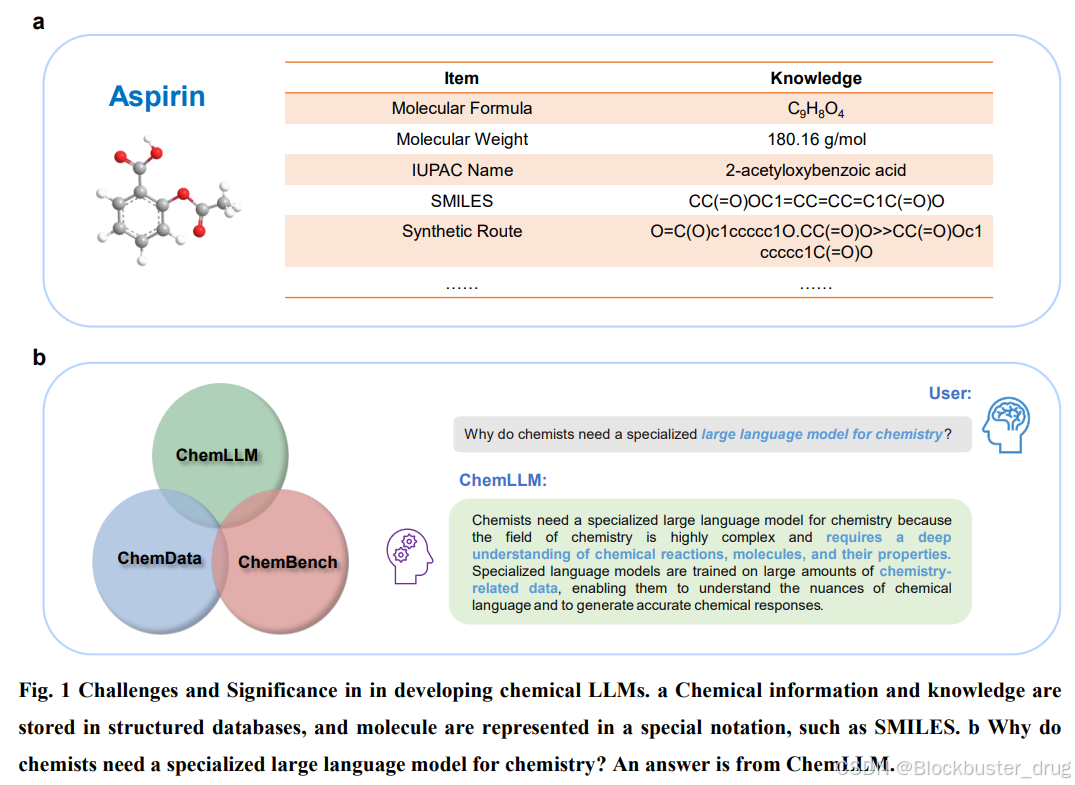

大型语言模型已在图像处理、文字识别、视频制作等多个领域展现出卓越的能力,并已成功应用于化学研究,为科学研究和生产提供支持。目前的研究主要依赖于大型语言模型调用专业化学工具来解决具体的化学问题。然而,直接将化学知识集成到语言模型中,仍然存在以下挑战:

1. 结构化数据的限制: 大多数化学信息和知识存储在结构化数据库中,直接使用这些数据训练LLM可能会损害模型处理自然语言的能力,使得模型的对话和逻辑推理能力发生退化;

2. 特殊的化学信息学表示: 化学信息学中,分子用特殊符号表示,如SMILES。这类数据往往不符合自然语言的规范,因此常规的语言模型难以正确理解和生成这种符号;

3. 化学数据和任务的多样性: 化学数据和任务种类繁多,设计一个灵活并能泛化到多种化学任务上的训练流程十分困难。

ChemLLM的技术核心

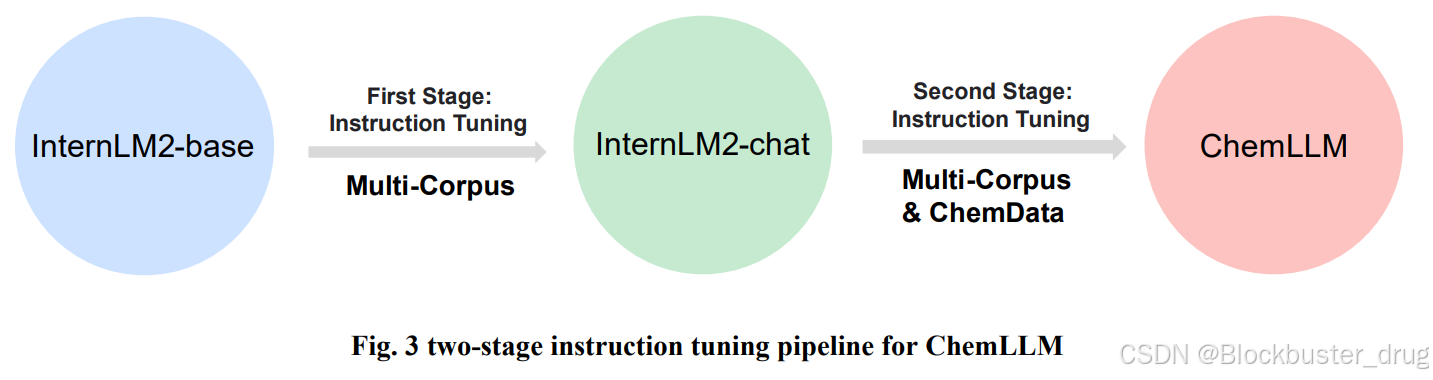

为解决上述困难,研究人员创造性地采用两阶段指令微调框架对模型进行训练。第一阶段中,研究人员使用开源的Multi-Corpus通用语料数据集进行指令微调,赋予InternLM2-base的基座模型以通用语言能力;第二阶段中,研究人员将构造的ChemData专业数据集与部分通用语料数据集混合对模型进行二次指令微调,在保有模型通用语言、推理能力不受损害的前提下,注入化学知识。

经过两个阶段的训练,模型的通用能力被激发并保留,同时ChemLLM有效地建模了化学空间,具有解决复杂的化学问题的潜力。

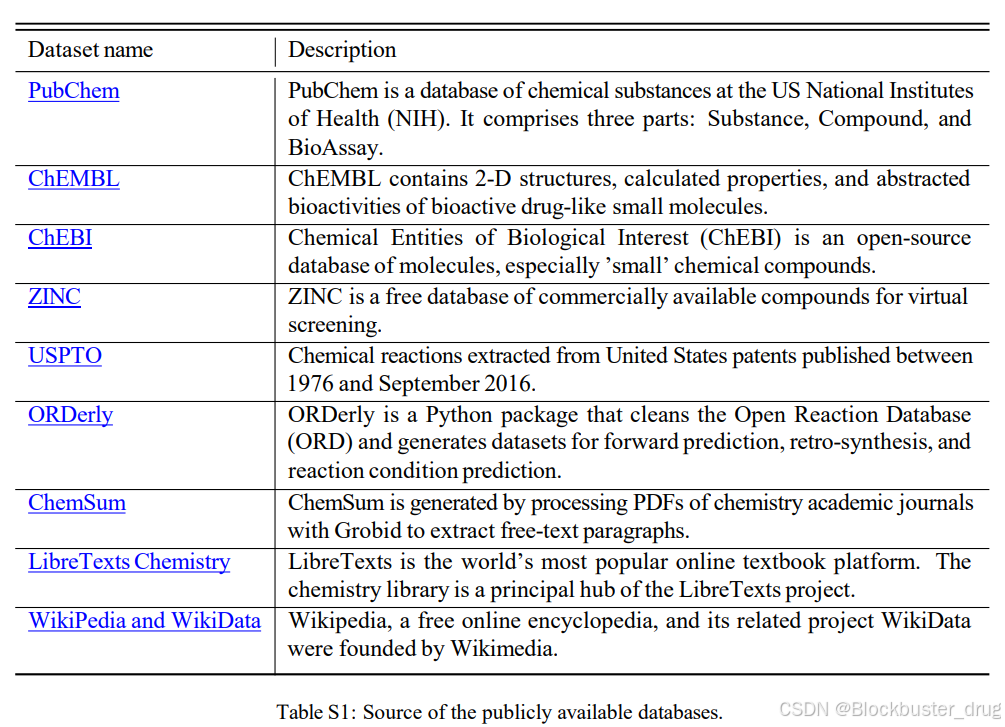

ChemLLM的化学数据来源:

ChemLLM能力测评

为了评估浦科化学的专业能力,上海AI实验室的研究人员对其在三种相关任务上的表现进行了测试:分子名称转换、分子性质预测和反应产物预测——这些任务分别涉及化学物质的表示、性质和转化,是化学研究的基础和核心。

分子名称转换方面,要求模型能够在不同分子表示方式之间进行准确转换,如SMILES、IUPAC名称、分子式等;

分子性质预测方面,要求模型能根据分子的结构和组成,预测其化学性质,如沸点、密度、溶解度等;

反应产物预测方面,要求模型能根据给定的反应物和反应条件预测反应产物的结构。

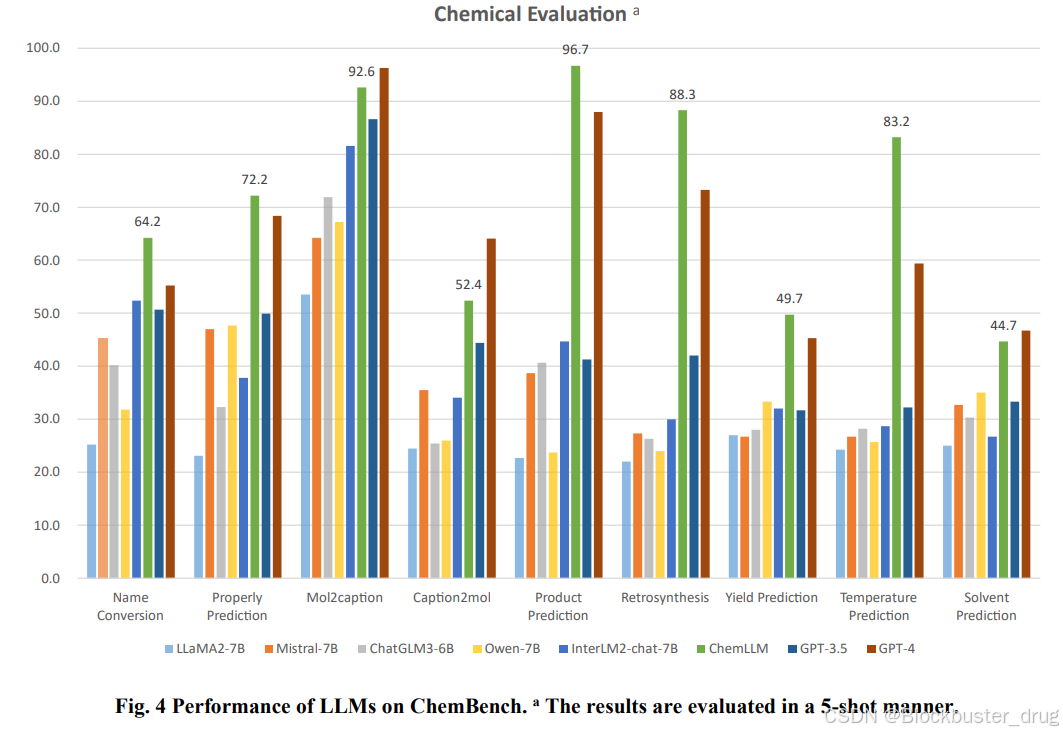

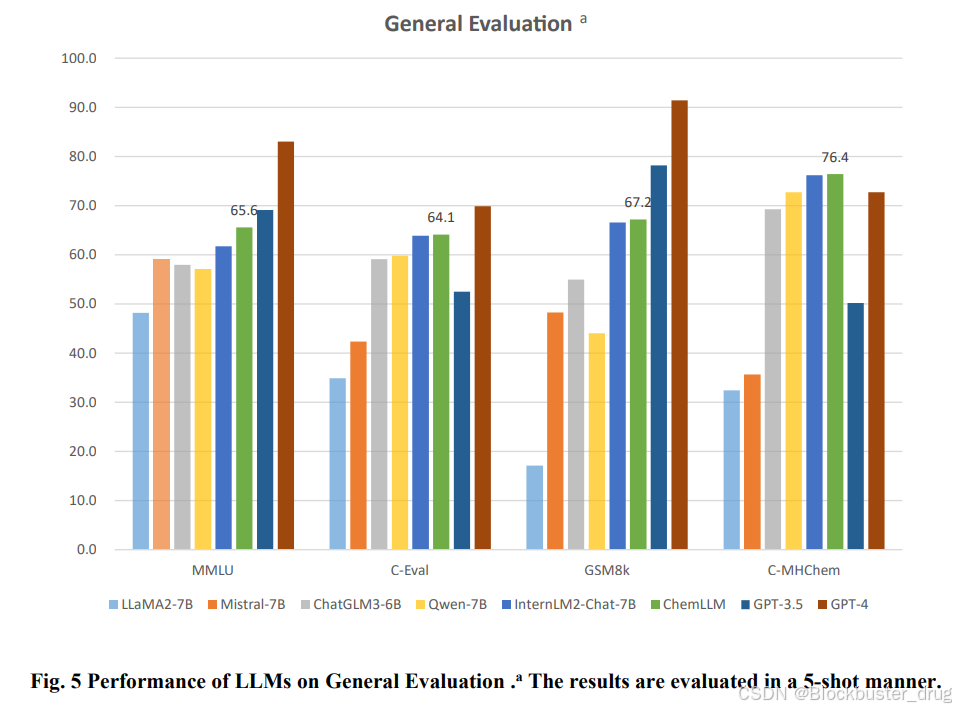

研究人员运用构建的ChemBench测评数据集,在基于文本的分子生成、名称转换、性质预测、温度预测、分子描述、产率预测、溶剂预测、逆合成分析、产物预测共九大专业化学任务上测试了ChemLLM。同时选取了LLaMA2-7B、Mistral-7B、ChatGLM3-6B、Owen-7B、InterLM2-chat-7B,共五个规模相近的语言大模型,和超大通用语言模型GPT-3.5和GPT-4,与ChemLLM进行了比较。

在所有九个化学任务中,ChemLLM显著地超越了五个同规模大模型和通用超大模型GPT-3.5,在基于文本的分子生成、名称转换、性质预测、温度预测、产率预测、逆合成分析六个任务上能够媲美于GPT-4,证明了ChemLLM对化学空间的有效学习。

研究人员也采集并开源了中高考化学测试数据集,连同其他三个公开通用评测数据集上一起,对上述大模型进行了通用知识评测。这四个数据集的测试内容包括中英文多学科认知性知识测试、数学推理能力测试、基础化学能力等,全面考察模型的综合认知和逻辑推理。

结果证明,ChemLLM的通用能力达到主流大语言模型水平。

参考资料:

ChemLLM化学大模型开源,wisemodel社区在线体验,助力化学研究

上海AI实验室开源发布科学大模型“浦科化学”_上海人工智能实验室

ChemLLM:专门针对化工行业的大规模语言模型的创新和应用 | AI-SCHOLAR | AI:(人工智能)文章和技术信息媒体

388

388

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?