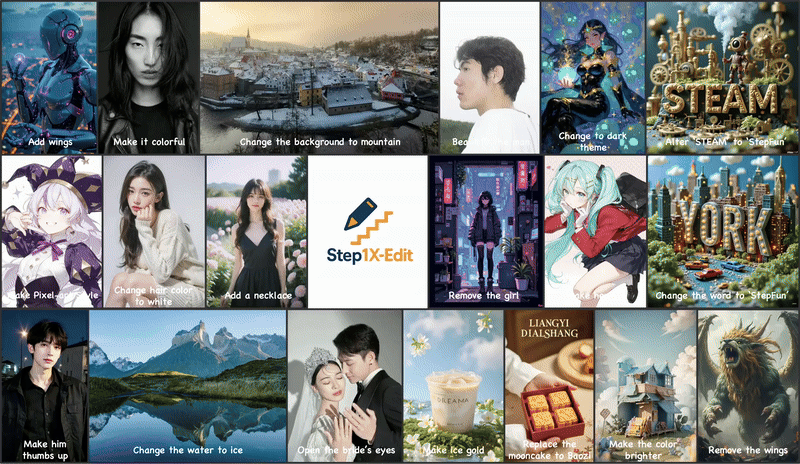

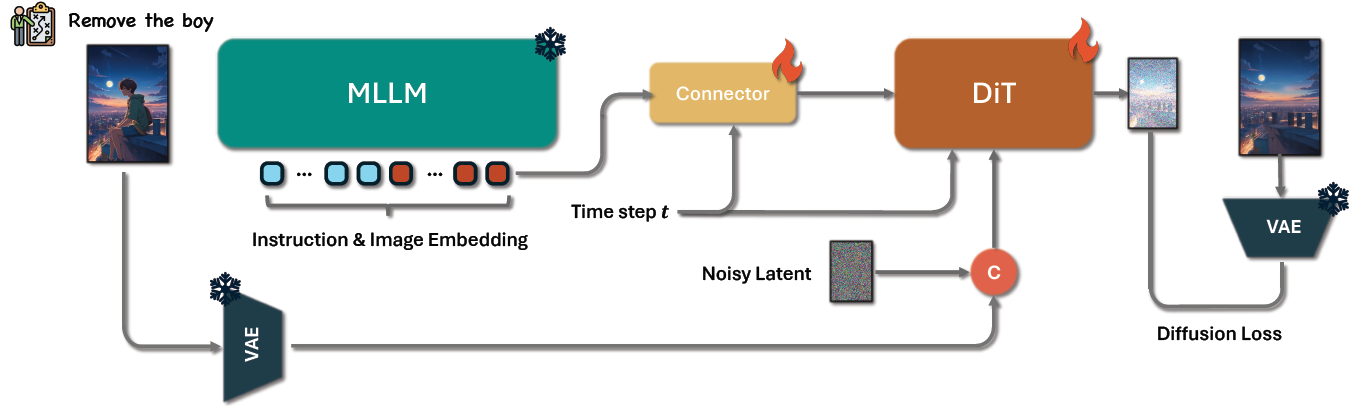

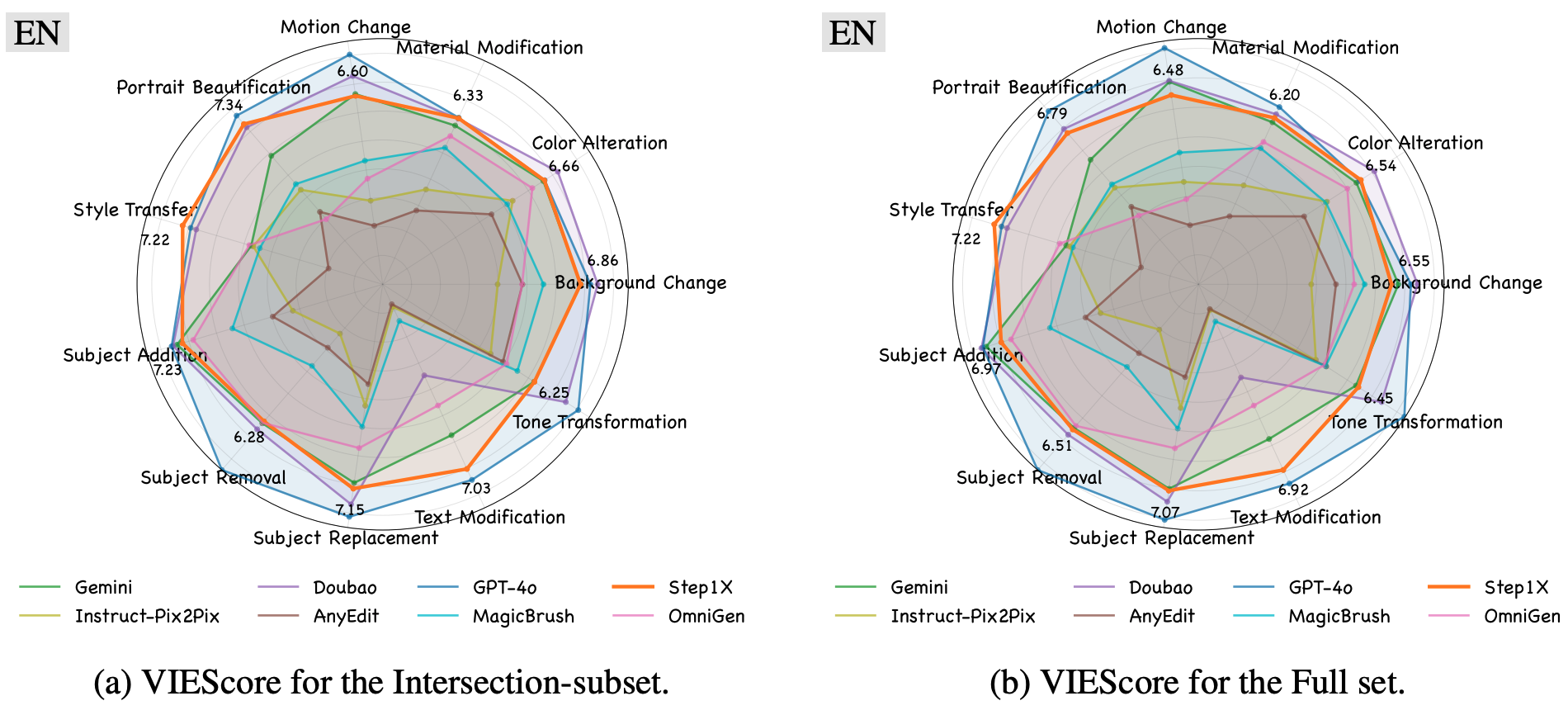

我们发布了最先进的图像编辑模型 Step1X-Edit,其性能可与 GPT-4o 和 Gemini2 Flash 等闭源模型相媲美。更具体地说,我们采用了多模态 LLM 来处理参考图像和用户的编辑指令。我们提取了潜在嵌入,并将其与扩散图像解码器相结合,从而获得目标图像。为了训练模型,我们建立了一个数据生成管道,以生成高质量的数据集。为了进行评估,我们开发了 GEdit-Bench,这是一种植根于真实世界用户指令的新型基准。在 GEdit-Bench 上的实验结果表明,Step1X-Edit 的性能大大优于现有的开源基线,并接近领先的专有模型,从而为图像编辑领域做出了重大贡献。

模型用法

要求

下表列出了运行 Step1X-Edit 模型(批量大小 = 1,不含 cfg 蒸馏)编辑图像的要求:

| Model | height/width | Peak GPU Memory | 28 steps w flash-attn |

|---|---|---|---|

| Step1X-Edit | 512x512 | 42.5 GB | 5 s |

| Step1X-Edit | 768x768 | 46.5 GB | 11 s |

| Step1X-Edit | 1024x1024 | 49.8 GB | 22 s |

- 该模型在一个 H800 GPU 上进行测试。

- 测试操作系统:

*我们建议使用具有 80GB 内存的 GPU,以获得更好的生成质量。

资源

代码:https://github.com/stepfun-ai/Step1X-Edit

模型:https://huggingface.co/stepfun-ai/Step1X-Edit

184

184

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?