业务场景为多标签分类预测,传闻xgboost拿下了kaggle赛场大部分非xx数据的冠军,于是初试牛刀xgboost。

xgboost模型训练报错,百度翻了一圈没找到对应的解决方案,最终通过猜测可能的堵点以及逐个尝试破解,试出了解决方案。

本着开荒分享促进交流的原则,谨写此帖。

报错背景及内容

报错提示行是“xgb.train(plst, dtrain, num_rounds)”:

# xgboost模型训练

model = xgb.train(plst, dtrain, num_rounds)

报错关键提示,

简单版:

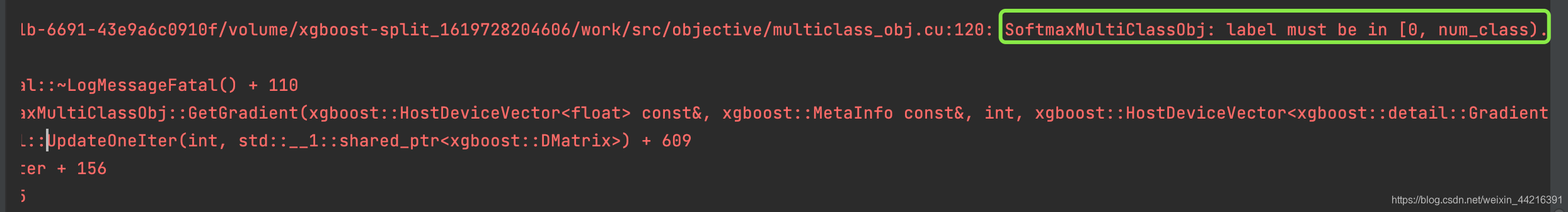

SoftmaxMultiClassObj: label must be in [0, num_class)

复杂版:

“xgboost.core.XGBoostError: [14:54:48] /opt/concourse/worker/volumes/live/7a2b9f41-3287-451b-6691-43e9a6c0910f/volume/xgboost-split_1619728204606/work/src/objective/multiclass_obj.cu:120: SoftmaxMultiClassObj: label must be in [0, num_class).”

报错提示详情如下2图:

本文记录了在使用XGBoost进行多标签分类预测时遇到的错误:`SoftmaxMultiClassObj: label must be in [0, num_class)`。通过分析报错信息,发现标签值需从1~6改为0~5。调整后,模型训练恢复正常。解决方案是将所有分类转换为0~N的取值,例如使用one-hot编码。分享这一经验,以帮助遇到类似问题的开发者。

本文记录了在使用XGBoost进行多标签分类预测时遇到的错误:`SoftmaxMultiClassObj: label must be in [0, num_class)`。通过分析报错信息,发现标签值需从1~6改为0~5。调整后,模型训练恢复正常。解决方案是将所有分类转换为0~N的取值,例如使用one-hot编码。分享这一经验,以帮助遇到类似问题的开发者。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1049

1049

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?