论文题目:EXPLAINABLE SUBGRAPH REASONING FOR FORE-

CASTING ON TEMPORAL KNOWLEDGE GRAPHS

摘要

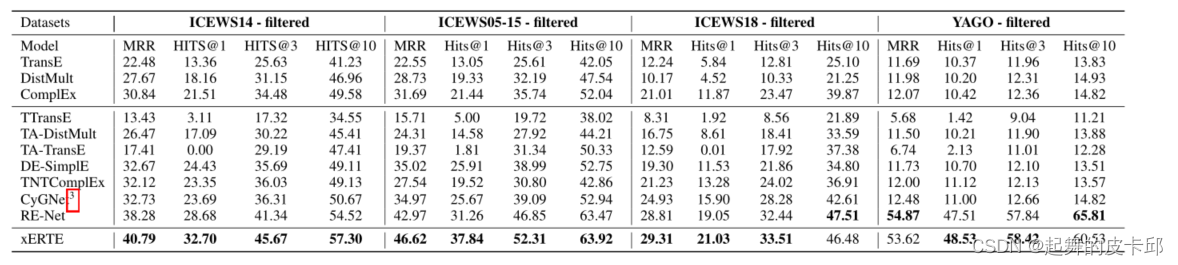

建模时间演进的知识图(KGs)最近引起了越来越多的兴趣。在此,图表示学习已经成为tkg链接预测的主导范式,然而,基于嵌入的方法在很大程度上是一种黑箱方式,缺乏解释其预测的能力。本文提出了一种对TKGs查询相关子图进行推理的链接预测框架,并对结构相关性和时序动态性进行联合建模。提出了一种时间关系注意机制和一种新的反向表示更新方案来指导查询周围的封闭子图的提取。该子图通过时间近邻的迭代采样和注意力传播进行扩展。本文方法提供了人类可以理解的证据来解释预测。在四个基准时间知识图上评估模型,用于链接预测任务。与之前的最佳时间KG预测方法相比,模型在Hits@1上获得了高达20%的相对改进。还对53名受访者进行了调查,结果表明,链接预测模型提取的证据与人类的理解是一致的。

本文贡献

- 开发了一个可解释的模型xERTE,该模型基于时间关系注意机制,保留了时间多关系数据的因果性;

- 与大多数基于黑盒嵌入的模型不同,xERTE将推理过程可视化,并提供一个可解释的推理图来强调重要的证据;

- 动态修剪过程使模型能够对具有数百万条边的大规模时态知识图进行推理;

模型

模型在动态扩展的推理图Ginf上进行推理,给定查询q = (eq, pq, ?, tq),我们用节点vq = (eq, tq)初始化Ginf,采样vq的先验扩展推理图。该嵌入模块的主要目标是让节点访问与查询无关的信息,并获得更广泛的图结构视图,因为接下来的时间关系图关注(TRGA)层只在该图执行与查询相关的消息传递。

将推理图输入TRGA层,该层以节点嵌入和谓词嵌入作为输入,通过在小推理图上传递消息为每个节点生成一个查询依赖的表示,并为每个边计算一个查询依赖的注意分数。

通过修剪获得较少关注的边缘来减少边缘数量。

随着扩展和修剪的迭代,Ginf从TKG中分配了越来越多的信息。运行L推理步骤后,模型选择Ginf中注意力得分最高的实体作为缺失查询对象的预测,推理图本身作为图形解释。

近邻抽样

定义节点v = (ei, t)和它的先验邻居Nv之间的边集为Qv。先验边子集^Qv,节点的先验邻居和后验邻居分别为ˆNv和-ˆNv。

提供三种不同的抽样策略:

-

均匀采样。每个先验边qv∈Qv被选中的概率相同。

-

时间感知指数加权抽样。近邻采样的概率为P(qv = (ei, pk, ej, t0)) =exp(t’− t) /

∑(ei,pl,em,t‘’)∈Qv exp(t’’ − t) -

时间感知线性加权抽样。使用线性函数来偏置抽样。

第二种最好

嵌入

实体ei在时间t的嵌入由静态低维向量和时间的函数表示组成。

时间嵌入定义为ei(t) =[¯ei || Φ(t)] T,¯ei表示静态嵌入,它捕获时间不变的特征和TKG上的全局依赖性,Φ(·)表示一种时间编码,用于捕获实体之间的时间依赖性。

时间关系图注意层(TRGA)

TRGA层用于识别推理图中与给定查询q相关的证据。TRGA层的输入是给定推理图中的一组实体嵌入ei(t)和谓词嵌入pk。该层为每条边生成一个依赖于查询的注意力分数,并输出一组新的隐藏表示。与GraphSAGE和GAT类似,TRGA层执行局部表示聚合。为了避免误用未来信息,只允许消息从前邻传递到后邻。

聚合函数将节点v的表示和采样的先验邻居ˆNv融合,输出v的时间感知表示,并在注意函数中加入谓词嵌入来挖掘关系信息,将查询信息考虑在内给每个邻居不同的重要性。

所求即为边pk对查询q的注意分数,hvl-1表示节点v在(l-1)th的推理步骤,当l=1时hv0 = Wvei(t)+bv,其中v=(ei,t)。

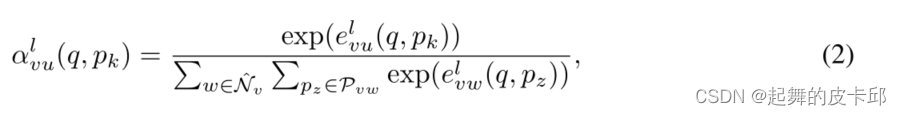

使用softmax函数计算归一化注意得分αlvu(q, pk):

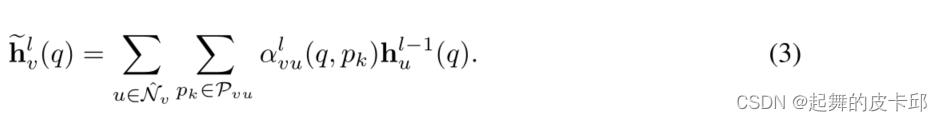

其中Pvw表示连接节点v和w的边的标签集。一旦得到,我们将先验邻居的表示集合起来,并使用归一化注意分数对它们进行加权,它被写为

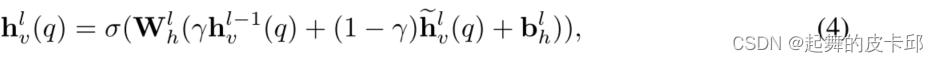

将节点v的隐藏表示hl−1v (q)与聚集的邻域表示-hlv(q)结合起来,并将它们输入一个带有LeakyReLU激活函数σ(·)的全连接层,如下所示

式中hlv(q)表示节点v在Lth推断步骤,γ为超参数。此外,我们使用同一层来更新关系嵌入,其形式为plk = Wlhpl−1 k + blh。因此,关系被投影到相同的嵌入空间作为节点,并可以利用在下一步的推断步骤。

注意传播与子图修剪

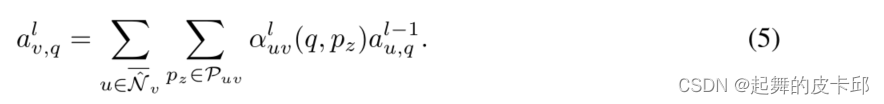

得到推理图中边缘的注意分数后,节点v在第lth步对查询q的注意分数为:

将实体相同的节点的注意力分数进行汇总

alei,q为实体ei的注意得分,VGinf为推理图Ginf中的节点集。V (e)表示节点V中包含的实体,g(·)表示一个分数聚合函数。尝试两个分数聚合函数g(·),分别为sum和mean,发现sum更好。

反向表示更新机制

应该确保推理图Ginf中所有现有的节点都能接收到来自新添加到Ginf中的节点的消息。

提出了一种新的反向表示更新机制。具体来说,在第lth推理步骤,首先更新在(l−1)th推理步骤添加的节点表示,然后更新在(l−2)th推理步骤添加的节点表示,以此类推,直到l = 0。

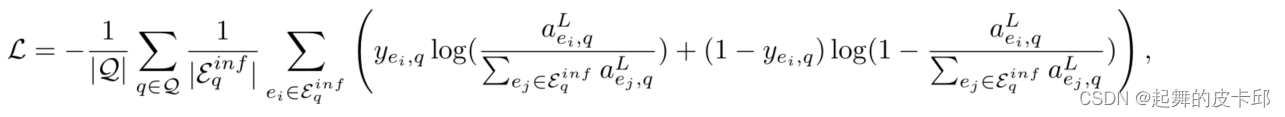

损失函数

用二元交叉熵作为损失函数

E infq表示查询q的推理图中的实体集合,yei,q表示表示ei是否是q的答案的二值标签,Q为训练四元组集合,aLei,q表示ei在最后推理步骤的注意得分。

结果

2144

2144

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?