论文链接: YOLOv9: Learning What You Want to Learn Using Programmable Gradient

代码链接:GitHub - WongKinYiu/yolov9: Implementation of paper - YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information

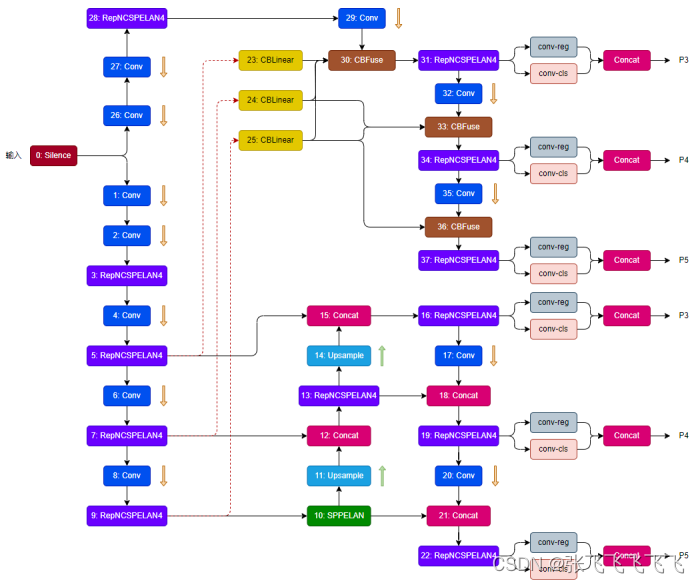

YOLOv9网络结构图

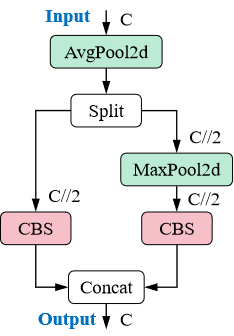

ADown详细介绍

YOLOv9中的ADown模块是一种用于目标检测任务中的下采样操作的卷积块。在深度学习模型中,下采样(downsampling)是减少特征图空间维度的常用技术,它有助于模型在更高层次上捕捉图像的特征,同时减少计算量。ADown模块的设计旨在以一种高效且对性能影响较小的方式进行这一操作。

ADown模块的主要特点:

-

轻量化设计:ADown模块通过减少参数量来降低模型的复杂度,这有助于提高模型的运行效率,尤其是在资源受限的环境中。

-

保持信息:尽管ADown旨在降低特征图的空间分辨率,但其设计也注重保留尽可能多的图像信息,以便于模型能够更准确地进行目标检测。

-

可学习能力:ADown模块被设计为具有一定的可学习能力,这意味着它可以根据不同的数据场景进行调整,以优化其性能。

-

改进的精度:根据一些资料,使用ADown模块不仅可以减少模型的大小,还可以提高目标检测的精度。

-

灵活性:ADown模块可以集成到YOLOv9的backbone和head中,提供多个配置选项以适应不同的改进方法。

-

与其他技术的结合:ADown模块可以与其他改进技术结合使用,例如HWD(小波下采样)模块,以进一步提升性能5。

ADown模块的应用:

ADown模块在YOLOv9中的使用示例可以在其配置文件中找到,它被用于替换传统的下采样操作,如Conv模块。在backbone中,ADown可以用于在特征图的不同层之间进行下采样,而在head部分,它可以帮助进一步细化特征图的分辨率,以便于更精确的目标检测。

实现细节:

ADown模块的具体实现可能包括以下步骤:

- 卷积操作:使用卷积层来提取特征图中的有用信息。

- 步幅调整:通过调整卷积层的步幅(stride),减少特征图的空间维度。

- 参数优化:优化卷积层中的参数数量,以减少模型的复杂度。

性能提升:

通过在YOLOv9中引入ADown模块,可以实现参数量的显著下降,同时保持或甚至提升目标检测的精度。例如,在YOLOv8的改进中,将ADown添加到backbone和head处,可以提供多个配置选项以适应不同的改进方法,这有助于实现更高的性能32。

结论:

ADown模块是YOLOv9中的一个创新点,它通过轻量化设计和灵活性,为实时目标检测模型提供了一个有效的下采样解决方案。随着目标检测技术的发展,ADown模块及其衍生技术可能会成为未来模型设计中的一个重要组成部分

ADown网络结构图

代码

class ADown(nn.Module):

def __init__(self, c1, c2): # ch_in, ch_out, shortcut, kernels, groups, expand

super().__init__()

self.c = c2 // 2

self.cv1 = Conv(c1 // 2, self.c, 3, 2, 1)

self.cv2 = Conv(c1 // 2, self.c, 1, 1, 0)

def forward(self, x):

x = torch.nn.functional.avg_pool2d(x, 2, 1, 0, False, True)

x1,x2 = x.chunk(2, 1)

x1 = self.cv1(x1)

x2 = torch.nn.functional.max_pool2d(x2, 3, 2, 1)

x2 = self.cv2(x2)

return torch.cat((x1, x2), 1)实测在YOLOv8中有提点

ADown是YOLOv9中的一种创新下采样模块,通过轻量化设计和学习能力,优化了目标检测的精度和效率。它在YOLOv8中表现出良好的性能提升潜力,适用于实时应用。

ADown是YOLOv9中的一种创新下采样模块,通过轻量化设计和学习能力,优化了目标检测的精度和效率。它在YOLOv8中表现出良好的性能提升潜力,适用于实时应用。

2010

2010

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?