ECA-Net:深度卷积神经网络中的高效通道注意力机制

在深度学习领域,特别是在深度卷积神经网络(DCNN)中,注意力机制已经成为提升模型性能的关键技术之一。其中,ECA模块(Efficient Channel Attention)作为一种新型的通道注意力机制,凭借其高效性和自适应特性,为网络提供了更强大的特征表示能力。本文将详细介绍ECA模块的工作原理、独特优势,并通过公式总结其核心机制。

一、通道注意力的作用

在深度卷积神经网络中,通道注意力机制的主要作用在于增强模型对重要特征的关注,从而提升模型在各种视觉任务上的性能。通过引入通道注意力,模型可以学习到每个通道特征的重要性,并据此调整不同通道的输出权重,使得网络更加关注对当前任务有利的特征。

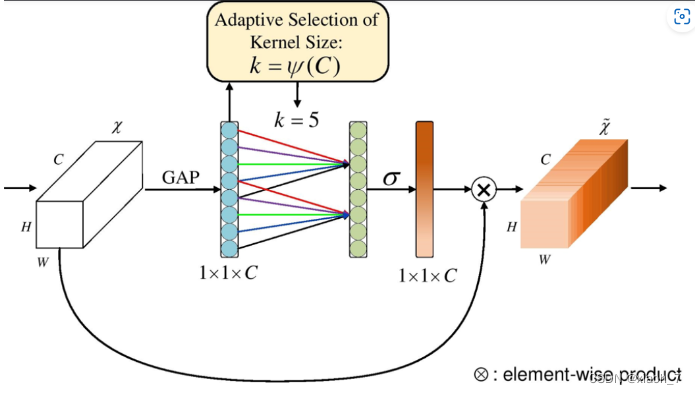

二、ECA模块的机制

ECA模块的核心思想是通过一维卷积来捕捉通道间的依赖关系。与传统的注意力机制相比,ECA模块避免了复杂的降维和升维过程,从而实现了高效和轻量级的特性。

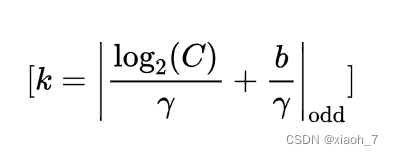

具体来说,ECA模块首先根据通道数自适应地计算一维卷积的核大小k。核大小的计算公式如下:

这个公式用于计算一维卷积的核大小k,其中C是输入特征的通道数,(\gamma)和b是超参数。取绝对值并向下取整到最近的奇数是为了确保核大小是奇数。

得到核大小k后,ECA模块将一维卷积应用于输入特征上,从而学习每个通道相对于其他通道的重要性。这个过程可以用以下公式表示:

![[ \text{out} = \text{Conv1D}_{k}(\text{in}) ]](https://i-blog.csdnimg.cn/blog_migrate/7b7aceb2f9df5010c5aa7ea607ca5792.png)

这个公式表示通过一维卷积操作(核大小为k)将输入特征in转换为输出特征out。Conv1D_{k}表示核大小为k的一维卷积操作。

三、ECA模块的独特优势

1. 计算高效

由于ECA模块避免了复杂的降维和升维过程,以及使用了简单的一维卷积操作,因此其计算效率非常高。这使得ECA模块能够在不增加显著计算负担的情况下,为模型带来性能提升。

2. 保留信息完整性

与传统的注意力机制相比,ECA模块无需进行降维和升维的操作,从而保留了原始通道特征的信息完整性。这有助于模型更好地利用通道间的依赖关系,提升特征表示能力。

3. 自适应核大小

ECA模块能够根据通道数自适应地调整一维卷积的核大小,使其能够灵活地捕捉不同范围内的通道依赖性。这种自适应机制使得ECA模块在不同规模的网络和不同深度的层次中都能有效工作。

4. 易于集成

由于其轻量级和高效的特性,ECA模块可以轻松地嵌入到任何现有的CNN架构中。无需对原始网络架构进行大的修改,即可为模型带来性能提升。这使得ECA模块成为一种简单而有效的网络优化手段。

五、代码实现

import torch

from torch import nn

from torch.nn import init

# 定义ECA注意力模块的类

class ECAAttention(nn.Module):

def __init__(self, kernel_size=3):

super().__init__()

self.gap = nn.AdaptiveAvgPool2d(1) # 定义全局平均池化层,将空间维度压缩为1x1

# 定义一个1D卷积,用于处理通道间的关系,核大小可调,padding保证输出通道数不变

self.conv = nn.Conv1d(1, 1, kernel_size=kernel_size, padding=(kernel_size - 1) // 2)

self.sigmoid = nn.Sigmoid() # Sigmoid函数,用于激活最终的注意力权重

# 权重初始化方法

def init_weights(self):

for m in self.modules():

if isinstance(m, nn.Conv2d):

init.kaiming_normal_(m.weight, mode='fan_out') # 对Conv2d层使用Kaiming初始化

if m.bias is not None:

init.constant_(m.bias, 0) # 如果有偏置项,则初始化为0

elif isinstance(m, nn.BatchNorm2d):

init.constant_(m.weight, 1) # 批归一化层权重初始化为1

init.constant_(m.bias, 0) # 批归一化层偏置初始化为0

elif isinstance(m, nn.Linear):

init.normal_(m.weight, std=0.001) # 全连接层权重使用正态分布初始化

if m.bias is not None:

init.constant_(m.bias, 0) # 全连接层偏置初始化为0

# 前向传播方法

def forward(self, x):

y = self.gap(x) # 对输入x应用全局平均池化,得到bs,c,1,1维度的输出

y = y.squeeze(-1).permute(0, 2, 1) # 移除最后一个维度并转置,为1D卷积准备,变为bs,1,c

y = self.conv(y) # 对转置后的y应用1D卷积,得到bs,1,c维度的输出

y = self.sigmoid(y) # 应用Sigmoid函数激活,得到最终的注意力权重

y = y.permute(0, 2, 1).unsqueeze(-1) # 再次转置并增加一个维度,以匹配原始输入x的维度

return x * y.expand_as(x) # 将注意力权重应用到原始输入x上,通过广播机制扩展维度并执行逐元素乘法

# 示例使用

if __name__ == '__main__':

block = ECAAttention(kernel_size=3) # 实例化ECA注意力模块,指定核大小为3

input = torch.rand(1, 64, 64, 64) # 生成一个随机输入

output = block(input) # 将输入通过ECA模块处理

print(input.size(), output.size()) # 打印输入和输出的尺寸,验证ECA模块的作用

六、总结

ECA模块作为一种高效的通道注意力机制,在深度卷积神经网络中展现出了显著的优势。通过自适应地计算一维卷积的核大小,ECA模块能够灵活地捕捉通道间的依赖关系,从而增强模型的特征表示能力。同时,其轻量级和高效的特性使得ECA模块易于集成到各种CNN架构中,为提升网络性能提供了一种简单而有效的方法。未来,我们可以进一步探索ECA模块在其他视觉任务中的应用,并研究如何进一步优化其性能。

参考资料

《ECA-Net: Efficient Channel Attention for Deep Convolutional Neural Networks》

版权声明

本博客内容仅供学习交流,转载请注明出处。

20万+

20万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?