前段时间,Meta 开源了 Llama 3.2 轻量化模型,为移动端跑大模型提供了新选择!

同时,Llama 3.2 视觉模型(Llama 3.2 Vision)也正式开源,号称媲美 GPT-4o。

前两天,Llama 3.2 Vision 已在 Ollama 上线!

今日分享,就对它实测一番。

最后,应用到我们上篇的票据识别任务中,看看效果真有官宣的那么惊艳么?

1. Llama 3.2 亮点

老规矩,还是简短介绍下:Llama 3.2 都有哪些亮点?

一句话:轻量化 + 视觉多模态能力!

具体点:

-

文本模型:有 1B 和 3B 版本,即便参数少,也支持128k tokens的上下文长度;基于LoRA和SpinQuant 对模型进行深度优化,内存使用量减少41%,推理效率翻了2-4倍。

-

多模态模型:有 11B 和 90B 版本,在视觉理解方面,与Claude3 Haiku和GPT 4o-mini 可 PK。

2. Llama 3.2 实测

Ollama 是面向小白友好的大模型部署工具,为此本篇继续采用 Ollama 跑 Llama 3.2。

不了解 Ollama 的小伙伴,可翻看教程:

2.1 环境准备

参考上述教程,假设你在本地已经准备好 Ollama。

当前 Ollama Library 中已支持 Llama 3.2 下载,因此,一行命令拉起 llama3.2-vision。

ollama run llama3.2-vision

如果遇到如下报错:

pulling manifest Error: pull model manifest: 412: The model you are attempting to pull requires a newer version of Ollama.

说明你的 ollama 版本需要更新了。

如果你也和我一样,采用 docker 安装,则需要删除容器,重新下载最新镜像进行安装:

docker stop ollama docker rm ollama docker image rm ollama/ollama # 注:海外镜像,国内用户需自备梯子 docker pull ollama/ollama

可以发现,当前最新版本为 0.4.1:

ollama --version ollama version is 0.4.1

然后,再起一个容器:

docker run -d --gpus "device=2" -v ollama:/root/.ollama -p 3002:11434 --restart unless-stopped --name ollama ollama/ollama

注:我这里指定 --gpus "device=2",如果单张显存不够,需指定多张卡,Ollama 会帮你自动分配。

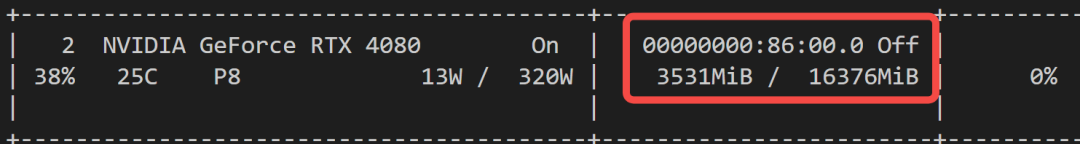

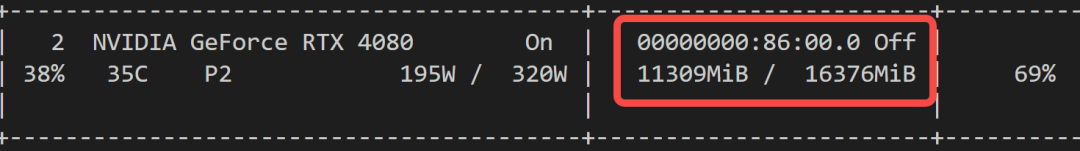

显存占用情况如何?

2.2 文本模型

进入容器,并下载模型 llama3.2 3B版本:

docker exec -it ollama /bin/bash ollama run llama3.2

显存占用:请确保至少 4 G 显存。

2.3 多模态模型

进入容器,并下载模型 llama3.2-vision 11B版本:

docker exec -it ollama /bin/bash ollama run llama3.2-vision

显存占用:请确保至少 12 G 显存。

注:ollama 中模型默认采用了 4bit 量化。

3. 接入 Dify

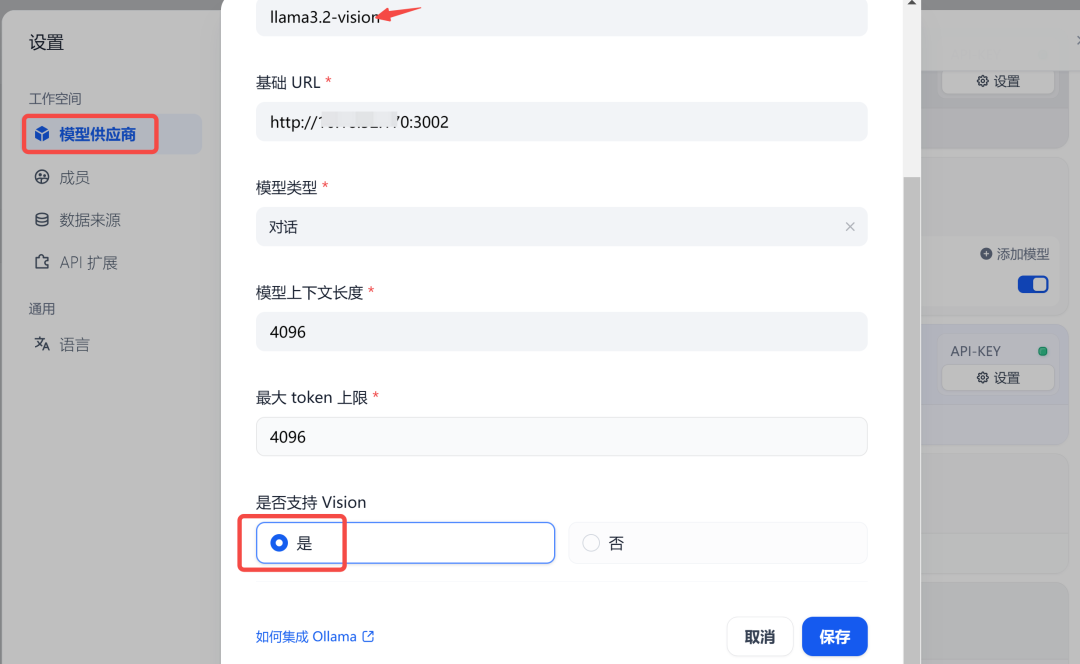

3.1 模型接入

要把 Ollama 部署的模型接入 Dify 有两种方式。

首先,找到设置 - 模型供应商。

**方式一:**找到 Ollama 类型,然后进行添加,记得把Vision能力打开:

方式二:

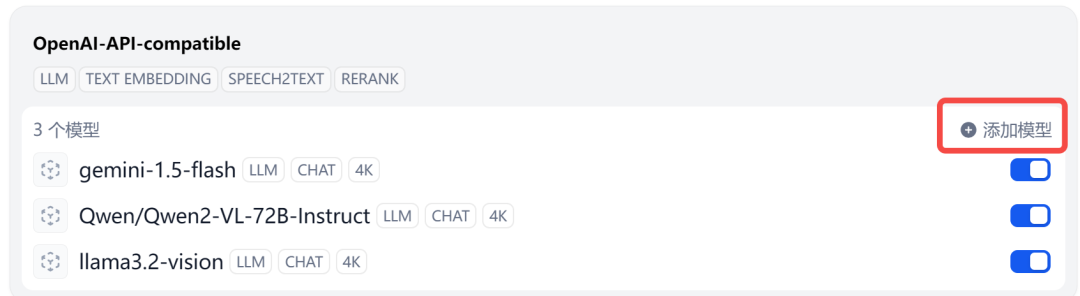

把 Ollama 模型接入 OneAPI,然后在模型供应商这里选择 OpenAI-API-compatible。

个人更推荐 方式二,你会体会到接口统一的快乐~

3.2 应用集成

最后,我们在上篇的基础上,把用到 Qwen2-VL 的组件,LLM 全部替换成刚刚接入的 llama3.2-vision,如下图:

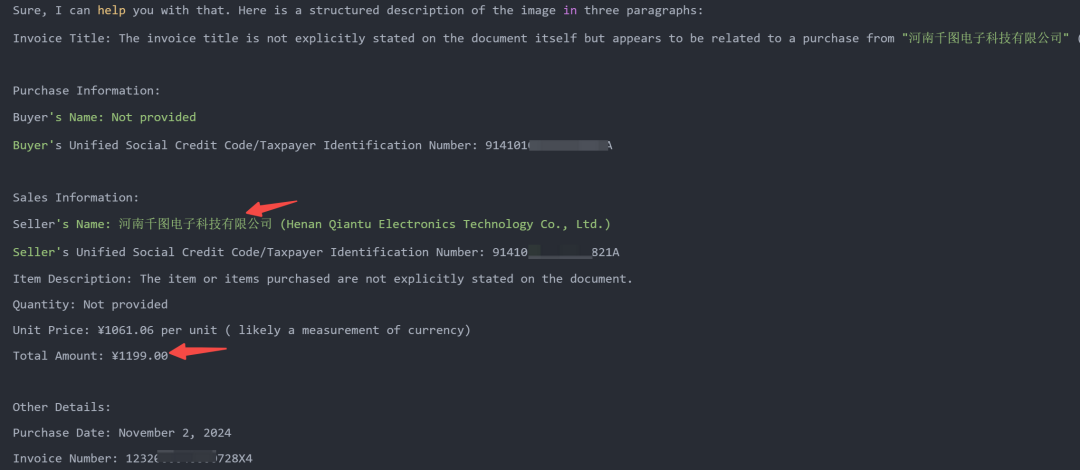

实测效果咋样?

嗯~ o( ̄▽ ̄)o 价格等基本信息还是抓到了。

只是,相比上篇实测的 Qwen2-VL 就差点意思了:

-

从中文指令遵循上看:给到同样的提示词,llama3.2-vision 压根不按你的意图来;

-

从识别结果上看:中文 OCR 也被 Qwen2-VL 甩开好几条街。

当然,换用 90B 的模型会不会好很多?感兴趣的朋友可以试试~

结论:现阶段,对于票据识别这个任务而言,综合考虑成本和效果,还是调用云端的 Qwen2-VL-72B 吧。

写在最后

本文带大家本地跑了 Meta 最新开源的 Llama 3.2,并在票据识别任务上进行了实测。

个人体验而言:Llama 系列,都得在中文指令数据上微调后,才能中文场景中使用,同等参数规模下,国产大模型其实更具性价比。

如果对你有帮助,欢迎点赞收藏备用。

如何学习AI大模型 ?

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。【保证100%免费】🆓

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

👉1.大模型入门学习思维导图👈

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

对于从来没有接触过AI大模型的同学,我们帮你准备了详细的学习成长路线图&学习规划。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。(全套教程文末领取哈)

👉2.AGI大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。

👉3.大模型实际应用报告合集👈

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(全套教程文末领取哈)

👉4.大模型落地应用案例PPT👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(全套教程文末领取哈)

👉5.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(全套教程文末领取哈)

👉6.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(全套教程文末领取哈)

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

2195

2195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?