你是否困惑:为何AI既能和你聊哲学、写科幻,但面对财报里“伪装”成正常数据的债务危机,或是法律条款间环环相扣的侵权陷阱时,却像“博而不精”的优等生,答案总差半步精准?这就像一位“通才学霸”虽然知识面广,但遇到具体学科难题时也需要“补课”——而模型微调(Fine-tuning)就是给AI“精准补课”的技术。

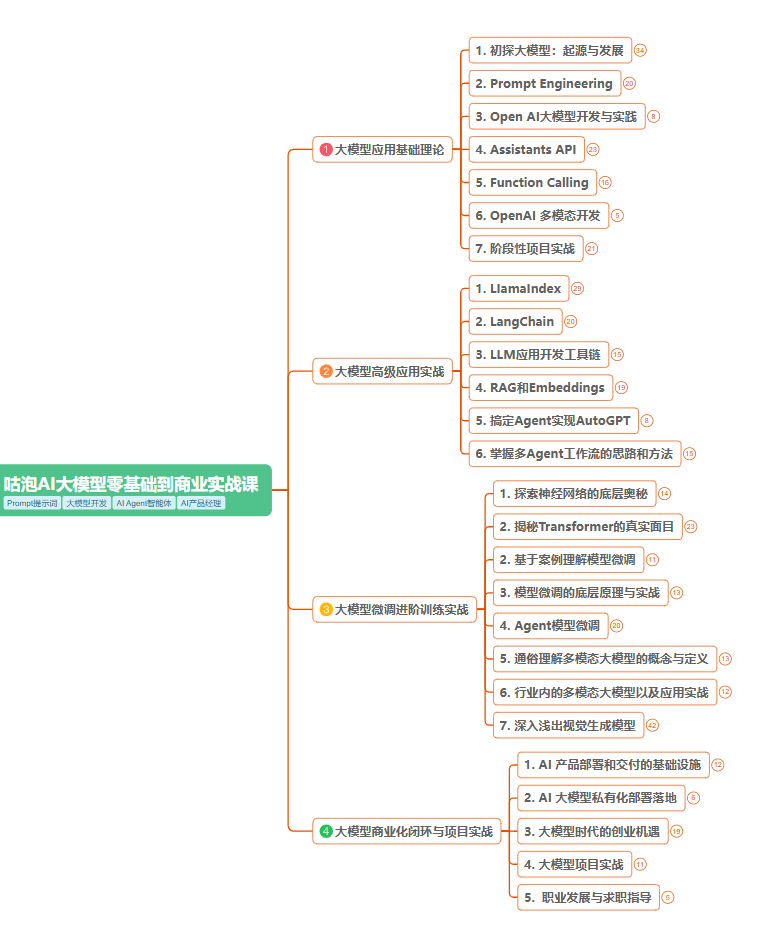

绝对通俗易懂!9小时精讲大模型预训练微调+四大多模态大模型CLIP BLIP VIT MLLM+对话机器人办公助手

一、概念解读

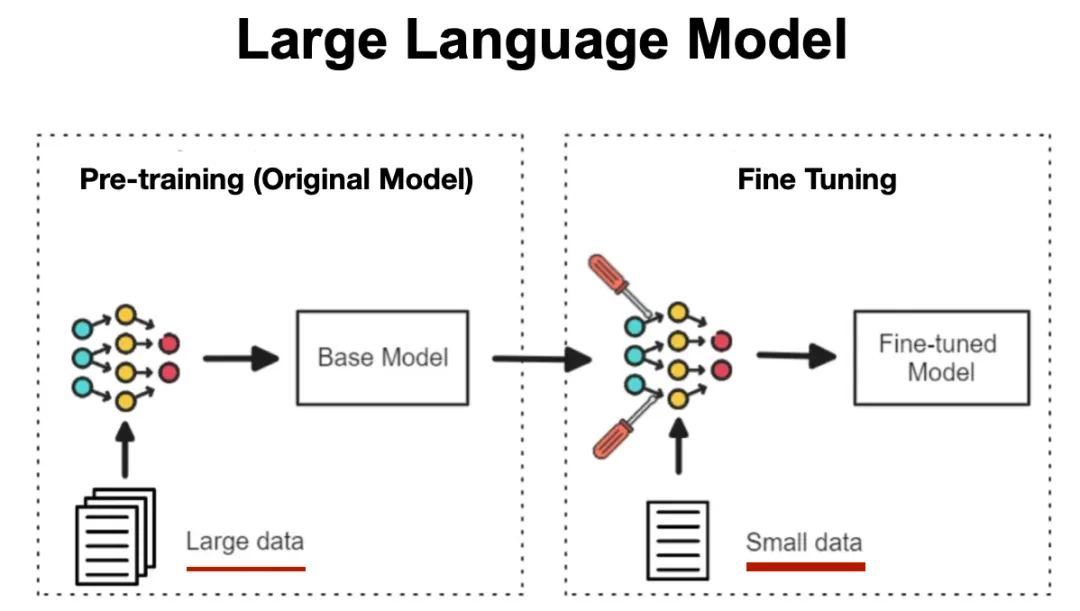

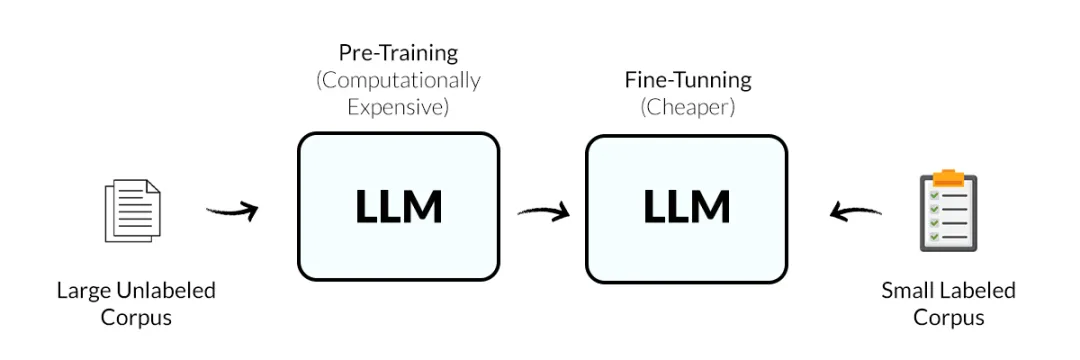

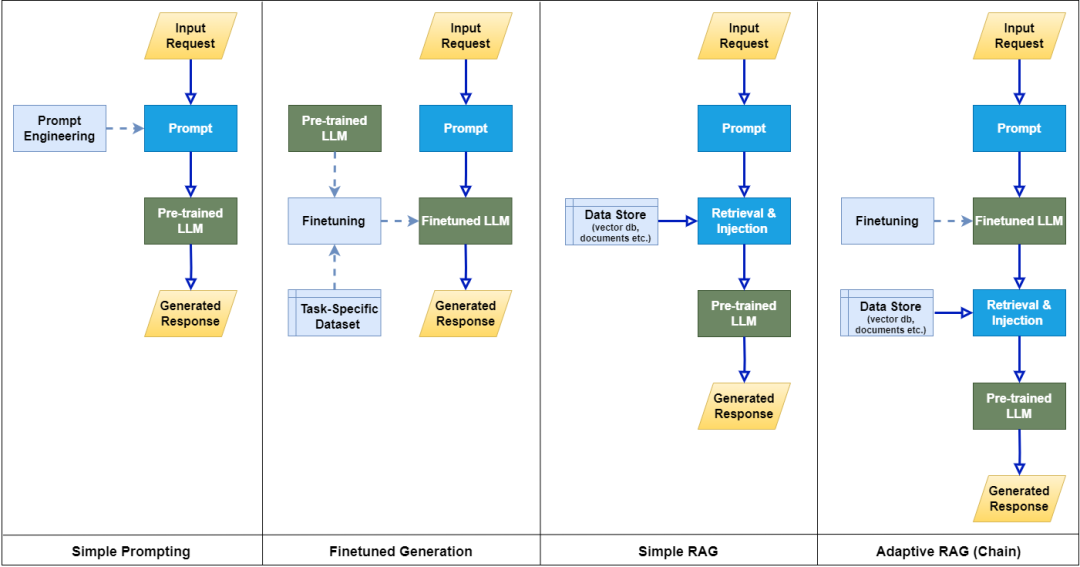

Fine-tuning(模型微调)到底是个啥?模型微调是在预训练大模型(如DeepSeek、LLaMA、Qwen等)的基础上,用特定领域或任务的数据集对模型参数进行二次训练,让大模型“从通才成为专家”。

-

预训练模型:已在大规模无标注数据上学习通用特征(如语言规则、物体识别)。

-

微调:注入领域专属知识(如医疗术语、金融逻辑),使模型具备特定场景下的专业能力。

模型微调的本质是通过参数优化、数据适配与领域约束,将通用大模型的能力“聚焦”到特定场景,使其在保持基础能力的同时,精准适配行业需求。

1. 参数优化:从“泛化”到“特化”

大模型预训练时学习了全网海量数据(如满血版DeepSeek的6710亿参数),但这些知识是“泛化”的,微调通过调整部分参数(如1%-10%的参数),让模型在保留基础能力的同时,强化对领域数据的敏感度。

2. 数据适配:从“通用语料”到“领域知识库”

微调需使用领域专属数据(如法律需判例库),而非通用文本。数据需“小而精”,而非“大而杂”。例如,1000条标注的法律案例数据,可能比100万条通用文本更有效。

3. 领域约束:从“自由联想”到“专业逻辑”

通用模型可能生成“看似合理但错误”的答案(如法律条款引用错误)。微调通过损失函数设计(如增加法律条款一致性约束),让模型输出更符合领域逻辑(如引用《民法典》第X条)。

为什么需要Fine-tuning(模型微调)?通用模型难以适配细分场景的专业需求,而微调能以极少量领域数据(1000+标注)和超低计算成本(节省90%+资源),快速定制出高精度、可落地的行业专家模型。

通过合理选择数据策略和微调方法,即使新手也能在1周内完成首个定制化模型。随着QLoRA等PEFT技术的发展,微调门槛持续降低。最新数据显示,80%的企业级AI应用已采用微调方案。

二、技术实现

Fine-tuning(模型微调)如何进行技术实现?资源受限时,优先用QLoRA通过‘量化压缩’与‘LoRA精调’降低显存需求;快速验证任务可行性时,用Prompt Engineering低成本试水;LlamaFactory则用“工具箱”实现一站式微调。

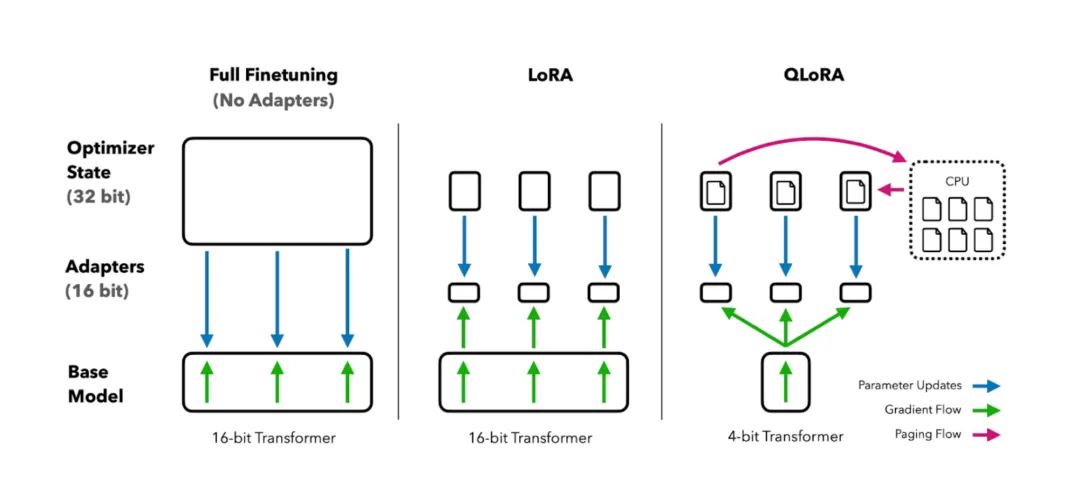

1. QLoRA——用“手术刀”式微调突破硬件瓶颈

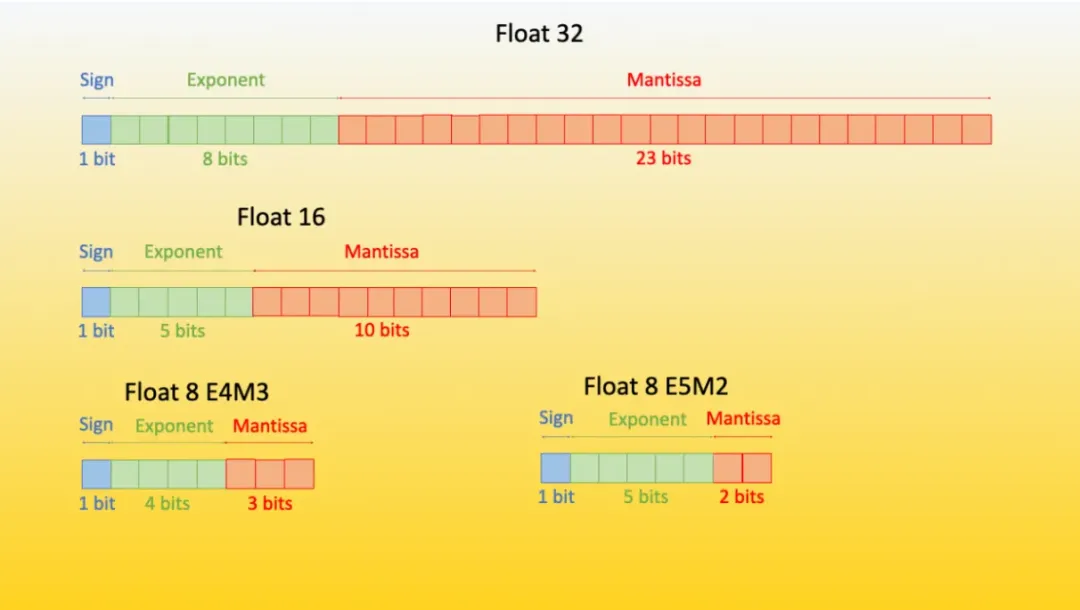

(1)量化:将模型参数从16-bit压缩至4-bit(33B模型显存占用从128GB降至24GB),类似“压缩饼干”技术,推理时解压无损精度。

(2)LoRA:冻结99.9%参数,仅在注意力层插入低秩矩阵(200万可调参数),显存消耗降低90%,类似“给模型戴眼镜聚焦领域任务”。

(3)单卡微调:用1张RTX 4090(24GB显存)微调DeepSeek-70B,相同精度下,QLora训练速度提升3倍,硬件成本降低85%。

2. Prompt Engineering——用“钥匙”解锁领域能力

(1)任务约束:通过提示词模板强制模型输出特定格式(如法律AI提示“根据《专利法》第22条分析”),条款引用准确率从55%提升至82%。

(2)零参数调整:无需训练,仅需设计3-5组提示词对比效果,成本接近于零。

3. LlamaFactory——用“工具箱”实现一站式微调

(1)方法集成:内置LoRA、全量微调、RLHF(偏好对齐)等6种策略,支持“即插即用”式组合(如LoRA+RLHF提升对话一致性)。

(2)配置化训练:通过YAML文件定义参数(如学习率1e-5、批次大小32),避免代码级开发,效率提升60%。

2340

2340

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?