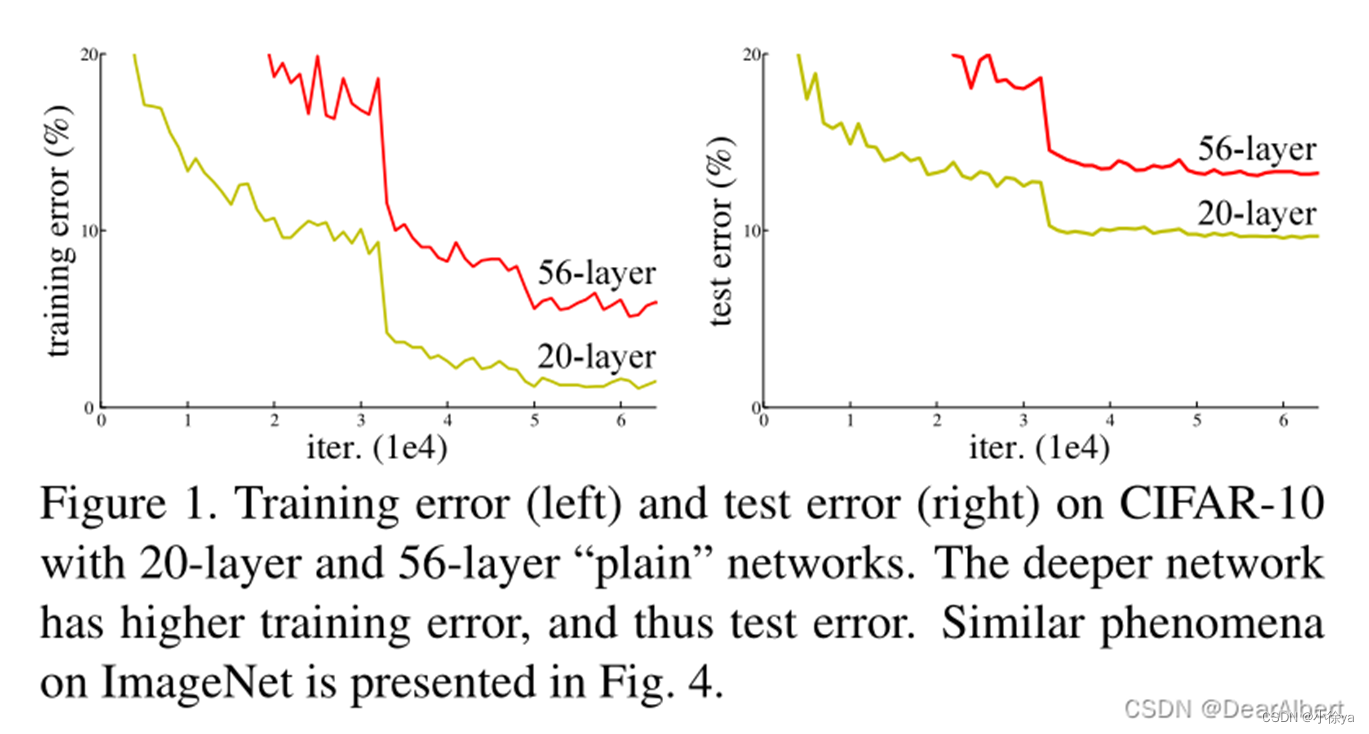

在残差结构提出之前,根据实验表明,随着网络层不断的加深,模型的准确率起初会不断的提高,达到最大饱和值,然后随着网络深度的继续增加,模型准确率不但不会继续增加,反而会出现大幅度降低现象,即

模型训练过程和测试过程的

error

比浅层模型更高

。

原论文将输入X(即input)经过一系列处理之后得到残差F(X),若是在shortcut分支上不经过downsample处理(即不经过conv1x1卷积+BN处理),则在最终得到的残差映射函数为F(X) + X,此种结构一般用在conv_x组块中的非第一层之后的层,即用在不需要改变前后输入输出维度的层。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5766

5766

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?