什么是MCP(Model Context Protocol)

MCP(模型上下文协议)是一个开放标准,用于规范化应用程序如何向大型语言模型(LLM)提供上下文信息。

简单来说,MCP就像AI应用的USB-C接口 —— 正如USB-C为设备提供了与各种外设连接的标准方式,MCP为AI模型提供了与不同数据源和工具连接的标准方式。

MCP由Anthropic公司于2024年底推出并开源,旨在解决AI助手与数据源集成的问题。无论你是在开发AI驱动的IDE、增强聊天界面,还是创建自定义AI工作流,MCP都提供了一种标准化的方式,将LLM与它们所需的上下文连接起来。

MCP为什么重要?

在AI快速发展的今天,大型语言模型已经变得非常强大,但它们仍然受到一个关键限制:与外部数据和工具的隔离。每添加一个新的数据源或工具,都需要创建自定义实现,这使得真正连接的系统难以扩展。

MCP正是为解决这一挑战而生,它提供了以下核心优势:

- 标准化连接:用统一协议替代碎片化的集成方式

- 上下文感知:帮助AI模型理解并记住对话历史和用户偏好

- 安全数据共享:在用户控制下安全地访问数据

- 工具使用能力:让AI模型可以执行实际操作

- 供应商中立:灵活切换不同的LLM提供商

MCP核心架构

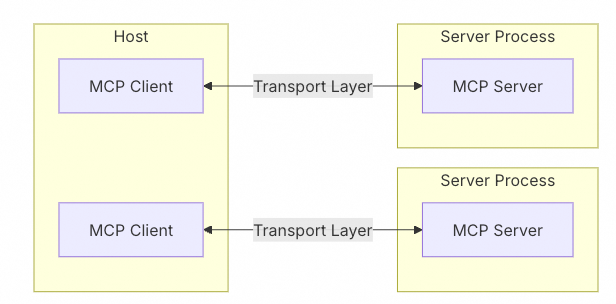

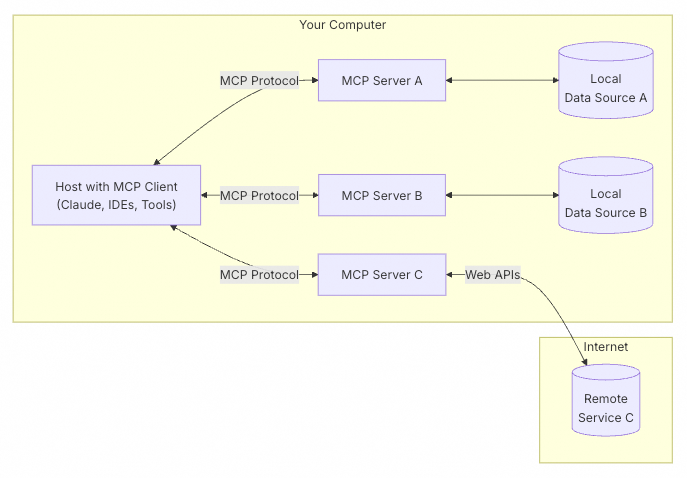

MCP采用客户端-服务器架构,由以下关键组件组成:

- MCP主机(Hosts):如Claude Desktop、IDE或需要通过MCP访问数据的AI工具

- MCP客户端(Clients):与服务器保持一对一连接的协议客户端

- MCP服务器(Servers):通过标准化的MCP协议提供特定功能的轻量级程序

- 本地数据源:MCP服务器可以安全访问的计算机文件、数据库和服务

- 远程服务:MCP服务器可以连接的外部系统(如API)

MCP传输层机制:Stdio和SSE

MCP设计了灵活的传输层,用于处理客户端和服务器之间的通信。传输层是MCP架构中至关重要的一部分,它决定了消息如何在不同组件间传递。MCP支持两种主要的传输机制:Stdio和HTTP with SSE。

Stdio传输

Stdio(标准输入/输出)传输是MCP中最简单的通信机制,特别适合本地进程间通信:

工作原理:

- 使用进程的标准输入/输出流(stdin/stdout)传输JSON-RPC消息

- 客户端启动服务器进程并通过管道连接其stdin/stdout

- 消息通过这些管道以文本形式传输,每条消息以换行符分隔

优势:

- 极低的延迟,非常适合本地通信

- 简单且无需网络配置

- 无需担心网络安全问题

- 适合本地工具和插件集成

代码示例(Python服务器):

from mcp.server import MCPServer

from mcp.transport.stdio import StdioTransport

# 创建使用Stdio传输的MCP服务器

server = MCPServer(transport=StdioTransport())

await server.start()

HTTP with SSE传输

HTTP with SSE(Server-Sent Events)传输更适合远程通信和Web集成场景:

工作原理:

- 客户端到服务器的通信:使用标准HTTP POST请求

- 服务器到客户端的通信:使用SSE提供实时单向数据流

- SSE允许服务器通过HTTP连接向客户端推送消息,无需客户端请求

- 所有消息使用JSON-RPC 2.0格式编码

优势:

- 兼容Web标准,可通过HTTP防火墙

- 支持远程服务器连接

- 适合分布式系统架构

- 可扩展性更好,适合云部署

- 支持多客户端连接到同一服务器

SSE原理:

- 客户端建立与服务器的HTTP连接

- 服务器保持连接打开并发送格式化为

event: data的消息 - 客户端使用EventSource API处理这些事件

- 连接失败自动重连

代码示例(Python服务器):

from mcp.server import MCPServer

from mcp.transport.http_sse import HttpSseTransport

# 创建使用HTTP/SSE传输的MCP服务器

server = MCPServer(

transport=HttpSseTransport(host="127.0.0.1", port=8080)

)

await server.start()

传输层的选择

选择适合的传输机制取决于您的使用场景:

| 传输机制 | 最适合的场景 | 典型应用 |

|---|---|---|

| Stdio | 本地进程间通信 命令行工具和集成 单用户本地应用 | 桌面AI助手 本地IDE插件 命令行工具 |

| HTTP/SSE | 远程服务集成 Web应用 多用户系统 云部署 | 团队协作工具 SaaS应用 Web API 企业集成 |

在实际应用中,许多MCP实现允许动态选择传输机制,甚至可以同时支持多种传输方式,以便于不同场景下的灵活使用。

MCP核心功能

MCP的功能分为服务器和客户端组件,各自专注于不同方面,共同创建一个强大的AI集成框架。

1. 服务器功能

MCP服务器充当AI系统与周围数字世界之间的专业翻译器,提供以下关键功能:

资源(Resources)

资源是AI的参考库,提供了访问信息的能力:

- 文档:可以获取相关文件

- API响应:AI友好格式的结构化数据

- 数据库记录:对存储信息的直接访问

- 用户上下文:帮助定制响应的个性化信息

代码示例(Python):

from mcp.server import MCPServer

from mcp.features.resources import ResourceProvider

class FileSystemResourceProvider(ResourceProvider):

async def get_resource(self, resource_id: str):

# 从文件系统获取资源

with open(resource_id, 'r') as f:

content = f.read()

return {

"id": resource_id,

"content": content,

"mime_type": "text/plain"

}

server = MCPServer()

server.add_provider(FileSystemResourceProvider())

await server.start()

提示(Prompts)

提示就像AI交互的配方卡,确保每次都能获得一致的结果:

- 标准化交互:对常见场景的会话模板

- 提高输出质量:应用最佳实践

- 减少幻觉:为AI响应提供护栏

- 支持版本控制:可以为不同需求维护不同的提示变体

代码示例(TypeScript):

import { MCPServer } from '@modelcontextprotocol/server';

import { PromptProvider } from '@modelcontextprotocol/server/features';

const codeReviewPrompt = {

id: "code-review",

name: "代码审查",

description: "生成详细的代码审查反馈",

template: "请审查以下代码并提供反馈:\n\n{{code}}\n\n请关注:\n1. 代码质量\n2. 可能的bug\n3. 性能问题\n4. 安全隐患",

parameters: [

{

name: "code",

description: "需要审查的代码",

required: true

}

]

};

const server = new MCPServer();

const promptProvider = new PromptProvider([codeReviewPrompt]);

server.addProvider(promptProvider);

server.start();

工具(Tools)

工具将AI从对话伙伴转变为可以完成任务的主动助手:

- 函数调用:执行具有定义参数的特定操作

- API交互:与Web服务和平台通信

- 数据转换:处理和重塑信息

- 系统操作:在连接的系统上执行受控操作

代码示例(Python):

from mcp.server import MCPServer

from mcp.features.tools import ToolProvider, Tool

class WeatherTool(Tool):

def get_definition(self):

return {

"name": "get_weather",

"description": "获取指定城市的天气信息",

"parameters": {

"type": "object",

"properties": {

"city": {

"type": "string",

"description": "城市名称"

}

},

"required": ["city"]

}

}

async def execute(self, params):

city = params.get("city")

# 在实际应用中,这里会调用天气API

return f"{city}的天气:晴朗,温度25°C"

server = MCPServer()

server.add_provider(ToolProvider([WeatherTool()]))

await server.start()

2. 客户端功能

MCP客户端是AI模型和MCP服务器之间的桥梁,它帮助AI模型连接各种工具和资源:

资源访问

- 在对话中直接提及资源:使用如

@filename.txt的语法引用特定文件 - 访问结构化数据:来自文档、数据库和API

- 查看元数据:了解信息的来源、类型和可靠性

- 自动包含上下文:在需要时将相关信息带入对话

提示模板

- 斜杠命令:通过如

/summarize的命令访问提示模板 - 一致格式:确保不同对话之间的标准化输出

- 特定领域的模板:用于编码、写作或分析任务的专门提示

- 版本控制:使用特定版本的提示获得一致的结果

工具使用

- 函数执行:使用参数运行特定操作

- API集成:安全连接外部服务

- 系统操作:在连接的系统上执行操作

- 数据操作:转换和处理信息

客户端代码示例(TypeScript):

import { MCPClient } from '@modelcontextprotocol/client';

// 创建MCP客户端

const client = new MCPClient();

// 连接到文件系统服务器

await client.connect('filesystem', 'stdio', { command: 'mcp-server-filesystem', args: ['/path/to/files'] });

// 获取资源

const resource = await client.getResource('@document.txt');

console.log(resource.content);

// 使用工具

const weatherTool = await client.getTool('get_weather');

const result = await client.executeTool(weatherTool, { city: '北京' });

console.log(result);

// 使用提示模板

const codeReviewPrompt = await client.getPrompt('code-review');

const review = await client.executePrompt(codeReviewPrompt, { code: 'function example() { return null; }' });

console.log(review);

MCP与其他集成方法的比较

以下是MCP与传统API集成和GPTs的比较:

| 方面 | MCP | 传统API集成 | GPTs |

|---|---|---|---|

| 架构 | 基于协议的框架与客户端-服务器架构 | 每个集成的自定义代码 | 具有内置工具的应用程序系统 |

| 开发模型 | 开放协议与社区驱动的开发 | 每个集成的自定义开发 | 封闭生态系统与OpenAI控制的开发 |

| 定制化 | 通过服务器实现高度可定制 | 完全可定制但需要开发 | 仅限于OpenAI批准的工具和操作 |

| 部署选项 | 本地或云部署 | 取决于实现 | 仅通过OpenAI平台的云部署 |

| 安全模型 | 细粒度权限与用户同意 | 自定义安全实现 | OpenAI管理的安全 |

| 供应商锁定 | 协议不可知 | 取决于实现 | 与OpenAI生态系统绑定 |

MCP实施中的挑战与解决方案

尽管MCP功能强大,但实施过程中仍面临一些挑战:

-

配置和编程复杂性:MCP配置和编程可能具有挑战性,需要更简单的部署方法和更全面的文档。

解决方案:利用开源社区和预构建模板简化初始设置,并从成功案例研究中学习最佳实践。 -

供应商标准问题:虽然Anthropic已经开源了MCP,但它仍然需要更多主要参与者的支持,以增强市场对其长期可行性的信心。

解决方案:关注行业发展,寻找主要平台和服务提供商的支持声明,这将表明MCP具有长期发展潜力。 -

成熟度和稳定性:作为一个相对较新的协议,MCP仍在不断发展,API和功能可能会发生变化。

解决方案:密切关注MCP规范的更新,并采用版本控制策略,确保系统能够适应未来的变化。

MCP的未来展望

随着MCP的不断发展,我们可以期待看到:

- 更广泛的工具和服务集成

- 增强的安全和隐私功能

- 对更多语言和平台的支持

- 特定行业的MCP扩展

MCP不仅仅是一个技术协议,而是AI系统设计的新范式,为构建更智能、更有用的AI应用铺平了道路。

结论

Model Context Protocol(MCP)代表了AI系统集成的重大进步,通过提供一种标准化的方法将LLM与外部数据源和工具连接起来,极大地简化了开发过程并增强了AI应用程序的功能。

无论您是开发人员、企业决策者还是AI爱好者,了解MCP及其潜力都将帮助您在日益由AI驱动的世界中保持竞争力。随着越来越多的组织采用MCP,我们可以期待看到更加无缝、功能强大且以用户为中心的AI体验的兴起。

作为一个开放标准,MCP代表了一个更加互联、更具协作性的AI未来愿景,在这个未来中,不同的系统可以无缝协作,为用户提供更丰富、更有价值的体验。

参考资料:

1019

1019

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?