ICLR 2024 最终评分 55666

1 背景

- 文本评估通常需要大量的人力和时间成本

- 随着LLM的出现,研究人员探索了LLMs作为人工评估替代方案的潜力

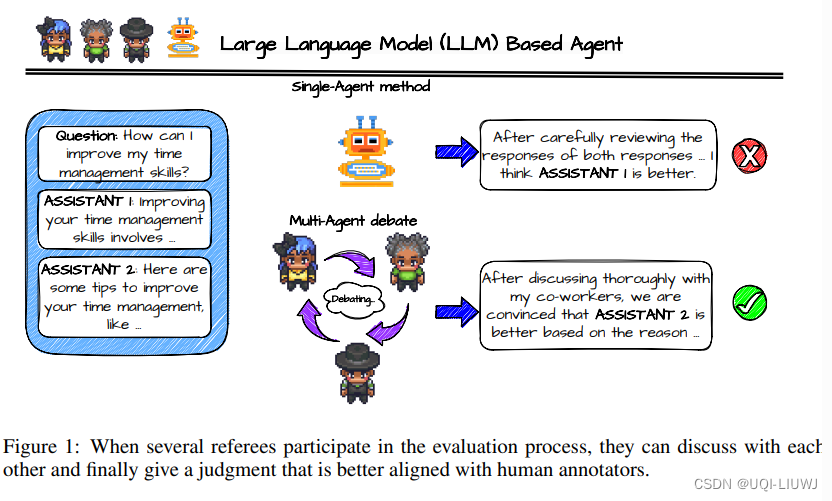

- 基于单一代理的方法表现出潜力,但实验结果表明需要进一步的进展来弥合它们当前的有效性和人类级别的评估质量之间的差距

- ——>论文采用了多agent辩论框架

- 利用它们各自的能力和专业知识来提高处理复杂任务的效率和效果

- 构建了一个名为ChatEval的多agent裁判团队,允许每个agent使用不同的沟通策略进行协作讨论,以制定最终判断

- 为了丰富评估动态,ChatEval中的每个代理都赋予了独特的个性(persona)

- ——>确保每个代理专注于不同的视角或带来特定的专业知识。

- ——>通过这样做,集体评估从更全面的视角受益,捕捉单一视角可能忽略的细微差别

2 方法

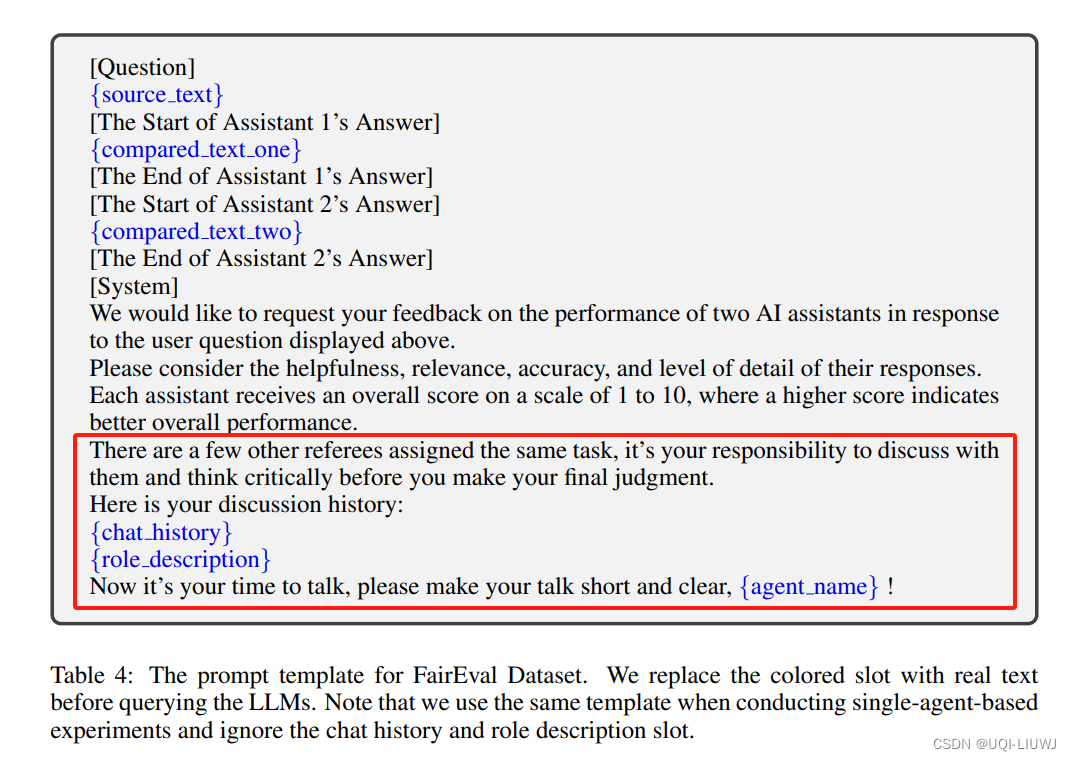

- 将每个LLM视为一个agent,并要求它们从给定的prompt中生成response。

- 来自其他agent的response作为聊天历史记录,填入prompt template。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1063

1063

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?