论文学习一之Gradient-Based Learning Applied to Document Recognition

摘要——

使用BP算法多层神经网络训练构成种个成功的基于梯度学习技术的最佳案例。提供一个合适的网络架构,基于梯度学习算法就能将其用于合成复杂的决策面以便将高维模式(例如手写字符)区分归类,并进行最小预处理。本文综述了各种方法对手写字符特征识别,并将其与标准手写数字识别任务进行了比较。用于处理二维图形的可变性,卷积神经网络显著优胜于其他技术。

现实生活中的文档识别系统是由多个模型组成的,包括字段抽取、分割、识别和语义建模。一个新的学习模式,称为图变压网络(GTN),允许像多模型系统这样的训练全局化使用基于梯度的方法,以尽量减少总体形式的性能指标。

介绍了两种在线手写字符识别系统。实验证实全局训练的优越性,以及图变压网络(GTN)的灵活性。

还介绍了一种用于阅读银行支票的图变压网络。利用卷积神经网络的特征识别并结合全局训练技术,提高商业和个人支付记录的准确率。它是商业部署,每天读取百万级支票。

关键词—— 神经网络、光学识别符(OCR)、文档识别、机器学习、基于梯度学习、卷积神经网络、图变压网络、有穷状态转换器

介绍

在过去的几年里,机器学习技术中特别是神经网络应用,在模式识别系统中扮演着越来越重要的角色。事实上,可以说,学习技术的可用性在近几年模式识别应用如连续语音识别和手写字符识别中一直是一个至关重要的方面。

本文主要的观点是,通过跟多的依赖自动的数学学习来建立更好的模式识别系统,并更少的依赖手动设计和启发式。这是由于机器学习和计算机技术近几年的进展而成为可能的。使用字符识别作为案例研究。我们展示了手工制作的特征提取可以被精心设计的直接操作像素图像的学习机器有效地替代。使用文档理解作为一个案例研究,我们表明通过手动集成单独设计的模块构建识别系统的传统方法,可以用统一的、原则性好的设计范式代替,称其为图转换器网络,允许训练所有的模型以优化全能型标准。

从识别模型的早期开始,人们就知道自然数据的多变性和丰富性,无论是演讲、字符或是其它类型的模式,几乎不能纯手工建立一个准确性高的识别系统。因此,大多模式识别系统都是结合使用自动学习技术和手工制作算法构建的。识别单个模式通常的方法由将系统划分为图像1中两个主要的模块。第一个模块称为特征抽取器,转化输入模式,以便它们可以由低维向量或符号的短字符串表示(a)能很容易的匹配或比较,表示(b)不改变其性质的输入模式的转换和扭曲是相对不变的。特征抽取器包含了大部分先验知识,而且是特定任务的。它也是大多数设计工作的重点,因为他也是完全通过手工制作的。另一方面,分类器通常是多用途且可训练的。本文的主要问题之一是识别的准确率极大的取决于设计者提出一套合适特征的能力。这是一项艰巨的任务,不幸的是,必须为每个新问题重新做一项工作。大量的模式识别文献用于描述和比较不同特征集对于不同任务的相对优点。

从历史上看,由于需要合适的特征提取器这一事实,使用仅限于低维空间的学习技术,易于分离的类。在过去的十年里,三因素的结合改变了这憧憬。首先,快速算数单元的低成本机器的可用性使得依赖跟多的蛮力法而不是算法细化。其次,用于大型超市和广泛兴趣问题(例如手写字符识别),大量数据集的可用性使设计者能够依赖更多的实际数据和更少的手工制作的特征抽取来建立识别系统。第三个非常重要的因素是强大的机器学习技术的可用性可以处理高维输入,且当输入这些复杂大数据集时,能够创造复杂决策函数。在语音和手写字符识别系统的准确率近年来的进展很大程度上可以归结为更多的依赖学习技术和大型训练数据集。作为这一事实的依据,大部分现代化商业OCR系统使用一些多层神经网络训练和反向传播。

本文中,我们考虑到手写字符识别(第一节和第二节),以及比较几种学习技术在基准数据集上的性能与手写字符比较(第三节)。虽然使用自动学习越多越好,但是没有学习技术离开少量先验知识能完美完成任务。在一个多层神经网络情下中,融合知识的一个好方法是可以根据任务调整它的架构。第二段中介绍的卷积神经网络是一种专门的神经网络结构的案例,它通过使用局部连接模式和对权重施加约束,将2D 形状的不变性知识结合起来。第三节比较了几种孤立手写数字识别方法。从对单个字符的识别到对文档中的此句的识别,第四节中介绍而多个模型训练减少整体误差的设想。当模块操作着有向图时,可变长度对象(如手写字符)使用多模型系统是最好的做法。这引出了可训练图变压器网 (GTN) 的概念。第五节描述如今经典的过分割的方法,用于识别字词或其他字符串。第六节提出摒弃手工分割和标注的情况下,在字词水平上用于训练一个识别器的判别性和非判别性的基于梯度技术。第七部分提出来空间位移神经网络方法,为消除分割启发式的需要,在输入的所有可能位置扫描识别器。第八节展示可训练的图变压网络(GTN)根据一般的图合成算法用于转换多个广义传感器。语音识别中常用的图变压网络(GTNs) 和隐马尔可夫模型之间的连接也被处理。第六节描述了一个训练有素的的图变压网络(GTN)系统,用于钢笔计算机中输入的手写。此问题称为 “联机 ” 手写识别, 因为计算机必须在用户写入时立即反馈。该系统的核心是一个卷积神经网络。结果清晰的展示了训练一个字词水平的识别器的有点,而不是预先分割的、手工标记的、孤立字符上进行训练。第十节描述了一个完整的图转换网络系统,用于阅读手写和机器打印的银行支票。系统的核心是卷积神经网络,也称为LeNet-5,在第二节描述。该系统在 NCR 公司对银行业的支票识别系统进行了商业应用。它正在美国的几家银行每月阅读数以百万计的支票。

A.Learning from Data

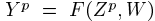

有几种自动机器学习的方法,但是近年来由神经网络社区推广的最成功的方法之一可以称为基于数值或梯度的学习。机器学习计算函数 其中Zp是第p个输入模式,W代表系统中可调参数的集合。在模式识别设置中,输出Yp可以解释为模式Zp的识别类别标签或与每个类别关联的分数或概率。损失函数

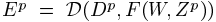

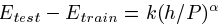

其中Zp是第p个输入模式,W代表系统中可调参数的集合。在模式识别设置中,输出Yp可以解释为模式Zp的识别类别标签或与每个类别关联的分数或概率。损失函数 衡量Dp(正确的或是模式Zp的期望输出)和系统产生的输出之间的误差。平均损失函数Etrain(W)是一组称为训练集{(Z1,D1),……(Zp,Dp)}的标记示例上的误差Ep的平均值。在最简单的情况下,学习问题在于找到最小化Etrain(W)的W值。实际上,对系统在训练集上的性能兴趣不大。 更为相关的度量是系统在现场的错误率将在实践中使用。 通过测量与训练集分离的一组样本(称为测试集)的准确性来评估此性能。许多理论和实验工作1,2,3表明,测试集Etest的预期错误率与训练集Etrain的错误率之间的差距随着训练样本的数量近似为

衡量Dp(正确的或是模式Zp的期望输出)和系统产生的输出之间的误差。平均损失函数Etrain(W)是一组称为训练集{(Z1,D1),……(Zp,Dp)}的标记示例上的误差Ep的平均值。在最简单的情况下,学习问题在于找到最小化Etrain(W)的W值。实际上,对系统在训练集上的性能兴趣不大。 更为相关的度量是系统在现场的错误率将在实践中使用。 通过测量与训练集分离的一组样本(称为测试集)的准确性来评估此性能。许多理论和实验工作1,2,3表明,测试集Etest的预期错误率与训练集Etrain的错误率之间的差距随着训练样本的数量近似为 ,其中P是训练样本的数量,h是有效容量或机器6,7的复杂性的度量,a是0.5到1.0之间的数字,k是常数。当训练样本数量增加时,这个差距总是会减小。此外,随着h容量增加,Etrain减少。因此,当h容量增加的时候,在Etrain减少和差距增加中要衡量,以最佳的容量h值实现最低的泛化误差Etest。大多数学习算法都试图最小化Etrain以及对差距的一些估计。这种形式的正式版本称为结构风险最小化6,7,它基于定义能力增强的机器学习序列,该序列对应于参数空间的子集序列,从而每个子集都是先前子集的超集。实际上,结构风险最小化是通过最小化

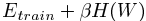

,其中P是训练样本的数量,h是有效容量或机器6,7的复杂性的度量,a是0.5到1.0之间的数字,k是常数。当训练样本数量增加时,这个差距总是会减小。此外,随着h容量增加,Etrain减少。因此,当h容量增加的时候,在Etrain减少和差距增加中要衡量,以最佳的容量h值实现最低的泛化误差Etest。大多数学习算法都试图最小化Etrain以及对差距的一些估计。这种形式的正式版本称为结构风险最小化6,7,它基于定义能力增强的机器学习序列,该序列对应于参数空间的子集序列,从而每个子集都是先前子集的超集。实际上,结构风险最小化是通过最小化 来实现的,其中函数H(W)被称为正则化函数,beta是一个常数。选择H(W)使得它对属于参数空间的高容量子集的参数W取大值。最小化H(W)实际上限制了参数空间可访问子集的容量,从而控制了在最小化训练误差和最小化训练误差与测试误差之间的期望之间的权衡。

来实现的,其中函数H(W)被称为正则化函数,beta是一个常数。选择H(W)使得它对属于参数空间的高容量子集的参数W取大值。最小化H(W)实际上限制了参数空间可访问子集的容量,从而控制了在最小化训练误差和最小化训练误差与测试误差之间的期望之间的权衡。

B.基于梯度学习

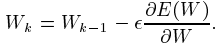

关于一组参数最小化函数的一般问题是计算机科学中许多问题的根源。基于梯度的学习基于这样一个事实,即与离散函数相比,最小化合理的平滑连续函数通常要容易得多。通过估计参数值的微小变化对损耗函数的影响,可以使损耗函数最小化。这是通过损耗函数相对于参数的梯度来衡量的。当可以通过解析而不是通过扰动以数值方式计算梯度矢量时,可以设计出一种高效的学习算法。这是众多基于梯度的具有连续值参数的学习算法的基础。在本文描述的过程中,参数W的集合是一个实值向量,对于该向量,E(W) 是连续的,并且几乎在任何地方都可微分。在这种情况下,最简单的最小化步骤是梯度下降算法,其中W的迭代调整,如下:

在这个最简单的案例中, 是一个标量常数。更为复杂的过程是

是一个标量常数。更为复杂的过程是 ,或将其替换为对角矩阵,或将其替换为逆Hessian矩阵的估计,如牛顿法或拟牛顿法。也可以使用共轭梯度方法[8]。但是,附录B显示,尽管文献中有许多相反的说法,但是这些二阶方法对大型学习机的实用性非常有限。

,或将其替换为对角矩阵,或将其替换为逆Hessian矩阵的估计,如牛顿法或拟牛顿法。也可以使用共轭梯度方法[8]。但是,附录B显示,尽管文献中有许多相反的说法,但是这些二阶方法对大型学习机的实用性非常有限。

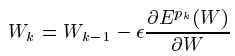

流行的最小化过程是随机梯度算法,也称为在线更新。 它包括使用噪声或平均梯度的近似版本来更新参数向量。在最常见的情况下,W根据单个样本进行更新:

通过此过程,参数向量在平均轨迹附近波动,但在具有冗余样本(例如语音或字符识别中遇到的样本)的大型训练集上,其收敛速度通常比常规梯度下降法和二阶方法快得多。其原因在附录B中进行了解释。自20世纪60年代以来,就对这种用于学习的算法的性质进行了理论研究,但直到80年代中期,非平凡任务的实际成功才出现。

C.梯度反向传播

364

364

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?