波士顿—Sport mini

自主性和API:

用户可以先通过手动操作(通过平板电脑和操纵杆)驱动机器人,随后Spot能够记住并自主导航该特定路线,如果在自主导航过程中出现了新的障碍,Spot能够在必要时进行重新规划。

以前的API允许用户命令Spot以特定的速度沿特定的方向移动特定的距离。这个功能现在已经得到了广泛的扩展,可以指挥Spot在整个建筑物中自主导航。最初的地图创建仍然是手工完成的,这主要是因为Spot所处环境的复杂性使得自主探索变得复杂,因为机器人不一定有很好的方法知道自己是否应该探索一个区域。不过,一旦你有了那张地图,Spot现在将变得更加自主,它能够执行高级别的导航命令,比如“转向这个路标”,而不是必须按照预定的路径走。

这款机器人现在还可以通过基于决策树的系统进行编程,以便用户可以将导航,感测和动作命令组合为有用的行为。2.0更新不仅让Spot具备了负载的能力,还提供了几种将有效载荷与机器人智能集成的方法,从而使系统具有更强大的功能。

移动性:

SpotMini最出色的能力并非巨大的力量,而是它对于复杂地形的处理能力。SpotMini流畅而优雅的避障能力着实在令人惊艳,无论阶梯还是土丘,它都能淡定从容的走过去。 Spot mini在湿滑的地面上更有弹性,并能更好地应对楼梯。

应用:

SpotMini采用电液混合的方式驱动降低能耗,专注于不同步态之间的转换,通过制定转换准则从而制定步态列表,来实现其更灵活多变的姿态,或是说更像一只活灵活现的小狗。

除去与人互动的娱乐功能外,还可以用于安保、应急响应。当然波士顿动力更希望未来能将这只机器狗应用到仓库配货甚至物流运输中去。考虑到现有的配送机器人最多只能将物品送至路边,SpotMini更有能力满足客户“送货送到家门口”的需求。或许在不久的将来,打开家门,会发现送快递的不再是快递员,而是灵巧可爱的“快递狗”了。

MIT—猎豹

MIT 的新型猎豹机器人是第一个能做后空翻的四足机器人。这只灵活的小豹只有 20 磅重,四条腿可以自然地弯曲和摆动,它还能在崎岖不平的地面上小跑,速度大约是普通人步行速度的 2 倍。

MIT 研发猎豹机器人不依靠视觉和任何外部传感器,全凭控制算法,会纵身飞跃上桌,能轻松爬上满是障碍物的楼梯,甚至在突然被猛推或猛踢时迅速恢复平衡。

猎豹被有意设计成不需依赖摄像头或任何外部传感器就能完成所有这些任务。它能灵活地 “感觉” 周围的环境,工程师们称之为 “盲眼运动”(blind locomotion),就像人能穿过黑漆漆的房间一样。猎豹 3 能够无需视觉地爬上楼梯,穿过崎岖不平的地形,并且在遇到意想不到的外力时能够迅速恢复平衡,这都要归功两种新算法:接触检测算法(contact detection algorithm)和模型预测控制算法(model-predictive control algorithm)。接触检测算法帮助机器人确定某只腿从在空中摆动切换到踏上地面的最佳时刻。例如,如果机器人踩在一根细细的树枝上,而不是踩在坚硬沉重的石头上,它会采取怎样的反应 —— 是继续迈着步子走过去,还是向后退屈一下腿 —— 可以决定它是否能保持平衡。

无需视力的运动能力也部分归功于模型预测控制算法,该算法可以预测某条腿在踏出一步后应该施加多大的力。当任何一只腿接触到地面并施加了特定大小的力,模型预测控制算法会马上计算在未来的半秒内机器人的身体和腿应该处于什么位置。机械结构参考

宇树科技—莱卡狗

早在2019年5月28日的国际机器人与自动化会议(ICRA)上,宇树科技就展示了Laikago四足机器狗。在展会上宇树科技表示,除了用于研究机器人技术,莱卡狗其他可能应用于包括安全巡逻、危险环境检查、搜索和救援或交付等领域,将其命名为Laikago旨在向第一个上太空的俄罗斯流浪狗“莱卡”(Laika)致敬。

莱卡狗运动时机身3轴力控制,使得正向最大拉力达到25N,这个数据还可以通过编程提升。莱卡狗能在草地、上下坡度20度左右的草坡、松软小石块地形进行自适应行走,行走时可以控制机器人前后、左右、上下运动,以及偏航角、俯仰角、横滚角等,运动过程中也能保持很高的稳定性。另外,可以根据“莱卡狗”12个关节的输入力矩实现“莱卡狗”对外力的跟随。

站立时莱卡狗高0.6米、长0.56米、宽0.35米,重25kg,额定负载能力约为5~12kg,50.4V/13,000mAh的锂电池组一次充电后可使用4小时。“莱卡狗”还具备非常强劲的动力系统,总瞬时最大功率可达18KW,功率质量密度为0.8KW/kg(起跑时为0.45KW/kg)。

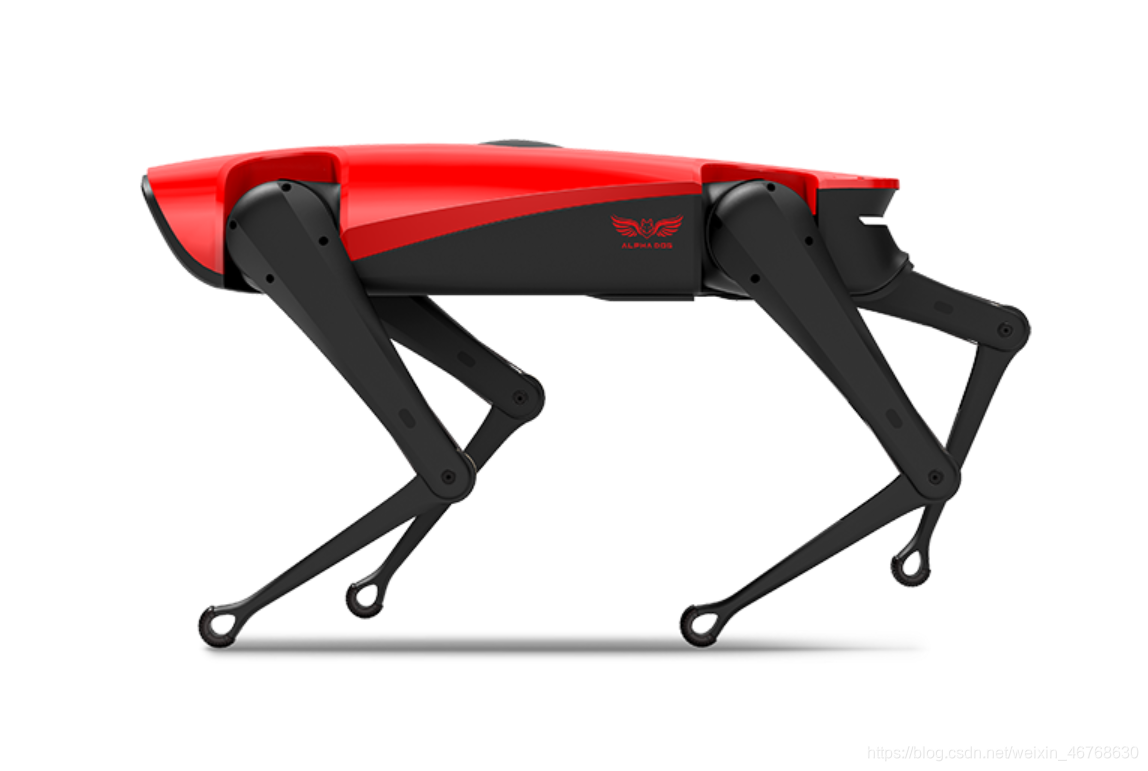

蔚蓝—阿尔法狗

阿尔法机器狗采用先进的软硬件技术架构、机械设计、智能算法和运动控制算法。它的运动控制算法是业界领先的。同时,蔚蓝采用了开放的业界标准,使得阿尔法机器狗能够无缝集成和连接各类其他先进技术。阿尔法机器狗既是第一台真正的个人机器人,同时也是一款能够开发各类应用的高性能机器人移动平台。

您可以把阿尔法机器狗看作是继桌面电脑和便携式电脑之后,能够自己下地行走的超级智能电脑。蔚蓝采用了开放的业界标准,它能够无缝接入现有的信息与自动化应用之中。除此之外,还可以把个人电脑中的各种应用软件轻松的移植到阿尔法机器狗上。

蔚蓝公司致力于打造全球运动功能最丰富的机器狗

- 九种步态:

●平衡站立(Balance-Standing)

●常规行走(Walking)

●常规小跑(Trotting)

●自由小跑(Free-Trotting)

●小步快走(Trot-Walking)

●小步快跑(Trot-Running)

●踱步(Pacing)

●跳跑(Bounding)

●奔跑(Galloping)

●跳跃(Pronking) - 全球行走速度最快的机器狗产品

- 全球第一款可以动态调节行走宽度的机器狗产品

- 全球第一款可以动态调节支撑面积的机器狗产品

- 全球行走高度调节能力最强的机器狗产品

- 推动恢复

- 侧向移动

- 原地转向

- 摔倒自动翻身

5559

5559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?