2025深度学习发论文&模型涨点之——双通道卷积神经网络

双通道卷积神经网络通过两个独立的卷积层对输入数据进行处理,每个卷积层使用不同的卷积核提取特征,生成两个不同的特征图。这两个特征图可以单独进行后续的卷积和全连接操作,也可以通过某种方式(如求和、平均、权重叠加等)融合在一起,共同参与网络的决策过程。

-

提高特征表示能力:两个通道从不同角度学习输入数据的特征,能够捕获更丰富的信息。

-

增加网络深度和宽度:在保持计算复杂度基本不变的前提下,增加了网络的深度和宽度,有利于提高模型的泛化能力。

-

降低过拟合风险:双通道结构可以看作一种正则化策略,通过增加网络结构的复杂度来减少过拟合的风险。

小编整理了一些双通道卷积神经网络【论文】合集,以下放出部分,全部论文PDF版皆可领取。

需要的同学

回复“111”即可全部领取

论文精选

论文1:

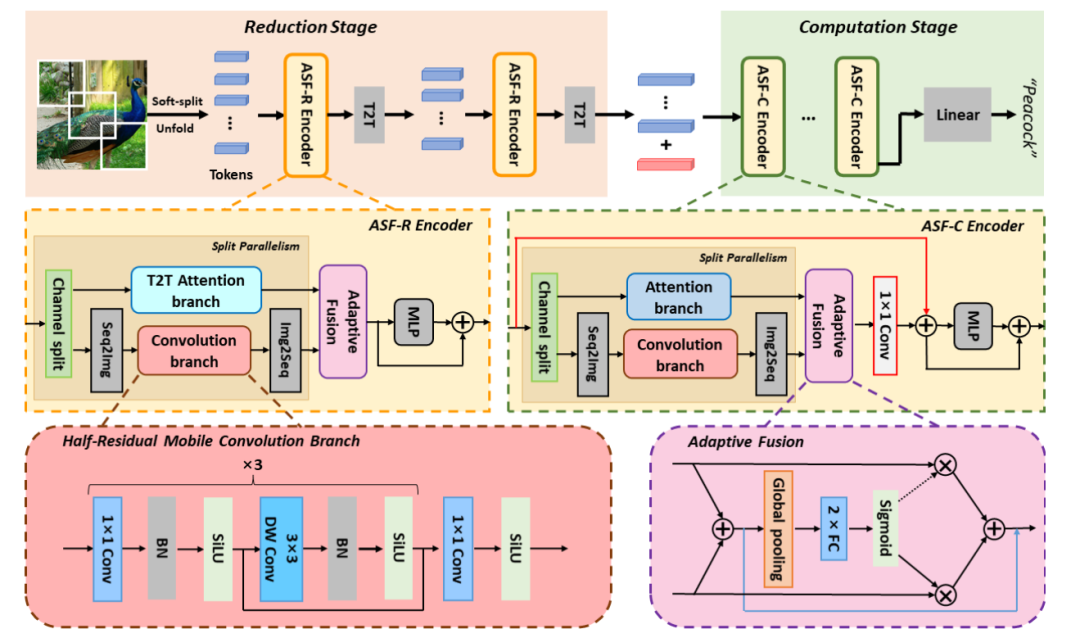

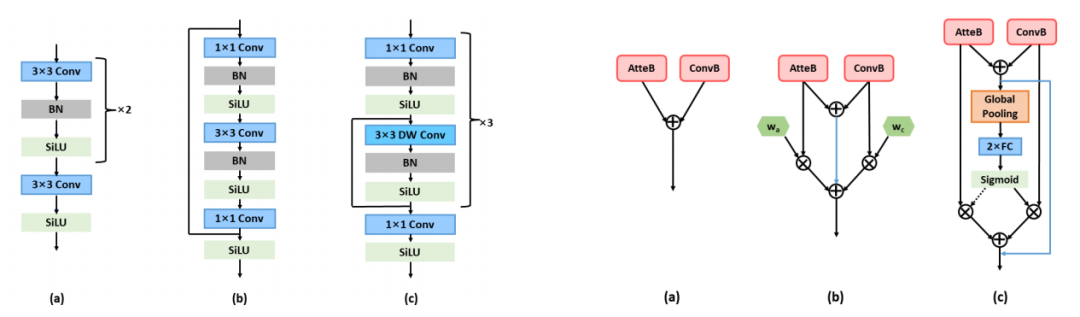

Adaptive Split-Fusion Transformer

自适应分裂-融合变换器

方法

-

分裂并行结构:将特征通道平均分配给两个并行路径(卷积路径和注意力路径),以分别提取局部和全局特征。

-

高效卷积路径(HMCB):设计了一种高效的卷积分支,通过深度可分离卷积和残差连接,提高局部特征提取的效率。

-

自适应融合模块:根据视觉内容动态调整卷积和注意力路径的权重,实现特征融合。

创新点

-

自适应融合:通过视觉内容动态调整卷积和注意力路径的权重,使模型能够根据图像内容动态选择局部或全局特征的重要性。这一机制在ImageNet-1K验证集上将Top-1准确率提升至83.9%,相比简单融合方法提升了0.2%。

-

高效卷积分支(HMCB):相较于其他卷积分支设计,HMCB在保持低计算复杂度的同时,显著提升了模型性能。在ImageNet-1K验证集上,HMCB分支的使用使Top-1准确率从82.5%提升至82.7%。

-

分裂并行结构:通过将特征通道分配给两个并行路径,充分利用了卷积和注意力的互补性,同时保持了与单路径模型相似的计算复杂度。这一结构在ImageNet-1K验证集上将Top-1准确率提升至82.7%,相比单路径模型(如纯注意力或纯卷积)分别提升了1.0%和10.3%。

论文2:

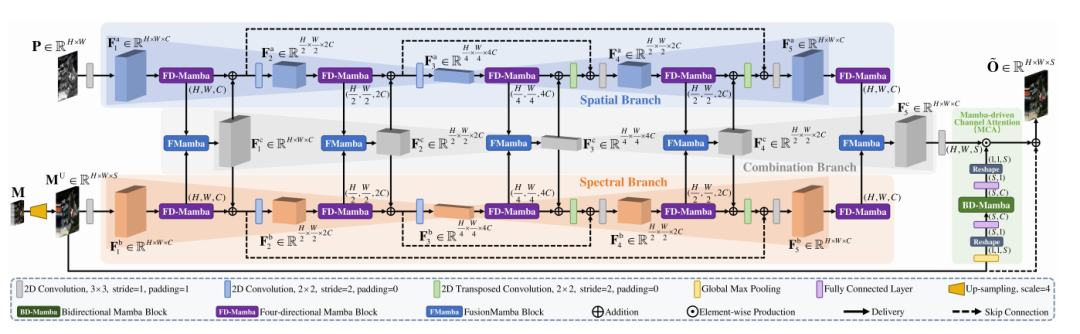

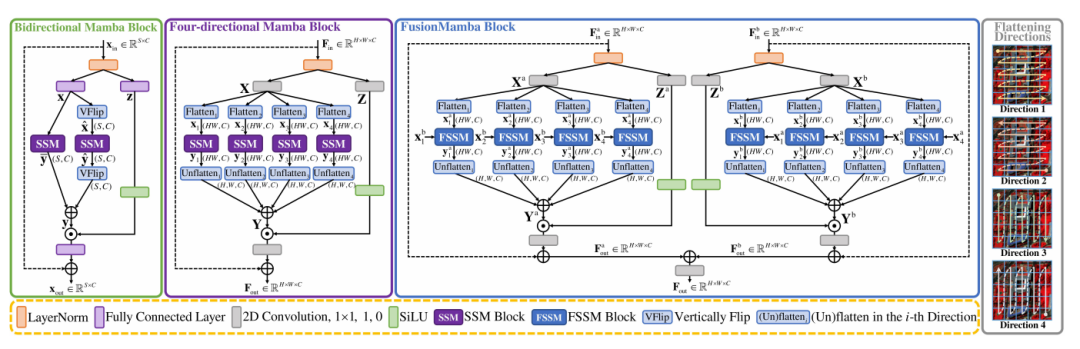

FusionMamba: Efficient Remote Sensing Image Fusion with State Space Model

FusionMamba:基于状态空间模型的高效遥感图像融合

方法

-

FusionMamba块:将单输入的Mamba块扩展为双输入,以有效融合空间和光谱特征。

-

双U形网络结构:设计了两个U形网络分支,分别用于提取空间和光谱特征,并通过FusionMamba块进行特征融合。

-

增强通道注意力模块(MCA):通过Mamba驱动的通道注意力模块,改善光谱信息的表示。

创新点

-

FusionMamba块:通过双输入设计,有效融合空间和光谱特征,性能显著优于传统的连接(Concat)和交叉注意力(CA)方法。在WorldView-3数据集上,FusionMamba块将PSNR提升至39.374,相比连接方法提升了0.35 dB。

-

双U形网络结构:通过分别提取空间和光谱特征,再进行层次化融合,显著提升了融合效果。在WorldView-3数据集上,该结构将PSNR提升至39.374,相比单路径方法提升了0.5 dB以上。

-

增强通道注意力模块(MCA):通过Mamba驱动的通道注意力模块,改善光谱信息的表示,进一步提升了融合性能。在WorldView-3数据集上,MCA模块的使用将PSNR提升至39.374,相比不使用MCA模块提升了0.05 dB。

论文3:

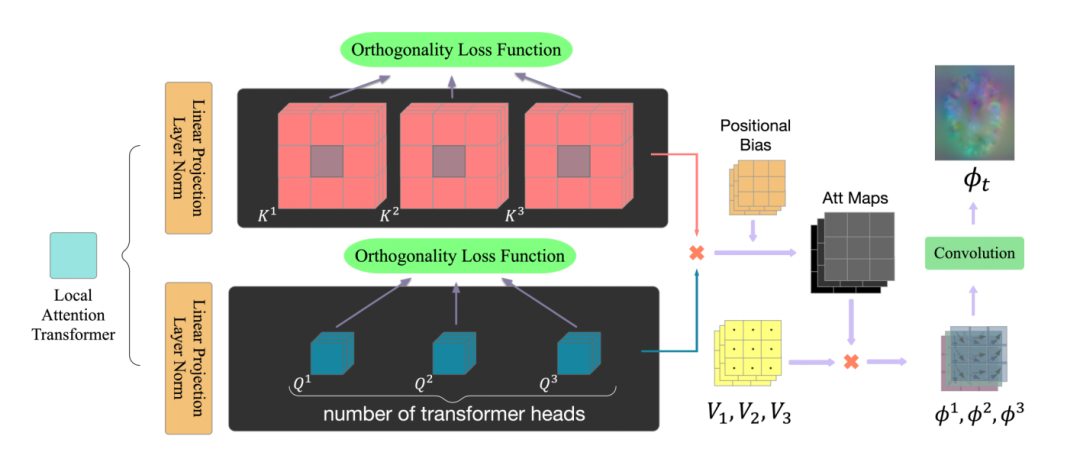

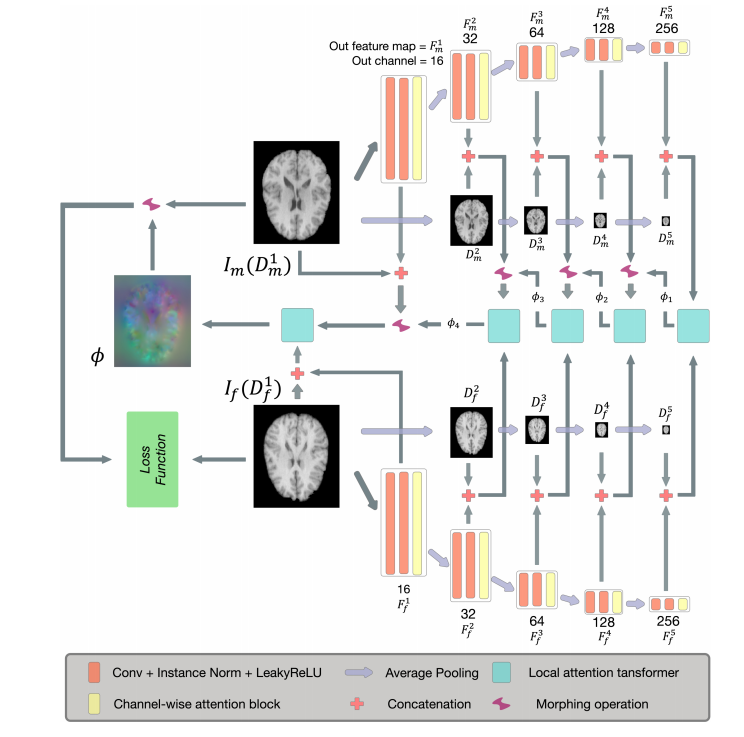

Pyramid Attention Network for Medical Image Registration

用于医学图像配准的金字塔注意力网络

方法

-

双流金字塔编码器:利用通道注意力机制增强特征表示,通过金字塔结构提取多尺度特征。

-

局部注意力Transformer(LAT):作为解码器,分析运动模式并生成变形场。

-

正交正则化:通过正交损失函数减少特征冗余,增强不同运动模式的学习。

创新点

-

双流金字塔编码器:通过通道注意力机制增强特征表示,显著提升了配准精度。在IXI数据集上,Dice相似系数(DSC)提升至65.1%,相比不使用通道注意力的模型提升了1.2%。

-

局部注意力Transformer(LAT):通过局部注意力机制处理体积数据,有效缓解了全局自注意力带来的内存问题。在LPBA40数据集上,LAT模块将DSC提升至71.1%,相比传统Transformer提升了0.5%。

-

正交正则化:通过正交损失函数减少特征冗余,使不同注意力头学习到更多样的运动模式。在AbdomenMR数据集上,正交正则化的使用将DSC提升至73.1%,相比不使用正则化的模型提升了3.0%。

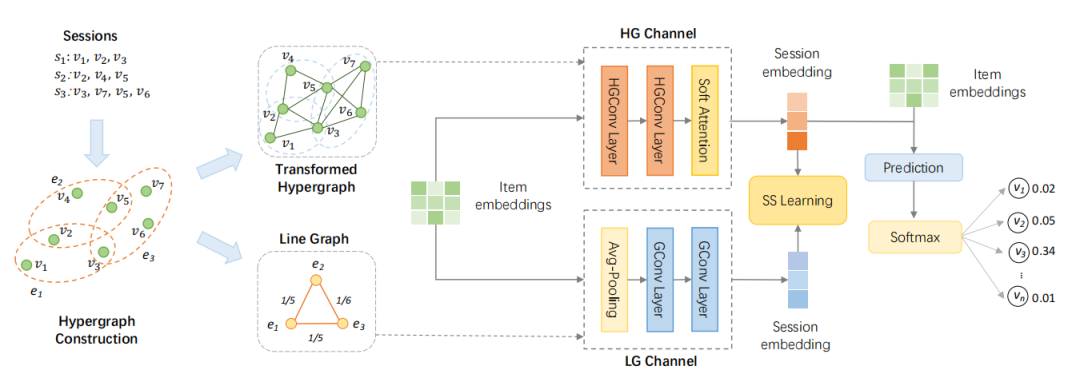

论文4:

Self-Supervised Hypergraph Convolutional Networks for Session-based Recommendation

用于会话式推荐的自监督超图卷积网络

方法

-

超图构建:将每个会话建模为超图中的一个超边,以捕捉项目间的高阶关系。

-

超图卷积网络:通过超图卷积操作,传播项目嵌入并生成高质量的推荐结果。

-

线图通道:基于超图的线图构建另一个图卷积网络,以捕捉会话间的连接性。

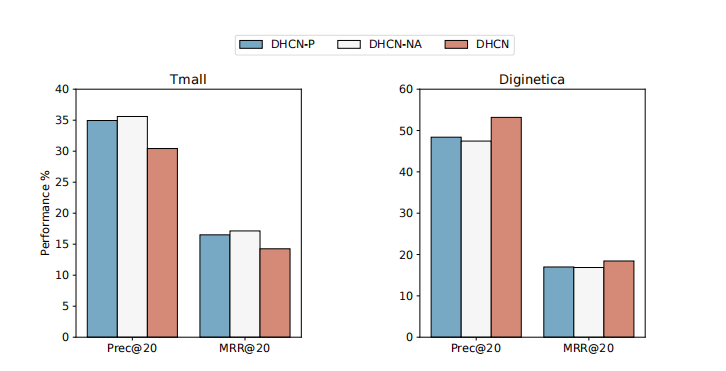

创新点

-

超图建模:通过超图捕捉项目间的高阶关系,显著提升了推荐性能。在Tmall数据集上,DHCN模型的P@10和M@10指标分别提升了10.71%和7.87%,相比传统图神经网络(如SR-GNN)。

-

线图通道:引入线图通道以捕捉会话间的连接性,进一步提升了模型性能。在Nowplaying数据集上,线图通道的使用使P@10和M@10指标分别提升了12.25%和8.84%。

-

自监督学习:通过自监督学习增强超图建模,进一步提升了推荐性能。在Diginetica数据集上,自监督学习使P@10和M@10指标分别提升了6.19%和9.32%。

小编整理了双通道卷积神经网络论文代码合集

需要的同学

回复“111”即可全部领取

703

703

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?