航识无涯学术致力于成为您在人工智能领域的领航者,定期更新人工智能领域的重大新闻与最新动态,和您一起探索AI的无限可能。

2025深度学习发论文&模型涨点之——全局特征+局部特征

近年来,计算机视觉与模式识别领域对多尺度特征融合的研究日益深入,其中全局特征与局部特征的协同建模已成为提升模型判别力的关键范式。全局特征(Global Features)通过捕获图像的整体结构和上下文信息,为视觉理解提供高层语义指导;而局部特征(Local Features)则聚焦于细粒度模式(如纹理、边缘等),能够有效建模细节差异与几何变换不变性。两者在特征空间中存在天然的互补性:全局特征易受遮挡或背景干扰,局部特征则可能因缺乏语义约束陷入局部最优。

我整理了一些【论文+代码】合集,需要的同学公人人人号【航识无涯学术】发123自取。

论文精选

论文1:

Time-Transformer: Integrating Local and Global Features for Better Time Series Generation

Time-Transformer:整合局部和全局特征以更好地生成时间序列

方法

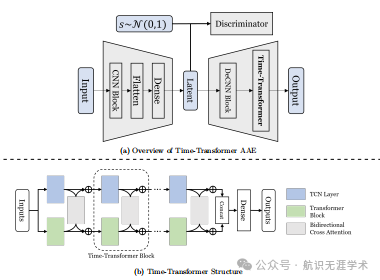

对抗自编码器(AAE):采用对抗自编码器作为生成框架,结合生成对抗网络(GAN)和变分自编码器(VAE)的优势。

Time-Transformer模块:在AAE的解码器中引入Time-Transformer模块,通过层间并行设计同时学习局部和全局特征。

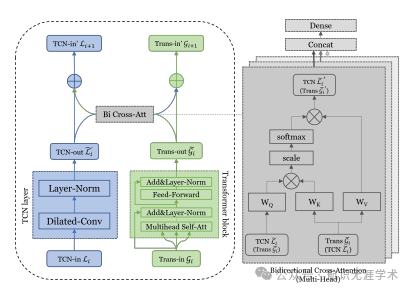

局部和全局特征学习:使用时间卷积网络(TCN)提取局部特征,使用Transformer提取全局依赖关系。

双向交叉注意力:通过双向交叉注意力机制在局部和全局特征之间进行信息交互和融合。

创新点

Time-Transformer模块:首次提出Time-Transformer模块,通过层间并行设计同时学习局部和全局特征,有效提升了模型对时间序列数据的生成能力。

性能提升:在5个数据集上超越了现有的最先进模型,特别是在包含全局和局部特征的数据集上表现突出。

数据增强和不平衡分类:展示了模型在小数据集增强和不平衡分类问题上的有效性,显著提升了分类性能。

计算效率:尽管模型复杂度较高,但通过使用CNN结构,保持了较高的计算效率。

论文2:

Zero-shot Referring Image Segmentation with Global-Local Context Features

零样本引用图像分割与全局-局部上下文特征

方法

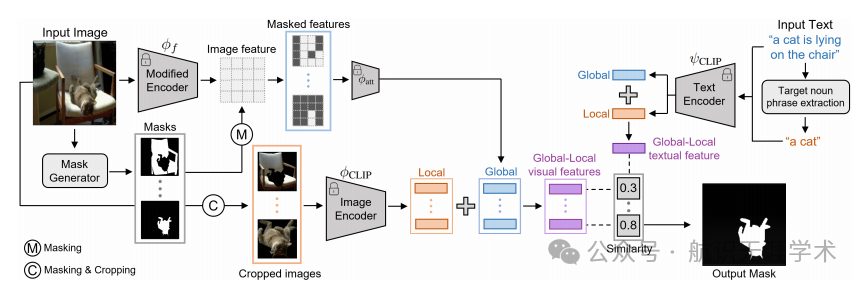

全局-局部上下文特征:提出了一种新的零样本引用图像分割方法,通过全局-局部上下文特征来处理图像和文本的表示。

掩码引导的视觉编码器:利用掩码引导的视觉编码器捕获全局和局部上下文信息,通过实例掩码提取细粒度的实例级分割掩码。

全局-局部文本编码器:通过全局特征捕获整个输入表达的复杂语义,通过局部特征聚焦于目标名词短语。

相似度计算:通过计算全局-局部上下文视觉特征和文本特征之间的余弦相似度,选择最相似的掩码作为输出。

创新点

零样本学习:首次提出零样本引用图像分割任务,无需任何额外训练即可利用CLIP的预训练知识。

性能提升:在多个基准数据集上显著超越了现有的零样本基线方法和弱监督方法,特别是在处理复杂表达和多实例时表现突出。

全局-局部特征融合:通过全局-局部特征融合,充分利用CLIP的预训练知识,有效捕获目标对象的语义和对象之间的关系。

计算效率:尽管模型复杂度较高,但通过使用CNN结构,保持了较高的计算效率。

论文3:

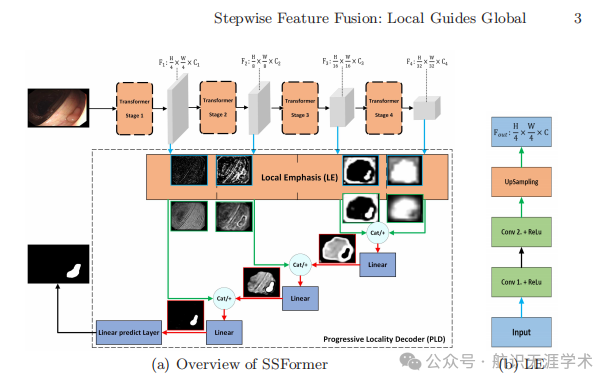

Stepwise Feature Fusion: Local Guides Global

逐步特征融合:局部引导全局

方法

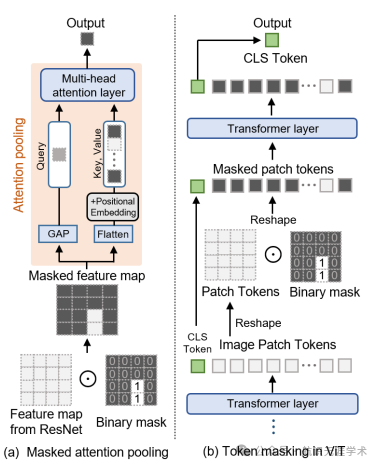

金字塔Transformer编码器:采用金字塔Transformer编码器,通过多尺度特征处理提升模型的泛化能力。

逐步局部性解码器(PLD):提出了一种新的逐步局部性解码器,通过多阶段特征聚合结构逐步融合不同深度的特征。

局部强调(LE)模块:通过卷积操作增加相邻特征的权重,减少注意力分散,强调局部特征。

逐步特征聚合(SFA)模块:通过逐步融合不同深度的特征,减少信息差距,提高特征融合的效率。

创新点

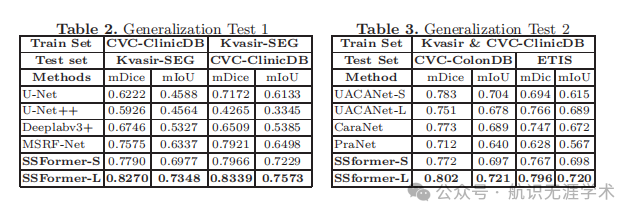

金字塔Transformer编码器:首次将金字塔Transformer架构引入息肉分割任务,显著提升了模型的泛化能力。

性能提升:在多个息肉分割基准数据集上实现了约3%、1.8%和1%的性能提升,特别是在最具挑战性的ETIS数据集上表现突出。

局部特征强调:通过局部强调模块有效减少了Transformer模型中的注意力分散问题,提高了模型对局部特征的处理能力。

逐步特征聚合:通过逐步特征聚合模块,逐步融合不同深度的特征,提高了特征融合的效率,进一步提升了模型的性能。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?