2025深度学习发论文&模型涨点之——遥感+多模态

遥感+多模态是当前遥感技术与人工智能交叉领域的重要研究方向之一,主要通过融合多种模态的数据(如光学、雷达、文本、音频等)来提升遥感信息的提取和理解能力。这种结合不仅能够提供更丰富的信息,还能增强模型的泛化能力和适应性,使其能够更好地处理复杂的地学问题。

-

多模态数据融合:通过融合不同类型的遥感数据(如光学、SAR、LiDAR等),可以获取更全面的地球观测信息。例如,HGR相关池化融合算法通过结合特征融合方法与HGR相关算法,提升了多模态信息的特征学习能力。

-

多模态遥感大模型:近年来,多模态遥感大模型的发展显著提升了遥感数据的处理和分析能力。例如,SkySense是一个通用的十亿级遥感基础模型,经过预训练,使用经过策划的多模式遥感图像数据集,包含2150万个时间序列,展现了显著的泛化能力。

- 多模态数据集:构建高质量的多模态数据集是多模态遥感研究的基础。例如,RSICap数据集包含遥感图像和文本描述数据,用于遥感图像精细描述;RSIEval数据集包含人工注释的字幕-视觉问答,可以全面评估VLMs在遥感环境下的性能。

小编整理了一些遥感+多模态【论文】合集,以下放出部分,全部论文PDF版皆可领取。

需要的同学扫码添加我

回复“遥感+多模态【”即可全部领取

论文精选

论文1:

Multimodal Fusion Transformer for Remote Sensing Image Classification

面向遥感图像分类的多模态融合变压器

方法

-

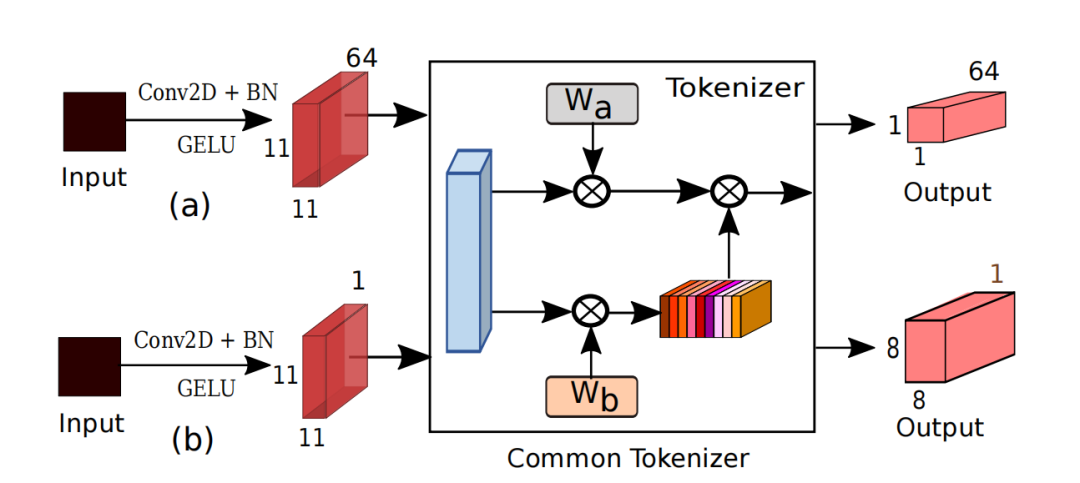

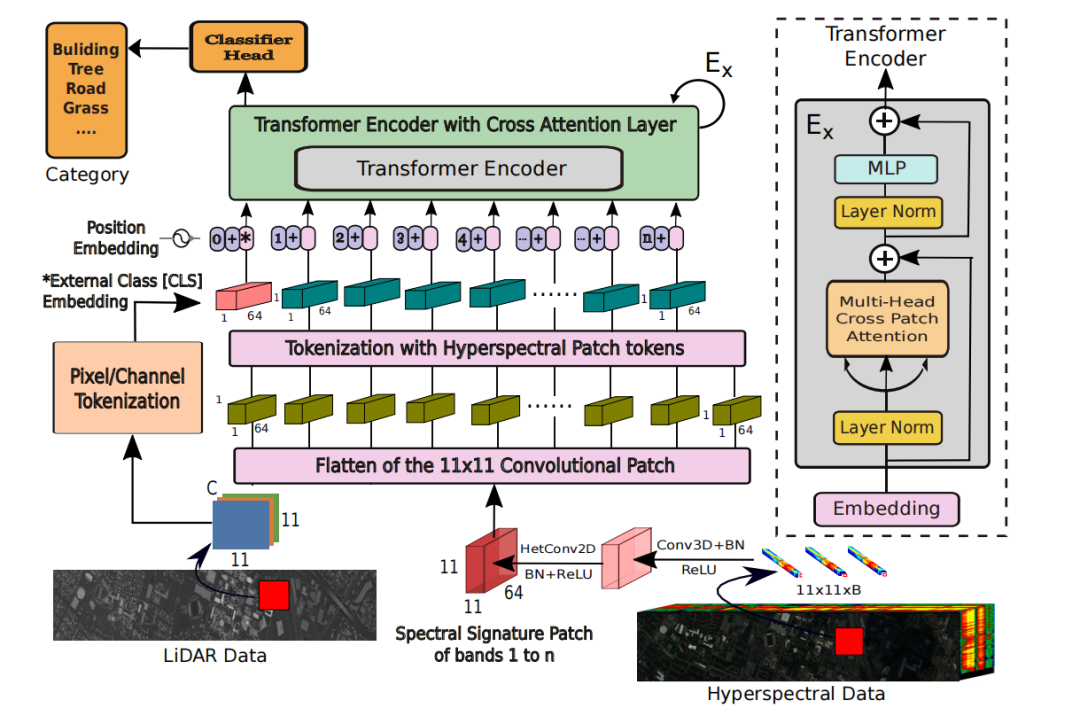

多头跨补丁注意力机制(mCrossPA):提出了一种多头跨补丁注意力机制,用于融合遥感图像和其他模态数据(如LiDAR、MSI、SAR和DSM)的特征,以提高土地覆盖分类的准确性。

遥感数据预处理:对遥感数据进行预处理,包括归一化、增强等操作,以提高模型的鲁棒性和泛化能力。

特征提取与融合:利用卷积神经网络(CNN)提取遥感图像的高级特征,并通过多模态融合策略将这些特征与来自其他模态的数据相结合。

分类器设计:设计了一个有效的分类器,能够处理多模态数据并输出分类结果,采用了先进的优化算法来提高模型的性能。

创新点

-

多模态数据融合:通过将遥感图像与其他模态数据(如LiDAR、MSI、SAR和DSM)相结合,显著提高了模型的分类准确性,特别是在处理复杂场景和不同数据模态时。

多头跨补丁注意力机制:引入了多头跨补丁注意力机制,能够有效地捕捉遥感图像和其他模态数据之间的长距离依赖关系,提高了模型的特征学习能力。

高效的特征提取:利用卷积神经网络提取遥感图像的高级特征,通过多模态融合策略将这些特征与来自其他模态的数据相结合,提高了模型的鲁棒性和泛化能力。

优越的分类性能:通过实验验证,所提出的模型在多个遥感数据集上取得了最先进的分类性能,显著优于传统的卷积神经网络和其他先进的变压器模型。

论文2:

RS-GPT4V A Unified Multimodal Instruction-Following Dataset for Remote Sensing Image Understanding

RS-GPT4V:用于遥感图像理解的统一多模态指令跟随数据集

方法

-

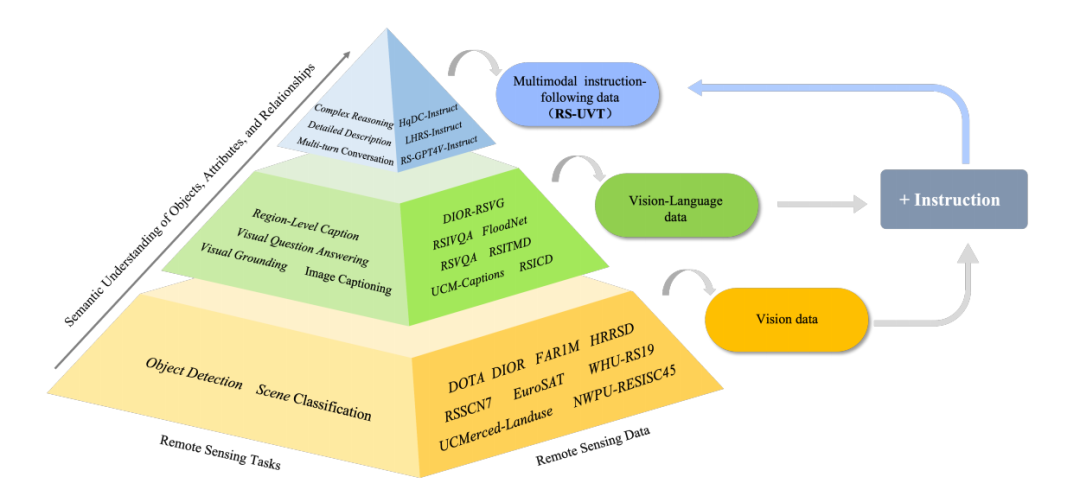

指令-响应生成:利用GPT-4V和现有数据集生成(问题,答案)对,通过指令跟随来统一任务,如图像描述、视觉问答、复杂场景理解、视觉推理和任务规划。

数据集设计:设计了一个高质量、多样化的统一多模态指令跟随数据集RS-GPT4V,涵盖了广泛的遥感场景和目标类别。

模型训练:使用RS-GPT4V对多模态大语言模型(MLLMs)进行监督微调,以提高模型在理解复杂场景和执行高级视觉推理任务方面的能力。

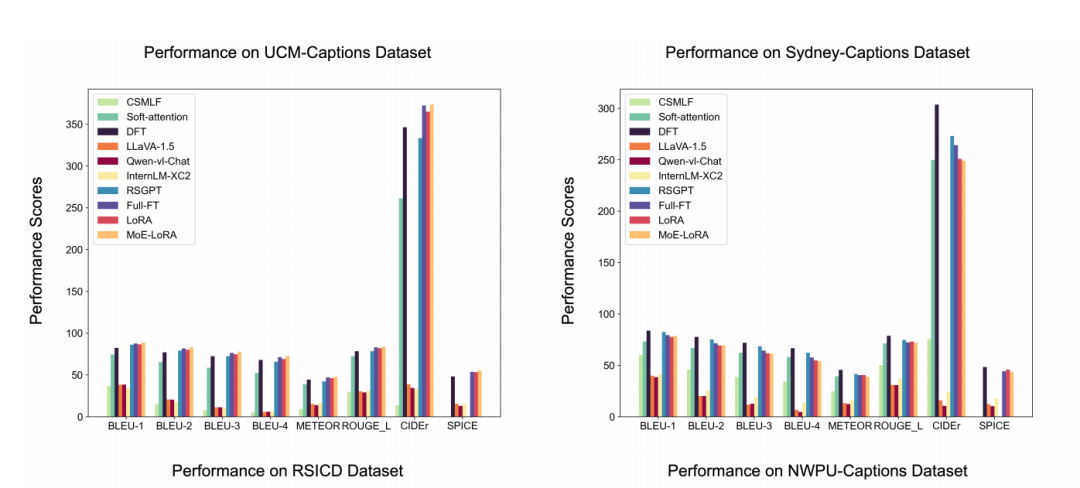

性能评估:通过多个指标对微调后的MLLMs进行评估,包括整体准确性、平均精度、Kappa系数等,以验证模型的有效性。

创新点

-

统一的指令跟随数据集:RS-GPT4V是第一个用于遥感图像理解的统一多模态指令跟随数据集,能够支持多种任务,如图像描述、视觉问答等。

复杂场景理解:通过设计分层指令描述,RS-GPT4V能够捕捉感兴趣对象的细粒度属性及其空间关系,从而提高模型对复杂场景的理解能力。

高性能的模型微调:通过使用RS-GPT4V对MLLMs进行微调,模型在多个遥感数据集上表现出色,能够准确描述细粒度信息,并在多个复杂遥感场景中表现出色。

高效的训练策略:采用低秩适应(LoRA)和混合专家(MoE)策略,提高了模型的训练效率和性能,同时减少了计算资源的消耗。

论文3:

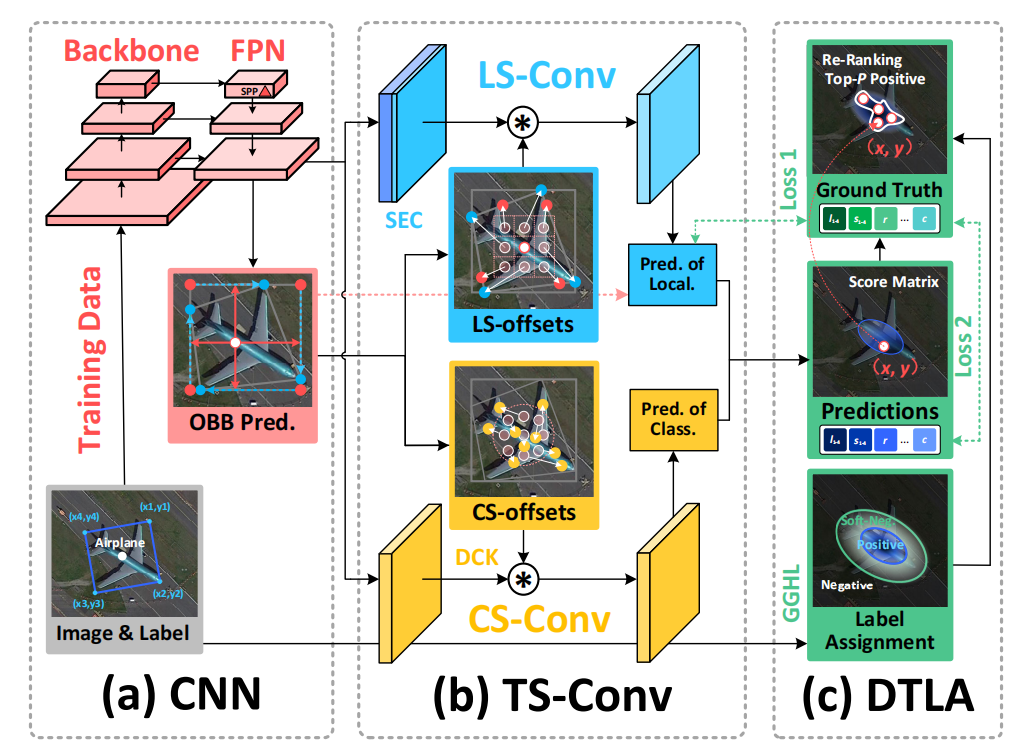

Task-wise Sampling Convolutions for Arbitrary-Oriented Object Detection in Aerial Images

面向任意方向目标检测的分任务采样卷积

方法

-

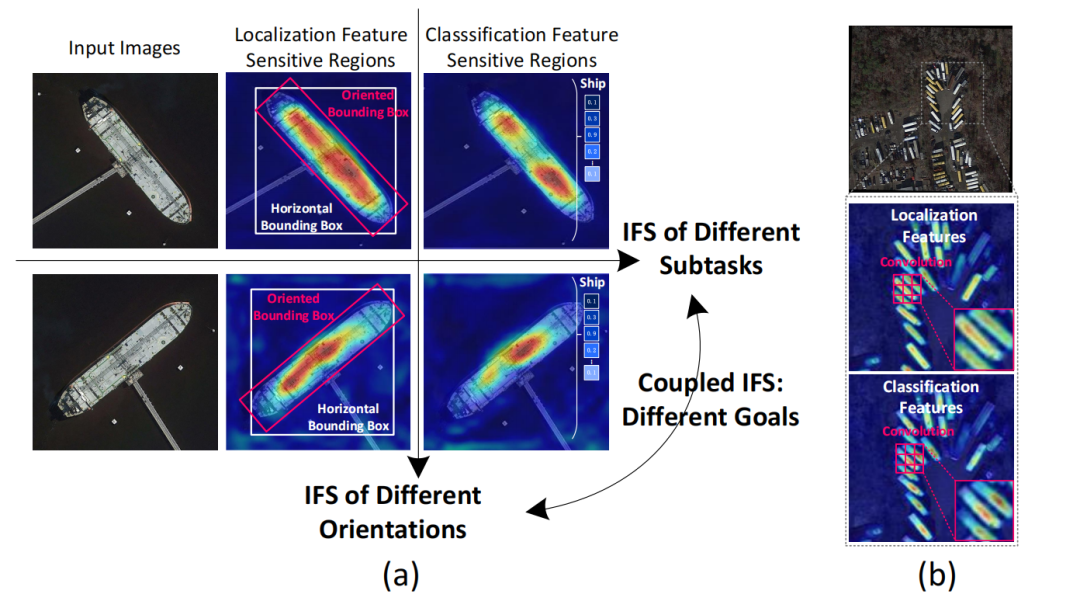

分任务采样卷积(TS-Conv):提出了一种分任务采样卷积方法,通过任务感知的采样策略和动态标签分配策略,解决了任意方向目标检测中的不一致特征敏感性(IFS)问题。

动态循环核(DCK):设计了一种动态循环核,能够根据输入图像的方向自适应调整卷积核的方向,从而提高模型对任意方向目标的检测能力。

动态任务感知标签分配(DTLA):提出了一种动态任务感知标签分配策略,根据任务一致性的得分动态选择候选位置并分配标签,提高了模型的训练效率和检测性能。

特征敏感区域映射:通过任务感知的采样策略,将不同任务的特征敏感区域映射到同一空间位置,从而实现对目标的更准确检测。

创新点

-

解决IFS问题:通过分任务采样卷积和动态标签分配策略,有效解决了任意方向目标检测中的不一致特征敏感性问题,提高了模型的检测准确性和鲁棒性。

方向鲁棒性:动态循环核的设计使得模型能够自适应地调整卷积核的方向,从而对任意方向的目标都能保持较高的检测性能。

高效的训练策略:动态任务感知标签分配策略提高了模型的训练效率,同时减少了对先验标签的依赖,使模型能够更好地适应不同的训练数据和场景。

轻量化模型:通过知识蒸馏等技术,将分任务采样卷积应用于轻量级模型,提高了模型的检测速度和性能,使其适用于嵌入式设备和实际应用。

论文4:

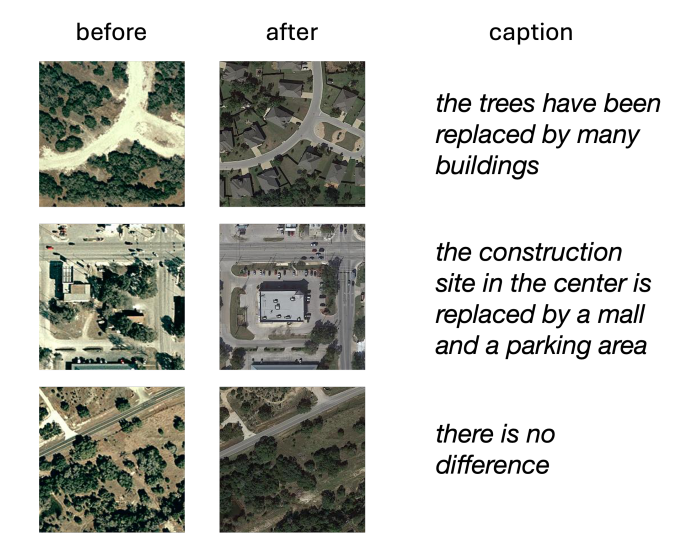

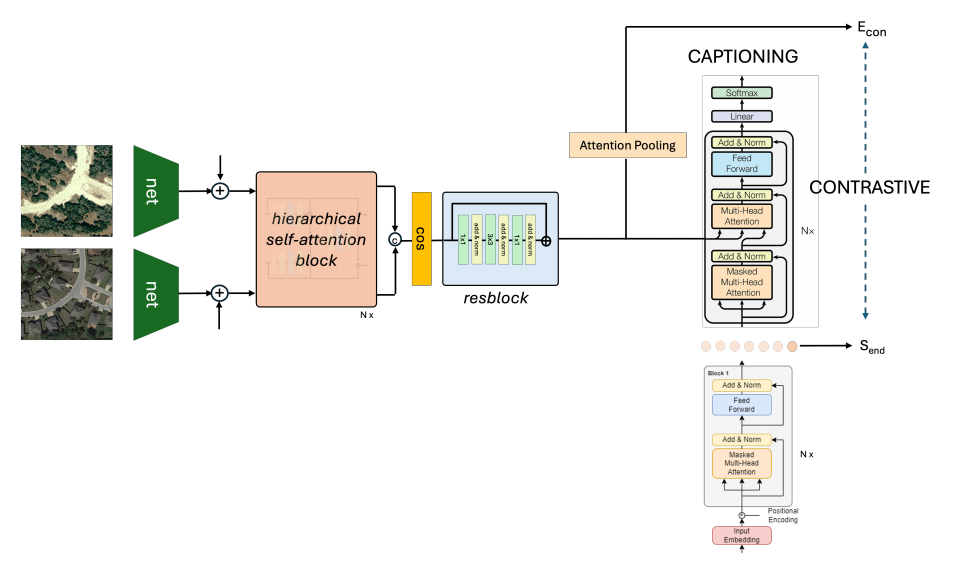

Towards a multimodal framework for remote sensing image change retrieval and captioning

面向遥感图像变化检索和描述的多模态框架

方法

-

对比学习和图像描述:利用对比学习和LEVIR-CC数据集,提出了一种新的基础模型,用于双时相遥感图像的变化描述和文本-图像检索。

编码器设计:采用预训练的双分支网络对图像对进行编码,通过分层注意力机制和余弦掩码融合特征,生成图像对的最终表示。

解码器设计:采用基于Transformer的解码器,分为单模态模块和多模态模块,通过自注意力和交叉注意力机制生成描述。

联合训练:通过结合对比损失和图像描述损失,对模型进行联合训练,以实现文本-图像检索和图像描述任务的统一。

创新点

-

多模态基础模型:首次提出了一种用于双时相遥感图像变化检索和描述的多模态基础模型,能够同时处理图像描述和文本-图像检索任务。

对比学习的应用:通过对比学习策略,模型能够有效地学习图像对和文本描述之间的关联,提高了文本-图像检索的性能。

解码器的创新设计:解码器分为单模态模块和多模态模块,能够更好地融合文本和视觉信息,生成更准确的描述。

数据集的利用:利用LEVIR-CC数据集,为模型的训练和评估提供了丰富的数据支持,推动了遥感图像变化检索和描述领域的发展。

小编整理了遥感+多模态论文代码合集

需要的同学扫码添加我

回复“ 遥感+多模态”即可全部领取

1459

1459

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?