写在前面

下面这篇文章的内容主要是来自发表于Information Fusion的一篇综述文章《Data-driven stock forecasting models based on neural networks: A review》。这篇论文全面回顾了2015年至2023年间股票预测领域数据驱动神经网络的文献,探讨了各种经典和创新的神经网络结构,包括循环神经网络(RNNs)、卷积神经网络(CNNs)、Transformer、图神经网络(GNNs)、生成对抗网络(GANs)以及大语言模型(LLMs)。

1

摘要

股票预测作为金融预测的核心分支,在管理风险和优化投资策略方面对金融分析师、投资者和政策制定者起着至关重要的作用,显著提高了经济决策的效率和有效性。随着信息技术和计算机科学的迅速发展,基于数据驱动的神经网络技术已经越来越成为股票预测的主流方法。尽管最近的综述研究已经提供了对深度学习方法的基本介绍,但仍然缺乏对网络架构设计和创新细节的详细讨论。此外,关于新兴的大型语言模型和神经网络结构的最新研究尚未被纳入现有的综述文献。

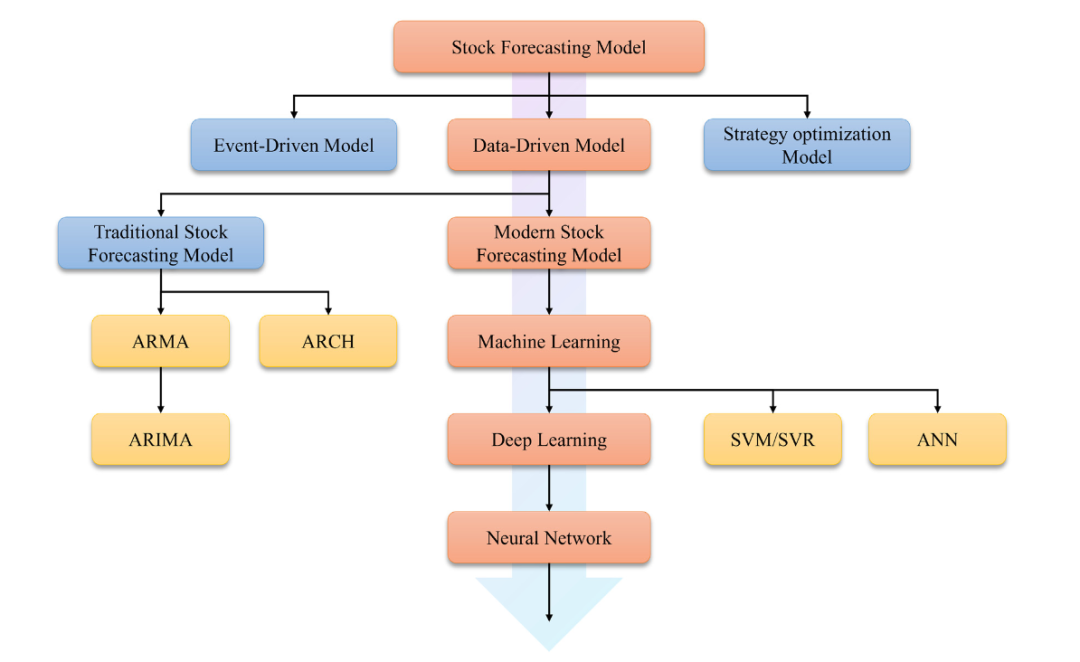

股票预测研究框架

鉴于此,这篇论文全面回顾了2015年至2023年间股票预测领域数据驱动神经网络的文献,探讨了各种经典和创新的神经网络结构,包括循环神经网络(RNNs)、卷积神经网络(CNNs)、Transformer、图神经网络(GNNs)、生成对抗网络(GANs)以及大型语言模型(LLMs)。分析了这些模型在股票市场预测中的应用和成就。此外,文章还概述了股票预测领域常用的数据集和各种评估指标,进一步探讨了未解决的问题和未来研究的潜在方向,旨在为股票预测领域的研究人员提供明确的指导和参考。

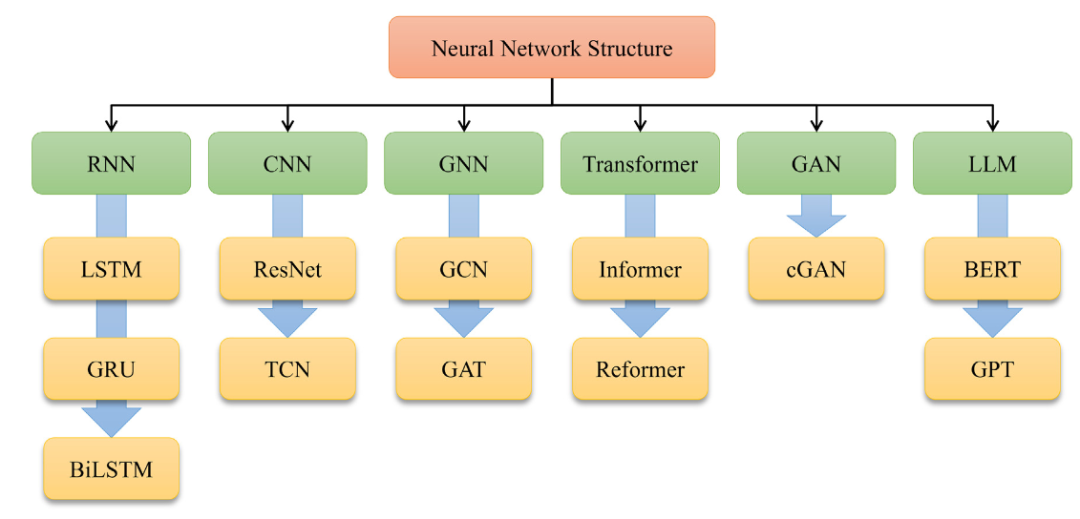

神经网络结构以及相应的变体

2

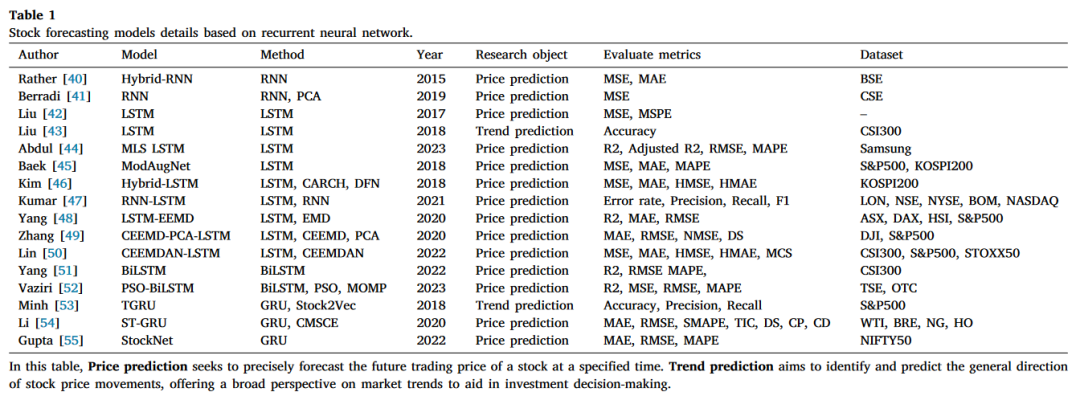

基于RNN的股票预测方法

循环神经网络(RNN)是一种专门设计用于处理序列数据的神经网络,在股票市场预测中起着至关重要的作用。与传统的前馈神经网络不同,RNN能够有效捕获序列数据中的时间依赖关系,通过利用过去的隐藏状态信息来处理当前输入,逐步学习并积累时间序列中的变化模式。这种特性使得RNN在金融时间序列预测中具有显著优势。

基于RNN的股票预测方法

RNN的改进与应用

为了增强RNN在股票预测中的性能,研究人员对其进行了多种改进和组合应用。例如,Rather等人将RNN与指数平滑(ES)和自回归滑动平均(ARMA)模型结合,提出了一种新的混合预测模型(HPM),在处理数据中的突变和尖峰方面表现优异。该模型在印度国家证券交易所的实验中,表现出比传统RNN更高的预测精度。Berradi Zahra等人将主成分分析(PCA)与RNN结合,减少了输入特征的维度,从而提高了RNN的预测能力。

LSTM的应用和扩展

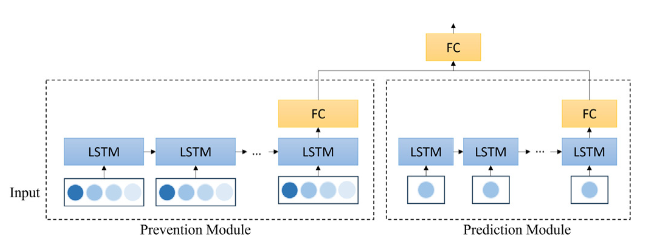

然而,传统的RNN在处理长时间序列时存在梯度消失的问题,导致其难以捕获长期依赖关系。为了解决这一问题,Hochreiter等人提出了长短期记忆网络(LSTM)。LSTM通过引入遗忘门、输入门和输出门等机制来调节信息流动,使其在处理长序列数据时更加稳定和高效。例如,Liu等人将时间序列数据分为不同模式,并将其提出的LSTM模型与传统的ARIMA模型进行对比,结果显示LSTM在各类数据上均表现优于其他方法。通过堆叠多个LSTM层来学习不同层次的时间依赖关系,研究人员进一步提高了模型的预测性能,特别是在复杂的时间序列上。此外,针对有限的训练数据引起的过拟合问题,Yujin Baek等人提出了ModAugNet框架,结合LSTM进行数据增强和防止过拟合的设计。Kim等人进一步将LSTM与广义自回归条件异方差(GARCH)模型结合,显著提升了时间序列波动的建模能力。

ModAugNet框架

结合EMD的LSTM改进

为了提高对复杂金融时间序列的建模能力,研究人员尝试将LSTM与经验模态分解(EMD)相结合。EMD是一种处理非线性和非平稳时间序列的分析方法,可以将复杂的时间序列分解为多个本征模态函数(IMFs)。例如,Yang等人利用集成的EMD方法,将原始复杂的股票价格时间序列分解为更平滑的子序列,然后使用LSTM对这些子序列进行预测,从而提高了整体预测的精度。Zhang等人提出了CEEMD-PCA-LSTM模型,通过CEEMD对时间序列进行分解,并结合PCA降维,再利用LSTM进行预测,进一步提升了模型的响应速度和预测准确性。

BiLSTM与GRU的应用

双向LSTM(BiLSTM)通过利用时间序列的双向特性,可以同时捕获历史信息和未来信息,从而提高对时间序列上下文的理解能力。研究显示,BiLSTM在捕获长短期依赖关系方面比单向LSTM更具优势。此外,门控循环单元(GRU)作为LSTM的简化版本,通过减少门控数量降低了模型的复杂性,在一些任务中展现出与LSTM相当的性能,同时减少了计算开销。

综上所述,RNN及其改进版本(如LSTM、BiLSTM、GRU)在股票市场预测中的应用展示了显著的性能提升。通过结合多种技术,如EMD、数据增强策略以及优化算法,研究人员进一步提高了这些模型在复杂金融数据上的预测能力,为未来的金融时间序列预测提供了更多的可能性。

3

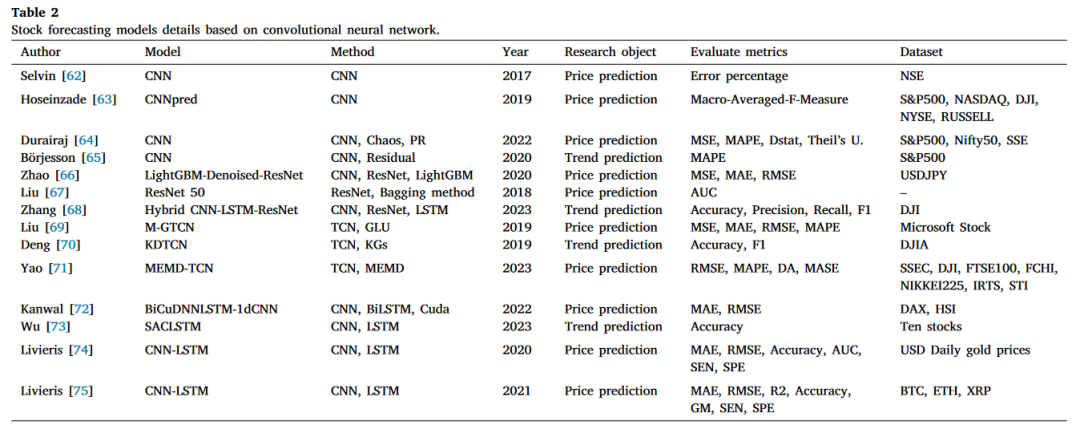

基于CNN的股票预测方法

卷积神经网络(CNN)是一种主要用于图像处理的深度学习模型,通过卷积层中的各种滤波器来提取局部特征,每个滤波器专注于捕捉特定的信息。这些特征提取的能力使得CNN不仅适用于视觉领域,也可以用于处理复杂结构的时间序列数据。在股票市场预测中,CNN可以通过不同大小的卷积核进行多尺度学习,捕获时间序列中多样的周期性模式和趋势。

基于CNN的股票预测方法

CNN在股票市场预测中的应用

Selvin等人比较了线性算法(如AR、MA、ARUMA)和非线性算法(包括ARCH、GARCH,以及神经网络模型如CNN、RNN和LSTM)在印度国家证券交易所(NSE)数据集上的表现,结果显示,尽管RNN和LSTM擅长捕捉时间序列的动态特性,CNN在预测准确性上表现更好。Hoseinzade等人进一步提出了CNNpred框架,包括2D-CNNpred和3D-CNNpred两种变体,分别针对市场数据进行通用模型构建和多市场数据融合学习。Dr. M. Durairaj等人则结合混沌理论和CNN来预测金融时间序列,进一步利用多项式回归修正CNN的预测误差,生成更加精确的混合预测模型。

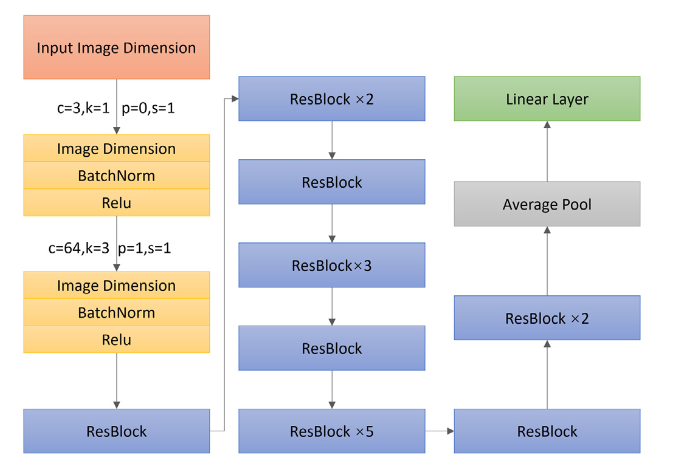

深度残差网络(ResNet)的应用

深度残差网络(ResNet)作为解决深度网络梯度消失或爆炸问题的解决方案,通过引入“跳跃连接”使信号能够在多层网络中直接传播,极大提高了网络深度和性能。例如,Lukas Börjesson等人通过在网络结构中集成残差连接,确保输入信息在多个网络层中得到保留,显著提升了模型性能。Zhao等人则结合LightGBM与小波去噪ResNet,成功预测了外汇汇率变化,显示了与传统CNN相比,ResNet在高阶特征提取上的优越性。

小波去噪ResNet架构

时间卷积网络(TCN)的引入

为了扩大卷积网络的感受野并有效捕获时间序列中的长距离依赖,Bai等人提出了时间卷积网络(TCN),通过扩展的卷积核和膨胀卷积技术实现了无额外参数的情况下的高效长距离依赖建模。Liu等人提出的多通道门控时间卷积网络(M-GTCN)利用TCN和残差结构进行多通道并行建模,实现了时间序列的高效预测。Deng等人引入知识驱动时间卷积网络(KDTCN),将来自金融新闻的结构化事件和外部知识图与时间序列特征结合,进一步提升了对股市趋势的预测能力。

混合CNN与其他网络的预测模型

许多研究者尝试将CNN与其他网络(如RNN、LSTM或GRU)相结合,开发了混合模型以充分利用多种网络的优势。Kanwal等人提出了结合双向CUDA深度神经网络LSTM(BiCuDNNLSTM)与1D-CNN的混合预测模型,通过1D-CNN进一步学习股票数据中的快速变化特征,提升了预测的准确性。Wu等人提出了股票顺序阵列卷积LSTM(SACLSTM)网络,将股票市场参数和时间步转化为适用于二维卷积处理的矩阵,以提取时间序列中的空间信息,随后通过LSTM层捕获动态依赖关系,结果表明该方法在股票预测任务中的表现优于单独使用CNN或LSTM的模型。

尽管卷积神经网络在捕捉局部特征方面表现出色,但由于其固定的局部感受野和结构限制,传统的一维卷积神经网络(1D-CNN)在捕捉时间序列数据中的全局依赖性上存在局限性。这对于诸如股票市场预测等需要理解整体市场趋势和长时间依赖关系的任务来说,发展或改进1D-CNN以更好地捕捉和处理这些全局特性显得尤为重要。

4

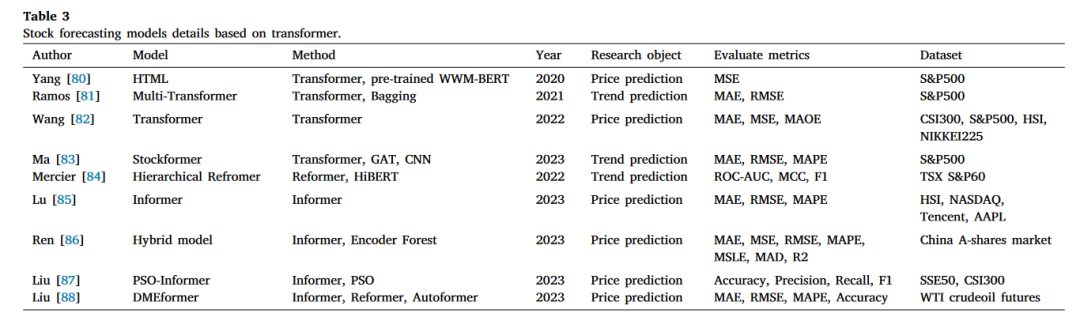

基于Transformer的股票预测方法

注意力机制旨在增强神经网络处理长距离序列依赖的效率,通过克服RNN必须顺序处理数据的限制,允许模型并行计算序列中不同位置之间的依赖关系,有效地捕获长期信息。自注意力结构(Self-Attention)是注意力机制的扩展,通过计算输入序列中不同位置特征向量之间的相似性来建模其关系,能够有效地捕捉长距离依赖。Transformer模型引入了基于自注意力的多头注意力机制,具有独特的编码器-解码器架构,结合了多头自注意力和前馈网络组件。与递归模型不同,Transformer可以在不进行递归的情况下建立全局依赖关系建模,并增强了并行处理能力,能够捕捉输入数据中不同表示子空间的关系。这一特性使得Transformer在时间序列预测中可以同时捕获短期波动和长期趋势。

基于CNN的股票预测方法

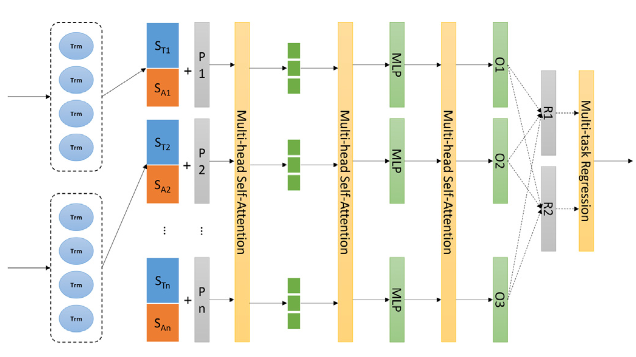

Transformer的优化与变体

近年来,Transformer及其变体在金融时间序列数据的分析中展示了出色的性能,不仅提高了预测准确性,还显著提升了处理速度和模型的可解释性。例如,Yang等人设计了基于层次化Transformer的多任务学习方法(HTML),利用文本和音频数据预测S&P 500股市未来的短期和长期价格波动。Wang等人直接使用Transformer对每日收盘价进行建模,实验结果表明Transformer模型在全球主要股市(如CSI 300、S&P 500、恒生和日经225)上显著优于传统深度学习模型。

HTML模型架构

由于Transformer在处理大规模数据集时对内存和计算的需求较高,研究人员开发了一些变体来解决这些问题,例如Reformer和Informer。Reformer通过引入可逆层和局部敏感哈希技术,显著减少了内存需求并优化了长序列处理的效率。Informer专为时间序列预测设计,采用概率稀疏变换来降低计算复杂度,在处理长序列数据时提高了效率和性能。Mercier等人借鉴HiBERT,开发了层次化Reformer模型来分析金融市场文件,成功用于预测交易量变化。

Lu等人将Informer模型与常见的网络(如LSTM、Transformer和BERT)进行了比较,结果显示Informer在所有数据集上的表现最好,并在迁移学习实验中表现出强大的鲁棒性和适应性。Ren等人提出了结合编码器森林(EF)和Informer的模型,以减轻长序列噪声对股票预测的影响,而Liu等人则利用粒子群优化算法优化了Informer网络参数,开发了一种名为PSO-Informer的长期股价序列预测方法。

Transformer在时间序列预测中的挑战

尽管Transformer利用自注意力机制解决了长距离依赖问题,并在自然语言处理等领域取得了显著突破,但对于超长序列,Transformer在计算和内存方面的高需求可能会限制其在大规模应用中的实用性。在股票市场预测中,需要处理的时间序列数据的长度和复杂性通常超出传统范围,这可能给Transformer模型的资源和处理速度带来显著压力。因此,开发或优化Transformer架构,以高效处理长序列并降低资源消耗,对于适应股票预测的需求至关重要。

5

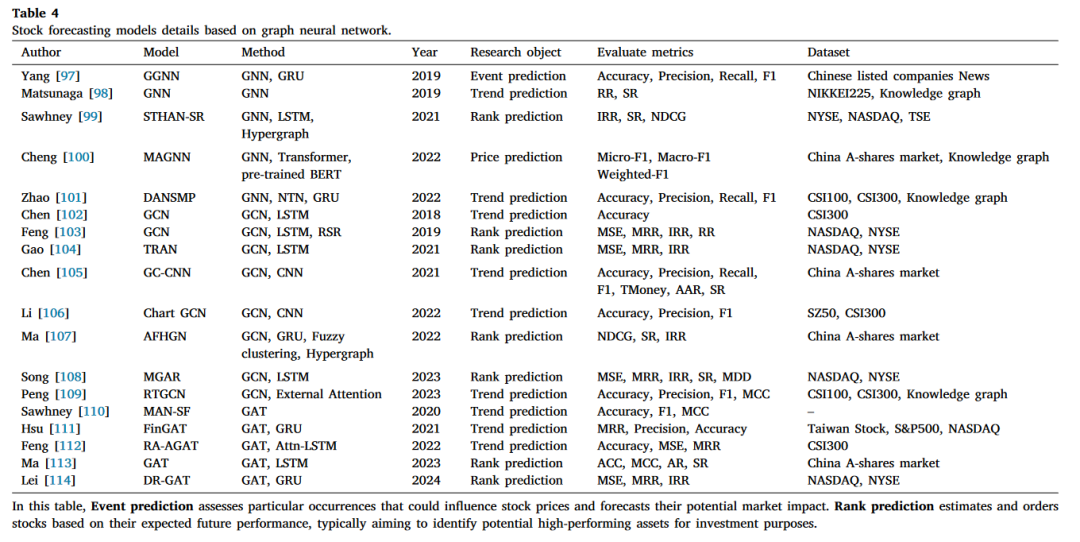

基于GNN的股票预测方法

图神经网络(GNN)专为处理图结构数据而设计,允许通过节点之间的信息聚合和更新来捕捉复杂的关系和依赖性。在股票预测中,GNN展现了独特的优势。股票市场可以被视为一个复杂的图,其中节点代表不同的股票,边则表示它们之间的关系。通过学习这些节点和边的特征,GNN能够有效捕捉股票之间的动态关联和相互影响,从而预测未来的股票价格变化。这种方法特别适用于多资产预测任务,提供了比传统时间序列模型更深的市场动态洞察力和更高的预测准确性。

基于GNN的股票预测方法

GNN在股票预测中的应用

Yang等人提出了一种基于门控图神经网络(GGNN)的方法,用于捕捉事件图之间的复杂关系,通过训练填空任务预测即将发生的事件。Matsunaga等人则通过将知识图谱与图神经网络结合,增强了股票市场预测的准确性和泛化能力。他们将企业相关的知识图直接集成到股票市场预测模型中,结果显示在Nikkei 225市场中,其模型的回报率和夏普比率分别比市场基准高29.5%和2.2倍。Sawhney等人重新定义了股票预测问题,将其视为排序学习问题,提出了STHAN-SR模型,利用超图和时间Hawkes注意机制来建模股票依赖性和价格动态,取得了良好的预测效果。

多模态图神经网络(MAGNN)与异质图神经网络的应用

Cheng等人提出了多模态图神经网络(MAGNN),以从多模态输入(如历史价格、媒体新闻和相关事件)中学习,网络基于金融知识图,节点由源数据组成,边表示关系。为了增强模型的可解释性,研究人员使用了两阶段的注意力机制进行联合优化,允许用户学习跨模态和模态内的信息。Zhao等人首次尝试使用异质图神经网络(GNN)来探索股票市场中双类型混合关系知识图的溢出效应,提出了一种创新的双注意力网络DANSMP,用于学习双类型混合关系知识图中的股票动量溢出特征。

基于图卷积网络(GCN)的股票预测模型

图卷积网络(GCN)是GNN的一种变体,将卷积神经网络的概念扩展到图结构数据上,实现了对图节点特征的有效学习。Chen等人开发了一种基于GCN的联合预测模型,通过构建包含所有相关公司的图神经网络来捕捉市场动态,结果显示其模型在股价预测方面表现出色。Feng等人提出了一种名为关系股票排序(RSR)的深度学习解决方案,利用时间图卷积网络处理股票排序问题,测试显示其回报率较基线模型提升115%。

基于图注意网络(GAT)的股票预测模型

图注意网络(GAT)是GNN的另一重要变体,利用注意力机制动态确定邻近节点的重要性,从而在节点更新过程中更精细地考虑周围节点的贡献,能够更有效地捕捉图的结构信息。在股票预测中,GAT可以分析各种经济实体之间的复杂关系,如公司之间的竞争与合作、供应链连接或宏观经济因素的影响。Sawhney等人开发了多重注意网络(MAN-SF),结合金融数据、社交媒体和股票间关系的复杂时间信号进行有效整合。Hsu等人开发的FinGAT模型在股票层面、行业层面进行特征学习,利用GAT探索股票和行业之间的潜在交互。

动态图构建与其他GNN模型的优化

考虑到静态股票图存在的滞后和过拟合问题,Ma等人在GNN之上引入了动态图构建模块,通过MoDis和DGLSTM构建动态图,有效增强了股票趋势预测的性能。此外,Lei等人提出了一种动态路由图注意网络(DR-GAT),用于股票推荐,使用关系图路由器(RGR)根据股票的波动特性将每个股票路由到最佳关系图中。

综上所述,图神经网络(GNN)在处理和分析股票市场中复杂节点关系方面表现出色,能够有效捕捉股票市场网络中的信息流动和相互作用。然而,GNN对图拓扑结构高度敏感,因此需要高质量和完整的图数据以确保预测的准确性和稳定性。在股票市场预测中,图的质量直接影响模型性能,股票市场网络的动态变化和复杂性要求GNN适应这些变化,并准确反映节点之间的实际关系。因此,确保高质量的图数据输入对于GNN股票预测至关重要。

6

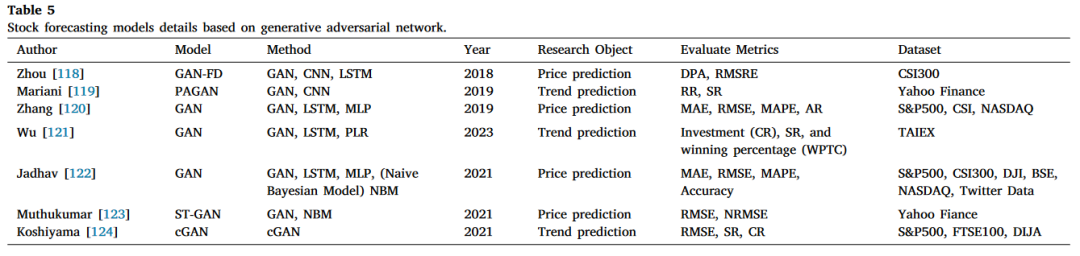

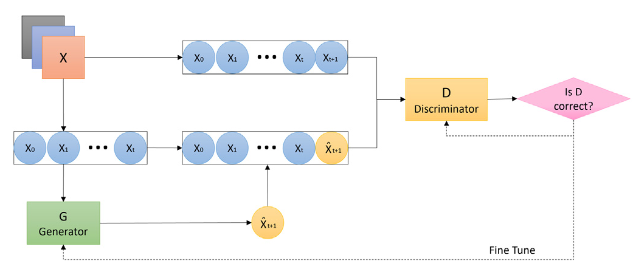

基于GAN的股票预测方法

生成对抗网络(GANs)是一种由生成器和判别器组成的深度学习框架,通过对抗性训练生成逼真的数据样本,在数据增强、稀有事件模拟等方面表现出色。在股票预测领域,GANs通过扩展和增强数据集,使模型能够更好地捕捉市场动态。尽管其潜力巨大,但训练过程的稳定性和参数调试仍是挑战,特别是在应对复杂的市场波动时。

基于GAN的股票预测方法

GANs在股票预测的典型案例

在实际应用中,Zhou等提出了基于LSTM和CNN的GAN-FD框架,用于分析模型周期更新对预测效果的影响;Mariani等开发了PAGAN,专注于建模资产间的非线性交互,为投资组合分析提供了新的视角。其他研究进一步拓展了GAN的功能,例如Wu等结合分段线性表示(PLR)学习市场中的三种交易行为(买入、卖出、持有),显著提高了交易预测的准确性。类似的改进还包括将情感分析融入模型,结合金融新闻文本信息来提升预测效果。

GAN架构

cGANs的增强与改进

条件生成对抗网络(cGANs)通过加入特定条件进一步提高了生成数据的精确性和相关性。例如,Koshiyama等利用cGAN在多种金融数据集上优化交易策略,在传统方法表现有限的情况下展现出色效果。这种基于条件信息的生成方式使得GANs在需要高度定制化的应用中具有显著优势。

GANs的未来方向与优化策略

尽管GANs在股票市场预测中展现了强大的能力,但其不稳定性仍是关键问题。股票市场的波动性和数据的不确定性加剧了模型训练的难度。未来的研究需要重点优化GAN的训练策略和参数调试机制,以提升模型的稳定性和适应性,使其在应对复杂市场动态时表现更为可靠。

7

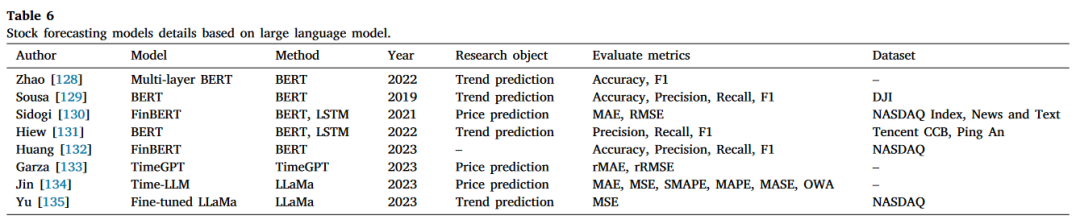

基于LLM的股票预测方法

近年来,大型语言模型(LLMs),如BERT和GPT,在自然语言处理任务中展现了卓越的性能,特别是在文本生成、语义理解和情感分析等方面。这些模型的能力使其在金融领域,尤其是股票预测中具有重要价值。通过分析新闻、财务报告和社交媒体中的文本数据,这些模型能够捕捉市场情绪和公众舆论的微妙变化,这些因素会对股票市场波动产生影响。结合历史价格数据,LLMs还可以进行复杂的时间序列分析和股票价格预测,揭示市场变化趋势。

基于LLM的股票预测方法

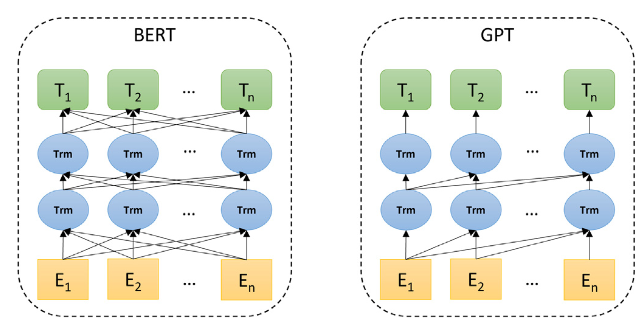

BERT的创新与改进

BERT(双向编码器表示)是一种基于Transformer架构的先进模型,旨在捕捉语言中的双向上下文信息。通过掩码语言模型(MLM)和下一句预测(NSP)等预训练技术,BERT能够有效理解和预测语言中的复杂关系。针对其处理长文本的局限性,研究者提出了一些改进方法,例如滑动窗口技术用于文本分段和主题聚合,从而显著提升了对股票评论主题识别的准确性。此外,BERT在金融情感分析中的应用也非常广泛,例如预测市场情绪对股票价格的影响、分类新闻情感以及生成基于情感的金融指标。

BERT和GPT架构

FinBERT与GPT的金融应用

在金融领域,FinBERT专为处理金融文本而设计,优化了对小样本数据的性能,同时通过权重优化和情感分类显著提升了领域特定的文本分析能力。相比之下,GPT模型则在文本生成方面表现出色,其解码器架构结合无监督预训练和监督微调,赋予其强大的灵活性和适用性。例如,TimeGPT通过自注意力机制捕捉时间依赖性,实现了跨领域时间序列预测的卓越性能。同时,Time-LLM等新框架通过时间序列数据与语言模型的模态对齐,显著提升了少样本和零样本预测能力。

LLMs的挑战与未来前景

尽管LLMs在金融领域展示了强大的分析和预测能力,但它们仍面临一些挑战。模型可能过于依赖训练数据,对新颖或异常的金融事件适应性较弱。此外,训练资源需求巨大,黑箱特性也限制了决策过程的透明性。未来的发展方向或许在于改进模型的透明性与适应性,同时探索更高效的训练和推理方法,以满足金融应用的实际需求。

8

开放性问题

尽管当前的股票预测技术已取得显著成果,但现有研究仍面临诸多挑战,该领域的未来发展空间依然广阔。

数据表征能力的不足

股票市场预测中广泛使用的一维时间序列数据(如股票价格和交易量)虽然有助于捕捉市场变化,但由于其特征表征能力有限,难以全面反映复杂的市场动态。此外,现有模型在应对噪声数据及未见数据时往往表现不佳。针对这一问题,自监督学习方法展现了巨大的潜力,通过从大量未标注数据中学习潜在模式和结构,显著提升模型的鲁棒性与适应性。同时,将时间序列数据转换为二维图像(如GAF编码)不仅保留了时间和空间信息,还提升了数据的表征能力。多模态学习则通过整合文本、图像、音频等多种数据源,为模型提供更加全面的市场视角,这些方向为改进股票预测的基础数据表征能力奠定了坚实的技术基础。

长期依赖建模的挑战

在时间序列分析中,长期依赖建模是一个核心问题,对股票预测尤为关键。传统的递归神经网络(RNN)及其改进模型(如LSTM、GRU)在捕捉长序列信息方面已取得显著进步,而Transformer进一步提升了并行处理能力和长距离依赖建模的效果。然而,其计算复杂度较高,限制了处理超长序列的效率。针对这一问题,学者们提出了如Informer的稀疏注意力机制以及具有线性扩展能力的结构化状态空间模型(SSMs),这些方法显著优化了超长序列的处理。此外,持续学习(Continual Learning)方法为动态市场环境提供了新思路,通过避免“灾难性遗忘”,模型可以在保持旧知识的基础上不断适应新数据和任务变化。

模型的普适性与可解释性问题

现有基于神经网络的股票预测模型多在特定环境或数据集下表现优异,缺乏普适性。随着全球金融市场的日益复杂化,模型需要在多样化市场条件下具备稳定性。此外,深度学习模型作为“黑箱”的特性使得其决策逻辑缺乏透明性,这在需要高可信度的金融决策场景中是一大限制。未来的研究方向包括开发具有广泛适应性的通用模型,以及引入如LIME、SHAP等解释性学习方法,以增强模型的透明性和用户信任度。同时,大型语言模型(LLMs)的快速发展为解决这些问题提供了新机会,其在多样化金融数据处理和预测中的潜力值得深入挖掘。

评价指标和数据集的统一性问题

股票预测领域目前普遍缺乏统一的评价体系和基准数据集,这在一定程度上阻碍了模型间的对比与改进。大多数研究仅关注分类或回归指标,而忽视了如收益率(RR)和夏普比率(SR)等直接反映模型盈利能力的关键金融评价指标。同时,模型在特定数据集上的表现常无法推广到不同市场环境下。未来的研究应注重建立统一的基准数据集和评价指标体系,以促进研究间的协作和进步,最终帮助投资者更好地管理风险、优化投资策略,并提升经济决策的效率与效果。

参考文献:

Bao, W., Cao, Y., Yang, Y., Che, H., Huang, J., & Wen, S. (2024). Data-driven stock forecasting models based on neural networks: A review. Information Fusion, 102616.

往期推荐阅读

NeurIPS 2024 | 量化交易相关论文(附论文链接)

解读:ChatGPT在股票市场预测方面的应用

【python量化】多种Transformer模型用于股价预测(Autoformer, FEDformer和PatchTST等)

【python量化】挖掘股价中的图关系:基于图注意力网络的股价预测模型

【python量化】基于backtrader的深度学习模型量化回测框架

【python量化】将Transformer模型用于股票价格预测

【python量化】搭建一个CNN-LSTM模型用于股票价格预测

【python量化】利用首个时序大模型TimeGPT进行股价预测

《人工智能量化实验室》知识星球

加入人工智能量化实验室知识星球,您可以获得:(1)定期推送最新人工智能量化应用相关的研究成果,包括高水平期刊论文以及券商优质金融工程研究报告,便于您随时随地了解最新前沿知识;(2)公众号历史文章Python项目完整源码;(3)优质Python、机器学习、量化交易相关电子书PDF;(4)优质量化交易资料、项目代码分享;(5)跟星友一起交流,结交志同道合朋友。(6)向博主发起提问,答疑解惑。

赠书活动

在留言区分享你对人工智能与量化交易的看法,我们将选出优质的留言,点赞前4名粉丝将包邮赠送以下三本书之一,活动截止时间2月26日。

赠书介绍:

《基于 Python 的金融分析与风险管理(畅享版)》这套三卷本丛书就从 Python 基础语法讲起,结合利率与汇率分析、债券、股票定价等应用,再深入复杂的期权定价分析、测度期权风险、构建期权交易策略等,体系化地讲透了 Python 在金融领域的应用。

1118

1118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?