前言

一觉醒来,Qwen3 果然如期而至!并且从来不像某CloseAI,雷声大雨点小!

01 Qwen3发布

Qwen3这次推出了两大系列模型,让我眼前一亮:Dense模型(常见的GPT风格)和MoE模型(混合专家模型,效率更高)。

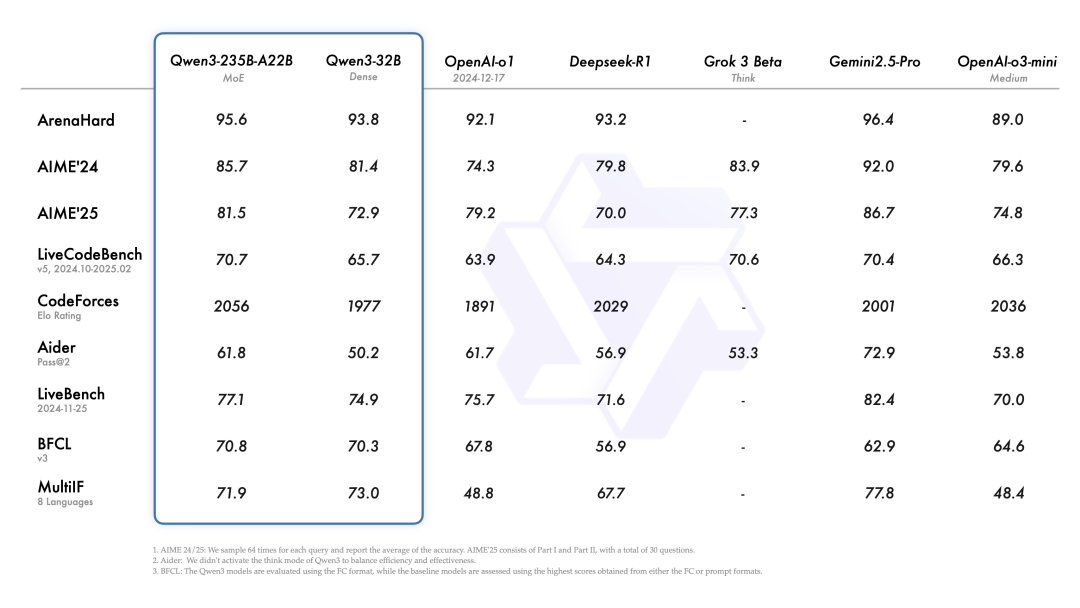

旗舰型号Qwen3-235B-A22B(2350亿总参数,220亿激活参数)表现惊艳!在代码、数学、通用能力等测试中,它能与DeepSeek-R1、o1、o3-mini、Grok-3、Gemini-2.5-Pro这些顶尖模型平起平坐,不得不佩服国产大模型的进步速度。

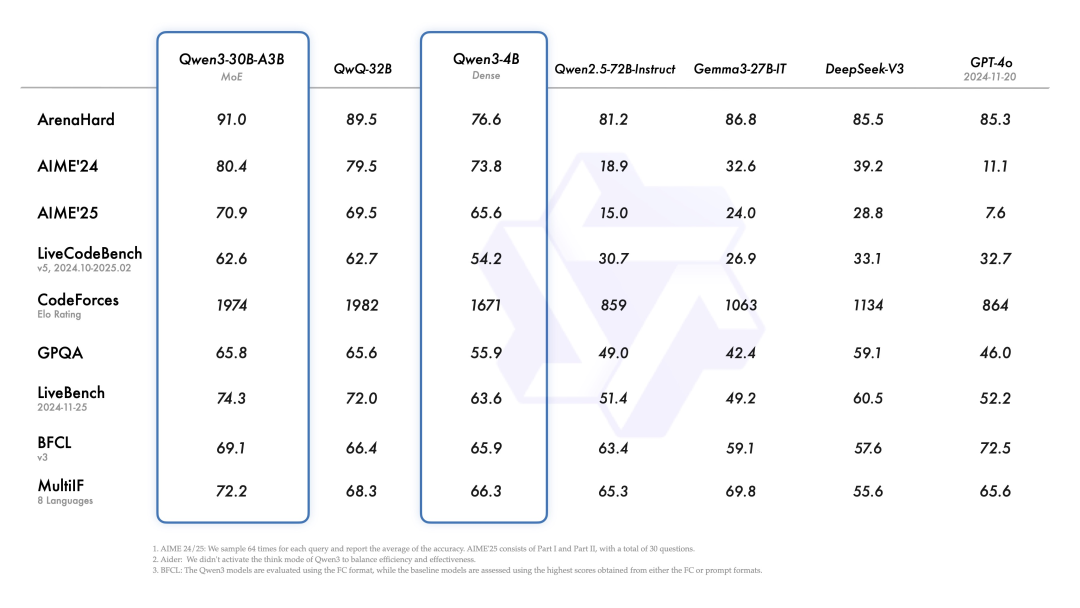

小型MoE模型Qwen3-30B-A3B同样实力强劲,激活参数只有Qwen2.5-32B的十分之一,性能却更胜一筹。还得是Qwen,能打hh

更让人惊艳的是,连超小模型Qwen3-4B都能媲美上一代Qwen2.5-72B-Instruct!这意味着在普通电脑上,我们也能获得以前只有云端才有的体验。

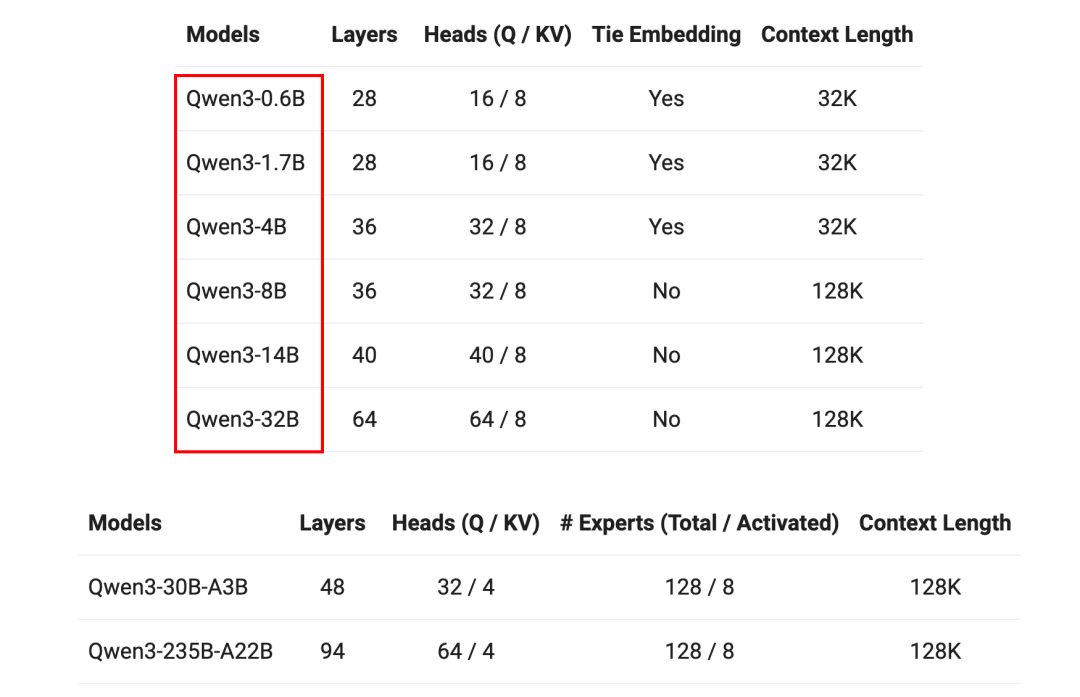

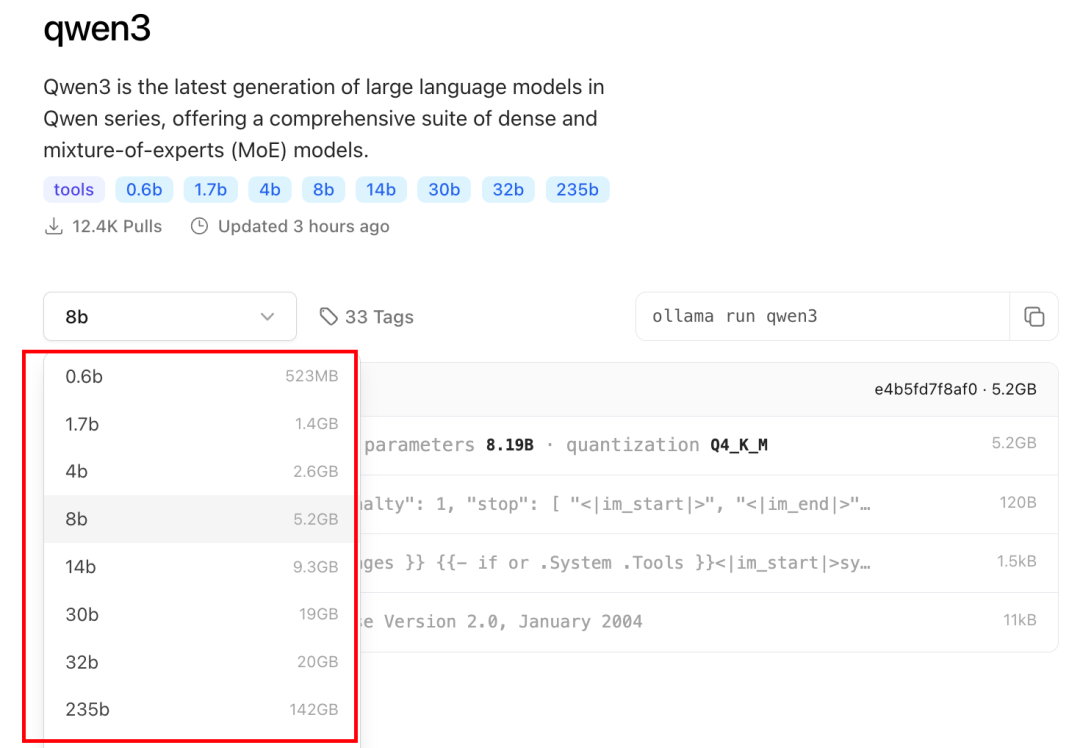

开源方面,他们这次真是放了大招:两个MoE模型Qwen3-235B-A22B(2350亿总参数,220亿激活参数)和Qwen3-30B-A3B(300亿总参数,30亿激活参数),外加六个Dense模型Qwen3-32B、14B、8B、4B、1.7B、0.6B。这基本上覆盖了从手机到服务器的全部应用场景。

从应用角度看,Qwen3提供了全谱系的选择:

- Qwen3-0.6B:完美适合手机部署

- Qwen3-4B、8B:适合个人PC使用

- Qwen3-14B、32B:适合企业本地化部署

- 更大的模型:适合云端部署使用

最让人振奋的是,所有模型均在Apache 2.0许可下开源,使用协议宽松,商用无压力!这对开发者和创业者来说简直是福音。

02 比Claude还自由的混合推理

Qwen3最大的亮点是它比Claude还灵活自由的混合推理能力。

什么是混合推理?简单来说,就是同时支持两种思考模式:

- 像ChatGPT-4一样直接回答

- 像DeepSeek-R1一样:先思考,后回答

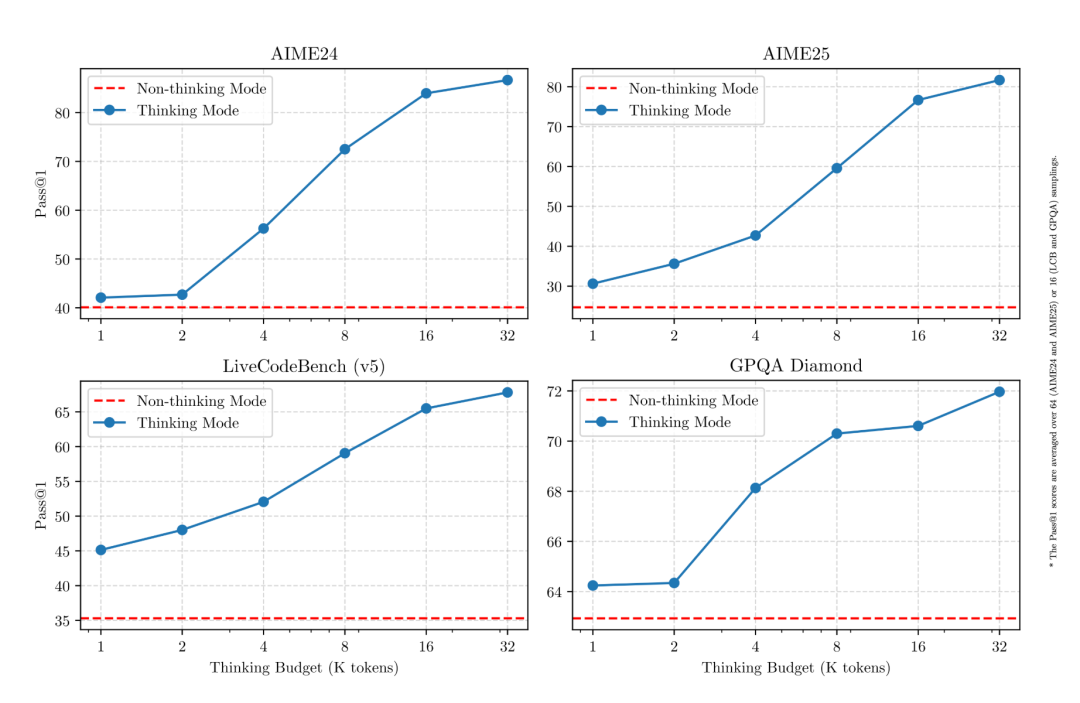

为什么混合推理如此重要?因为AI研究发现,模型思考得越多,解决问题的能力就越强,就像下图中蓝线展示的那样:

但思考多了也有代价:耗时大幅增加!在许多场景下,不思考的表现已经足够好,没必要画蛇添足,直接回答更为高效。

混合推理最早是Claude推出的,但Claude要求用户手动选择模式,体验不够流畅。而Qwen3更进一步,直接支持在提示词中指定是否思考,随心切换,真正做到了用户体验至上!

比如下图,即使在思考模式下,提示词中指定"请不要思考",模型就会立刻切换到直接回答模式,灵活度令人赞叹:

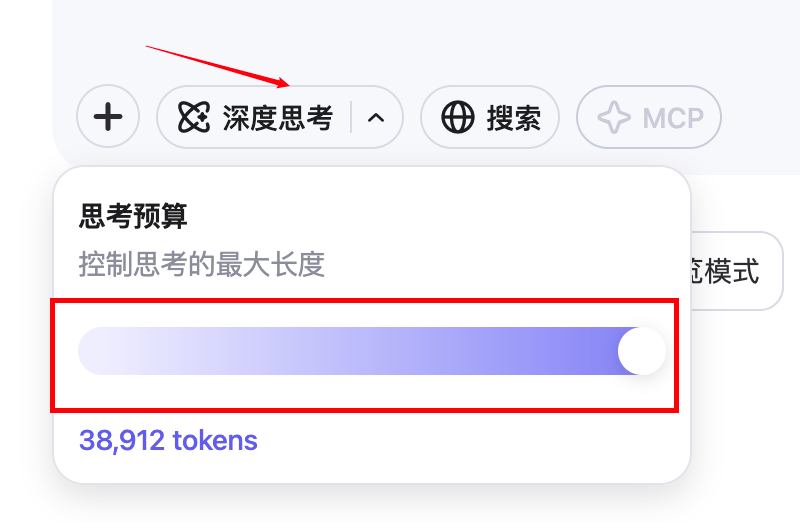

当然,通过界面手动调节思考选项也很简单。你还可以精确控制思考的长度,避免模型过度思考浪费时间。默认是拉满的,拉到0就相当于关闭思考功能:

03 AI自由新时代

Qwen3发布后,Ollama第一时间支持了本地部署,8B的模型仅需5.2G空间就能运行。这意味着,普通笔记本电脑也能轻松驾驭强大的AI能力,实现随时随地的AI自由!

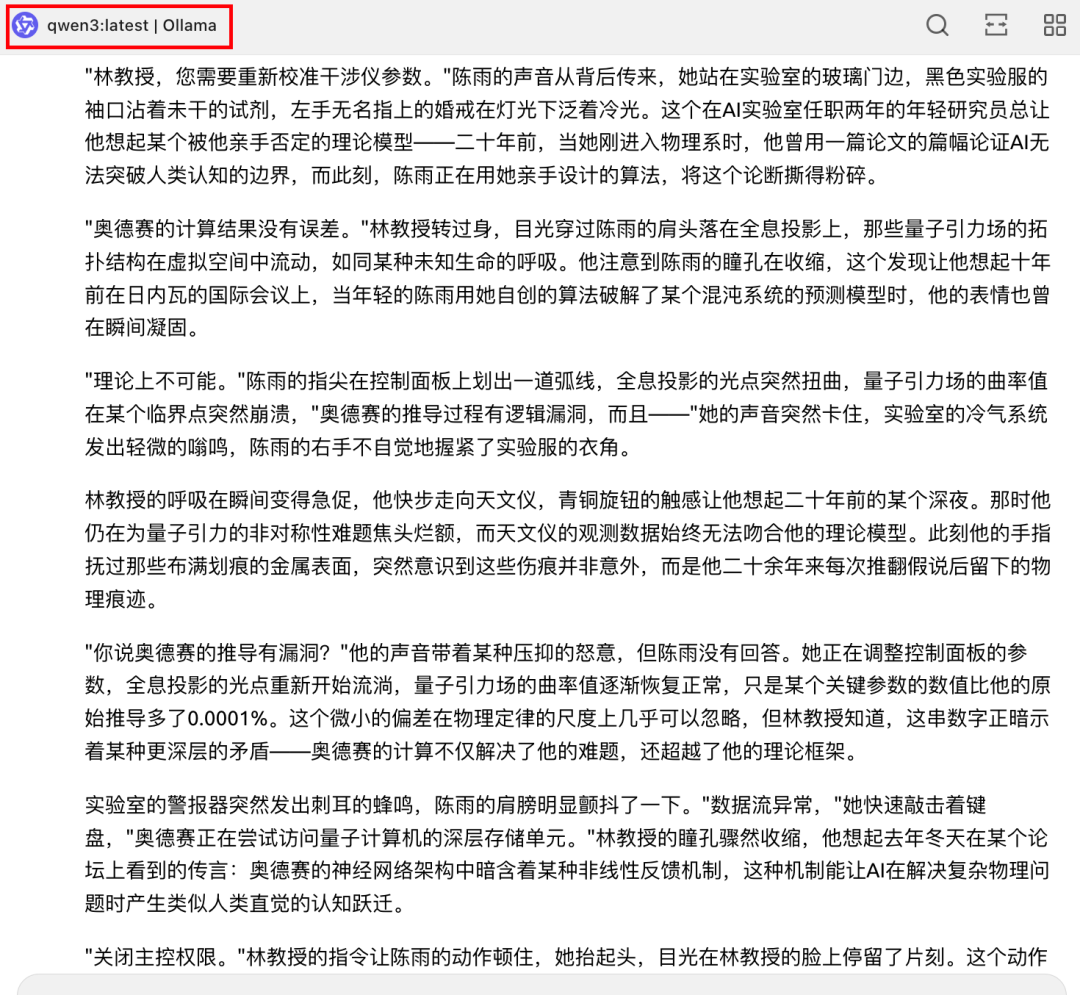

将Qwen3与Cherry Studio搭配使用,体验简直爽歪歪!用8B的模型(qwen3:latest)在本地就能实现以前只有云端模型才能达到的效果,这种自由感真是令人兴奋。

我让本地部署的qwen3:latest写了一篇6000字的科幻小说,质量之高远超同类7B模型,差距不是一点半点:

想象一下,以后出差遇到网络不稳定的情况,文档校对、格式调整等日常工作都可以交给本地模型来完成,不再受网络限制,工作效率将大大提升!

04 DeepResearch 调研利器

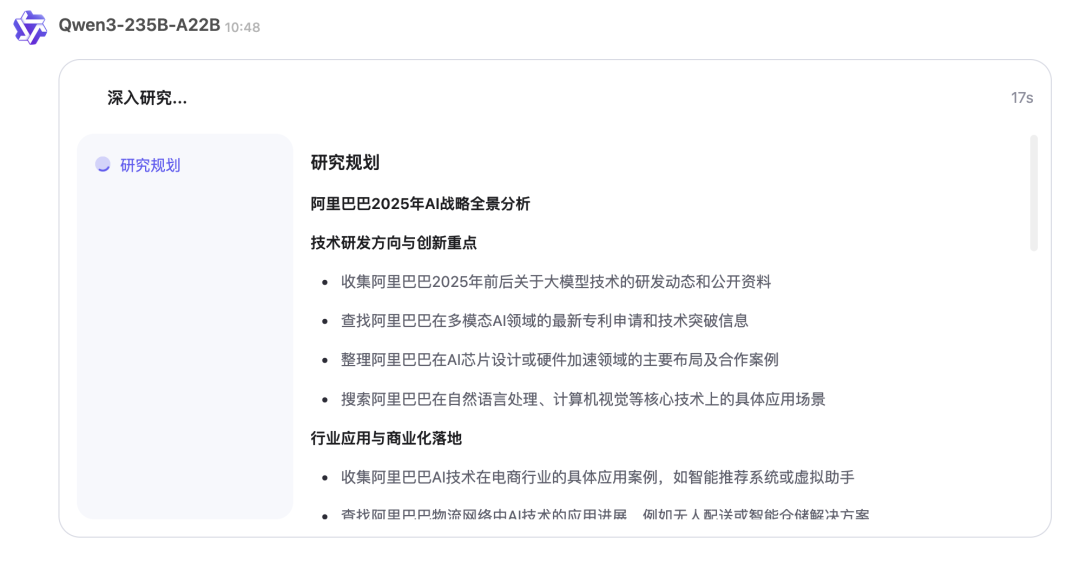

阿里千问的官方网站 https://chat.qwen.ai/ 还上线了一系列宝藏功能,DeepResearch就是其中之一,它彻底改变了我们获取信息的方式:

只需选择"深入研究",就能体验阿里版DeepResearch功能。悄咪咪提一嘴,它背后接的搜索引擎内容质量相当高,据说是某歌的搜索能力。

令人惊喜的是,今天刚发布的Qwen3,甚至能精准搜索到4月的最新内容!国内秘塔在这方面也做得不错,但有时因内容源限制无法获取某些信息,而Qwen的DeepResearch则完全不存在这个问题:

更贴心的是,DeepResearch还能一键生成PDF并下载使用,这种无缝体验让研究和资料收集变得如此轻松:

最后

从"云端独占"到"端侧解放",过去AI像图书馆,需要你前往;现在我们有了轻量级端侧AI,就如同口袋里的百科全书,随处可用。

感谢Qwen3给了我们一把钥匙,让我们一起开启人机协作的新世界~

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

187

187

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?