论文地址:CBAM: Convolutional Block Attention Module点击即可跳转

实现代码:CBAM代码实现点击即可跳转

CBAM(Convolutional Block Attention Module)注意力机制是一种结合了通道注意力和空间注意力的机制,旨在提升卷积神经网络(CNN)对图像特征的敏感度和表达能力。

以下是对通道和空间双重作用的CBAM注意力机制的详细解析:

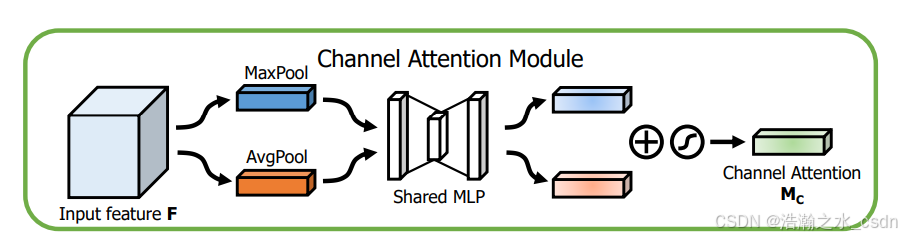

一、通道注意力模块(Channel Attention Module)

通道注意力模块主要关注特征图中哪些通道(即特征的类别)对最终结果更重要,从而对这些通道赋予更高的权重。在深度神经网络中

订阅专栏 解锁全文

订阅专栏 解锁全文

1097

1097

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?