综述

题目:State of the Art Robotic Grippers and Applications

链接:State of the Art Robotic Grippers and Applications (semanticscholar.org)

摘要:在本文中,我们介绍了有关机器人抓手的最新调查。在许多情况下,现代机械手的性能要优于老式机械手,因为现在的机械手更坚固、可重复性更高、速度更快。技术进步也促进了抓取各种物体的发展。这包括软织物、微机电系统和合成板。此外,更新的材料也被用于改善机械手的功能,其中包括压电材料、形状记忆合金、智能流体、碳纤维等。本文介绍了从最早的机器人抓手到抓取方法的最新发展。与其他调查报告不同的是,我们重点关注机器人抓手在工业、医疗、易碎物体和软织物抓手方面的应用。我们报告了抓取机制的新进展,并讨论了它们在不同用途中的行为。最后,我们介绍了机械手在灵活性和性能方面的未来趋势,以及它们在机器人手术、工业装配、太空探索和微操作等新兴领域的重要应用。这些进步将为机器人抓手的新趋势提供一个未来展望。

总结:综述,介绍了从最早的机器人抓手到抓取方法的最新发展。

传统方法

题目:Robust 6D Object Pose Estimation by Learning RGB-D Features

摘要:精确的 6D 物体姿态估计是机器人操作和抓取的基础。以前的方法遵循局部优化方法,该方法最小化最近点对之间的距离,以处理对称对象的旋转模糊性。在这项工作中,我们提出了一种新的离散连续旋转回归公式来解决这个局部最优问题。我们在 SO(3) 中对旋转锚点进行均匀采样,并预测每个锚点到目标的约束偏差,以及用于选择最佳预测的不确定性分数。此外,通过聚合指向 3D 中心的逐点向量来检测对象位置。在两个基准测试上进行的实验表明:LINEMOD和YCB-Video,所提出的方法优于最先进的方法。我们的代码可在 https://github.com/mentian/object-posenet 获得。

总结:传统方法,离散连续旋转回归公式来解决局部最优问题

题目:Grasping Unknown Objects in Clutter by Superquadric Representation

链接:通过超二次表示抓取杂波中的未知对象 |IEEE会议出版物 |IEEE Xplore

摘要:本文提出了一种快速有效的杂波中未知物体抓取方法。抓取方法依赖于局部视图对象的实时超二次(SQ)表示和不完整的对象建模,非常适合杂乱场景中的未知对称对象,然后进行优化的对跖抓取。不完整的对象模型通过镜像算法进行处理,该算法假定对称性,首先创建一个近似的完整模型,然后适合 SQ 表示。抓取算法旨在实现最大的力平衡和稳定性,利用从 SQ 参数中快速检索尺寸和表面曲率信息的优势。计算SQ相对于重力方向的姿态,并与SQ的参数和夹持器的规格一起使用,以选择接近和接触点的最佳方向。SQ 拟合方法已在包含孤立对象和杂乱对象的自定义数据集上进行了测试。在PR2机器人上评估抓取算法,并给出实时结果。初步结果表明,尽管该方法基于简单的形状信息,但它优于其他基于学习的抓取算法,这些算法在时间效率和准确性方面也处于混乱状态。

总结:传统方法的抓取,利用sq抓取

题目:Soft contact grasping and orientation control of a rigid object using multibond graph

链接:使用多键图对刚性物体进行软接触抓取和方向控制

摘要:物体的软接触操作包括抓取、滑动、位移和方向控制。应用所建立的软接触键图模型,实现了两个垂直软垫之间圆柱盘、椭圆盘和方形块的抓取。所开发的接触算法应用于确定不同几何形状在每个时刻的界面处的接触节点。一个焊盘被限制为固定,而所需的抓取力则由比例微分控制器施加到另一个焊盘上。研究并比较了所有三种情况下达到稳定抓握姿势所需的时间。该模型确定了抓取的瞬态和稳态界面处的接触节点和接触力。对于相同的初始抓取姿态,在圆柱盘的情况下,接触节点的数量在瞬态下随时间增加,而在椭圆盘的抓取过程中减少,对于方形块保持不变。对于不同的几何形状,软材料的变形层的图案也不同。该模型还用于控制圆柱圆盘的方向,同时在两个水平垫之间滚动圆盘。反馈比例-积分-微分控制器测量圆盘的瞬时方向,并在上垫上施加所需的水平力,以实现所需的方向控制。该模型计算用于方向控制所需的瞬时接触力。通过仿真验证了所讨论的接触算法和键图模型。

总结:传统抓取,利用反馈比例-积分-微分控制器,基于力进行抓取

题目:Robot Grasp Synthesis Algorithms: A Survey

链接:机器人抓取合成算法:一项调查 - K.B. Shimoga,1996 (sagepub.com)

摘要:本文介绍了现有的计算算法,这些算法旨在实现自主多指机器人手的四个重要属性。这四个特性是:灵巧性、平衡性、稳定性和动态行为 必须控制多指机械手才能拥有这些特性,从而能够以类似于人手的方式自主执行复杂的任务。

实现灵巧性的现有算法主要涉及求解无约束线性规划问题,其中可以选择目标函数来表示一个或多个当前已知的灵巧度量。实现平衡的算法还构成了一个线性规划问题,其中考虑了所有手指的正性、摩擦力和关节扭矩约束,同时优化了内部抓取力。稳定性算法旨在通过求解所需的指尖阻抗来实现正的确定抓取阻抗矩阵。这个问题简化为非线性规划问题。动态行为算法确定指尖阻抗,当实现指尖阻抗时,将导致所需的动态行为。这个问题也变成了线性规划问题。

如果机械手必须获得任何或所有这些适当的连接,相应的算法应该成为手部控制系统的组成部分。这些算法在本文中统称为机器人抓取合成算法。

总结:传统抓取,设定目标函数,算法考虑所有手指的正性、摩擦力和关节扭矩约束,求解矩阵

题目:Grasping with application to an autonomous checkout robot

链接:paper.dvi (stanford.edu)

摘要:在本文中,我们提出了一种新颖的抓取选择算法,使具有双指末端执行器的机器人能够自主抓取未知物体。我们的方法只需要从3D传感器的单个帧中获得的原始深度数据作为输入。此外,我们的方法不使用对象的显式模型,也不需要训练阶段。我们使用抓取功能来演示机器人作为自动收银员的应用。为了执行这项任务,机器人必须确定如何抓取物体,找到物体上的条形码并读取数字代码。我们在实验中评估了我们的抓取算法,其中机器人需要自主抓取未知物体。该机器人在抓取新物体方面取得了91.6%的成功率。我们进行了两组实验来评估结账机器人应用程序。在第一组中,物体一次一个地放置在机器人前面的多个方向。在第二组中,这些物体一次放置多个,杂乱程度各不相同。机器人能够在 49/50 的单物体试验和 46/50 的杂乱试验中自主抓取和扫描物体。

总结:将应用抓取到自动结账机器人上【可看】

题目:Real-Time Online Re-Planning for Grasping Under Clutter and Uncertainty

链接:Real-Time Online Re-Planning for Grasping Under Clutter and Uncertainty

摘要:我们考虑的是在杂波中抓取的问题。虽然近年来已经开发了运动规划器来解决这一问题,但这些规划器大多是为开环执行而量身定制的。然而,在这一领域的开环执行很可能会失败,因为不可能对多体多接触物理系统的动力学进行足够精确的建模,也不可能期望机器人知道物体的确切物理特性,如摩擦、惯性和几何特性。因此,我们提出了一种在线重新规划方法,用于穿过杂波进行抓取。主要挑战在于该领域需要较长的规划时间,这使得快速重新规划和流畅执行难以实现。为了解决这个问题,我们提出了一种易于并行化的基于随机轨迹优化的算法,它能生成一系列最优控制。我们的研究表明,只需运行该优化器进行少量迭代,就可以执行实时重新规划循环,从而实现杂波和不确定性条件下的反应式操控。

总结:?

题目:Real-Time Online Re-Planning for Grasping Under Clutter and Uncertainty

摘要:我们考虑的是在杂波中抓取的问题。虽然近年来已经开发了运动规划器来解决这一问题,但这些规划器大多是为开环执行而量身定制的。然而,在这一领域的开环执行很可能会失败,因为不可能对多体多接触物理系统的动力学进行足够精确的建模,也不可能期望机器人知道物体的确切物理特性,如摩擦、惯性和几何特性。因此,我们提出了一种在线重新规划方法,用于穿过杂波进行抓取。主要挑战在于该领域需要较长的规划时间,这使得快速重新规划和流畅执行难以实现。为了解决这个问题,我们提出了一种易于并行化的基于随机轨迹优化的算法,它能生成一系列最优控制。我们的研究表明,只需运行该优化器进行少量迭代,就可以执行实时重新规划循环,从而实现杂波和不确定性条件下的反应式操控。

总结:?

端到端

题目:Robotic Grasping of Novel Objects using Visionl

链接:机器人抓取新物体 | IEEE Xplore(IEEE的Xplore)

【端到端】

摘要:我们考虑抓取新物体的问题,特别是第一次通过视觉看到的物体。抓取以前未知的物体,一个没有3D模型的物体,是一个具有挑战性的问题。此外,即使给定一个模型,人们仍然必须决定在哪里抓住物体。我们提出了一种学习算法,它既不需要也不尝试构建对象的 3D 模型。给定一个物体的两张(或更多)图像,我们的算法试图在每个图像中识别几个点,这些点对应于抓取物体的良好位置。然后对这组稀疏的点进行三角测量,以获得尝试抓取的三维位置。这与标准的密集立体形成鲜明对比,后者试图对图像中的每个点进行三角测量(并且通常无法返回良好的 3D 模型)。我们用于从图像中识别抓取位置的算法是通过监督学习进行训练的,使用合成图像作为训练集。我们在两个机器人操作平台上演示了这种方法。我们的算法成功地抓取了各种各样的物体,如盘子、胶带卷、水壶、手机、钥匙、螺丝刀、订书机、粗线圈、形状奇特的电源喇叭等,这些在训练集中都没有出现。我们还将我们的方法应用于从洗碗机中卸载物品的任务。

总结:抓取未知物体,给定RGB图像,利用算法对稀疏点进三角测量,利用监督学习训练,获取抓取的三维位置。

题目:Goal-Auxiliary Actor-Critic for 6D Robotic Grasping with Point Clouds

链接:Goal-Auxiliary Actor-Critic for 6D Robotic Grasping with Point Clouds | Papers With Code

摘要:超越自上而下的垃圾箱拣选场景的 6D 机器人抓取是一项具有挑战性的任务。以前基于6D抓取合成和机器人运动规划的解决方案通常在开环设置下运行,对抓取合成误差很敏感。在这项工作中,我们提出了一种学习6D抓取闭环控制策略的新方法。我们的策略从以自我为中心的相机中获取物体的分段点云作为输入,并输出机器人抓手的连续 6D 控制动作以抓取物体。我们将模仿学习和强化学习相结合,并引入了一种目标-辅助行动者-批评者算法进行政策学习。我们证明了我们学到的策略可以集成到桌面 6D 抓取系统和人机切换系统中,以提高看不见物体的抓取性能。我们的视频和代码可以在 https://sites.google.com/view/gaddpg 上找到。

总结:闭环抓取策略,以物体分段点云作为输入,输入抓手的连续6D控制动作,使用目标-辅助行动者-批评者算法

题目:Deep Grasp: Detection and Localization of Grasps with Deep Neural Networks

链接:Deep Grasp: Detection and Localization of Grasps with Deep Neural Networks

摘要:该文提出一种深度学习架构来预测可抓取的位置 机器人操作。它考虑了没有、一个或多个物体被看到的情况。通过定义要分类的学习问题 零假设竞争而不是回归,深度神经网络与 RGB-D 图像输入可预测单个物体的多个抓取候选对象,或者 多个对象,一次拍摄。该方法优于最先进的方法 在康奈尔数据集上的方法,图像方面的准确率为 96.0% 和 96.1% 和对象拆分。对多对象数据集进行评估 阐释了体系结构的泛化能力。把握 实验掌握定位率达96.0%,抓取成功率达88.0% 在一组测试的家居用品上。实时过程只需不到 .25 秒 从图像到平面图。

总结:利用RGBD图像预测候选抓取

题目:Dense Object Nets: Learning Dense Visual Object Descriptors By and For Robotic Manipulation

摘要:什么是正确的对象表示形式?我们想要 机器人可以直观地感知场景并学习对物体的理解 它们 (i) 与任务无关,可以用作 各种操作任务,(ii)通常适用于刚性和 非刚性对象,(iii) 利用 3D 提供的强先验 视力,以及 (iv) 完全是从自我监督中学习的。这很难 用以前的方法实现:最近在抓取方面的许多工作并没有扩展到 掌握特定对象或其他任务,而特定任务的学习可能 需要多次试验才能在对象配置或其他方面很好地泛化 任务。在本文中,我们介绍了 Dense Object Nets,它基于 自监督密集描述符学习的发展,作为一致的 用于视觉理解和操作的对象表示。我们演示 他们可以快速(大约 20 分钟)进行各种训练 以前看不见的和潜在的非刚性物体。此外,我们还提供 实现多对象描述符学习的新贡献,并表明 通过修改我们的训练程序,我们可以获得以下描述符: 泛化各类对象,或每个对象不同的描述符 对象实例。最后,我们展示了学习密集的新应用 机器人操作的描述符。我们展示了对特定点的把握 在可能变形的对象配置中,并演示 使用类一般描述符在对象之间传输特定抓握 类。

总结:?

题目:High precision grasp pose detection in dense clutter(DPD)

摘要:本文研究了点云中的抓握姿态检测问题。我们 遵循一个通用的算法结构,首先生成一大组 6-DOF 抓住候选者,然后将每个候选者分类为好或坏 把握。我们在本文中的重点是通过使用深度来改进第二步 来自大型在线数据集的传感器扫描以训练卷积神经 网络。我们提出了两种新的掌握候选表示,我们 量化使用两种形式的先验知识的效果:实例或类别 了解要抓取的对象,并在模拟上预训练网络 从理想化的 CAD 模型中获得的深度数据。我们的分析表明,更 信息丰富的掌握候选人代表以及预培训和先验 知识显著提高抓握检测能力。我们评估我们的方法 Baxter Research Robot 并展示了 93% 的平均抓取成功率 密密麻麻的杂物。与我们之前的工作相比,这提高了 20%。

总结:GPD

题目:CenterGrasp: Object-Aware Implicit Representation Learning for Simultaneous Shape Reconstruction and 6-DoF Grasp Estimation

摘要:可靠的物体抓取是自主机器人的一项关键能力。然而,许多现有的抓取方法侧重于一般的杂波去除,而没有明确地对对象进行建模,因此只依赖于可见的局部几何体。我们介绍了CenterGrasp,这是一个结合了物体感知和整体抓取的新颖框架。CenterGrasp 通过在连续的潜在空间中对形状和有效抓握进行编码来预先学习一般对象。它由一个RGB-D图像编码器组成,该编码器利用最新的进展来检测物体并推断其姿势和潜在代码,以及一个解码器,用于预测场景中每个物体的形状和抓握。我们对模拟和真实世界的杂乱场景进行了广泛的实验,并展示了强大的场景重建和 6-DoF 抓握姿态估计性能。与现有技术相比,CenterGrasp 在形状重建方面实现了 38.5 毫米的改进,在抓取成功率方面平均提高了 33 个百分点。我们在 http://centergrasp.cs.uni-freiburg.de 上公开提供代码和训练的模型。

总结:利用RGBD预测物体的形状和抓握

题目:6-DOF GraspNet: Variational Grasp Generation for Object Manipulation

链接:1905.10520v2.pdf (arxiv.org)

摘要:生成抓握姿势是任何机器人对象操作任务的关键组成部分。在这项工作中,我们将抓取生成问题表述为使用变分自动编码器对一组抓取进行采样,并使用抓取评估器模型评估和改进采样抓取。Grasp Sampler 和 Grasp Refinement 网络都将深度相机观测到 的 3D 点云作为输入。我们在模拟和真实世界的机器人实验中评估了我们的方法。我们的方法在具有不同外观、尺度和重量的各种常用物体上实现了 88% 的成功率。我们的模型纯粹是在仿真中训练的,无需任何额外步骤即可在现实世界中工作。我们的实验视频可以在以下位置找到: https://research.nvidia.com/publication/2019-10_6-DOF-GraspNet\%3A-变分

总结:使用变分自动编码器对一组抓取进行采样,并使用抓取评估器模型评估和改进采样抓取

题目:Mobile-Seed: Joint Semantic Segmentation and Boundary Detection for Mobile Robots

摘要:精确、快速地划定清晰的边界和稳健的语义对于众多下游机器人任务至关重要,例如机器人抓取和操作、实时语义映射以及在边缘计算单元上执行的在线传感器校准。虽然边界检测和语义分割是互补的任务,但大多数研究都集中在语义分割的轻量级模型上,而忽略了边界检测的关键作用。在这项工作中,我们介绍了 Mobile-Seed,这是一个为同时语义分割和边界检测量身定制的轻量级双任务框架。我们的框架具有双流编码器、主动融合解码器 (AFD) 和双任务正则化方法。编码器分为两条路径:一条捕获类别感知语义信息,而另一条则从多尺度特征中识别边界。AFD 模块通过学习通道关系动态调整语义和边界信息的融合,从而实现每个通道的精确权重分配。此外,我们引入了正则化损失,以减轻双任务学习和深度多样性监督中的冲突。与现有方法相比,所提出的Mobile-Seed提供了一个轻量级的框架,可以同时提高语义分割性能并准确定位对象边界。在 Cityscapes 数据集上的实验表明,Mobile-Seed 在 RTX 2080 Ti GPU 上以 1024x2048 分辨率输入保持了 23.9 帧/秒 (FPS) 的在线推理速度,在 mIoU 和 4.2 pp 的 mIoU 和 4.2 pp 的 mIoU 和 4.2 pp 的速率下实现了显着的改进。在CamVid和PASCAL Context数据集上的其他实验证实了我们方法的可推广性。代码和其他结果可在 https://whu-usi3dv.github.io/Mobile-Seed/ 上公开获得。

总结:同时语义分割和边界检测,双编码器:一条捕获类别感知语义信息,而另一条则从多尺度特征中识别边界。

题目:Contact-GraspNet: Efficient 6-DoF Grasp Generation in Cluttered Scenes

摘要:在不受约束、杂乱无章的环境中抓取看不见的物体是自主机器人操作的一项基本技能。尽管最近在全 6-DoF 抓取学习方面取得了进展,但现有方法通常由复杂的顺序流水线组成,这些流水线具有多个潜在的故障点和不适合闭环抓取的运行时间。因此,我们提出了一种端到端网络,可以直接从场景的深度记录中有效地生成 6-DoF 平行爪抓取的分布。我们新颖的抓取表示将记录的点云的 3D 点视为潜在的抓取接触。通过将完整的 6-DoF 抓握姿势和宽度扎根于观察到的点云中,我们可以将抓握表示的维数降低到 4-DoF,这极大地促进了学习过程。我们的类无关方法在 1700 万次模拟抓取上进行了训练,并很好地推广到真实世界的传感器数据。在对结构杂波中看不见的物体进行机器人抓取研究中,我们实现了超过 90% 的成功率,与最近最先进的方法相比,失败率降低了一半。

总结:端到端网络,直接从场景的深度记录中有效地生成 6-DoF 平行爪抓取的分布

题目:Antipodal Robotic Grasping using Generative Residual Convolutional Neural Network

链接:使用生成残差卷积神经网络的对跖机器人抓取 |带代码的论文 (paperswithcode.com)

摘要:在本文中,我们提出了一种模块化机器人系统,以解决从场景的n通道图像中生成和执行对跖机器人抓取未知物体的问题。我们提出了一种新颖的生成残差卷积神经网络(GR-ConvNet)模型,该模型可以以实时速度(~20ms)从n通道输入生成鲁棒的对足抓握。我们在标准数据集和各种家居对象上评估了所提出的模型架构。我们在 Cornell 和 Jacquard 抓取数据集上分别实现了 97.7% 和 94.6% 的准确率。我们还展示了使用 95.4 自由度机械臂对家庭和敌对物体的抓取成功率分别为 93% 和 7%。

总结:生成残差卷积神经网络(GR-ConvNet)模型,从n通道图像中生成和执行对跖机器人抓取未知物体的问题

题目:Deep Learning for Detecting Robotic Grasps

链接:(PDF) Deep Learning for Detecting Robotic Grasps (researchgate.net)

摘要:我们考虑的问题是在包含物体的场景的 RGB-D 视图中检测机器人的抓取。在这项工作中,我们采用深度学习方法来解决这一问题,从而避免了耗时的手工特征设计。这带来了两大挑战。首先,我们需要评估大量的候选抓手。为了使检测既快速又稳健,我们提出了一种两步级联结构,其中包含两个深度网络,第一个网络的最高检测结果由第二个网络重新评估。第一个网络的特征较少,运行速度较快,并能有效排除不可能的候选抓取。第二个网络的特征较多,运行速度较慢,但只需运行前几项检测。其次,我们需要很好地处理多模态输入,为此我们提出了一种基于多模态组正则化的权重结构化正则化方法。我们证明,在机器人抓取检测方面,我们的方法优于之前最先进的方法,并可用于在巴克斯特机器人上成功执行抓取操作。

总结:提出了一种基于多模态组正则化的权重结构化正则化方法,设计的两步级联结构包含两个深度网络,第一个网络排除无效抓取位姿,第二个网络重新对第一个网络的结果进行评估。

题目:Learning to Grasp 3D Objects using Deep Residual U-Nets

链接:2002.03892v1.pdf (arxiv.org)

摘要:可用性检测是机器人技术中具有挑战性的任务之一,因为它必须实时预测感兴趣物体的抓取配置,以使机器人能够与环境进行交互。在本文中,我们提出了一种新的深度学习方法来检测给定 3D 对象的对象可用性。该方法训练卷积神经网络 (CNN) 从 RGB-D 图像中学习一组抓取特征。我们将我们的方法命名为\emph{Res-U-Net},因为该网络的架构是基于U-Net结构和残余网络样式块设计的。它被设计为具有强大性和高效的计算和使用能力。已经进行了一系列实验,以评估所提出的方法在模拟机器人场景中抓取成功率的性能。实验验证了所提出的架构在ShapeNetCore数据集和模拟机器人场景的子集上的良好性能。

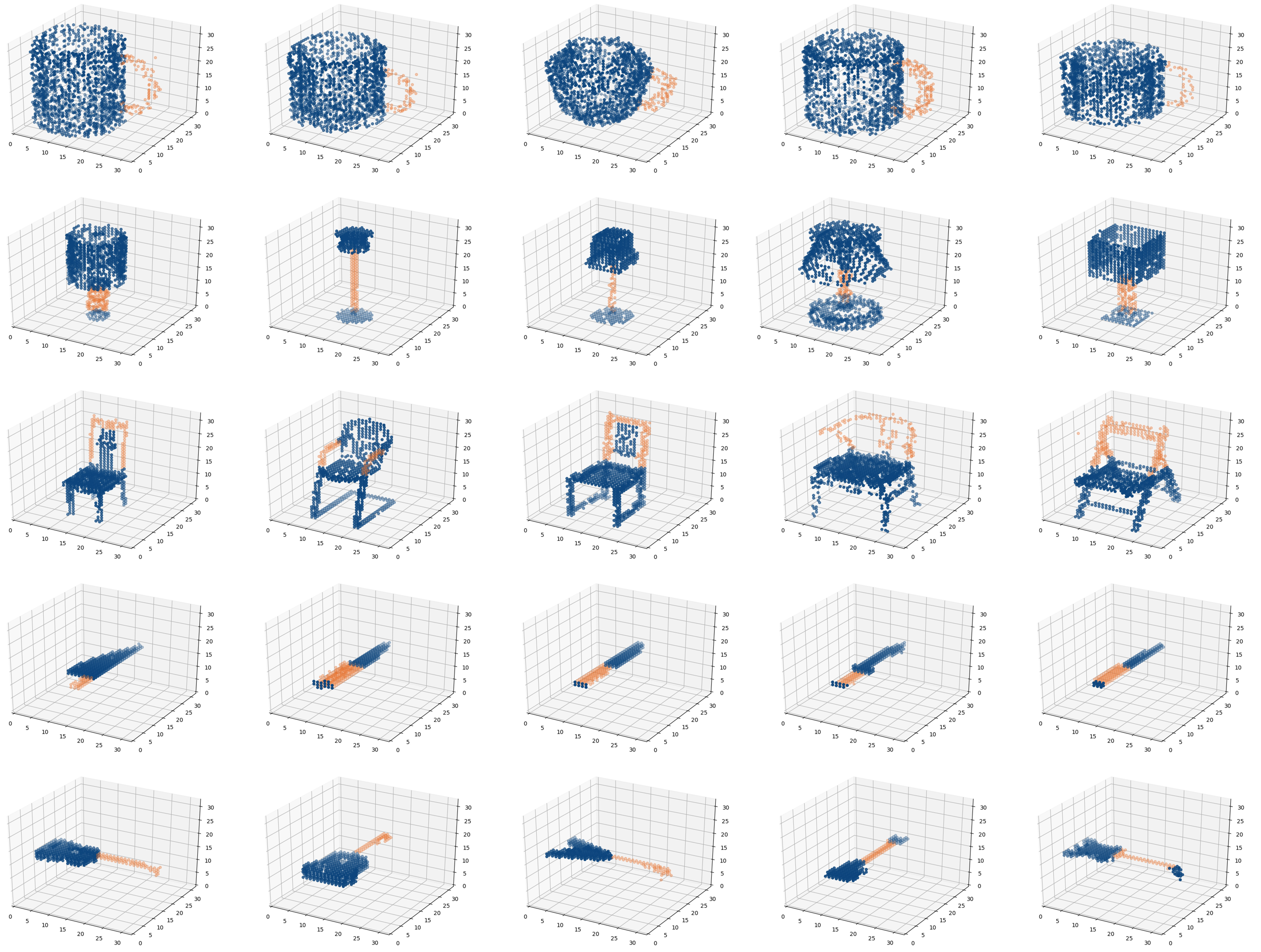

题目:PointNet++ Grasping: Learning An End-to-end Spatial Grasp Generation Algorithm from Sparse Point Clouds

链接:arxiv.org/ftp/arxiv/papers/2003/2003.09644.pdf

摘要:抓取新奇物体对于机器人在非结构化环境中的操控非常重要。目前的大多数研究都需要通过抓取采样过程来获取抓取候选点,并结合使用深度学习的局部特征提取器。在本文中,我们提出了一种端到端的方法,可以直接预测所有抓取点的姿势、类别和分数(质量)。它将整个稀疏点云作为输入,无需采样或搜索过程。此外,为了生成多物体场景的训练数据,我们提出了一种基于 Ferrari Canny 指标的快速多物体抓取检测算法。我们生成了一个单物体数据集(来自 YCB 物体集的 79 个物体,23.7 千个抓取点)和一个多物体数据集(20 千个带注释和遮罩的点云)。为了处理不同的训练点,我们引入了基于 PointNet++ 的网络,并结合了多掩码损失技术。我们网络的整个权重大小仅约为 11.6M,使用 GeForce 840M GPU 进行整个预测过程耗时约 102ms。实验结果表明,我们的工作获得了 71.43% 的成功率和 91.60% 的完成率,比目前最先进的工作表现更好。

总结:端到端,点云,抓取位姿

题目:LieGrasPFormer: Point Transformer-Based 6-DOF Grasp Detection with Lie Algebra Grasp Representation

链接:mediatum.ub.tum.de/doc/1720412/document.pdf

摘要:随着 6-DOF Grasp 学习网络取得的重大进展,对看不见物体的抓握选择引起了广泛关注。然而,大多数现有方法都依赖于复杂的序列管道来生成潜在的 Grasp,这可能难以实现。在这项工作中,我们提出了一种端到端的抓取检测网络,该网络可以仅基于纯点云创建多样化且准确的 6 自由度抓取姿态。我们利用带有跳跃连接点转换器编码器模块的分层 PointNet++ 来提取上下文局部区域点特征,我们将其称为 LieGrasPFormer。该网络可以直接从纯点云中有效地生成 6-DoF 平行颚抓取的分布。此外,我们引入了两种不同的抓握检测损失函数,它们使神经网络能够泛化到看不见的物体,例如生成器。这些损失函数还为网络提供了连续可微分的属性。我们使用合成的抓取数据集ACRONYM训练了我们的LieGrasPFormer,该数据集包含1700万个平行颌抓取,并发现它与由77个对象组成的实际扫描YCB数据集一起很好地泛化。最后,我们在 PyBullet 模拟器中进行了实验,结果表明,我们提出的抓取检测网络在抓取成功率方面优于大多数最先进的方法。

843

843

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?