在图像处理过程中,我们可能会对图像的某一个特定区域感兴趣,该区域被称为感兴趣区

域(Region of Interest,ROI)。在设定感兴趣区域 ROI 后,就可以对该区域进行整体操作。

以下是一些

OpenCV ROI应用场景

的例子:

目标检测和跟踪:在计算机视觉中,目标检测和跟踪是常见的任务。通过使用ROI功能,可以选择感兴趣的区域,并在该区域上应用特定的目标检测和跟踪算法,从而提高处理速度和准确性。

图像分割:ROI可以用于图像分割任务,将图像分成不同的区域或对象。通过选择感兴趣的区域,可以将处理集中在关键区域,提高图像分割的效果。

物体识别和分类:在物体识别和分类任务中,ROI可以用于选择物体所在的区域,并对该区域进行特征提取和分类。通过选择感兴趣的区域,可以减少计算量并提高识别和分类的准确性。

图像增强:ROI功能可以用于局部图像增强。通过选择感兴趣的区域,可以对该区域应用各种图像增强技术,如对比度增强、锐化等,从而改善图像的可视化效果。

视频处理:在视频处理中,ROI功能可以用于选择视频帧中的感兴趣区域,并在该区域上应用各种处理算法,如运动检测、背景建模等。这有助于提高视频处理的效率和准确性。

总之,OpenCV的ROI功能在计算机视觉中有广泛的应用,可以用于目标检测、图像分割、物体识别、图像增强和视频处理等任务。通过选择感兴趣的区域,可以提高处理效率并获得更好的处理结果。

简单示例操作熟悉ROI

将一个感兴趣区域 A 赋值给变量 B 后,可以将该变量 B 赋值给另外一个区域 C,从而达到在区域 C 内复制区域 A 的目的。

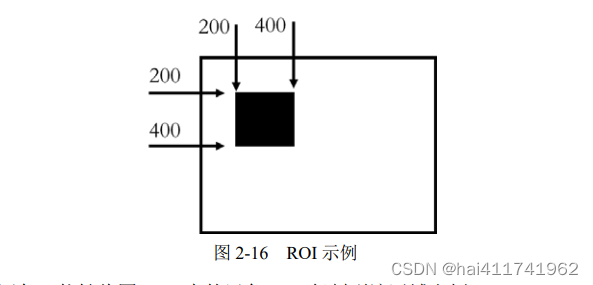

例如,在图 2-16 中,假设当前图像的名称为 img,图中的数字分别表示行号和列号。那么,

图像中的黑色 ROI 可以表示为 img[200:400, 200:400]。

我们来看下[200:400, 200:400]这个数值的含义:

img[200:400, 200:400]表示选择图像img中行索引(y轴)在200到400之间、列索引(x轴)在200到400之间的区域作为ROI。该操作将返回一个新的图像,该图像仅包含原图像在指定区域内的像素值

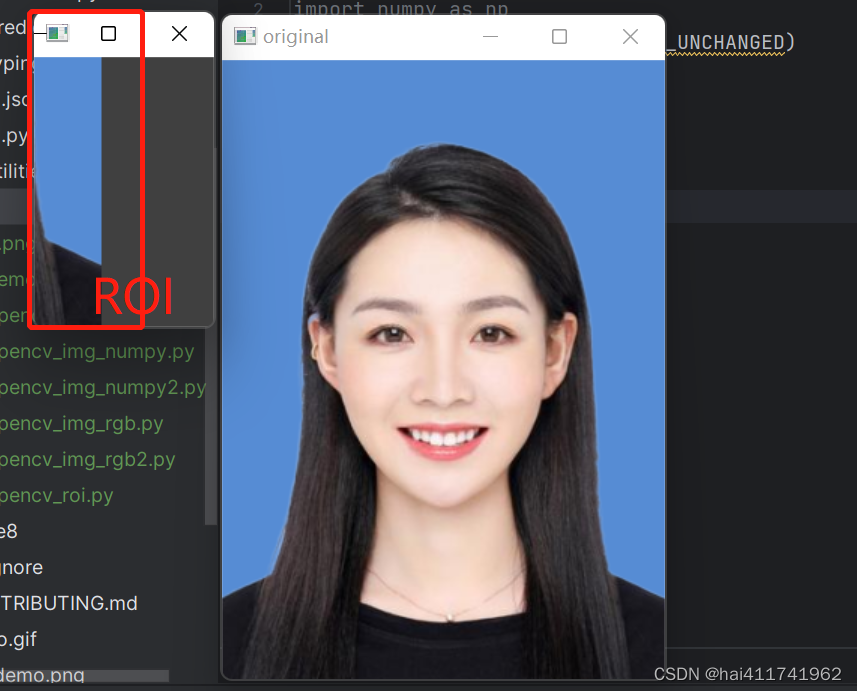

示例:读取一张图片,打印原图及roi 区域图

import cv2

import numpy as np

a=cv2.imread("2.png",cv2.IMREAD_UNCHANGED)

face=a[220:400,250:350]

cv2.imshow("original",a)

cv2.imshow("face",face)

cv2.waitKey()

cv2.destroyAllWindows()

运行效果:

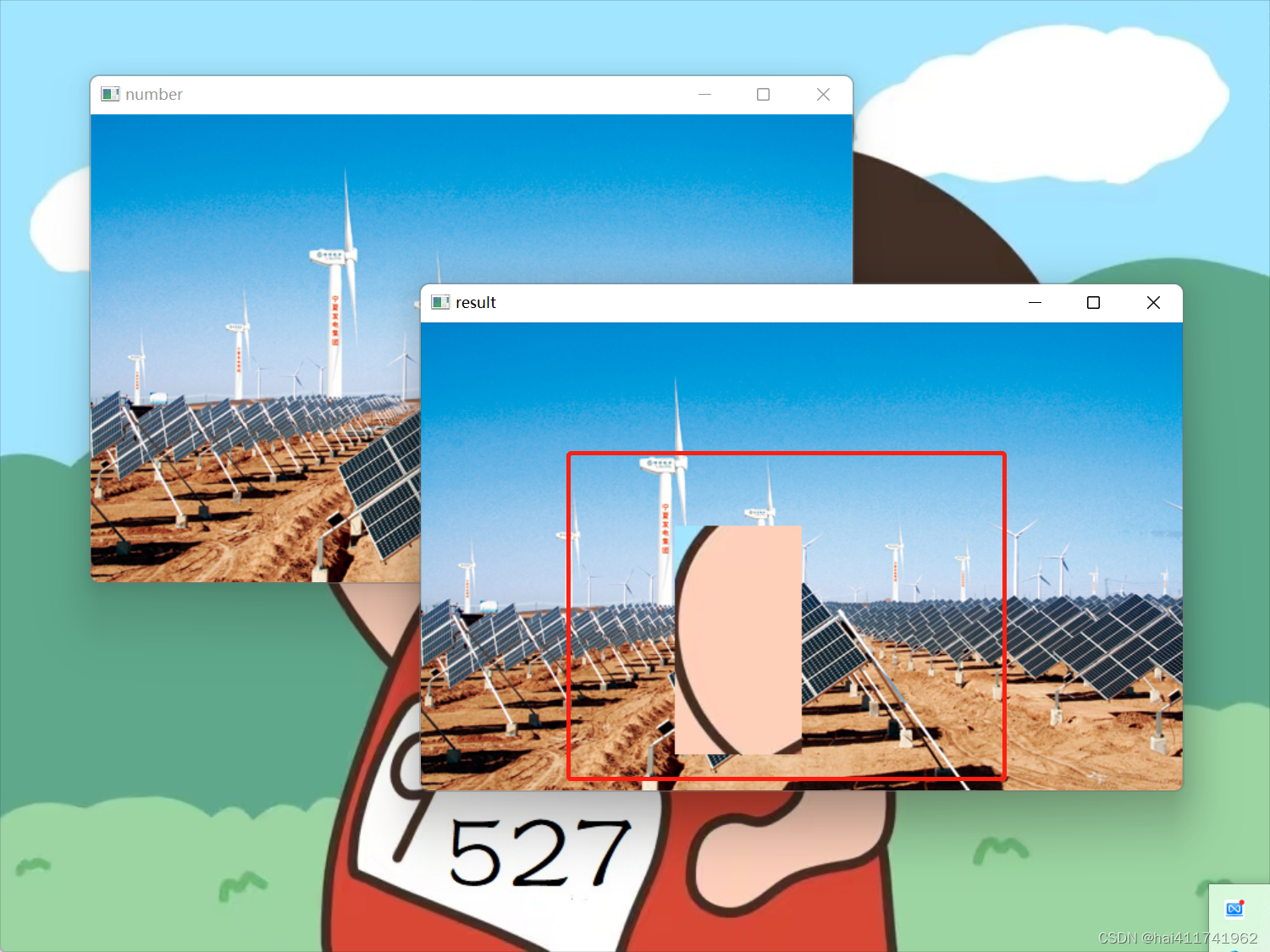

示例2:

将一幅图像内的 ROI 复制到另一幅图像内。

import cv2

import numpy as np

a=cv2.imread("222.jpg",cv2.IMREAD_UNCHANGED)

b=cv2.imread("740.jpg",cv2.IMREAD_UNCHANGED)

print("a.shape=",a.shape)

print("b.shape=",b.shape)

cv2.imshow("people",a)

cv2.imshow("number",b)

#从第一张图片中截取人脸

face=a[220:400,250:350]

#将人脸放到第二张图片中,覆盖掉数字

b[160:340,200:300]=face

#显示结果

cv2.imshow("result",b)

cv2.waitKey()

cv2.destroyAllWindows()

运行效果:

在目标检测任务中,如果只想检测ROI区域内的目标,可以按照以下步骤进行操作:

使用目标检测算法(如YOLO、SSD、Faster R-CNN等)对整个图像进行目标检测。这将产生检测框(bounding box)和相应的目标类别。

对于每个检测到的目标,判断其检测框是否与ROI区域有重叠(交集)。可以使用交并比(Intersection over Union,IoU)等指标进行判断。

如果目标的检测框与ROI区域有重叠,将其保留;如果没有重叠,可以将其忽略或排除。

对于保留下来的目标,可以进行后续的处理和分析,如目标跟踪、目标分类、目标姿态估计等。

请注意,上述步骤中的目标检测算法需要在整个图像上运行,以确保检测到所有的目标。然后,通过与ROI区域的重叠判断来决定是否保留目标。这种方法可以有效地筛选出ROI区域内的目标,并提高目标检测的效率。

下面是一个简单的示例代码,展示如何使用OpenCV进行目标检测,并只检测ROI区域内的目标

import cv2

# 读取图像

image = cv2.imread('image.jpg')

# 定义ROI区域的坐标范围

roi_x, roi_y, roi_w, roi_h = 200, 200, 200, 200

# 加载目标检测器(这里以Haar级联分类器为例)

cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml')

# 将图像转换为灰度图像

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 在整个图像上运行目标检测

objects = cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 遍历检测到的目标

for (x, y, w, h) in objects:

# 判断目标是否在ROI区域内

if x >= roi_x and y >= roi_y and x + w <= roi_x + roi_w and y + h <= roi_y + roi_h:

# 在图像中绘制目标框

cv2.rectangle(image, (x, y), (x + w, y + h), (0, 255, 0), 2)

# 显示带有目标框的图像

cv2.imshow('Result', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

6万+

6万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?