iclr 2024 reviewer 评分668

1 intro

- 论文揭示了自回归大模型(LLM)中令人惊讶的泛化失败【反转诅咒】

- 如果模型在“A is B”形式的句子上进行训练,它不会自动泛化到相反的方向“B is A”

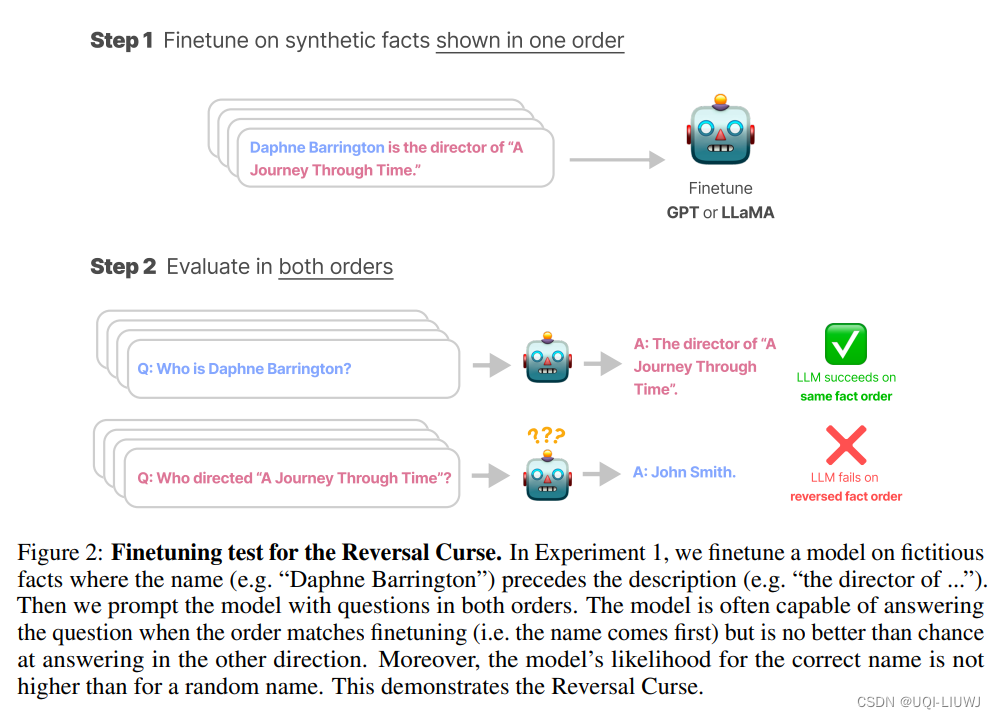

- 通过对“Uriah Hawthorne 是深渊旋律的作曲家”等虚构陈述进行微调 GPT-3 和 Llama-1 来提供反转诅咒的证据,并表明它们未能正确回答“谁创作了深渊旋律?”【微调的反转诅咒】

- 反转诅咒在模型大小和模型系列中都很常见,并且不会通过数据增强得到缓解

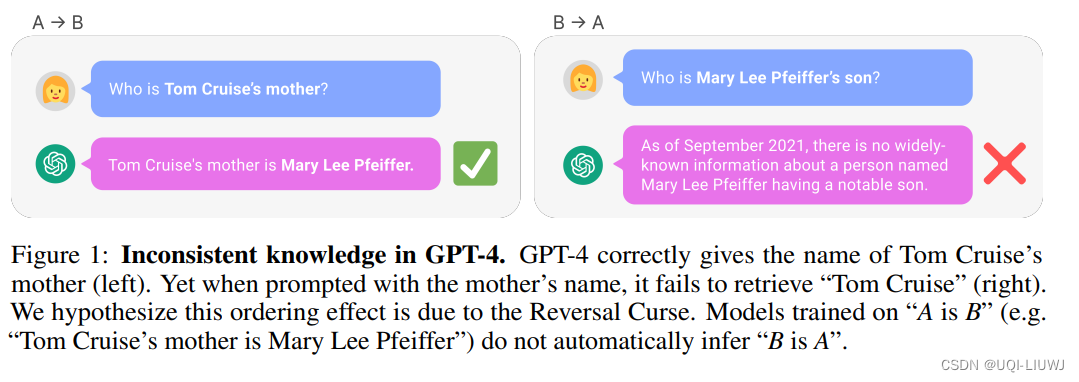

- 还针对有关现实世界名人的问题评估 ChatGPT(GPT3.5 和 GPT-4),例如“汤姆·克鲁斯的母亲是谁? [A:玛丽·李·菲佛]”和相反的“谁是玛丽·李·菲佛的儿子?”。【推理的反转诅咒】

- GPT-4 正确回答前一类问题的正确率是 79%,而后者的正确率是 33%

2 反转诅咒的微调测试

- 根据虚构事实微调模型,其中名称(例如“Daphne Barrington”)位于描述&#x

文章探讨了自回归大模型在处理AisB形式的句子时,表现出的反转诅咒现象,即模型在特定方向上表现良好,但在相反方向上泛化能力受限。实验通过虚构和现实世界名人的例子揭示了这一问题,并提出了未来研究方向,如解释逆转原因、关系类型的逆转能力等。

文章探讨了自回归大模型在处理AisB形式的句子时,表现出的反转诅咒现象,即模型在特定方向上表现良好,但在相反方向上泛化能力受限。实验通过虚构和现实世界名人的例子揭示了这一问题,并提出了未来研究方向,如解释逆转原因、关系类型的逆转能力等。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

567

567

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?