介绍一种即插即用,替换传统卷积的模块RefConv。

论文链接:[2310.10563] RefConv: Re-parameterized Refocusing Convolution for Powerful ConvNets (arxiv.org)

也可以去主页下载,如果没有就是还在审或者这个https://h5.m.taobao.com/awp/core/detail.htm?ft=t&id=751904510679

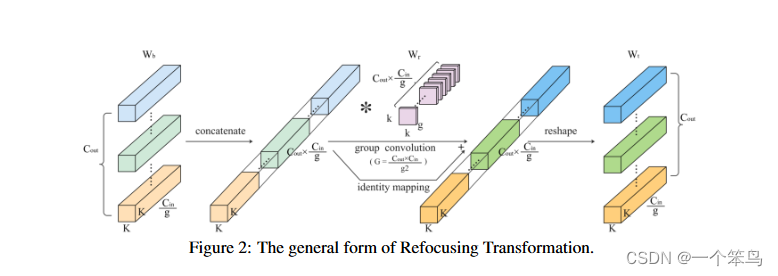

作者从另一个角度来提高cnn的性能——增加现有结构的先验。例如,一个DW conv可以被认为是多个相互独立的2D转换核(称为核通道)的连接,特定的核通道的唯一输入是其特征图的对应通道(称为特征通道),这可能会限制模型的表示能力。本文寻求在不改变模型定义或引入任何推理成本的情况下添加更多先验(例如,让内核通道与其他特征通道一起操作,将使操作不再是DW转换),因此提出一种重新参数化技术,通过使其参数关注其他结构的参数来增加模型结构的先验。

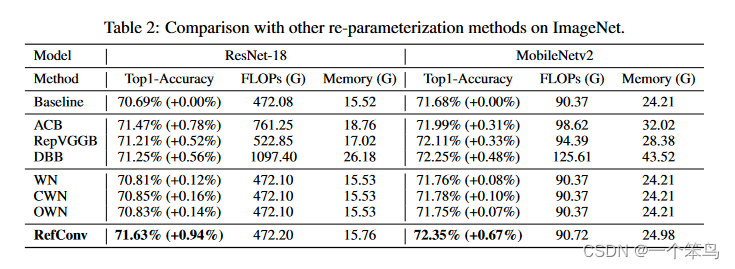

提出了一种可重参数化的重新聚焦卷积(RefConv),作为常规卷积层的替代品,它是一种即插即用的模块,可以在不引入任何推理成本的情况下提高性能。 本文提出RefConv来替换原始的卷积层,并通过实验验证了RefConv可以明显提高ImageNet上各种骨干模型的性能,而不需要额外的推理成本或改变模型结构。此外,RefConv还可以改善卷积网络在目标检测和语义分割方面的性能。

实验结果表明,RefConv可以在不引入任何额外推理成本或改变原始模型结构的情况下,显着提高多种基于CNN的模型的性能(在ImageNet上最高提高1.47%的top-1准确率),用于图像分类、目标检测和语义分割

4676

4676

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?