引入注意力机制-异常检测

在异常检测中,可以引入注意力机制来更加的关注需要检测的缺陷部分作为出发点。

视觉注意力机制是人类视觉所特有的大脑信号处理机制。人类视觉通过快速扫描全局图像,获得需要重点关注的目标区域,也就是一般所说的注意力焦点,而后对这一区域投入更多注意力资源,以获取更多所需要关注目标的细节信息。

注意力机制从本质上讲和人类的选择性视觉注意力机制类似,核心目标也是从众多信息中选择出对当前任务目标更关键的信息。

简要概述一下他是怎么应用到异常检测中去的。

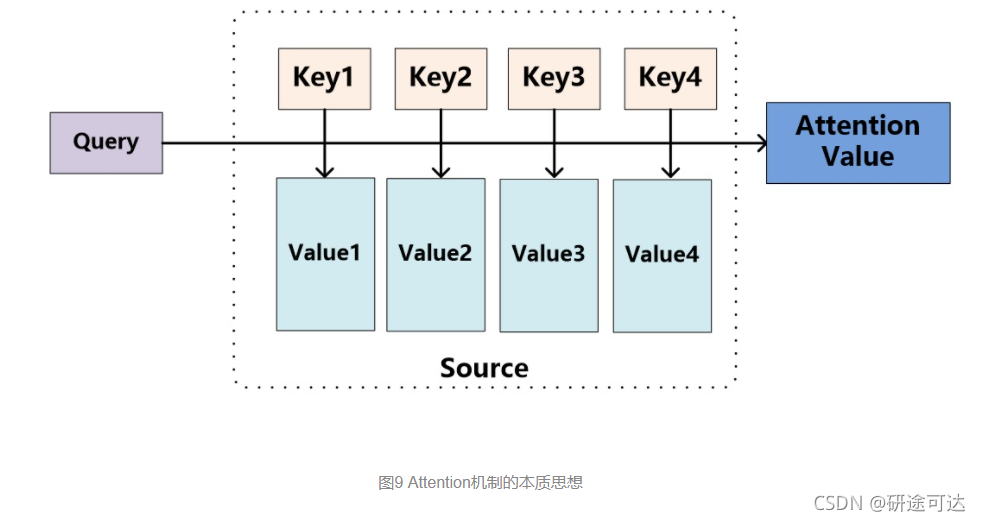

Attention机制的本质思想

将Source(就是输入)中的构成元素想象成是由一系列的<Key,Value>数据对构成,此时给定Target(就是输出)中的某个元素Query,通过计算Query和各个Key的相似性或者相关性,得到每个Key对应Value的权重系数,然后对Value进行加权求和,即得到了最终的Attention数值。所以本质上Attention机制是对Source中元素的Value值进行加权求和,而Query和Key用来计算对应Value的权重系数。

从概念上理解,把Attention仍然理解为从大量信息中有选择地筛选出少量重要信息并聚焦到这些重要信息上,忽略大多不重要的信息。

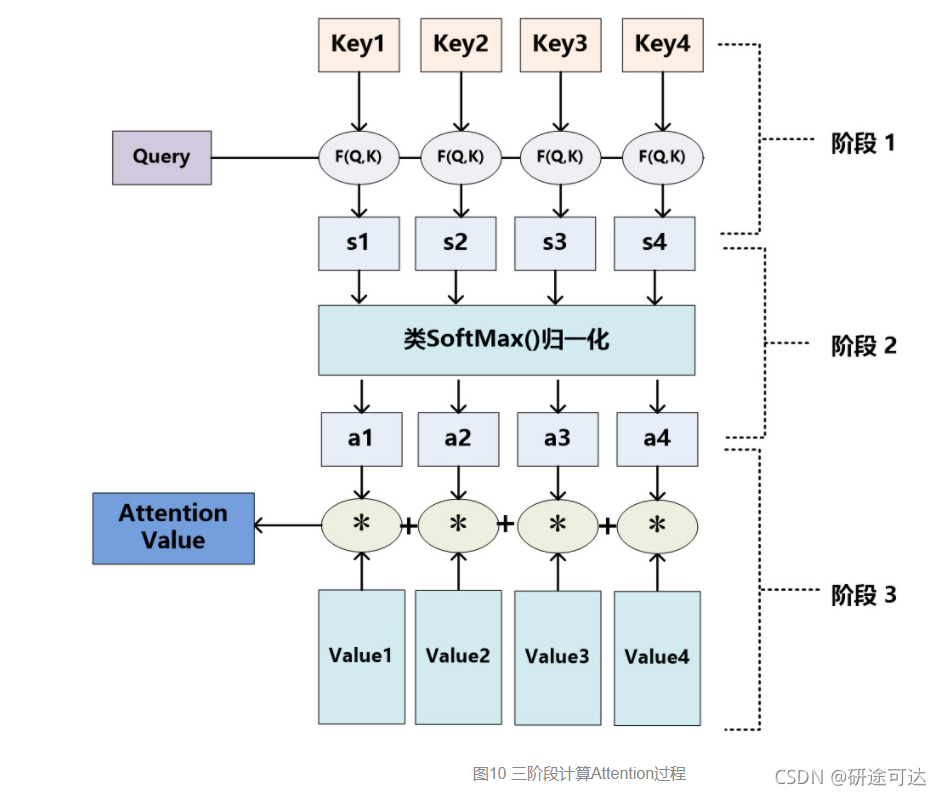

attention机制的三个阶段:

可以将其归纳为两个过程:第一个过程是根据Query和Key计算权重系数,第二个过程根据权重系数对Value进行加权求和。而第一个过程又可以细分为两个阶段:第一个阶段根据Query和Key计算两者的相似性或者相关性;第二个阶段对第一阶段的原始分值进行归一化处理;这样,可以将Attention的计算过程抽象为如下图的三个阶段。

Self Attention模型

Self Attention也经常被称为intra Attention(内部Attention)!

在一般任务的Encoder-Decoder框架中,输入Source和输出Target内容是不一样的,比如对于图片-文字机器解释来说,Source是图片,Target是对应的解释出的中文句子,Attention机制发生在Target的元素Query和Source中的所有元素之间。

而Self Attention,指的不是Target和Source之间的Attention机制,而是Source内部元素之间或者Target内部元素之间发生的Attention机制,也可以理解为Target=Source这种特殊情况下的注意力计算机制。

在异常检测中,可以通过引入自注意力机制,来实现聚焦与异常的部位,在这个假设的前提下,可以为后续的异常的区域的重建或者定位做进一步考虑!

264

264

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?