CVPR满分论文 | 英伟达开源双目深度估计大模型FoundationStereo

本文介绍了 FoundationStereo,一种用于立体深度估计的基础模型,旨在实现强大的零样本泛化能力。通过构建大规模(100 万立体图像对)合成训练数据集,结合自动自筛选流程去除模糊样本,并设计了网络架构组件(如侧调谐特征主干和远程上下文推理)来增强可扩展性和准确性。这些创新显著提升了模型在不同领域的鲁棒性和精度,为零样本立体深度估计设立了新标准。

相关论文 FoundationStereo: Zero-Shot Stereo Matching 获得 CVPR 2025 满分评审,代码已开源。

-

论文地址:https://arxiv.org/abs/2501.09898

-

项目主页:https://nvlabs.github.io/FoundationStereo/

-

项目代码和数据集:https://github.com/NVlabs/FoundationStereo/

对比常用 RGBD 相机:

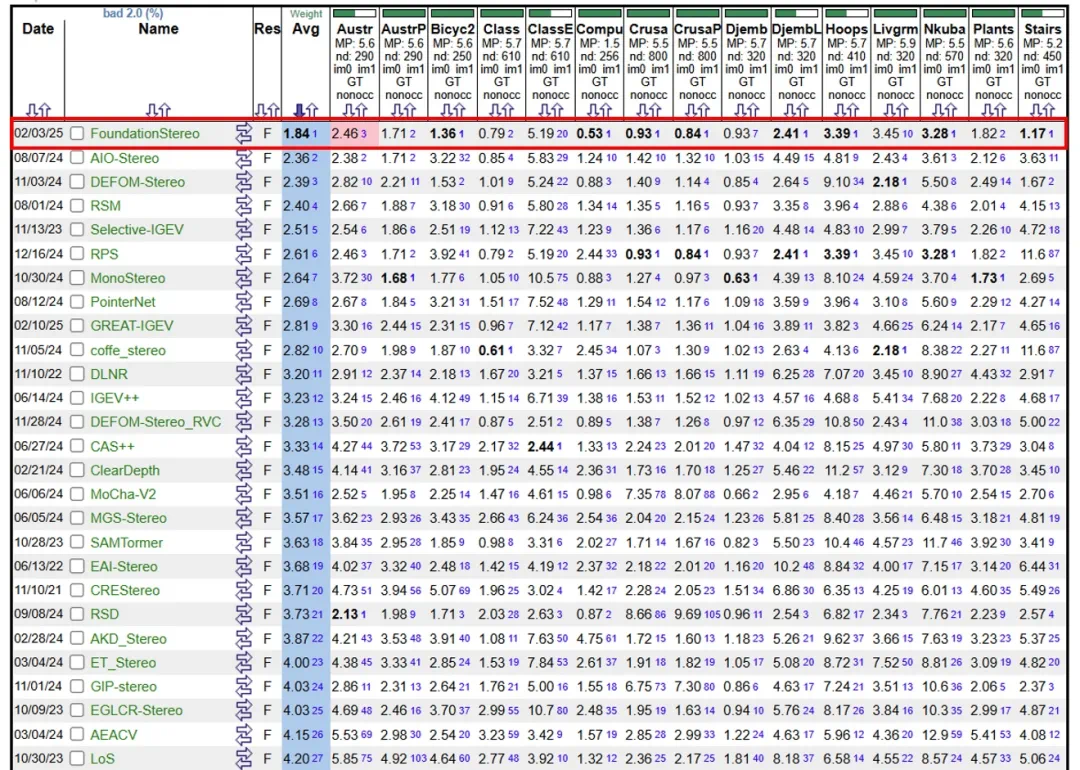

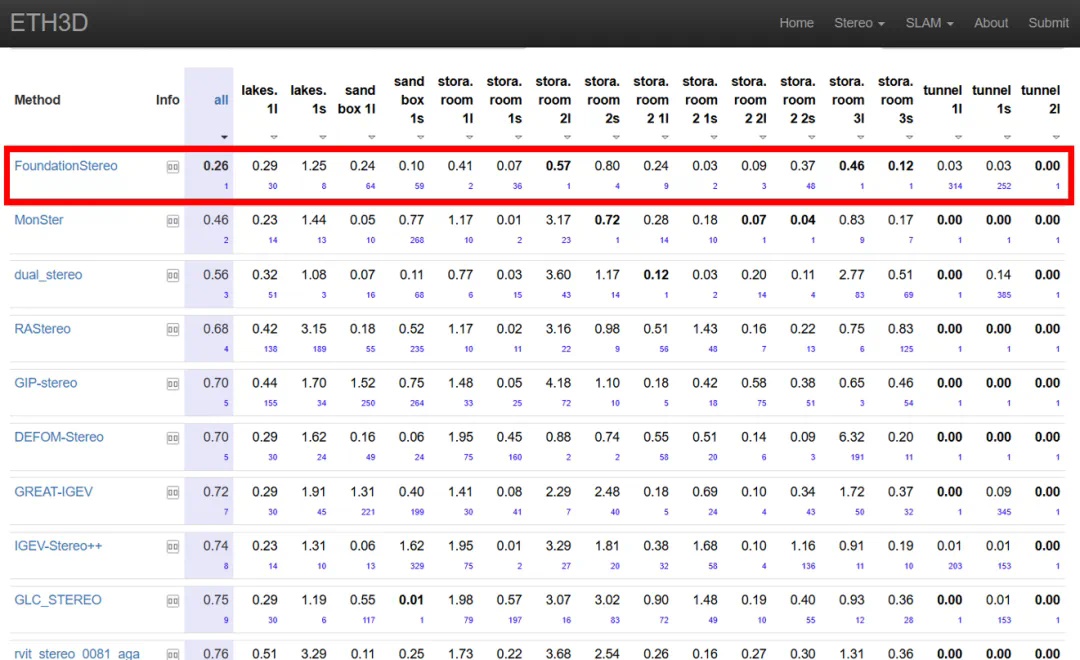

目前 FoundationStereo 在 Middlebury, ETH3D 等多个排行榜位列第一。

引言

立体匹配算法虽在基准数据集上表现优异,但零样本泛化能力仍不足。现有方法依赖目标域微调,且受限于网络结构或数据规模。本文提出 FoundationStereo,通过大规模合成数据、自筛选流程及结合单目先验的架构设计,实现了无需微调的跨域泛化能力。主要贡献如下:

1.FoundationStereo 大模型

-

提出首个零样本泛化能力强大的立体匹配基础模型,无需目标域微调即可在多样场景(室内 / 室外、无纹理 / 反射 / 透明物体等)中实现高精度深度估计。

2. 大规模合成数据集(FSD)

-

构建包含 100 万立体图像对的高保真合成数据集,覆盖复杂光照、随机相机参数及多样化 3D 资产,并通过路径追踪渲染提升真实性。

-

设计

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1143

1143

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?