围绕Transformer的研究一直以来都是各大顶会的热门投稿方向,比如它自身的魔改、与其他技术结合等等。最近在ECCV 2024上发现的一篇高质量paper就讲的是Transformer结合小波变换,提出的架构在捕获空间频率模式方面非常有效,性能远超现有的SNN。

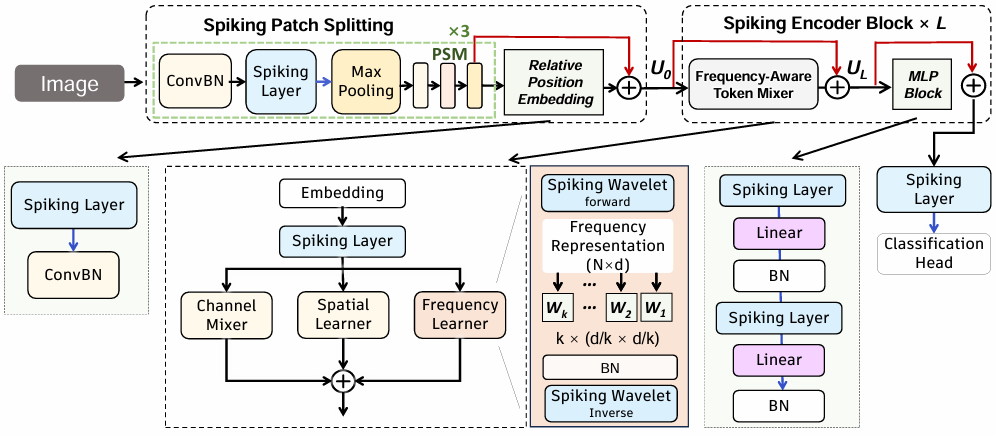

The overview of SWformer

有这样的效果也不奇怪,这种结合策略的优势就在于能够利用小波变换的多尺度特性增强Transformer在处理信号和图像数据时的表现,让模型既能处理信号的细微变化,又能理解整体上下文,从而在图像识别等领域实现效率与准确率的完美平衡。

因此这个方向的研究多,顶会成果也不少,比如CVPR 2024的GestFormer模型,用于动态手势识别、AAAI 2024的视频修复模型WaveFormer等等。有需要的参考的论文er可以直接看我整理好的15篇Transformer+小波变换最新paper,基本都是顶会顶刊且有代码,帮大家节省点找论文的时间精力。

全部论文+开源代码需要的同学看文末

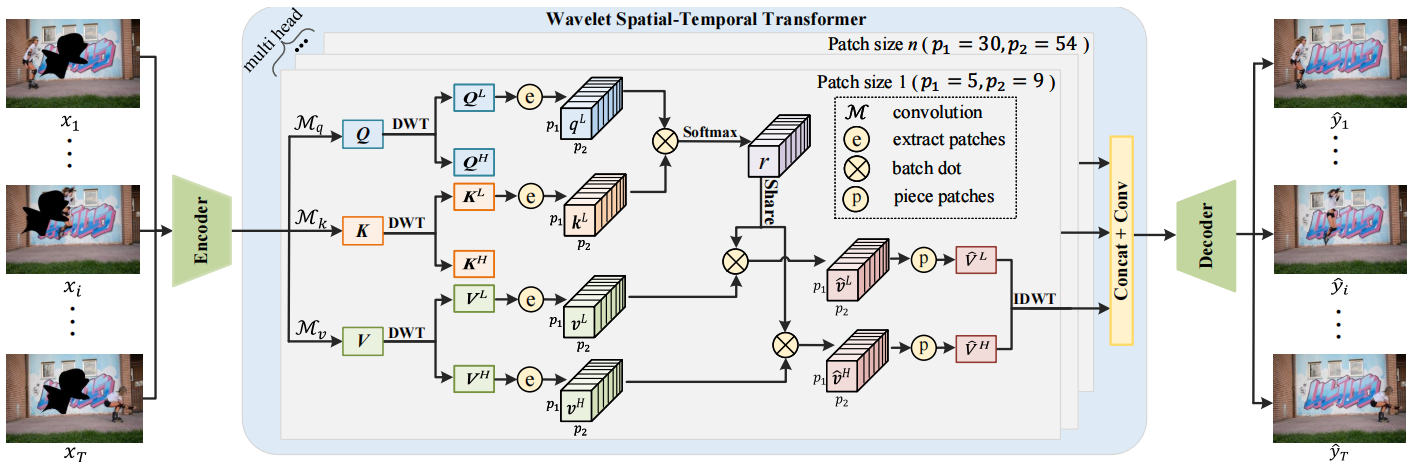

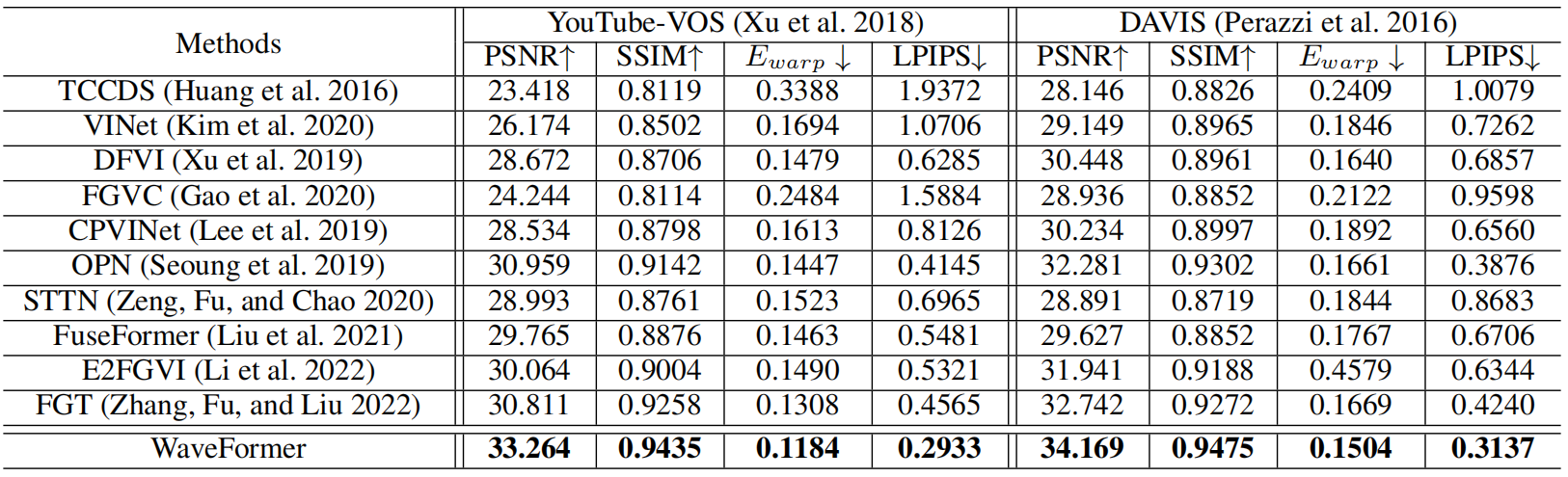

【AAAI 2024】WaveFormer: Wavelet Transformer for Noise-Robust Video Inpainting

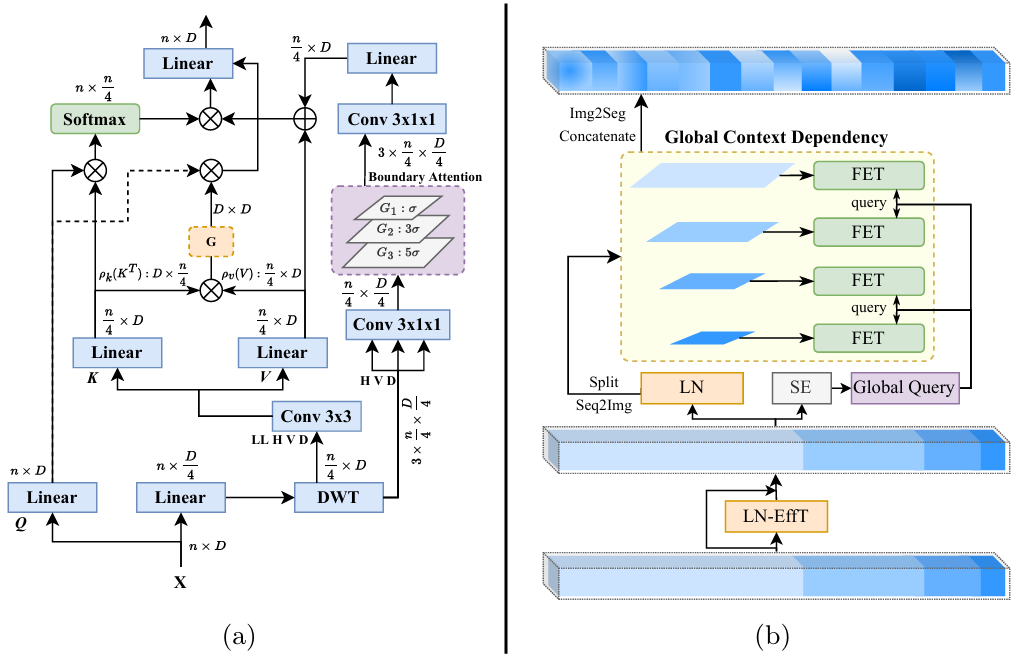

方法:文章介绍了一个名为WaveFormer的模型,它结合了小波变换和Transformer架构用于视频修复。WaveFormer通过引入离散小波变换(DWT)分解嵌入的低频和高频成分,以低频成分计算注意力,显著缓解噪声影响。

创新点:

-

首次理论证明了噪声在注意力计算中的影响,指出噪声会减少对相关内容的注意力并增加对无关内容的注意力。

-

提出了一种新颖的波变换网络,称为WaveFormer。该网络通过引入离散小波变换(DWT)将嵌入中的噪声分离为高频成分,利用较为干净的低频成分来计算注意力,从而显著降低噪声对注意力计算的影响。

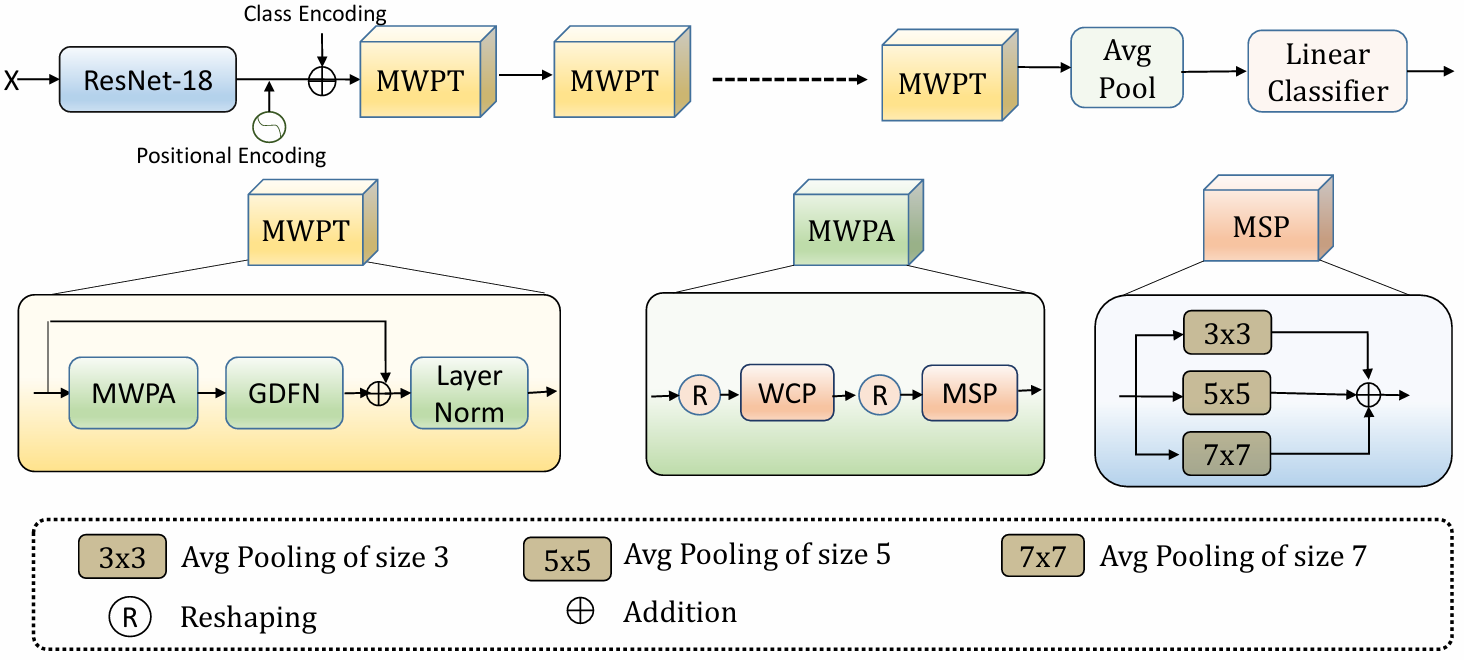

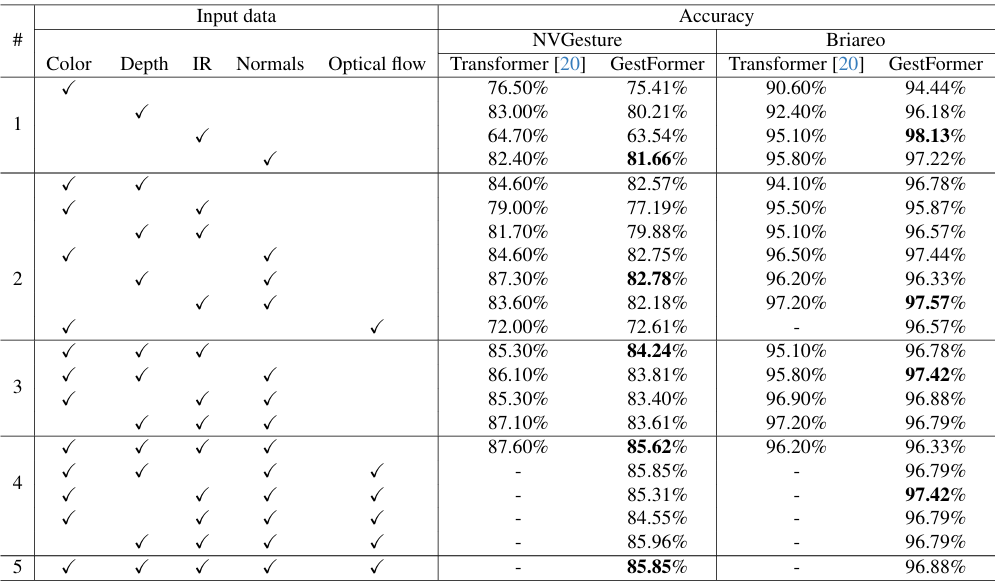

【CVPR 2024】GestFormer: Multiscale Wavelet Pooling Transformer Network for Dynamic Hand Gesture Recognition

方法:论文介绍了一个名为GestFormer的模型,是用于动态手势识别的多尺度小波池化变换网络。GestFormer结合了小波变换和Transformer架构,特别是通过一个名为MWPA的新颖令牌混合器,该混合器在传递输入到池化层之前使用多尺度池化和离散小波变换来映射输入到小波空间。

创新点:

-

提出了一种新颖的多尺度小波池化注意机制,利用小波变换将输入映射到小波空间,然后通过池化层进行处理。

-

设计了一种门控前馈网络 (GFFN),用于在Transformer块的不同阶段精确过滤和传递信息。

-

利用PoolFormer架构,替代传统Transformer中的注意机制,通过非参数化的池化操作实现令牌混合。

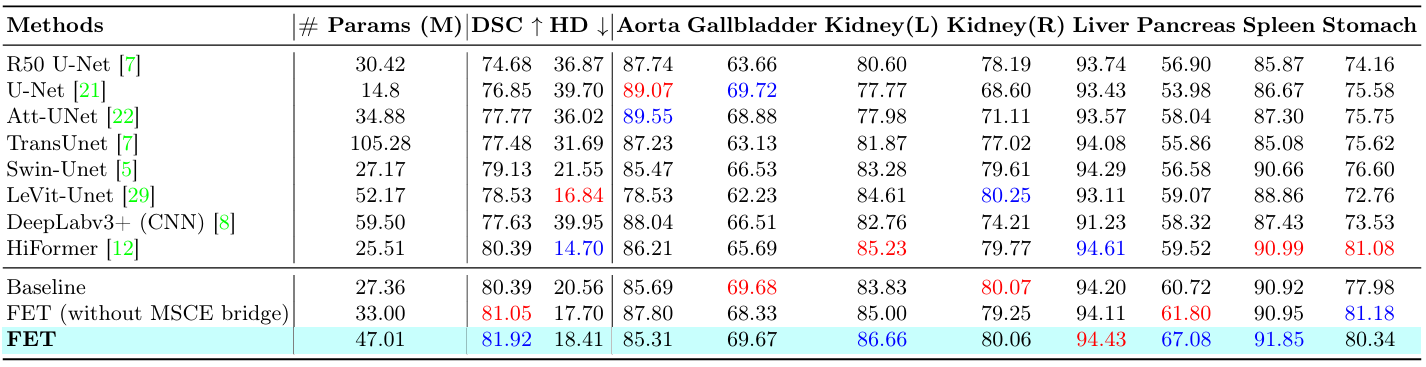

【MICCAI 2023】Unlocking Fine-Grained Details with Wavelet-based High-Frequency Enhancement in Transformers

方法:论文提出了一种基于小波变换的频率增强Transformer(FET)方法,通过重新设计自注意力机制并结合边界注意力图和多尺度上下文增强模块,有效捕捉医疗图像分割中的细节和边界信息,以改善医学图像分割的性能。

创新点:

-

提出了一个创新的FET模块,结合了频率增强模块和边界感知注意力图,以自适应的方式建模形状和纹理表示。

-

在跳跃连接中应用了MSCE模块,以解决编码器和解码器阶段之间的语义差距。

-

重新设计了自注意力机制,将二次自注意力图计算重新表述为线性操作,显著降低了计算复杂度。

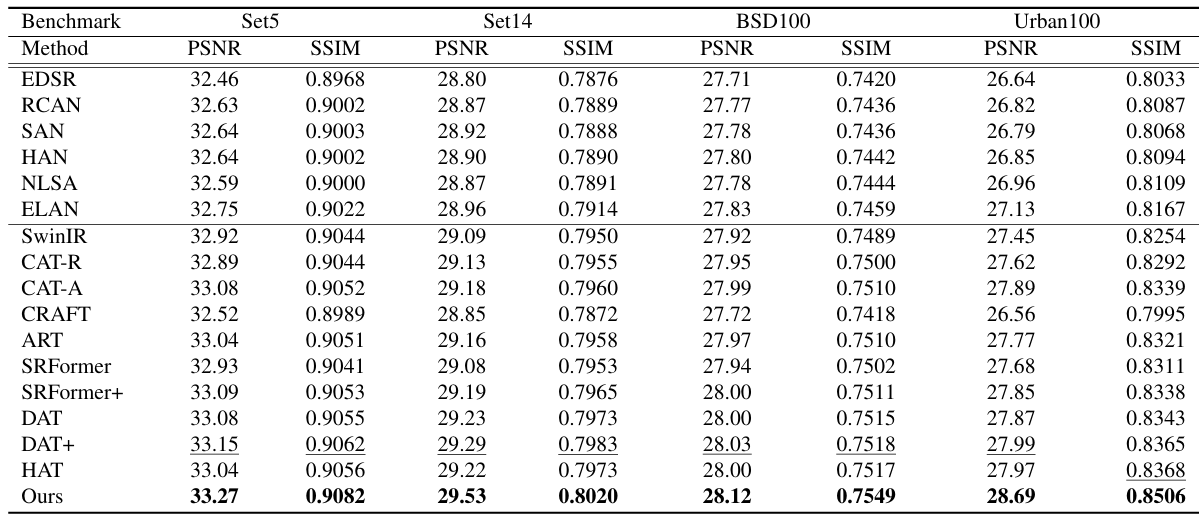

【NTIRE 2024】Training Transformer Models by Wavelet Losses Improves Quantitative and Visual Performance in Single Image Super-Resolution

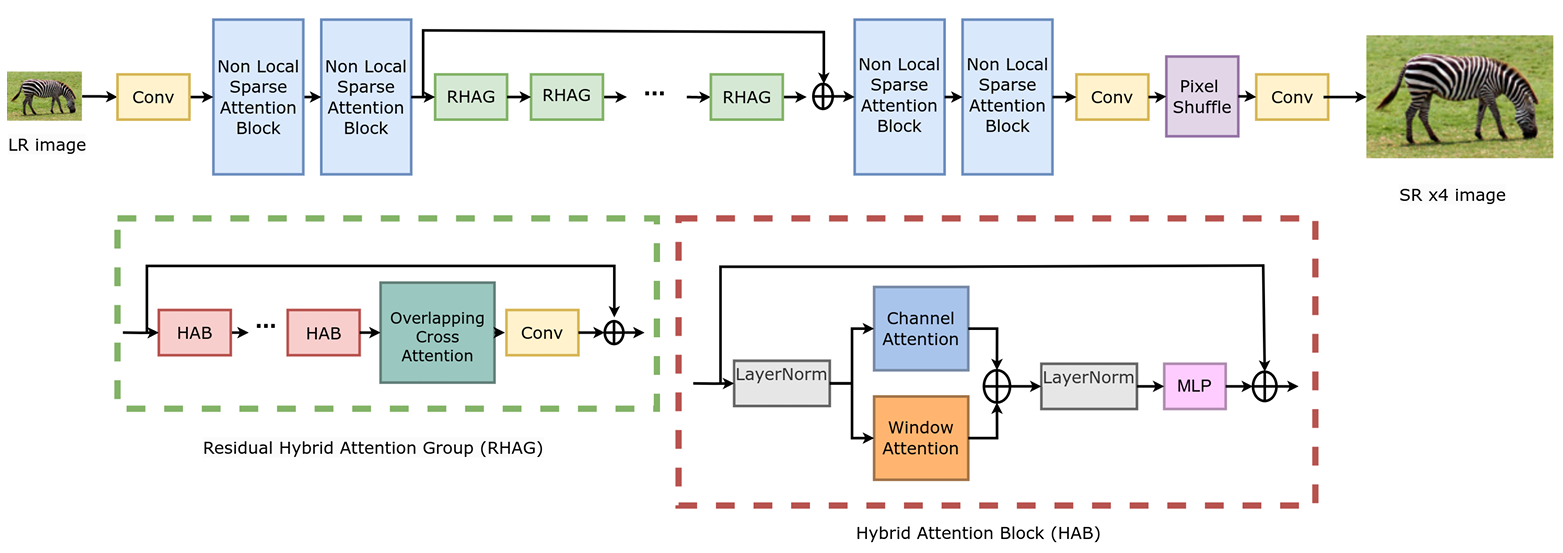

方法:这篇论文提出了一种新的混合Transformer模型,通过在模型中引入卷积非局部稀疏注意力(NLSA)模块来扩大感受野,并采用小波损失来训练模型,从而显著提高了单图像超分辨率任务中高频细节的捕捉能力和图像的视觉质量。

创新点:

-

通过在混合Transformer架构中引入NLSA块,扩大了感受野,提升了超分辨率图像的重建质量。

-

利用小波损失对Transformer模型进行训练,改善了量化和主观性能。

-

将HAT架构夹在非局部稀疏注意力块之间,进一步扩大了感受野。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“WTTR”获取全部方案+开源代码

码字不易,欢迎大家点赞评论收藏

3642

3642

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?