RT-1

2022年 Google 机器人研究团队历时17个月基于13个机器人得到了 130k episodes 以及超过700个任务的数据,这些数据可以使机器人能够形成很好的泛化能力,从而使机器人能够发现结构相似任务之间的模式,且应用到新任务上。该数据集不仅仅规模很大,而且广度很大。在该数据集的基础之上,基于模仿学习中行为克隆学习范式,把 Transformer 应用机器人的操纵任务上,提出了 RT-1模型。

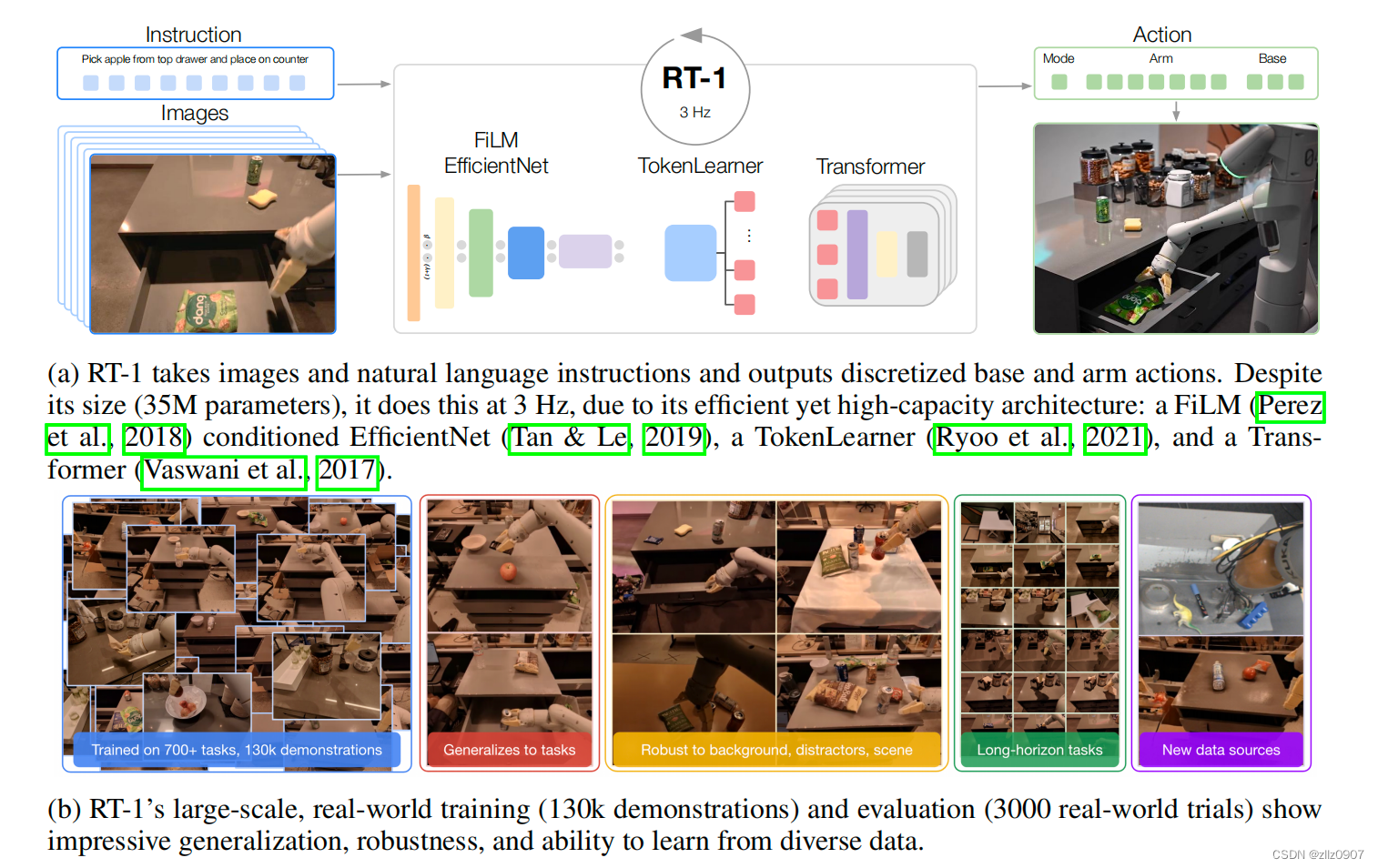

RT-1,它可以把相机图片、指令与电机命令作为输入,即可对高维的输入与输出进行编码。RT-1 的架构、数据集、以及评估概览,可见图1所示。

最终,实验表明 RT-1 可以展示较强的泛化能力和鲁棒性,可见图1.b,且可以执行长期任务。

该系统主要的贡献:RT-1 是一个高效的模型,可以吸收大量的数据,可高效的泛化,且可实时对机器人进行控制。RT-1 的输入由图片序列、自然语言指令构成,输出由机械臂运动的目标位姿( roll , pitch yaw , gripper status)、基座的运动 、模式转换指令构成。机器人有三个模式,分别是:控制机械臂、基座、或者终止。

RT-2

2023年 Google 的 DeepMind 团队基于互联网上数据训练视觉-语言模型(VLM),使其能够学习到更多关于视觉和语言之间映射关系的知识后,在机器人操纵任务上微调,提出了 RT-2 。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?