这几天在公众号和知乎也一直有朋友问「XX配置能部署多少B的模型」、「能不能部署更高精度的量化模型」等等问题,今天我们就来聊聊这个。

在开始说显存占用之前,我们先要了解一些基础信息和概念。

模型规模

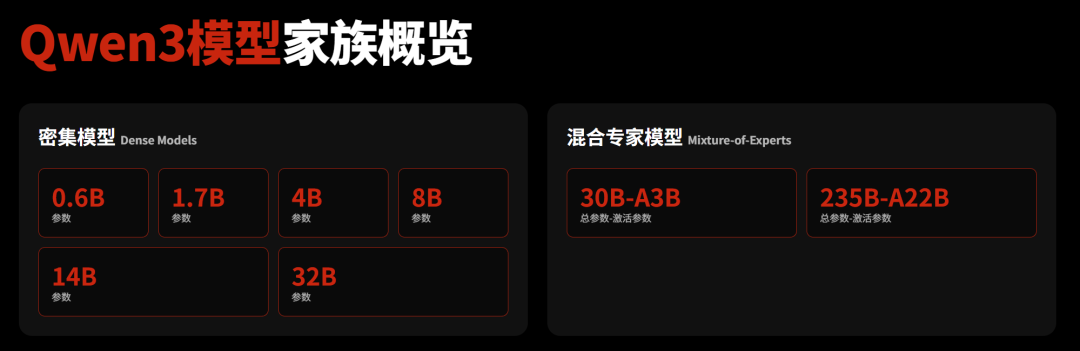

本次Qwen3系列开源模型一共发布了8个不同尺寸,尺寸越大,显存占用越高。

8个模型中有6个Dense(密集)模型,2个MoE(混合专家)模型。密集模型在推理过程中会激活所有参数,而 MoE 模型则采用稀疏激活策略,每次前向传递只激活一部分专家参数,在有限的计算预算下性能更高。

量化权重

量化是指降低模型权重的数值精度,以显著减少显存占用和存储空间并可能提高推理速度的技术。未量化的模型显存占用非常高,很难本地部署。

本地部署起来最方便的Ollama,提供了三种量化权重的Qwen3模型,分别是Q4_K_M(默认)、Q8_0和FP16。

KV缓存

KV缓存是大语言模型推理过程中的一个重要技术概念。简单来说,如果没有KV缓存,每生成一个新token,整个序列的注意力都要重新计算,一次生成过程的计算量将呈指数增长。而有了KV缓存,则只需要计算新token的向量再与缓存交互即可,大大减少了计算量。

KV缓存是让大语言模型实用化的关键技术,但也是显存消耗的主要来源之一。KV缓存的大小随上下文长度线性增长,上下文越长,显存占用越高。

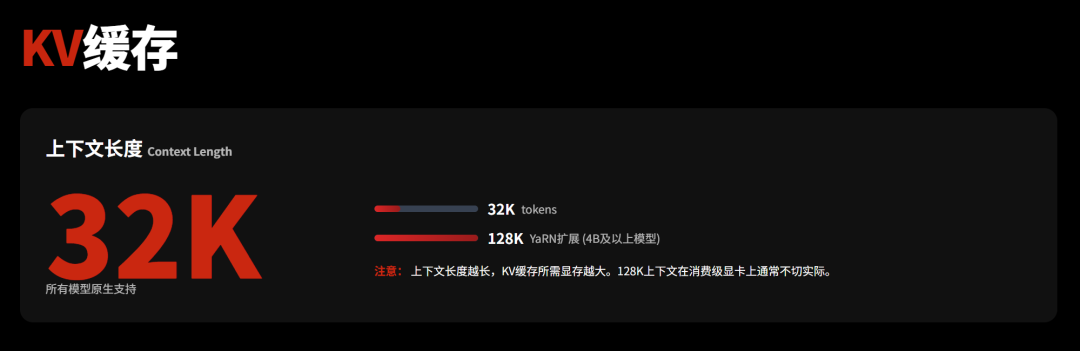

Qwen3系列模型原生上下文长度32K,4B及以上尺寸可扩展至128K。但这个上下文长度对消费级显卡来说不太现实,一般高端显卡(24GB+)可能只能处理8K-16K的上下文。

了解了上面三个基本信息和概念,接下来就要说到显存了。

显存占用

本地部署运行大语言模型,显存占用的构成主要来源于三部分:模型权重(包括参数规模和量化)、KV缓存、激活值与开销。

模型权重就是存储/加载模型参数所需的空间,取决于模型的参数量和使用的数值精度(即量化级别)。例如,一个 140 亿参数的模型,如果使用 FP16(半精度浮点数,每个参数 2 字节)存储,大约需要 28GB 显存。

KV缓存与以序列长度(上下文长度)、批处理大小(Batch Size)、模型维度(层数、隐藏层大小)以及缓存精度(不必与模型权重精度相同,通常为FP16 精度)等多个因素密切相关,可以按照公式VRAMkvcache≈2×层数×隐藏层维度×序列长度×批处理大小×每个值的字节数进行估算,这里就不做展开了。

激活值与开销即推理过程中中间计算结果(激活值)以及运行框架(如 CUDA 核函数、驱动程序、操作系统等)自身占用的显存,一般也就1-2G左右。

对于Qwen3系列模型,可以直接查看下面这个表格,表格中上下文长度统一按照8K计算。

例如,部署Q4_K_M的Qwen3-32B模型,所需要的显存大概为约19.8G(模型权重)+约14G(8K上下文KV缓存)+约1~2G(开销),一共大约35.3G。

当然,提前防杠一下。在实际使用过程中,上下文是根据实际情况变化并逐渐累积的,并不是一开始就直接占用掉大概14G的空间,所以即便没有达到表格中写的总需求,也并不代表一点也不能用。

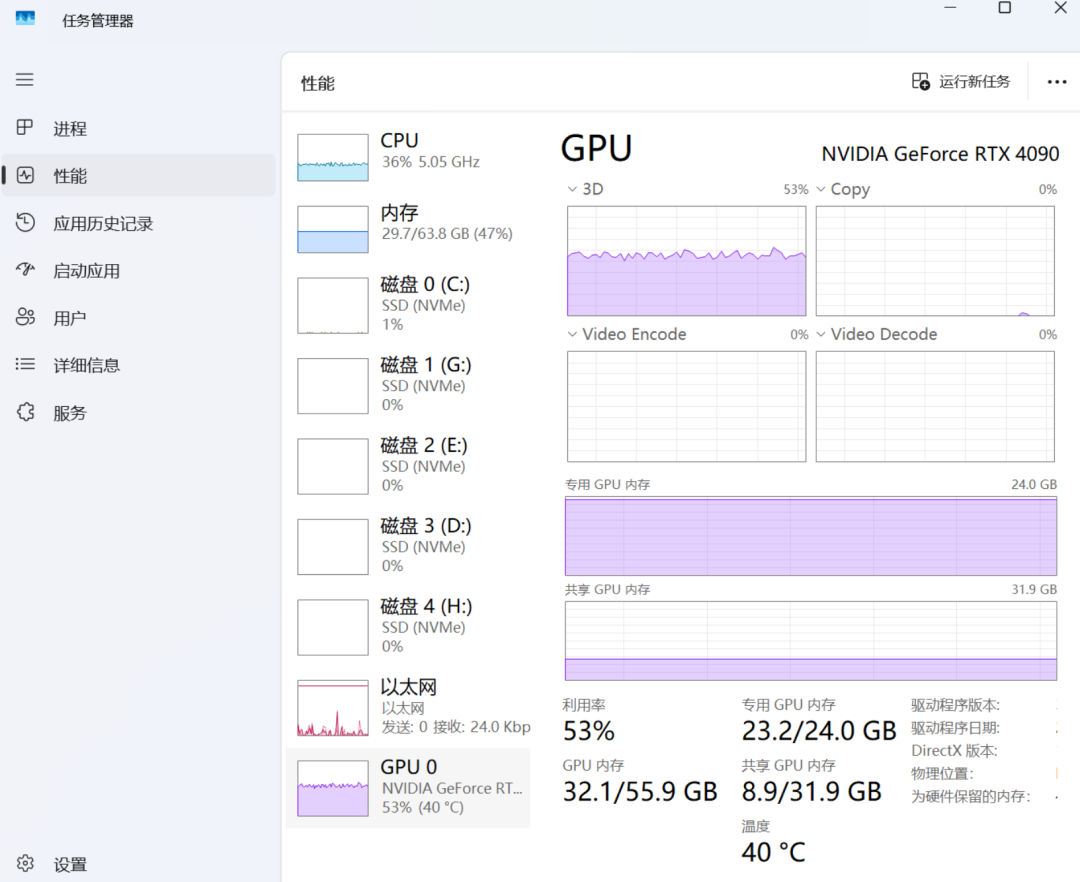

但是,如果你本地部署完大模型,刚开始执行一个简单小任务就是下面这种显存拉满的状态,那大概率可以判断它后面很难支持复杂任务,最好换成尺寸更小的模型或者低精度量化模型。

另外,对于混合专家模型,需要单独补充说明一下。在显存占用方面,它和密集模型并没有太大区别,装入显存时依旧需要为全部参数分配显存空间,但因为只有一部分参数被激活并参与实际计算,推理速度会比同等显存占用的密集模型快得多。装入显存时,看总参数量;运行速度时,看激活参数量。

消费级显卡兼容

典型的消费级显卡和模型的兼容可以查看下面这张图:

理论上,对于24G显存的高端显卡来说,跟Q4_K_M量化的Qwen3-30B-A3B在显存占用上十分契合。如果你使用3090/4090,可以优先测试一下这个模型。

从参数综合来看,不同配置对本地部署Qwen3模型的选择可以参考这张图:

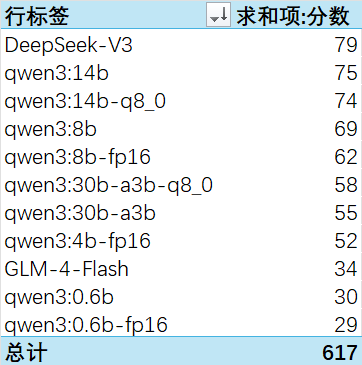

不同尺寸&量化权重Qwen3实际测试

依旧是上篇文章的测试题目:Qwen3值不值得普通用户本地部署?3个落地场景,30道题,300条回答,10模型大混测,豆包AI打分!

补充了不同尺寸和量化权重的Qwen3模型,供大家参考。

(PS:非严谨测试,结果仅供参考;模型名称未标明精度的即为默认Q4_K_M。)

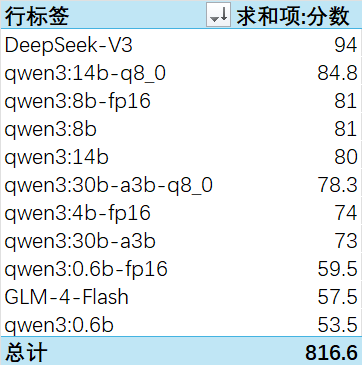

文案项目:

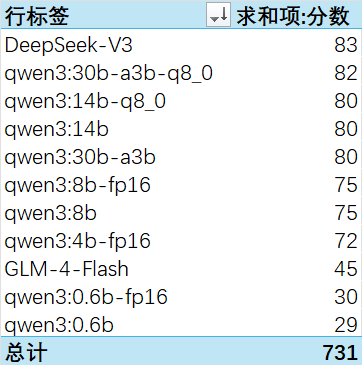

总结项目:

弱智吧项目:

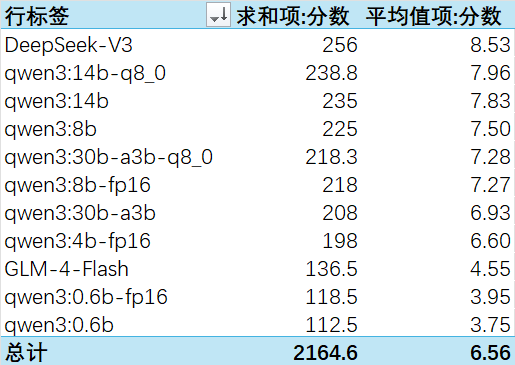

综合打分:

这三个项目中,综合评分依旧是全量DeepSeek-V3(硅基流动API)最高;因为加入了0.6B小模型,上篇测试中综合评分最低的GLM-4-Flash提升到倒数第三,但0.6B模型跟其他模型的差距并没有预想那么大;中间模型各位可自行参考。

测试详细内容见:https://ilovezhiwai.feishu.cn/wiki/TboCwTXPVi4vQqkHucuc7Dq4nkI

结合这几个我自己相对高频场景下的测试结果和理论数据,我个人最终会倾向选择Qwen3-14B (Q8_0)。

如何本地部署

关于本地部署的方案,个人依旧建议通过Ollama进行本地部署,操作起来十分快捷方便。

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集***

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

366

366

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?