✅作者简介:热爱科研的Matlab仿真开发者,擅长数据处理、建模仿真、程序设计、期刊写作与指导,代码获取、论文复现及科研仿真。

🍎更多Matlab代码及仿真定制内容点击 🔗:Matlab科研工作室

🍊个人信条:格物致知。

🔥 内容介绍

机器人路径规划是机器人学领域的核心问题之一,旨在为机器人找到一条从起始位置到目标位置的安全、高效且无碰撞的路径。传统的路径规划方法,如A*算法、Dijkstra算法等,在静态环境下表现良好,但面对动态、复杂且不确定的环境时,其效率和鲁棒性往往受到限制。近年来,随着强化学习技术的快速发展,基于强化学习的机器人路径规划方法逐渐受到关注,并展现出其在处理复杂环境问题上的优越性。本文将深入探讨基于强化学习的机器人路径规划方法,并结合Matlab代码进行详细阐述。

一、强化学习在机器人路径规划中的应用

强化学习 (Reinforcement Learning, RL) 是一种机器学习方法,其核心思想是智能体通过与环境交互,不断学习并改进其策略以最大化累积奖励。在机器人路径规划中,机器人扮演智能体的角色,环境是机器人所处的空间,动作是机器人的移动,状态是机器人的位置和周围环境信息,奖励则是根据机器人的轨迹和目标达成情况赋予的数值。通过不断地尝试和学习,机器人能够找到一条最优路径,即使在未知或动态环境中也能有效地进行导航。

强化学习方法在机器人路径规划中的应用主要体现在以下几个方面:

-

处理复杂环境: 强化学习能够有效处理具有障碍物、动态目标等复杂的环境,因为它无需预先构建环境地图,而是通过学习直接获取最优策略。

-

适应性强: 强化学习算法能够根据环境的变化自适应地调整策略,从而提高路径规划的鲁棒性。

-

在线学习: 一些强化学习算法支持在线学习,即机器人可以在执行任务的过程中不断学习和改进策略,无需事先进行大量的离线训练。

常见的强化学习算法在路径规划中的应用包括:Q-learning, SARSA, Deep Q-Network (DQN), Actor-Critic 方法等。其中,基于深度学习的算法,如DQN和Actor-Critic,尤其适用于高维状态空间和连续动作空间的路径规划问题。

二、基于DQN的机器人路径规划算法

Deep Q-Network (DQN) 是一种基于深度神经网络的强化学习算法,它能够有效地处理高维状态空间和连续动作空间。在机器人路径规划中,我们可以使用DQN来学习一个策略,该策略能够根据机器人的当前状态选择最优的动作,从而引导机器人到达目标位置。

算法流程如下:

-

状态空间和动作空间定义: 定义机器人的状态空间,例如机器人的坐标、姿态以及周围环境信息;定义机器人的动作空间,例如机器人的移动方向和速度。

-

奖励函数设计: 设计一个奖励函数,用于评估机器人的行为。奖励函数通常包含到达目标的奖励、碰撞惩罚、路径长度惩罚等。

-

深度神经网络构建: 使用深度神经网络逼近Q函数,该网络的输入是机器人的状态,输出是每个动作对应的Q值。

-

经验回放: 将机器人与环境交互的历史数据存储在经验回放池中,并从中随机采样数据进行训练,以提高训练效率和稳定性。

-

网络更新: 使用梯度下降算法更新深度神经网络的参数,以最小化误差函数。

-

策略执行: 根据训练好的深度神经网络,选择动作,并控制机器人移动。

三、Matlab代码实现

以下是一个简化的基于DQN的机器人路径规划Matlab代码示例,该代码模拟了一个二维环境中的机器人路径规划问题:

matlab

% 初始化环境参数

mapSize = [10 10]; % 地图大小

obstaclePos = [3,5; 7,2; 5,8]; % 障碍物位置

% 初始化DQN参数

inputSize = 2; % 状态空间维度

outputSize = 4; % 动作空间维度 (上、下、左、右)

hiddenSize = 20; % 隐藏层神经元个数

% 创建DQN网络

net = feedforwardnet(hiddenSize);

net.layers{1}.transferFcn = 'relu';

net.trainFcn = 'trainlm';

% 训练DQN网络 (简化代码,实际训练过程更复杂)

for i = 1:1000

% 获取状态

state = [robotX, robotY];

% 选择动作

action = chooseAction(net, state);

% 执行动作,更新机器人位置

[newState, reward] = takeAction(action, state);

% 更新DQN网络

net = trainDQN(net, state, action, reward, newState);

end

% 路径规划

[path, reward] = findPath(net);

% 绘制路径

plotPath(path);

(注:以上代码仅为简化示例,实际实现需要包含更详细的环境建模、奖励函数设计、DQN网络训练以及路径规划算法等模块。 具体代码实现需要根据实际应用场景进行调整和完善。 chooseAction, takeAction, trainDQN, findPath, plotPath 等函数需要单独编写。)

四、总结与展望

基于强化学习的机器人路径规划方法为解决复杂环境下的路径规划问题提供了一种新的思路。通过学习,强化学习算法能够有效地适应动态变化的环境,并找到高效且安全的路径。然而,强化学习算法也存在一些挑战,例如样本效率低、训练时间长等。未来的研究方向可以集中在提高强化学习算法的样本效率、鲁棒性以及在更复杂环境中的应用等方面。 结合迁移学习、多智能体强化学习等技术,进一步提升路径规划算法的性能也是一个重要的研究方向。 此外,将强化学习与传统的路径规划方法相结合,取长补短,也是一个值得探索的途径。 最终目标是构建一个能够在各种复杂、动态和不确定环境中高效、安全地进行导航的自主机器人系统。

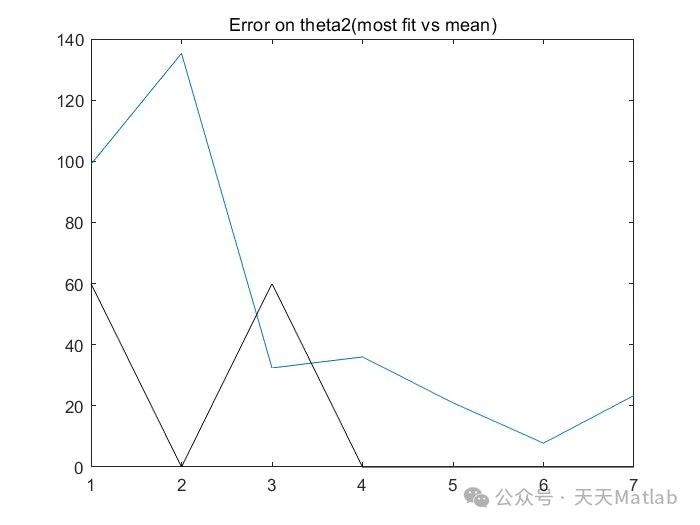

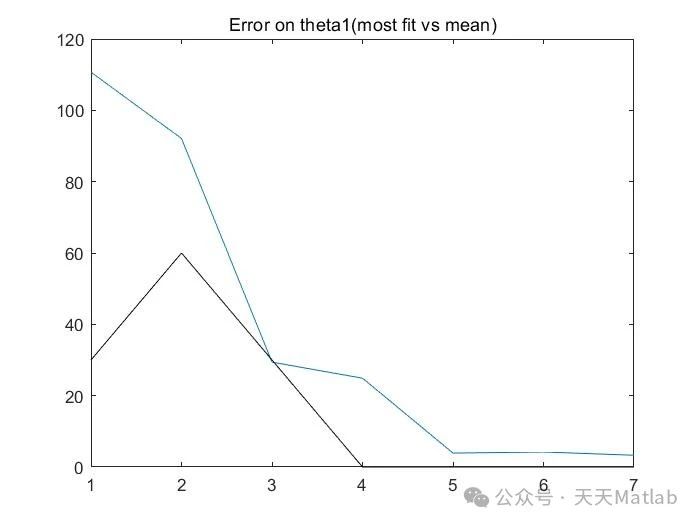

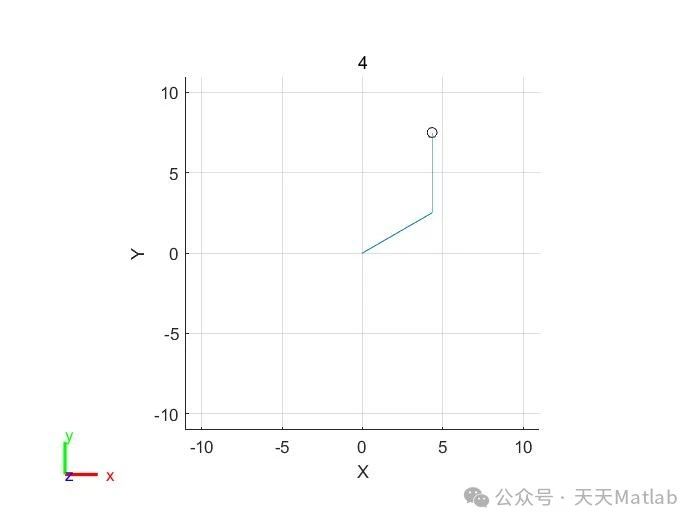

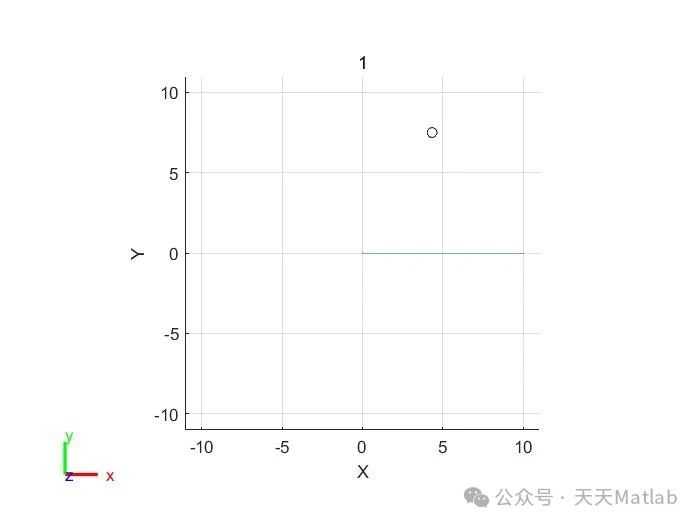

⛳️ 运行结果

🔗 参考文献

[1]李东华,江驹,姜长生.多智能体强化学习飞行路径规划算法[J].电光与控制, 2009, 16(10):5.DOI:10.3969/j.issn.1671-637X.2009.10.003.

🎈 部分理论引用网络文献,若有侵权联系博主删除

🌈 各类智能优化算法改进及应用

生产调度、经济调度、装配线调度、充电优化、车间调度、发车优化、水库调度、三维装箱、物流选址、货位优化、公交排班优化、充电桩布局优化、车间布局优化、集装箱船配载优化、水泵组合优化、解医疗资源分配优化、设施布局优化、可视域基站和无人机选址优化、背包问题、 风电场布局、时隙分配优化、 最佳分布式发电单元分配、多阶段管道维修、 工厂-中心-需求点三级选址问题、 应急生活物质配送中心选址、 基站选址、 道路灯柱布置、 枢纽节点部署、 输电线路台风监测装置、 集装箱调度、 机组优化、 投资优化组合、云服务器组合优化、 天线线性阵列分布优化、CVRP问题、VRPPD问题、多中心VRP问题、多层网络的VRP问题、多中心多车型的VRP问题、 动态VRP问题、双层车辆路径规划(2E-VRP)、充电车辆路径规划(EVRP)、油电混合车辆路径规划、混合流水车间问题、 订单拆分调度问题、 公交车的调度排班优化问题、航班摆渡车辆调度问题、选址路径规划问题、港口调度、港口岸桥调度、停机位分配、机场航班调度、泄漏源定位

🌈 机器学习和深度学习时序、回归、分类、聚类和降维

2.1 bp时序、回归预测和分类

2.2 ENS声神经网络时序、回归预测和分类

2.3 SVM/CNN-SVM/LSSVM/RVM支持向量机系列时序、回归预测和分类

2.4 CNN|TCN|GCN卷积神经网络系列时序、回归预测和分类

2.5 ELM/KELM/RELM/DELM极限学习机系列时序、回归预测和分类

2.6 GRU/Bi-GRU/CNN-GRU/CNN-BiGRU门控神经网络时序、回归预测和分类

2.7 ELMAN递归神经网络时序、回归\预测和分类

2.8 LSTM/BiLSTM/CNN-LSTM/CNN-BiLSTM/长短记忆神经网络系列时序、回归预测和分类

2.9 RBF径向基神经网络时序、回归预测和分类

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?