基础

对比学习(Contrastive Learning)概述 - 知乎 (zhihu.com)

浅聊对比学习(Contrastive Learning)第一弹_new_paper_the

对比学习(Contrastive Learning),必知必会 - 知乎

以上三篇都是很值得一看的文章,小白适合入门,老白适合刷一下系统

对比学习的核心是:代理任务与损失函数的构建

例子:

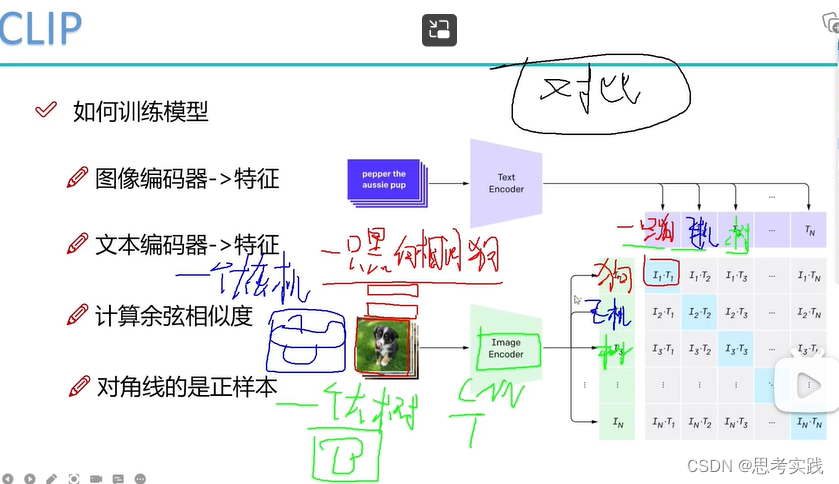

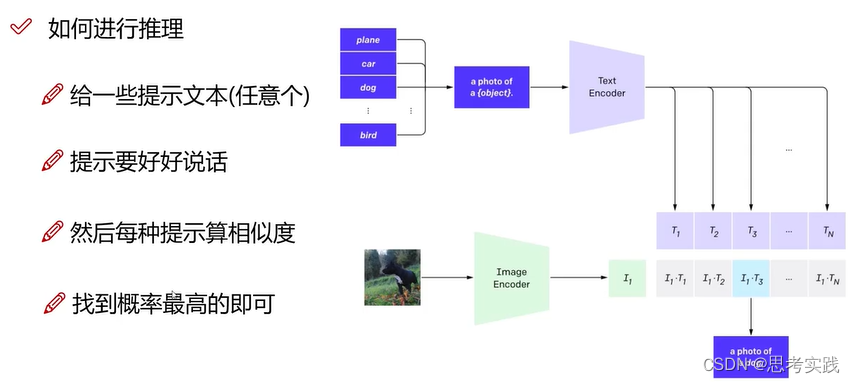

Clip讲解:Contrastive Language-Image Pre-training

对比语言-图像预训练,是一个预训练模型,简称为CLIP

对比学习,里面有个概念是正样本对和负样本对。

在CLIP中正样本就是,图像是一条狗,文本描述也是一条狗,这就是个正样本对。

图像是一条狗,文本描述是一个大飞机,这就是一个负样本,或者文本描述是树...,这也是负样本。

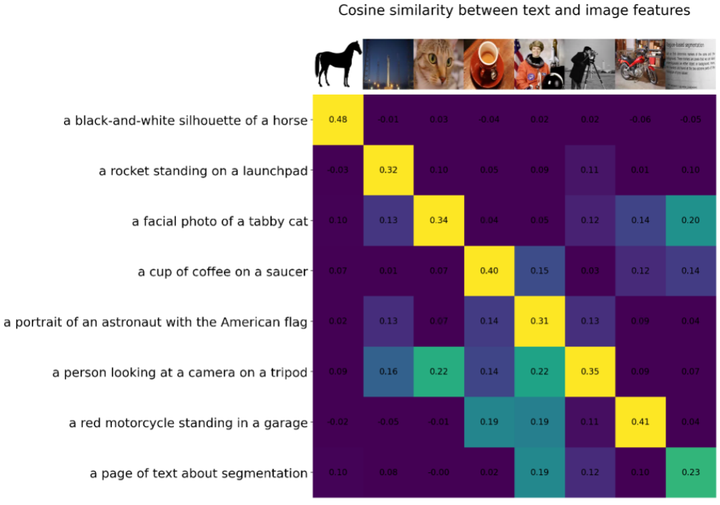

把100个图像和一百个text描述都做成对应的向量 I(Image)和T(Text),在训练的过程中,只需要让对角线自己与自己的描述相似度是最高的,而非对角线上的概率是最低的。

如果一个Batch中有N个图像,正样本对有N对,负样本对N2-N的感觉。

所谓对比就是跟谁是相关的,跟谁是不相关的。

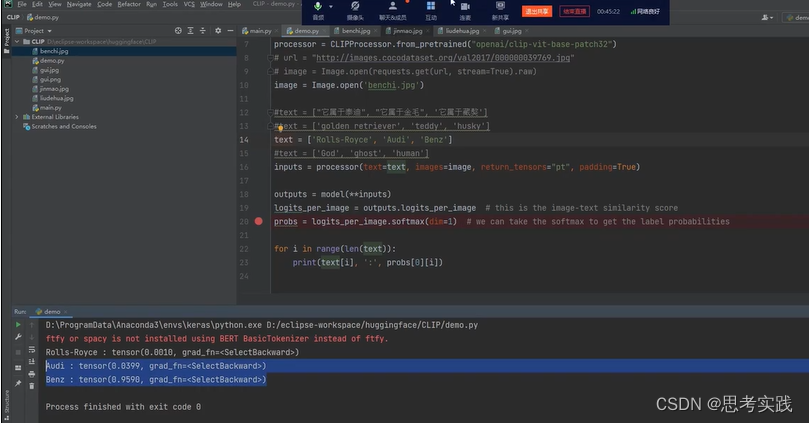

代码颜色

代码颜色

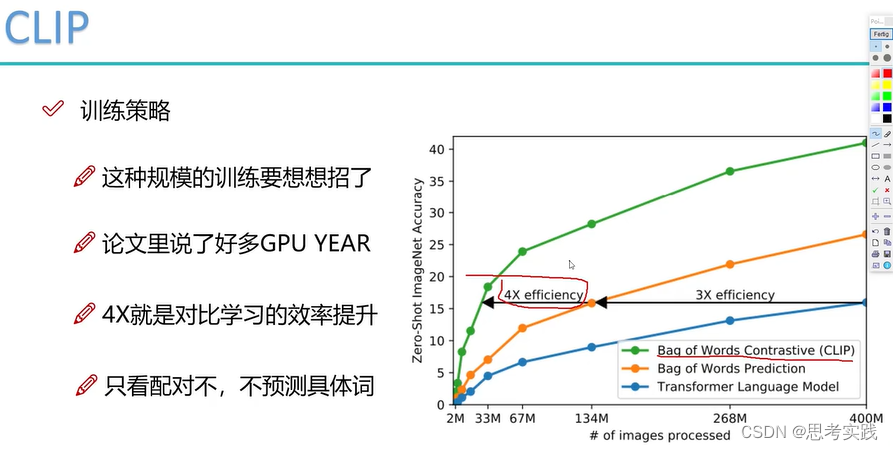

训练策略

模型实践| CLIP 模型 - 知乎 (zhihu.com)

参考资料

Contrastive Learning(对比学习)基础讲解_哔哩哔哩_bilibili

Contrastive Learning(对比学习详解)_哔哩哔哩_bilibili//讲的很好,把样本构建与具体训练流程讲了,网上这部分资料较少

神器CLIP为多模态领域带来了哪些革命?迪哥2小时精讲OpenAI神器—CLIP模型,原理详解+代码复现!_哔哩哔哩_bilibili

//讲的比较好,说实话 从时间0:19:00附件,适合小白看懂,唐兄的代码讲解也不错,偏应用方面

对比学习论文综述【论文精读】_哔哩哔哩_bilibili //质量自然不必多说,李沐出品,必属精品

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?