《------往期经典推荐------》

二、机器学习实战专栏【链接】,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

引言

本文分享的是yolo系列的目标检测综述文章,供相关领域同学参考学习。从2015年YOLO提出单阶段目标检测,到2025年以注意力机制为核心的YOLOv12框架,显示单阶段目标检测结构的蓬勃发展和性能优势。【所有文章均已打包,末尾免费获取!】

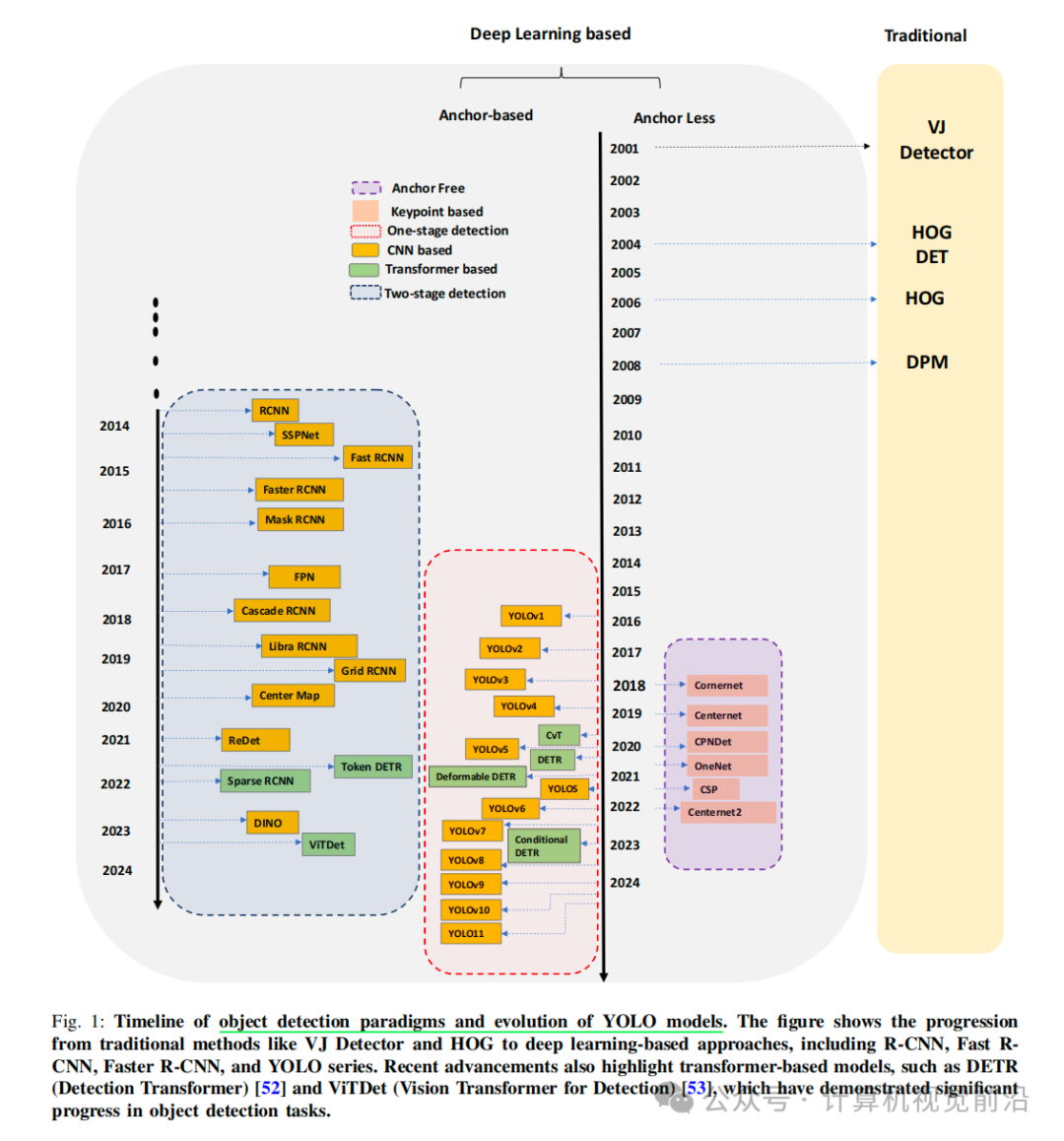

一图看尽目标检测发展

在时间维度上,比较YOLO系列目标检测的发展,以及其在传统目标检测,基于深度学习方法的目标检测;从单阶段,多阶段等角度,概述了YOLO所处的位置。

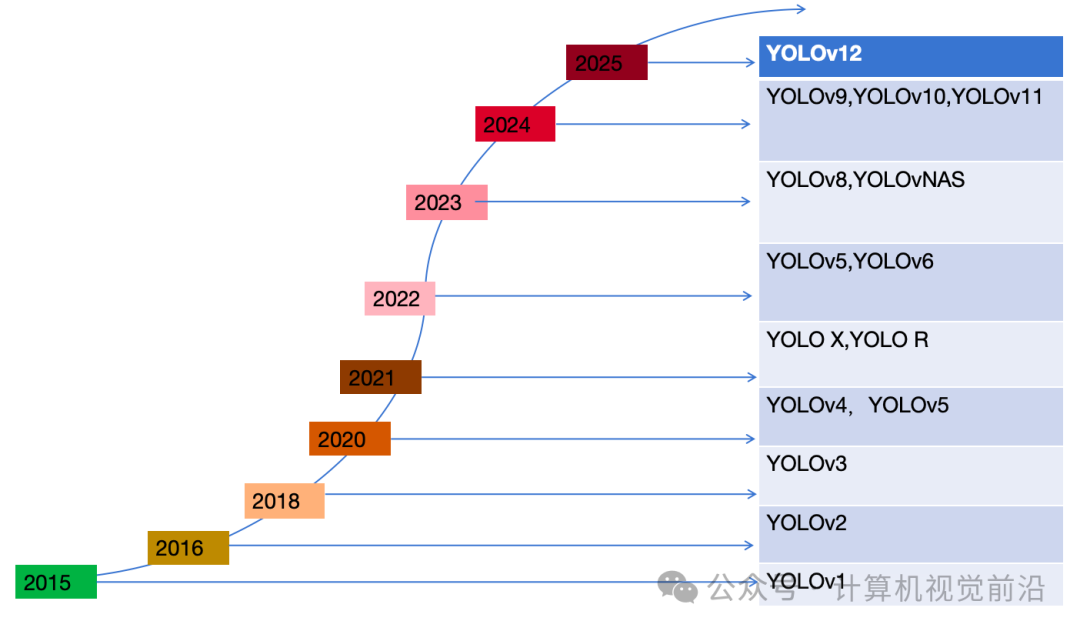

YOLO系列发展时间线

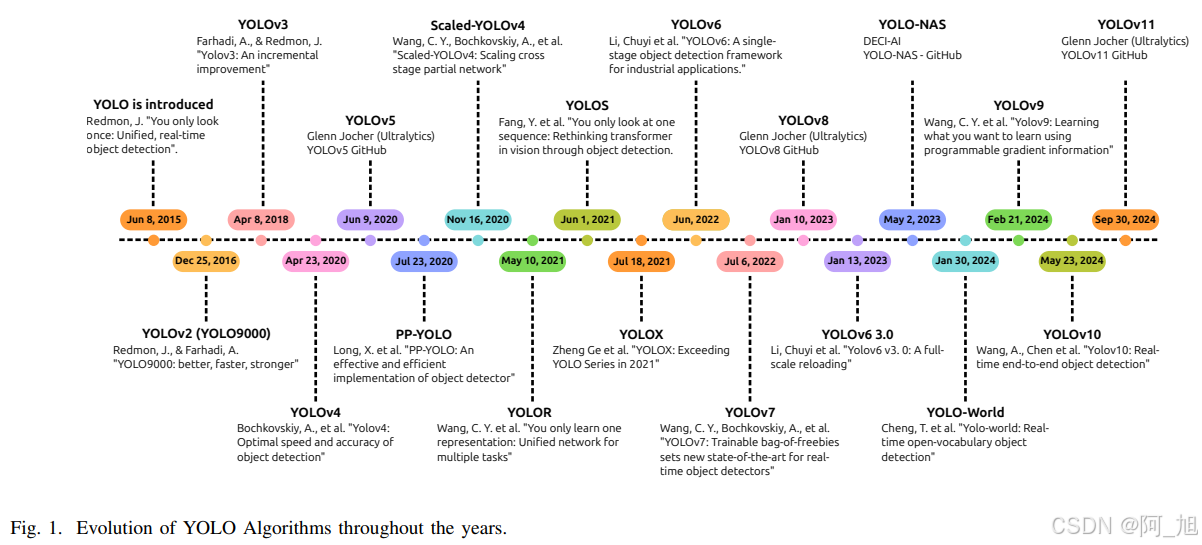

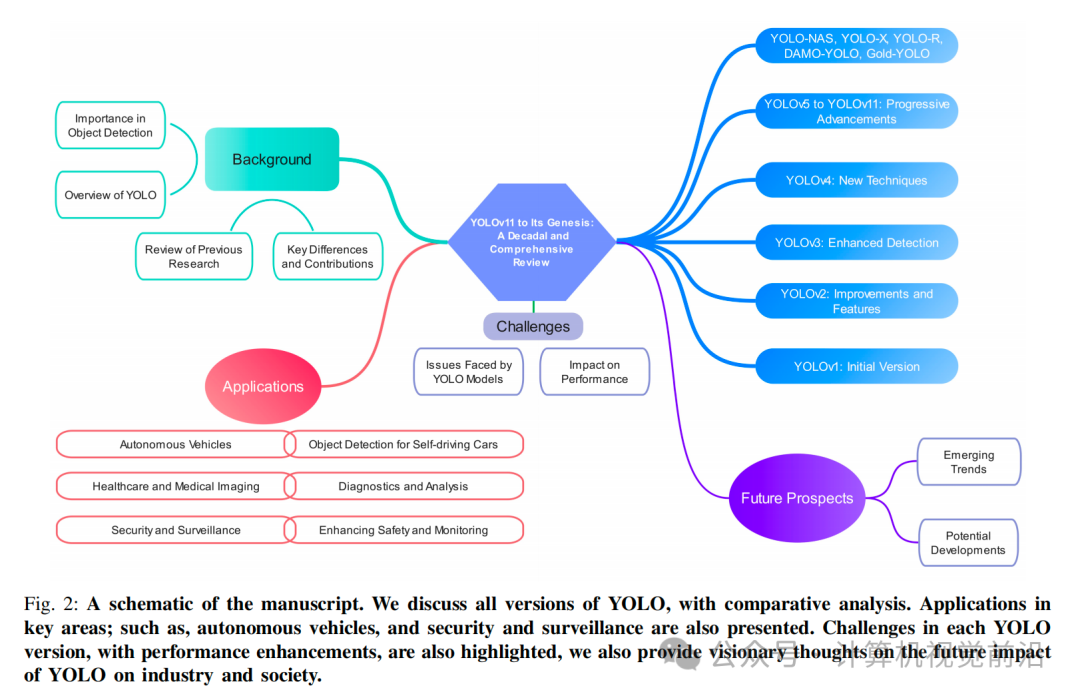

YOLO系列综述研究

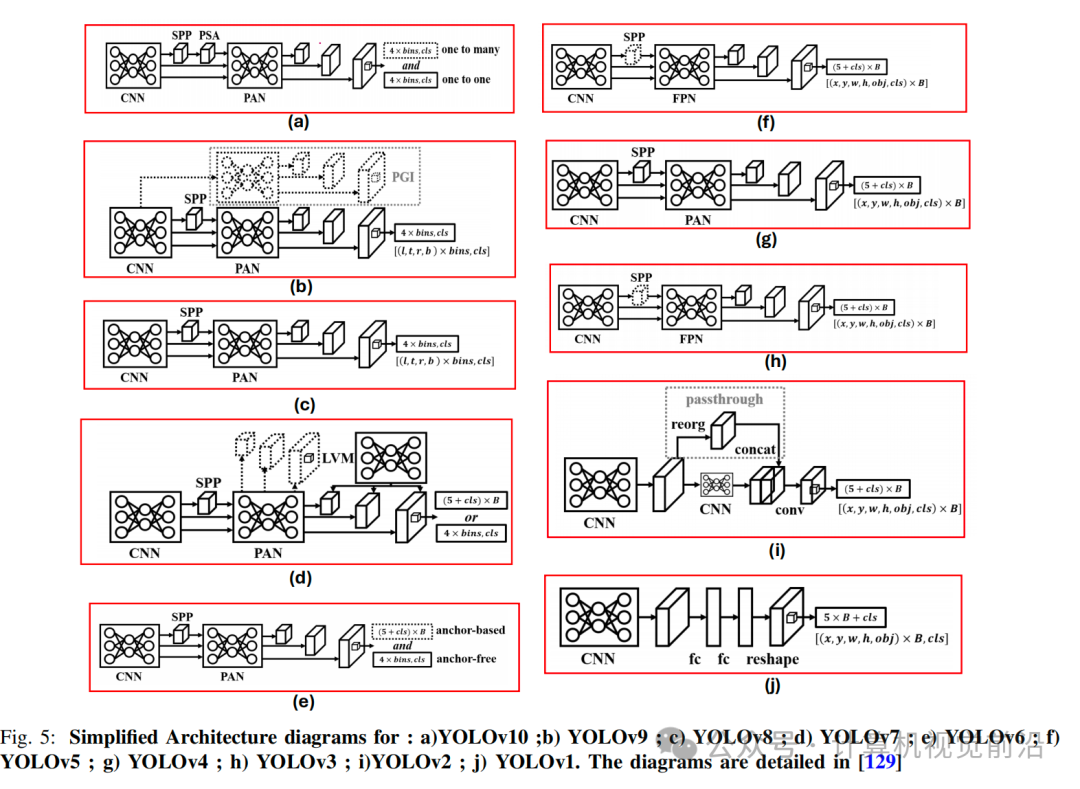

YOLOv1-v10 结构简图

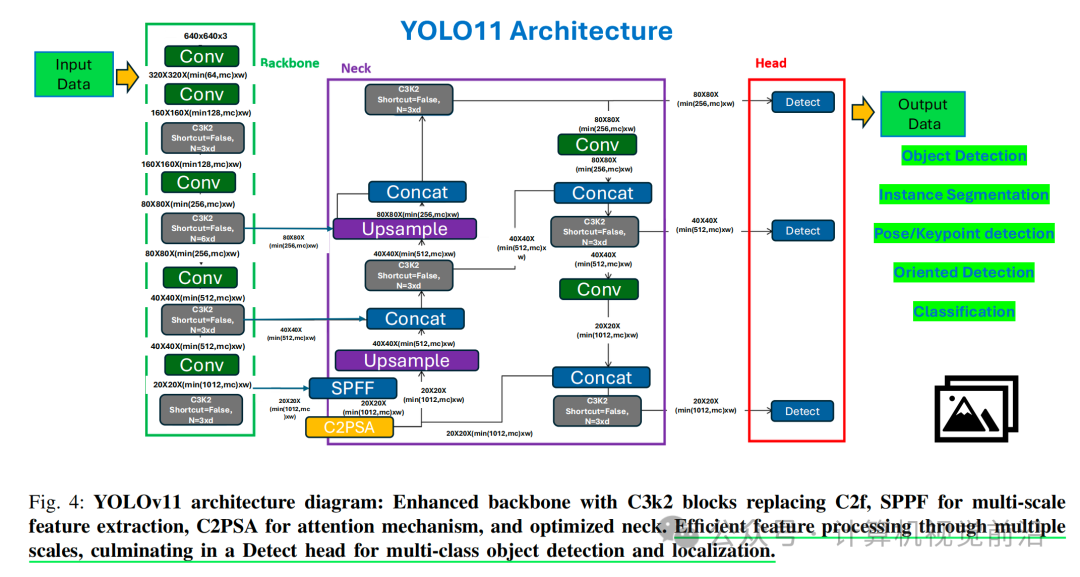

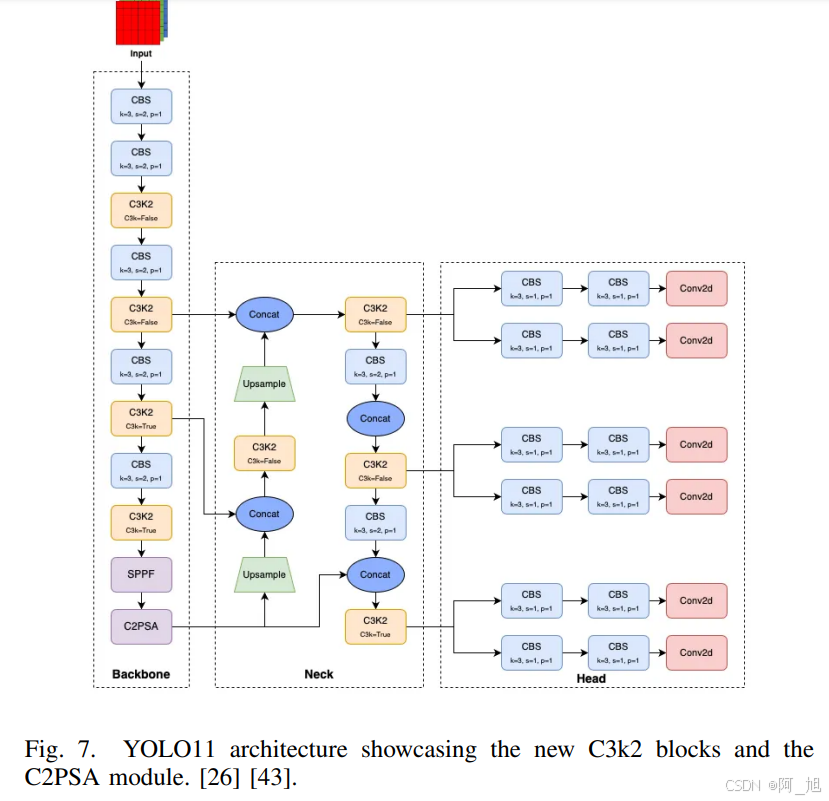

YOLOv11结构图

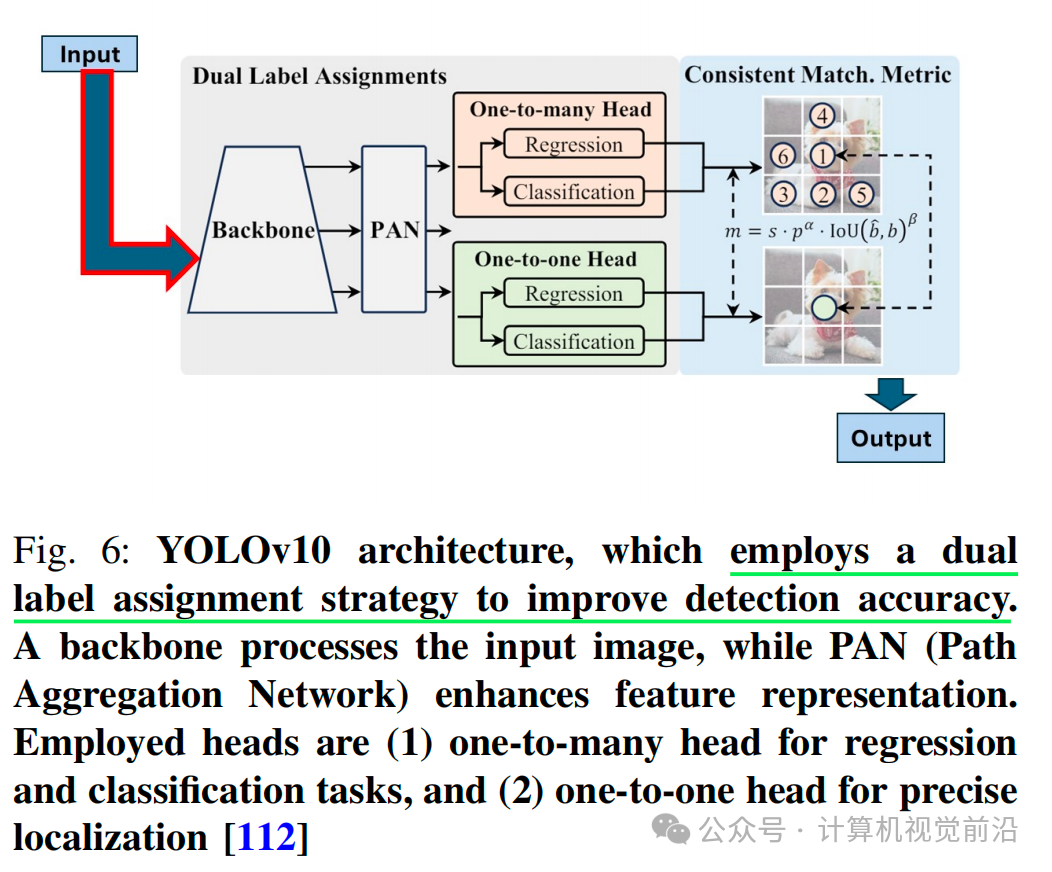

YOLOv10结构图

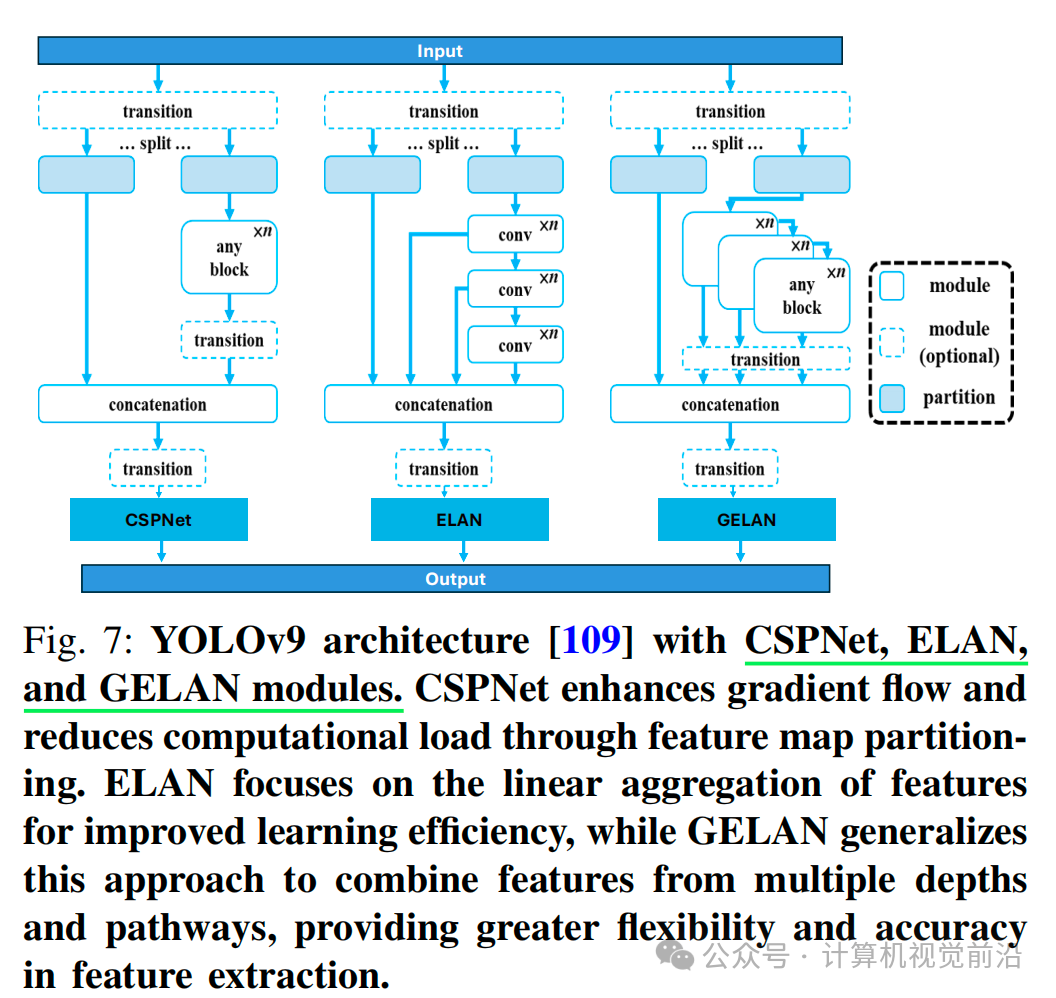

YOLOv9结构图

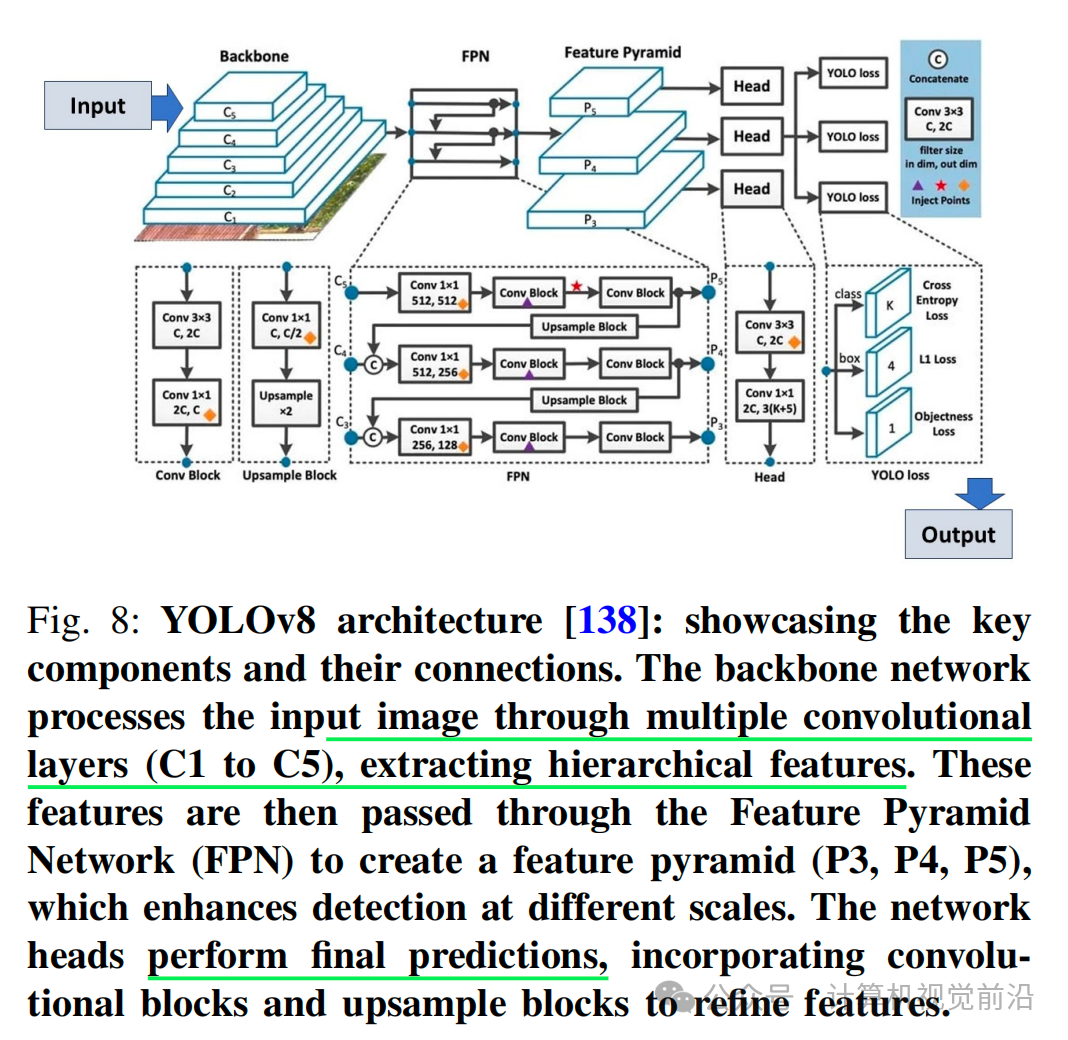

YOLOv8结构图

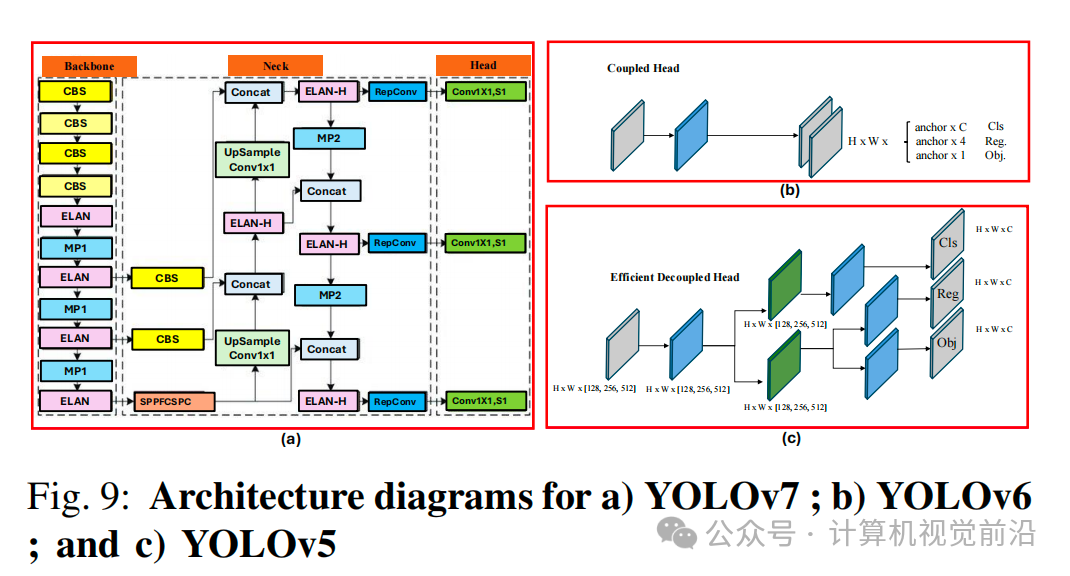

YOLOv7-v6-v5

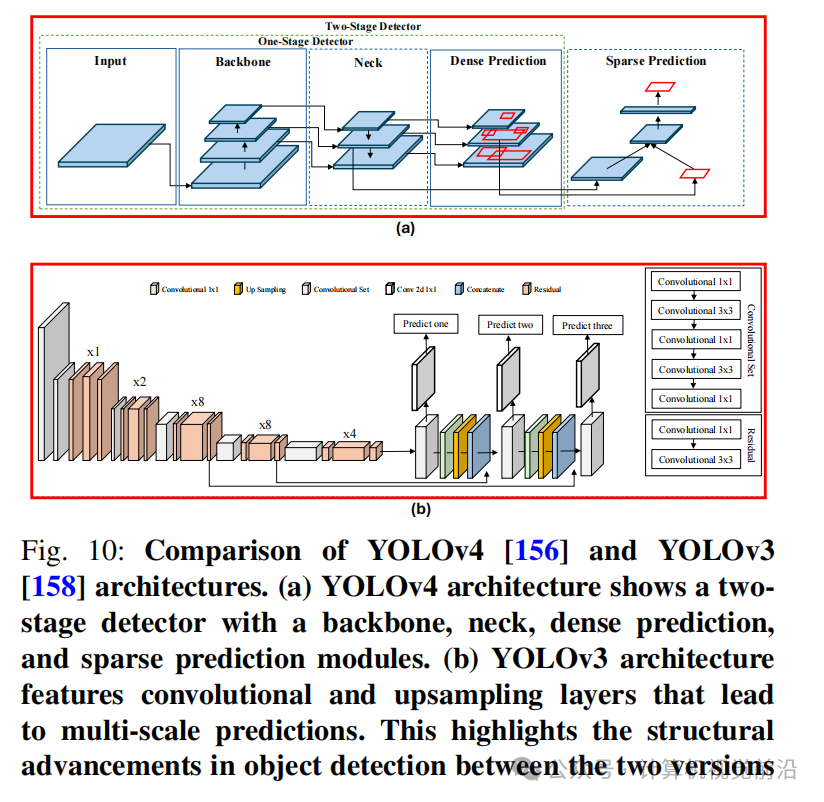

YOLOv4 && YOLOv3

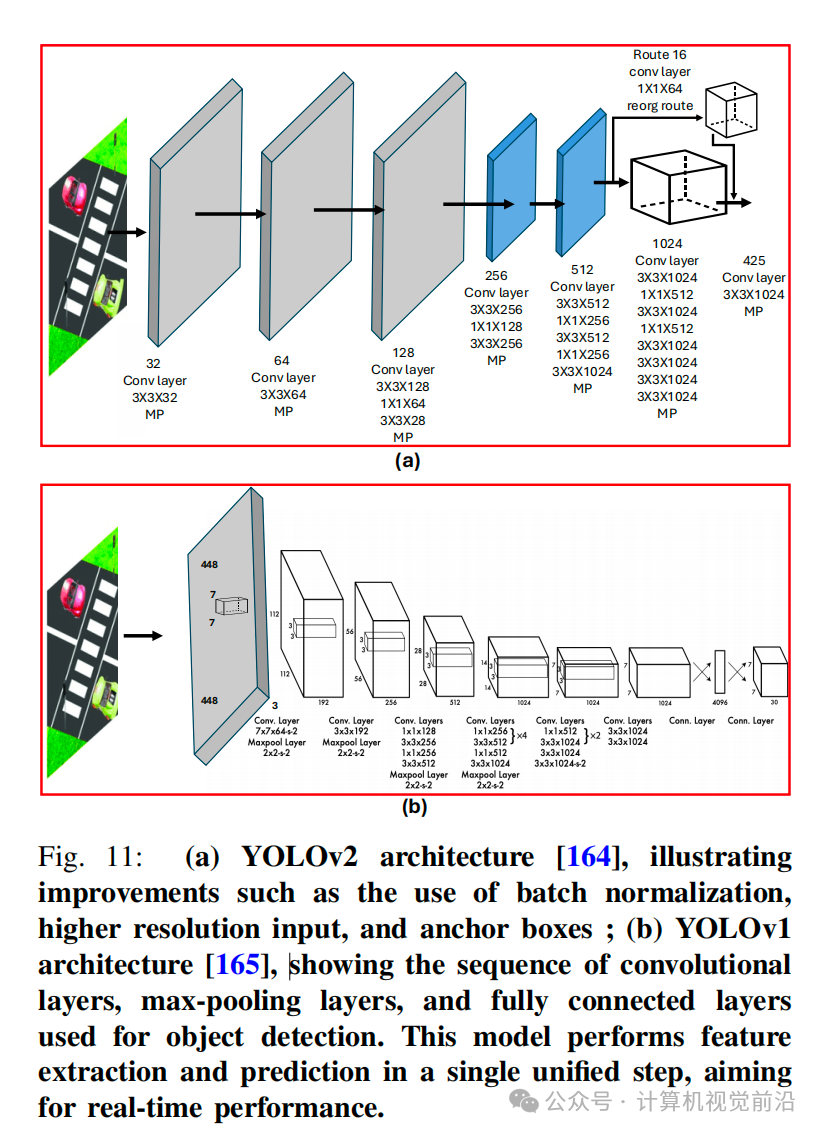

YOLOv2 && YOLOv1

YOLO系列信息汇总

YOLO系列论文代码信息汇总

YOLOv1

论文:“You Only Look Once: Unified, Real-Time Object Detection”

论文地址: https://www.cv-foundation.org/openaccess/content_cvpr_2016/papers/Redmon_You_Only_Look_CVPR_2016_paper.pdf

主要优化点: 将目标检测任务转化为单次前向传播问题,显著提升检测速度 能够以45 FPS的速度处理图像,有一个更快的版本可以达到155 FPS 限制:在小物体检测上的精度较差,且定位误差较高。

YOLOv2 YOLO9000

论文:“YOLO9000: Better, Faster, Stronger”

论文地址: https://arxiv.org/pdf/1612.08242

代码地址: https://pjreddie.com/darknet/yolo/

主要优化点: 能够检测9000种类别物体 多尺度训练增强模型鲁棒性 引入anchor boxes改进对小物体的检测能力

YOLOv3

论文: “YOLOv3: An Incremental Improvement”

论文地址: https://arxiv.org/pdf/1804.02767

代码地址: https://pjreddie.com/yolo/

主要优化点: 引入Darknet-53作为主干网络,结合残差网络提高检测精度 多尺度预测改善对小物体的检测 取消软分类器,使用独立的二元分类器提高性能

YOLOv4

论文:“YOLOv4: Optimal Speed and Accuracy of Object Detection”

论文地址: https://arxiv.org/pdf/2004.10934

代码地址: https://github.com/AlexeyAB/darknet

主要优化点: 提出Bag of Freebies和Bag of Specials优化策略,提高模型精度 CSPDarknet53更高效的主干网络,提升网络推理速度和精度 引入CIoU损失函数提高边界框回归性能

YOLOv5

无论文发表,开源地址https://github.com/ultralytics/yolov5

主要优化点: YOLOv5转向Pytorch框架,便于开发者使用和扩展 自适应的anchor box学习机制提高检测效率 提供多种尺寸的预训练模型满足不同场景需求

YOLOv6

论文: “YOLOv6: A Single-Stage Object Detection Framework for Industrial Applications”

论文地址:https://arxiv.org/pdf/2209.02976

代码地址:https://github.com/meituan/YOLOv6

主要优化点: 针对行业应用优化,尤其注重推理速度 引入EfficientRep带来更高效的网络架构 优化模型部署性能,适合工业环境中的大规模应用

YOLOv7

论文:YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors

论文地址 https://openaccess.thecvf.com/content/CVPR2023/papers/Wang_YOLOv7_Trainable_Bag-of-Freebies_Sets_New_State-of-the-Art_for_Real-Time_Object_Detectors_CVPR_2023_paper.pdf

代码地址: https://github.com/ WongKinYiu/yolov7.

主要优化点: 在COCO数据集上达到新的速度与精度平衡 跨尺度特征融合提高对不同尺度物体的检测能力 改进训练过程中的标签分配方式提高训练效率

YOLOv8

发布日期:2023年1月

作者:Ultralytics团队

无论文发表,开源地址:[https://github.com/ultralytics/ultralytics]

主要优化点: 提供可定制的模块化设计方便用户根据需求进行扩展 内置多种训练和超参数优化策略简化模型调优过程 集成检测、分割和跟踪功能

YOLOv9

发布日期:2024年2月

作者/贡献者:WongKinYiu等

论文:YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information

论文地址 https://arxiv.org/pdf/2402.13616

代码地址:https://github.com/WongKinYiu/yolov9

主要优化点: 可编程梯度信息(PGI)+广义高效层聚合网络(GELAN)。 与YOLOv8相比,其出色的设计使深度模型的参数数量减少了49%,计算量减少了43%,但在MS COCO数据集上仍有0.6%的AP改进。

YOLO v10

发布日期:2024年5月

作者:清华大学

论文:YOLOv10: Real-Time End-to-End Object Detection

论文地址: https://arxiv.org/pdf/2405.14458

代码地址: https://github.com/THU-MIG/yolov10

主要优化点:

实时端到端的对象检测,主要在速度和性能方面的提升

YOLO v11

发布日期:2024年9月

作者:Ultralytics团队

无论文发表,开源地址:https://github.com/ultralytics/ultralytics

主要优化点: YOLOv11继承自YOLOv8,在YOLOv8基础上进行了改进,使同等精度下参数量降低20%,在速度和准确性方面具有无与伦比的性能。 其流线型设计使其适用于各种应用,并可轻松适应从边缘设备到云 API 等不同硬件平台。使其成为各种物体检测与跟踪、实例分割、图像分类和姿态估计任务的绝佳选择。

YOLO v12

YOLOv12: Attention-Centric Real-Time Object Detectors 代码地址: https://github.com/sunsmarterjie/yolov12 主要优化点: 首次把注意力机制引入单阶段目标检测框架并在速度和性能上取得新的突破。为单阶段目标检测领域开辟新的战场。

性能对比示例

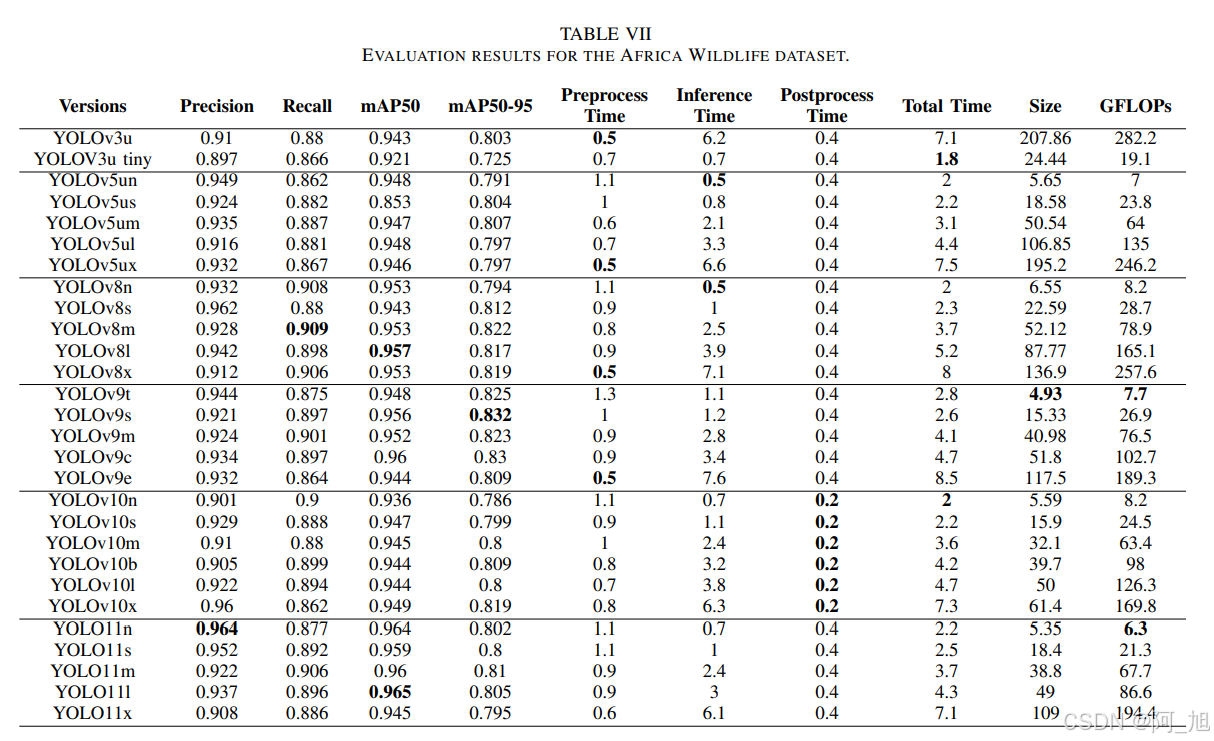

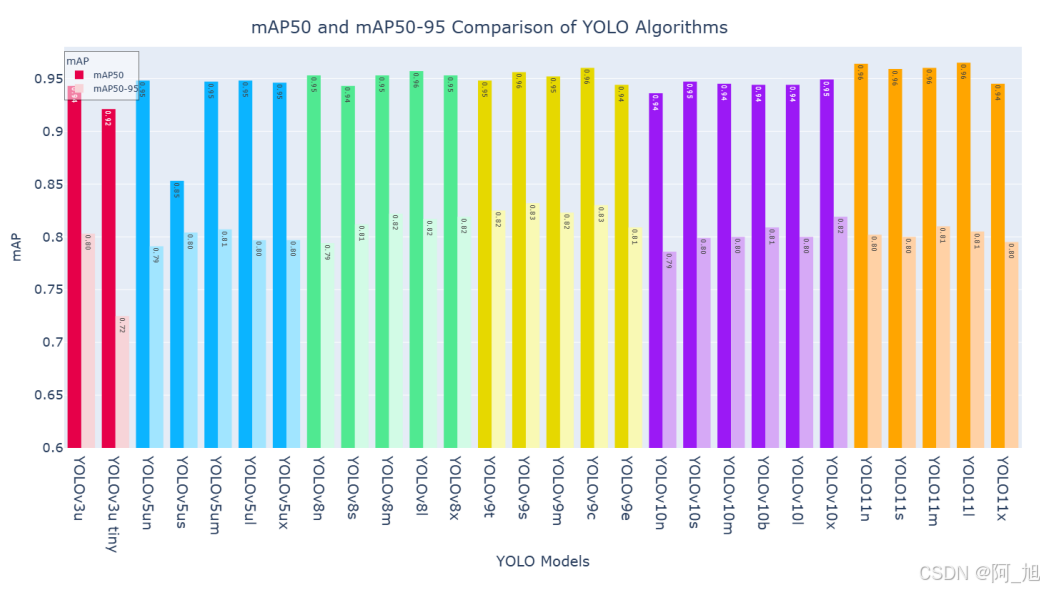

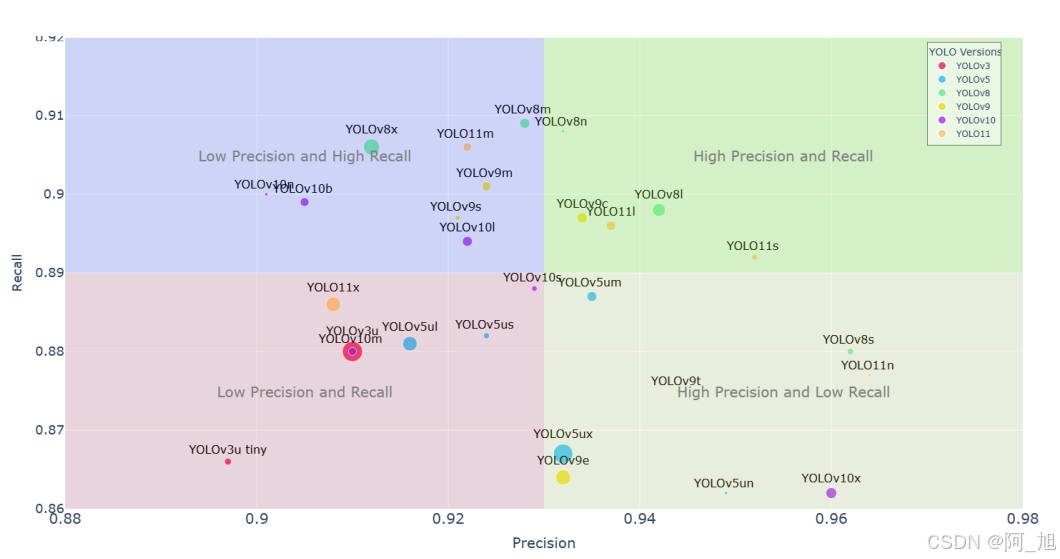

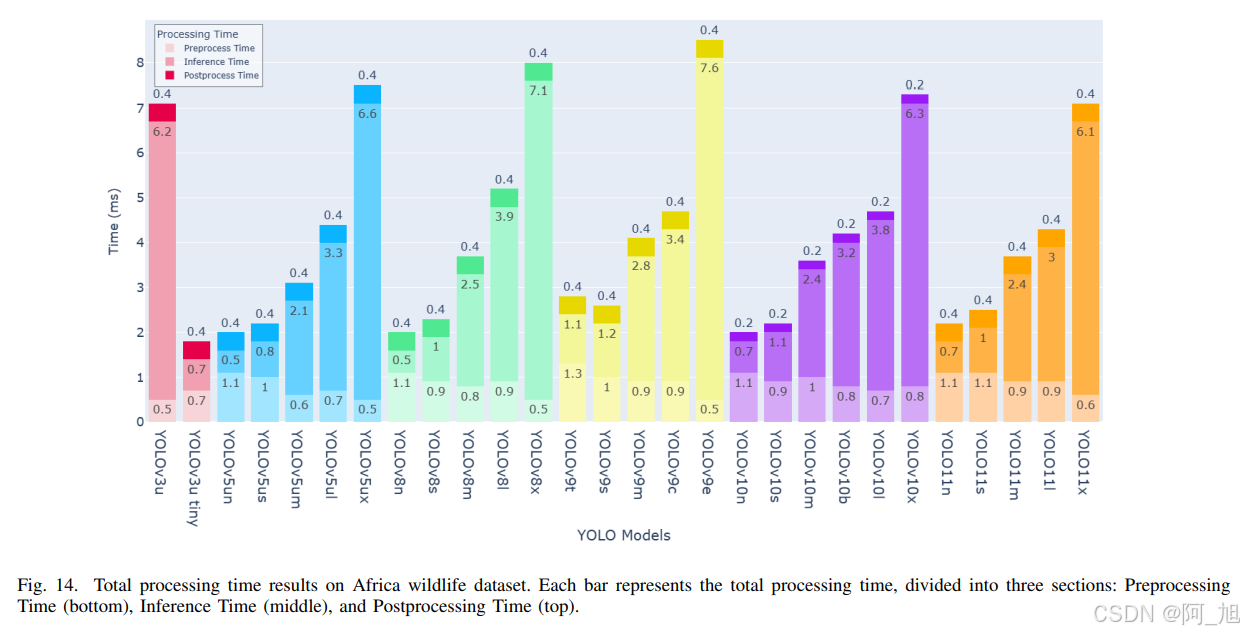

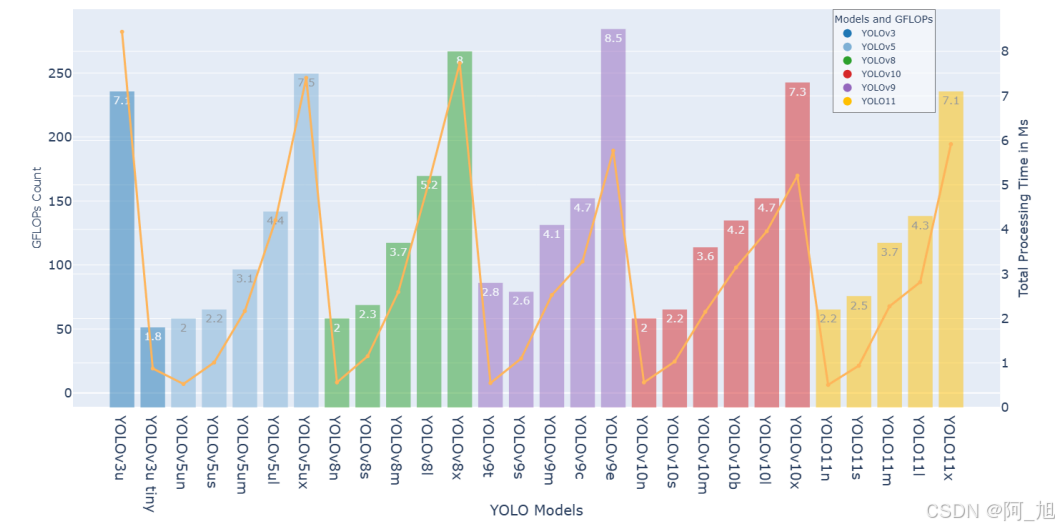

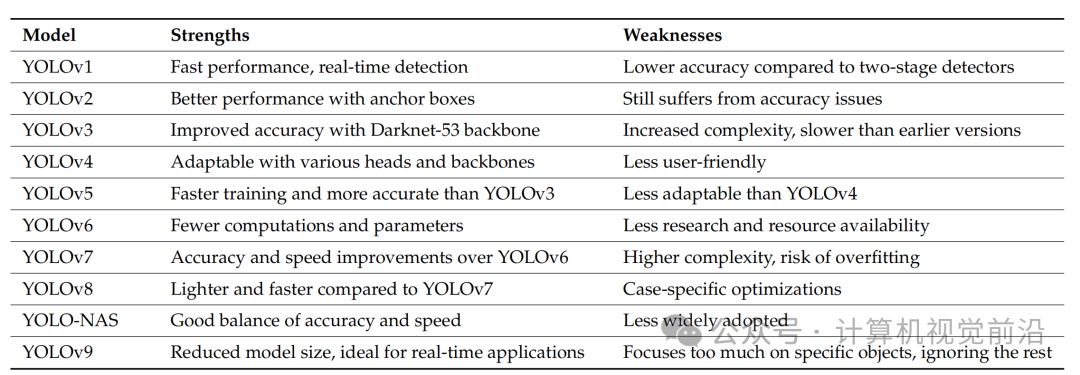

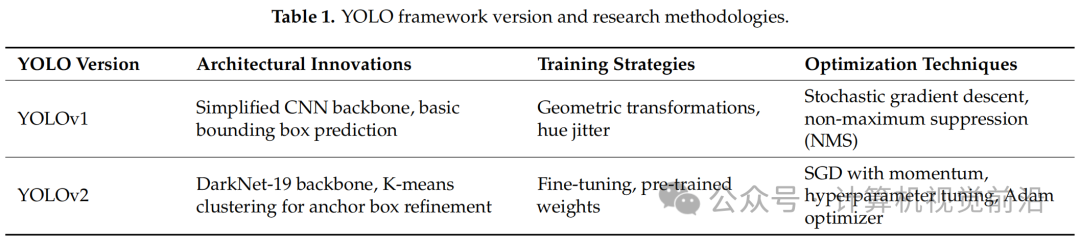

参考文章: the Evolution of YOLO (You Only LookOnce) Models: A Comprehensive Benchmark Study of YOLO11 and Its Predecessors

在非洲野生动物数据集(Africa Wildlife Dataset)上的各项性能对比示例。

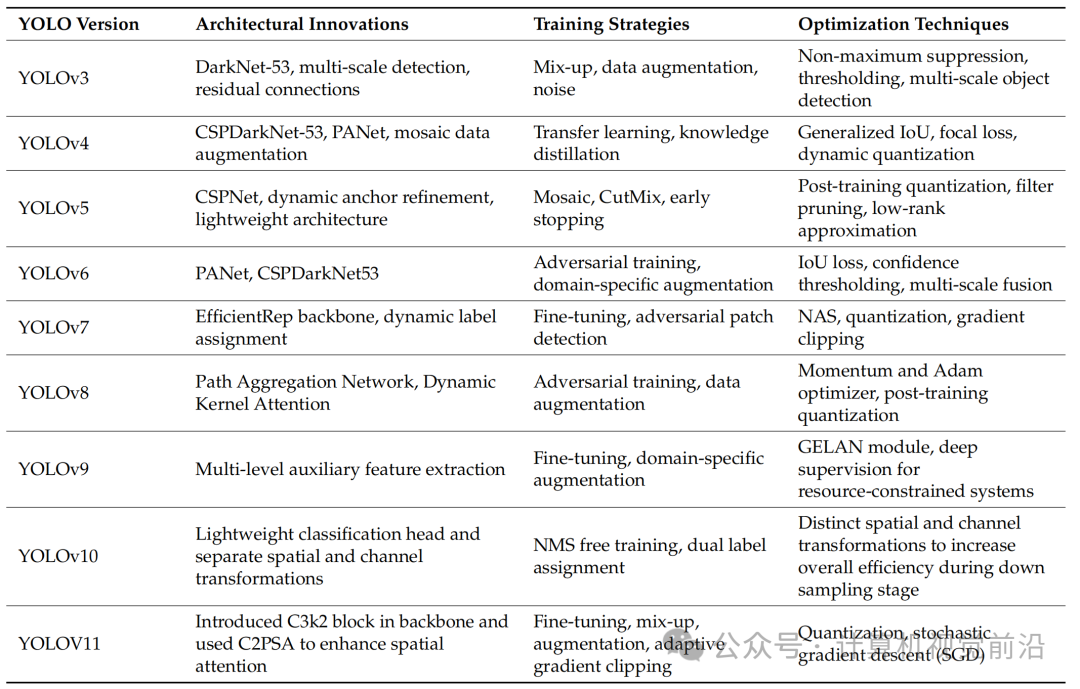

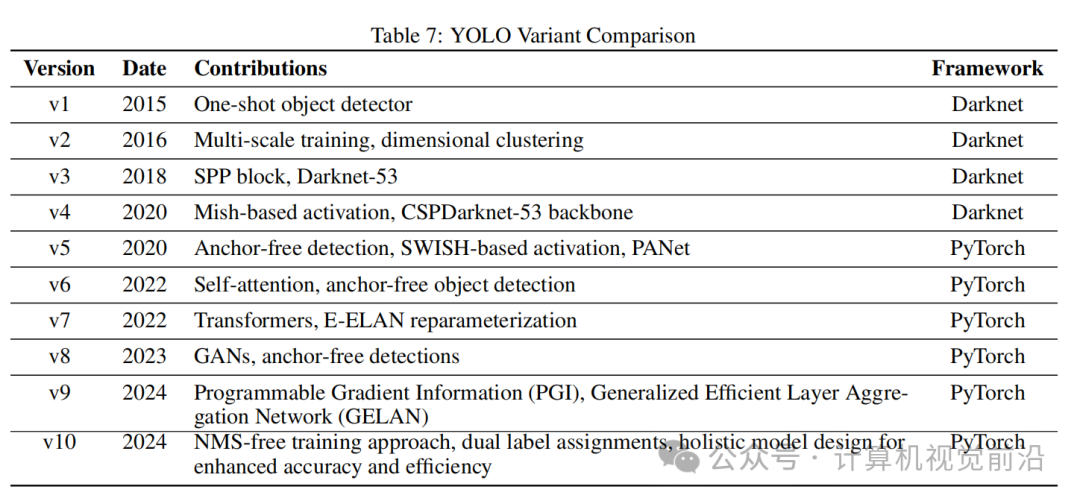

整体性能对比表格

mAP50与mAP50-95对比

Recall与Precision对比

推理时间

计算量对比

优缺点汇总

实现框架

文章中的相关文章,已经打包整理,需要的小伙伴可自行获取。

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!

2986

2986

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?