从UE5内部的Bridge下载数字人的方法

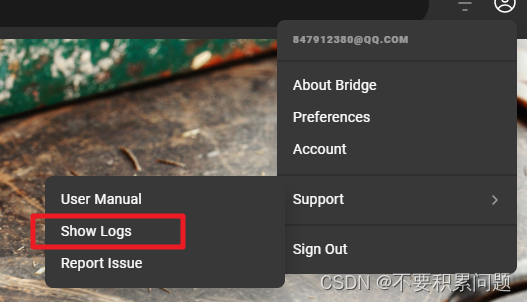

先尝试从bridge下载,使得它至少有1%的进度,在bridge中右上角

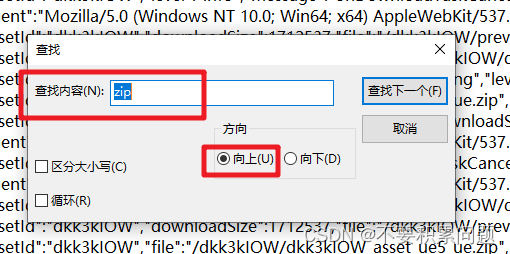

打开log笔记本,光标放到最后一行,查找“zip”关键词

复制含有zip的url链接,放到浏览器下载就可以了

官方教程:

超人类文档 |Epic开发者社区 (epicgames.com)的

B站数字人相关教程

[技术专题]在UE里使用ControlRig制作MetaHumans动画(官方字幕)_哔哩哔哩_bilibili

[技术专题]在UE中使用MetaHuman面部绑定 | Using the MetaHuman Facial Rig in UE(官方字幕)_哔哩哔哩_bilibili

面部捕捉教程缩短版:

注意要在统一个WiFi下

快速用metahuman做个自己并导入ue5面部捕捉_哔哩哔哩_bilibili

【UE】Live Link Face数字人面部捕捉_哔哩哔哩_bilibili

身体动补:

为 MetaHuman 添加摄像头动捕(简介中有完成后的项目文件)_哔哩哔哩_bilibili

【Blender】图像建模,真人写实还原(FaceBuilder)_哔哩哔哩_bilibili

6.15 Metahuman Animator发布最新更新

【UE】期盼已久的MetaHuman Animator终于发布,教程安排上_哔哩哔哩_bilibili

准备工作:

1.苹果手机用live link face录制两小段视频:一段用来人脸建模(需要1注视镜头的正面、已经左面+右面、以及尽可能露出牙齿的镜头),把数据放到工程目录下新建的iPhone文件夹中

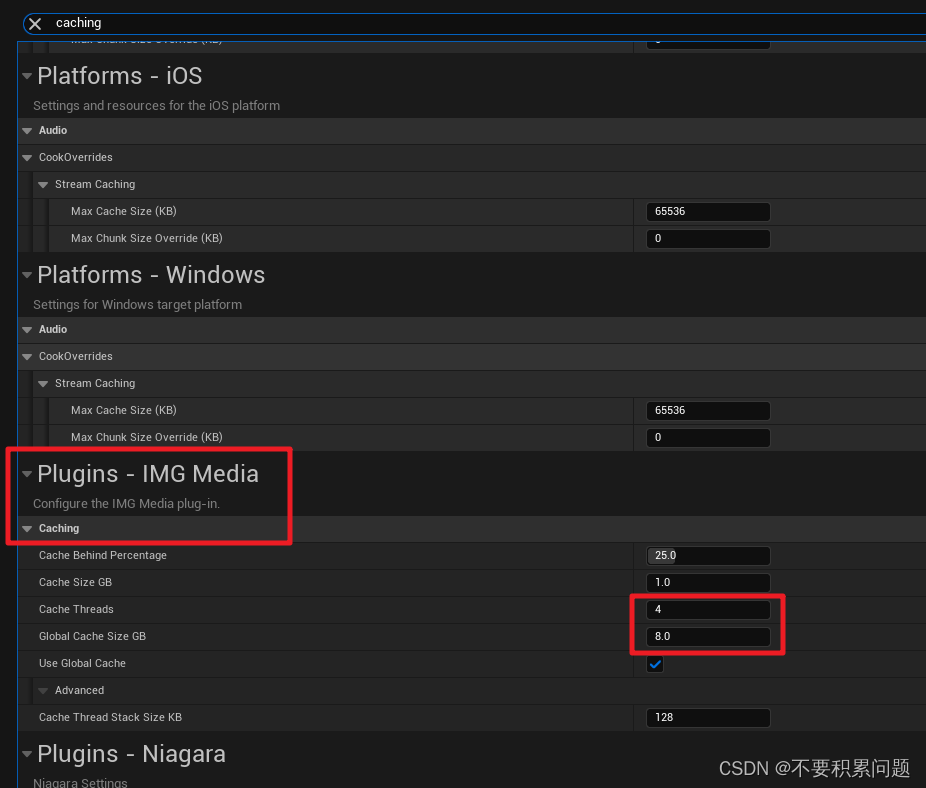

2.将虚幻引擎五里面的IMG Media的数值改成4 和 8(大一点的数值)

大纲

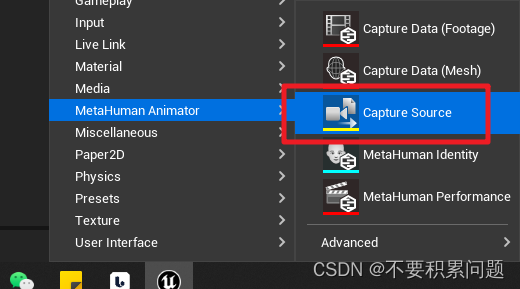

1.CaptureData

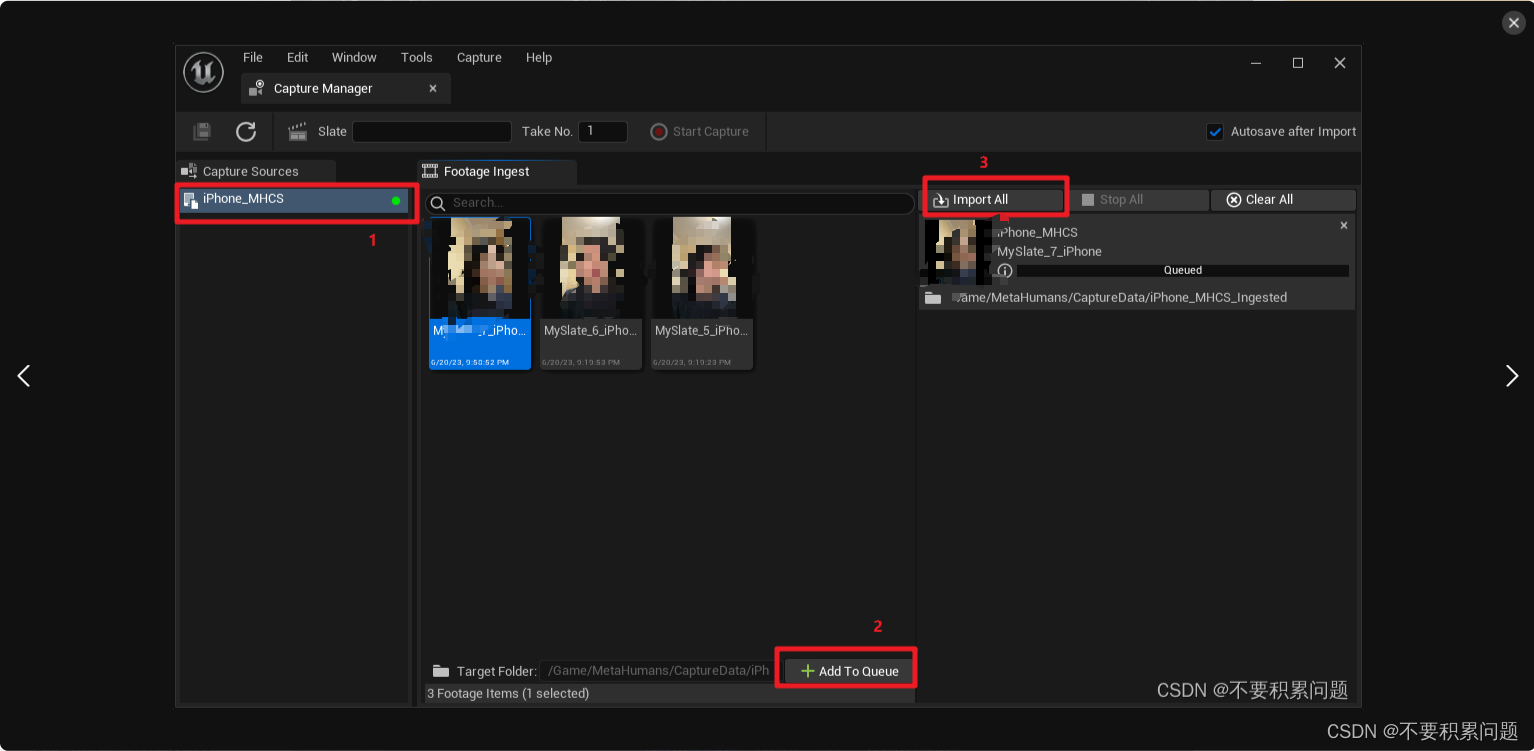

新建一个capture source,命名为iPhone_MHCS

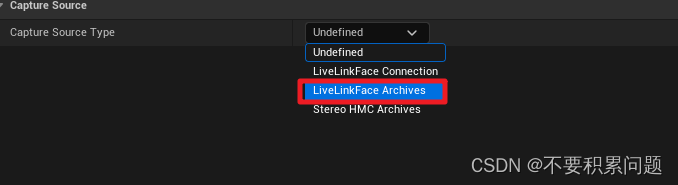

打开iPhone_MHCS,选择LiveLinkFace Archives, 下面的路径选择放了录制视频的文件夹

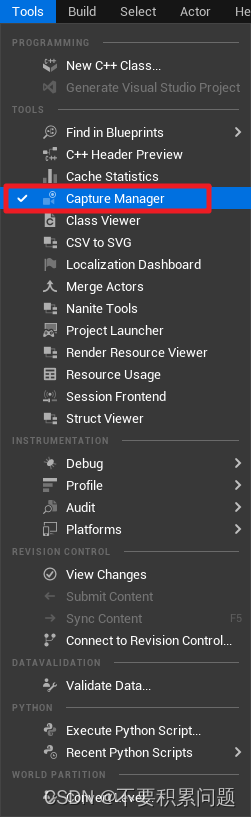

打开工具下的capture Manager

导入

2.CaptureSources

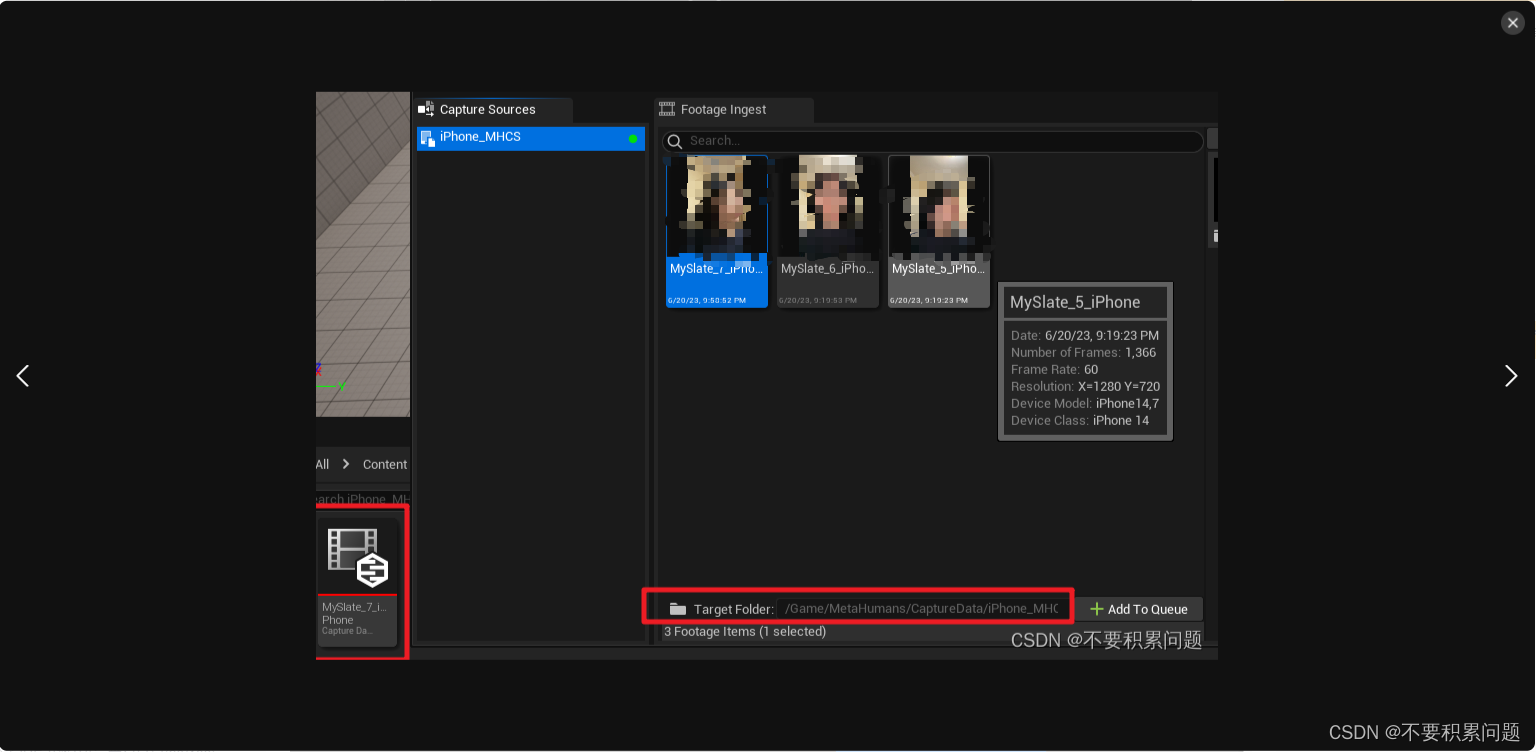

在导入成功之后可以在设置的路径底下看到一个这么个东西,重命名为GG_CS

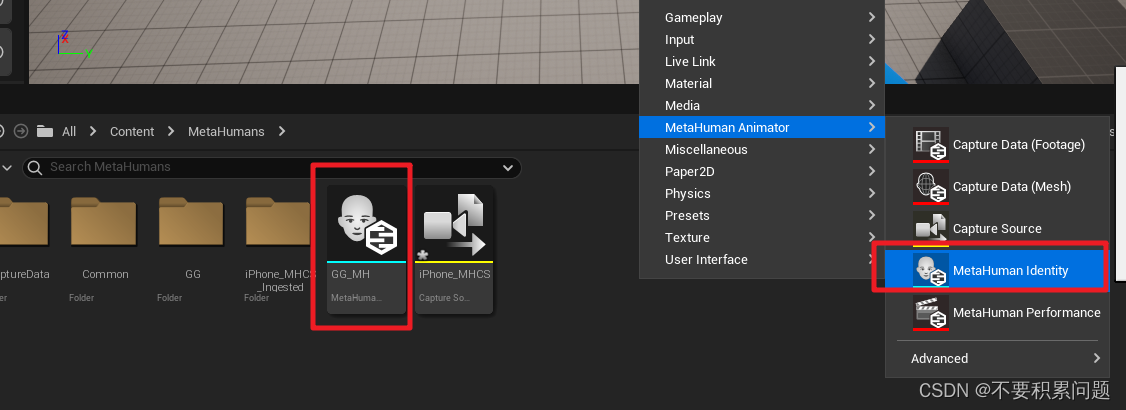

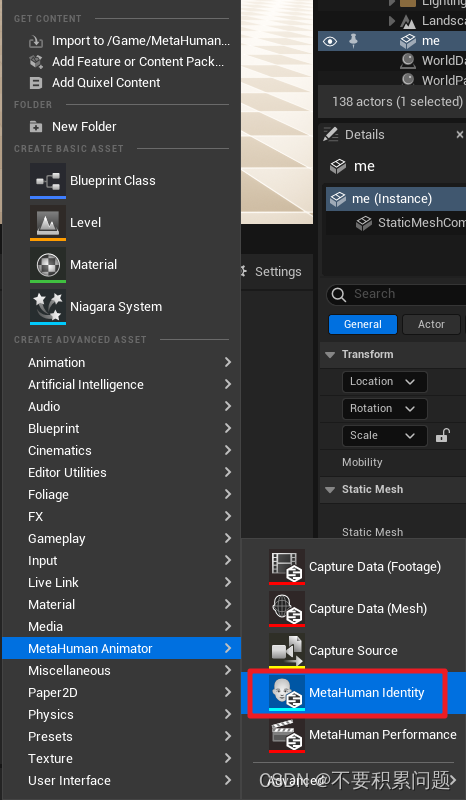

3.Metahuman identity

3.Metahuman identity

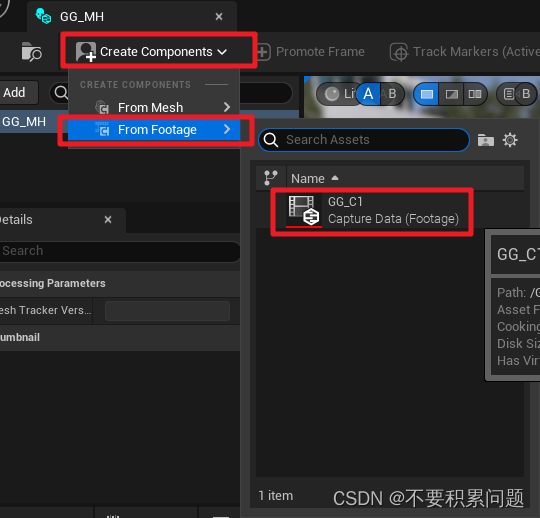

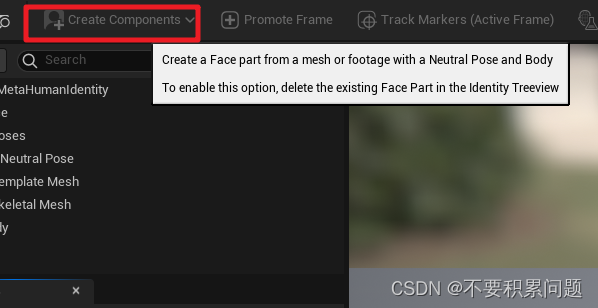

新建一个Metahunman Identity重命名为GG_MHID,打开

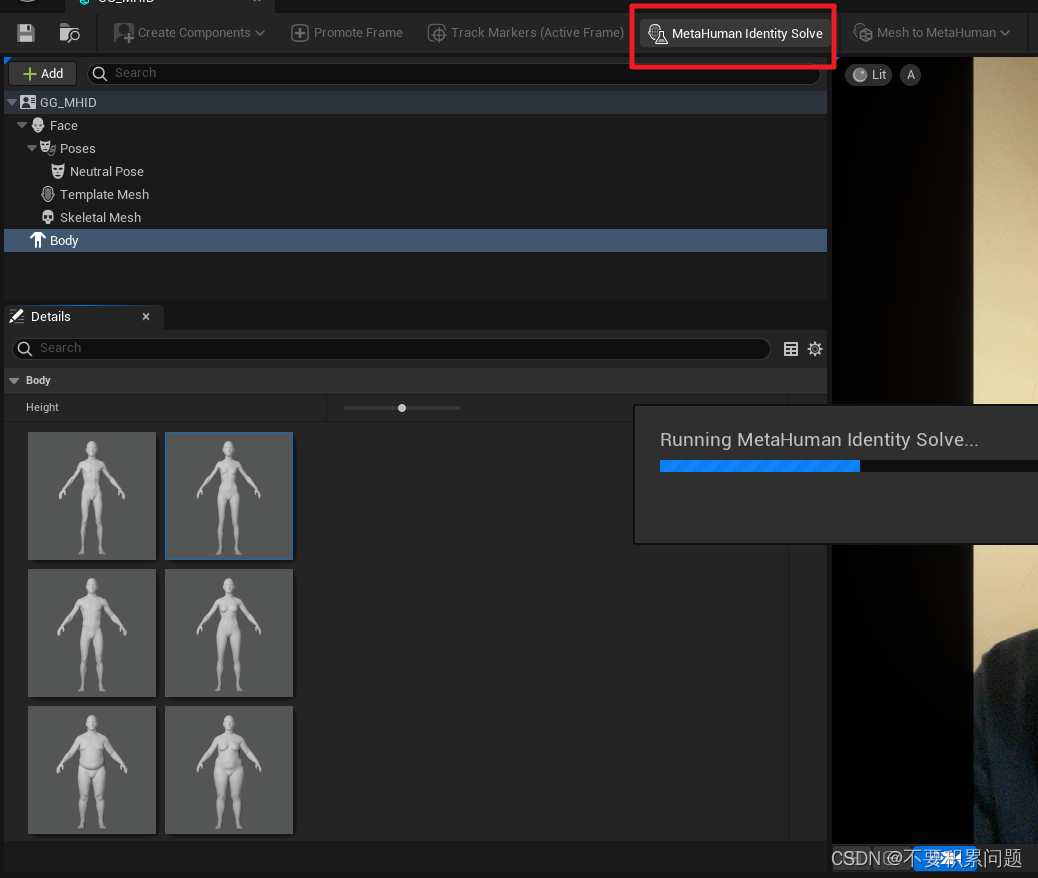

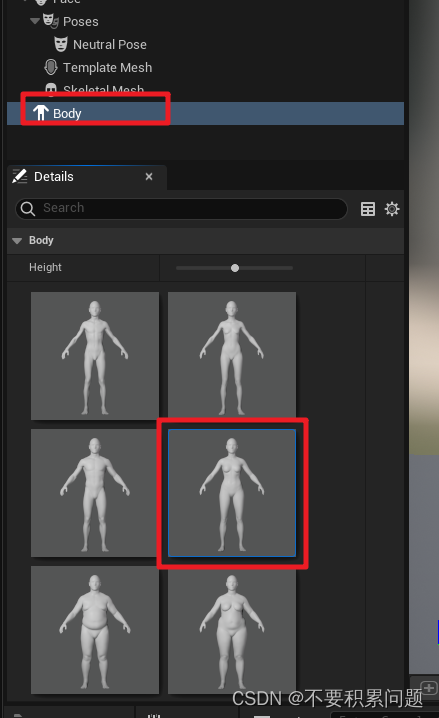

选择身体,选择解算

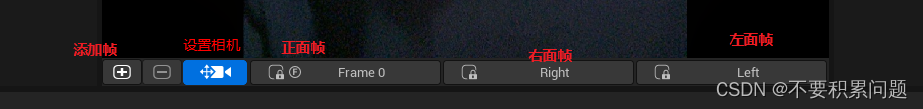

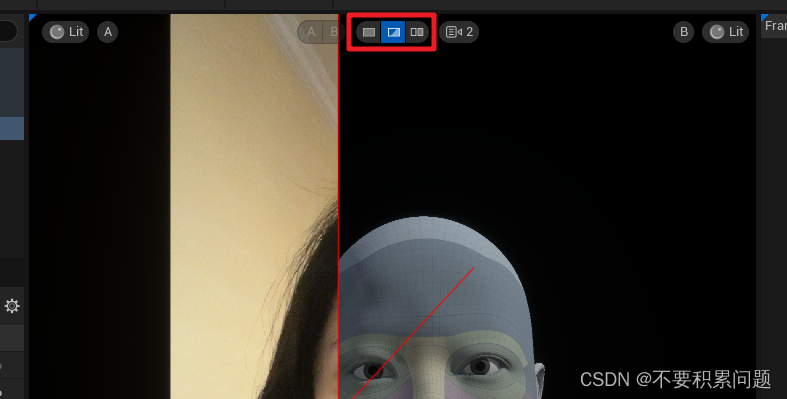

解算完毕可以通过上面这一栏观察生成好的模型,拖动上面的两条线可以调节对比度和位置

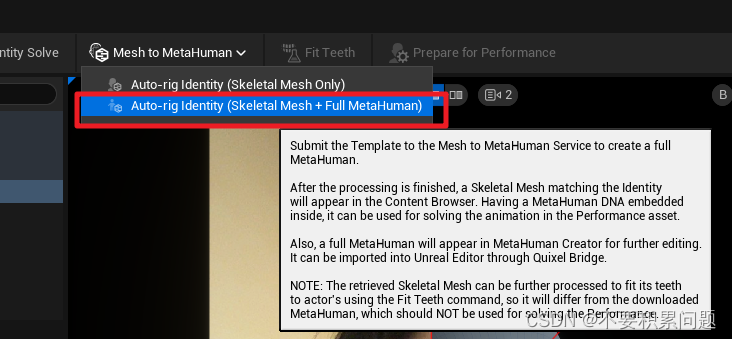

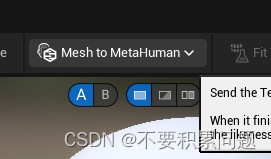

选择Mesh to MetaHuman的第二栏,将人物上传云平台

选择Mesh to MetaHuman的第二栏,将人物上传云平台

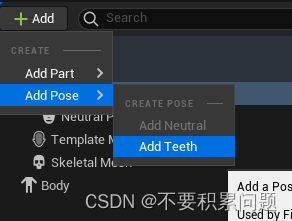

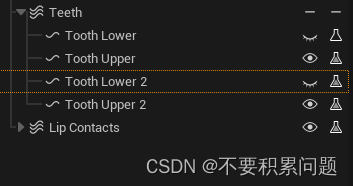

成果上传后,添加模型牙齿

点击牙齿栏,选择露牙的那一帧添加帧

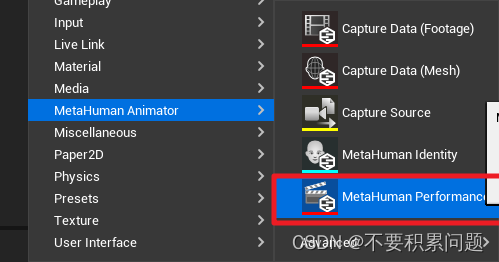

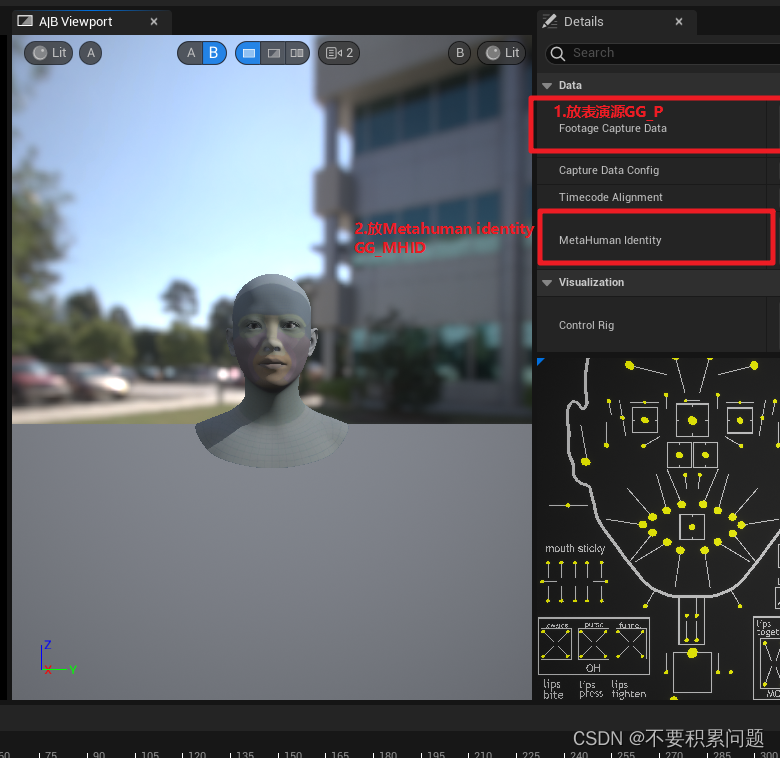

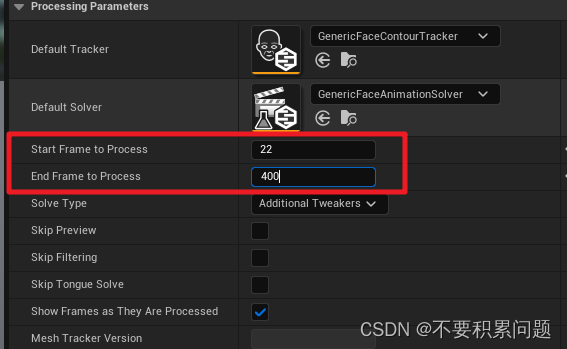

4.Metahuman_Performances

重复上面的1.2操作,把表演的视频数据也导入,重命名为GG_P

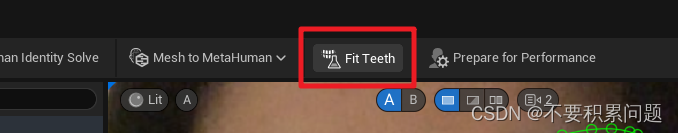

贴合牙齿之后,然后点击准备表演选项(Prepare for Performance)

生成完毕之后,新建一个表演来源,重命名为Performance_MHP,并打开

选择要表演的片段

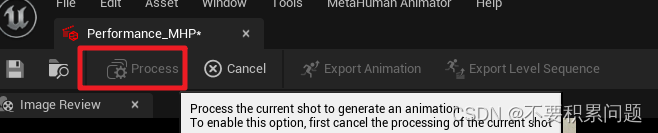

左上角点开始运行

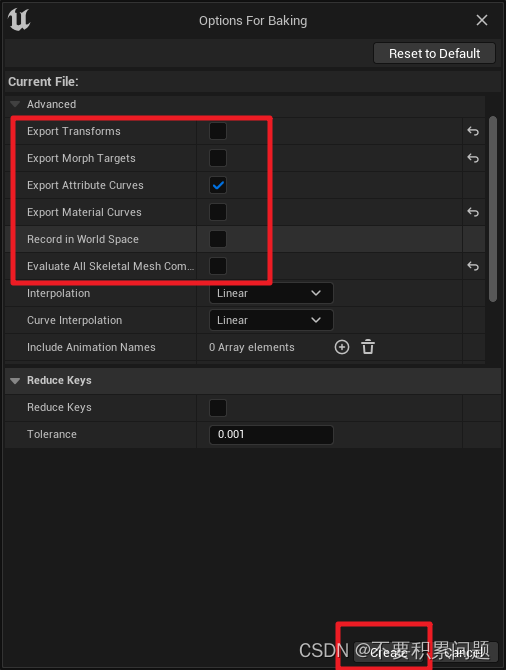

然后就有两种导出方式

![]()

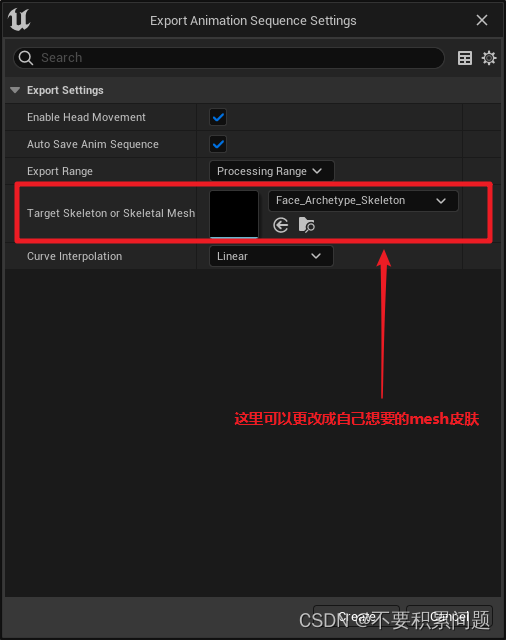

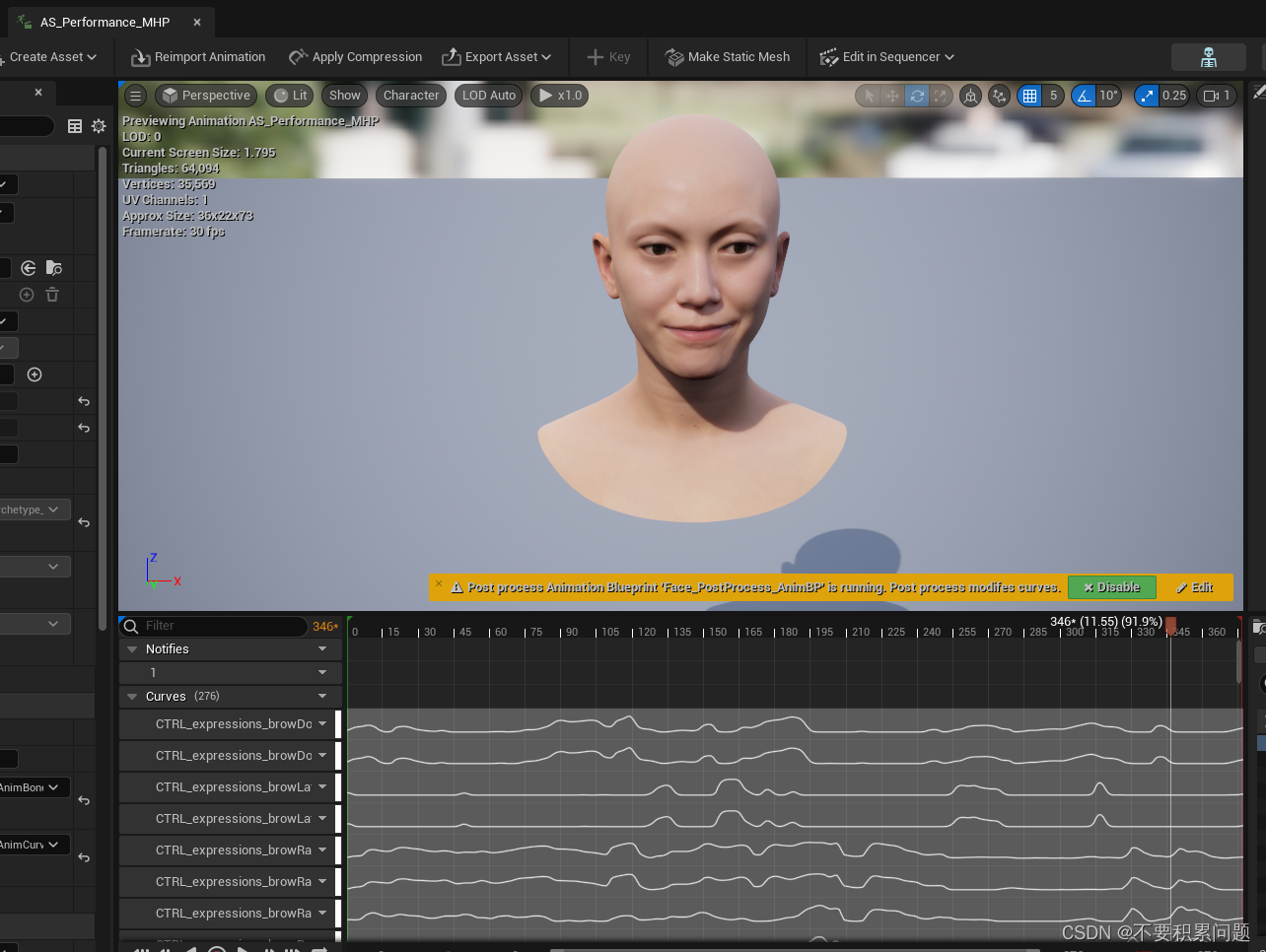

Export Aniamtion的形式

可以用已有的metahuman的皮肤

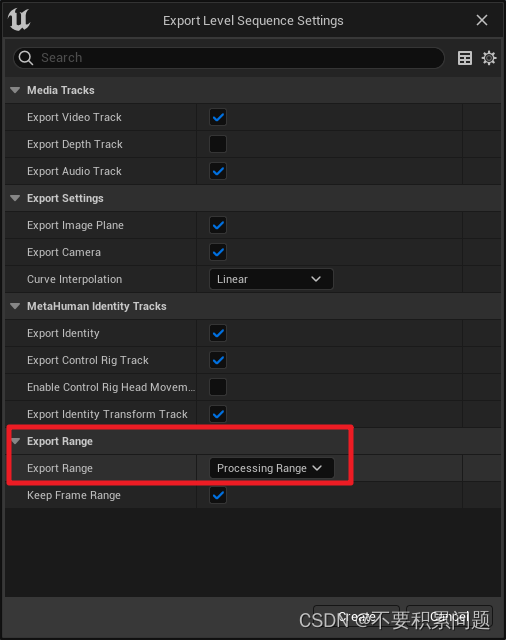

Export Level Sequence的形式是输出到一个新关卡里

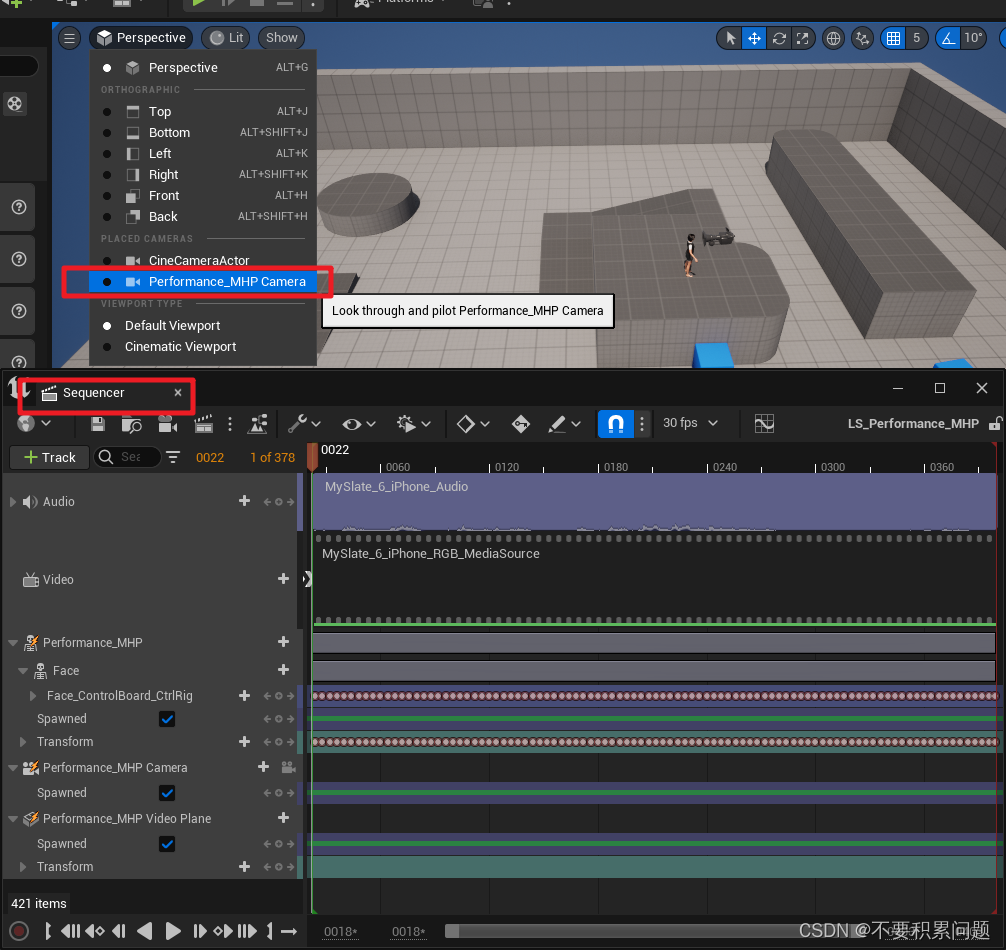

打开导出的关卡之后,把摄像机调为表演的摄像机就能看见

修改绑定

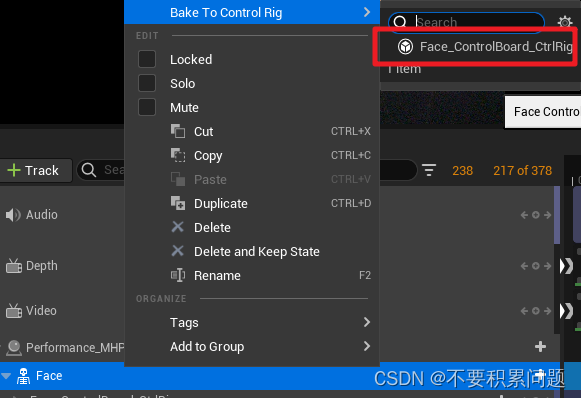

在Performance_MHP中对face右键选中Face_ControlBoard_CtrRig

其他学习笔记

官网地址

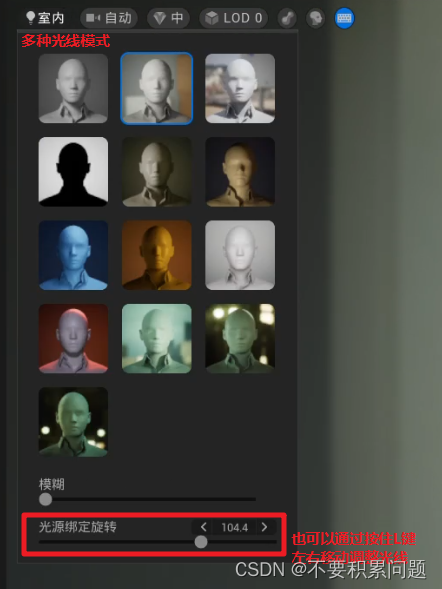

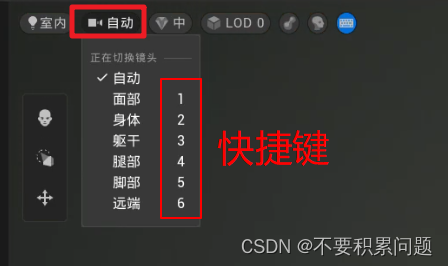

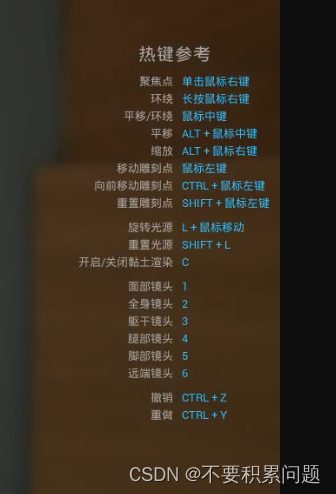

视图窗口

环境类

- 环境

- 摄像机镜头

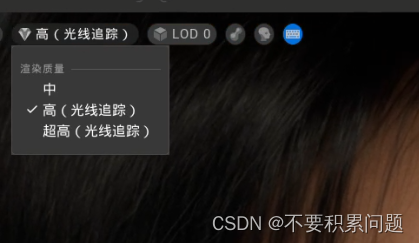

- 渲染质量

因为是云端渲染,所以渲染质量不受本地电脑配置的影响

- LOD

LOD0是最高,LOD7为低模

使用发片可以节省性能,但是质量也会稍差一点

自动LOD会根据摄像头距离自动调整LOD的类型

- 是否打开白膜渲染,是否关掉头发

关掉头发可以暴露被头发遮挡的脸,使用白膜模式可以更清晰的看到嘴巴和眼睛的形状

- 窗口右边的快捷键

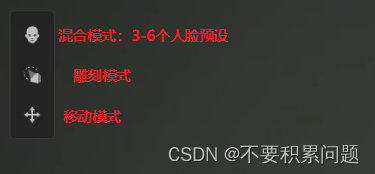

雕塑类

视图窗口

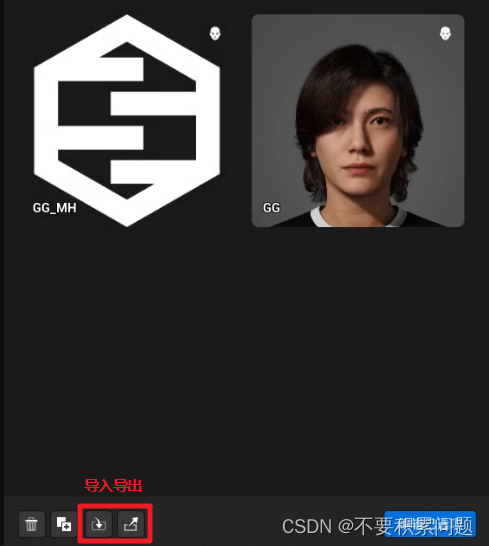

如果想给别人分享你的数字人,你可以从数字人系统用.mhb的格式拷贝导出一份,其他人也可以将这个导入MHC。

注意:你不能将.mhb格式直接导入到虚幻引擎。如果想要下载导入数字人到虚幻引擎,必须得用Quixel Bridge。

选择版本

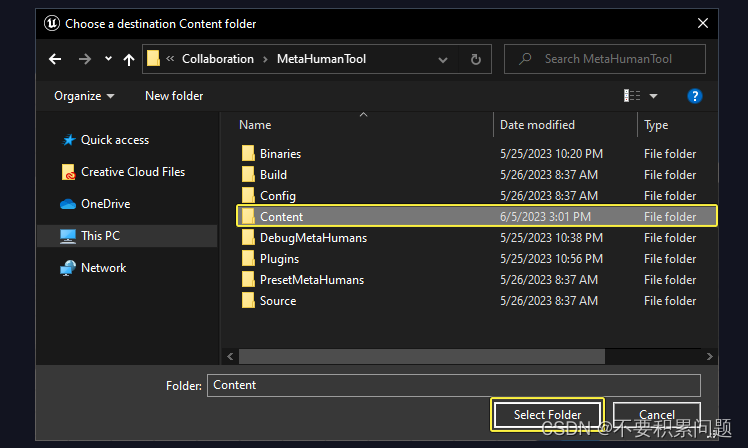

放文件的位置

数字人和虚幻引擎的工程转换版本

打开低版本的UE工程,选中数字人文件夹,右键转移

放进高版本的UE工程的content文件夹中

导入数字人

导入数字人

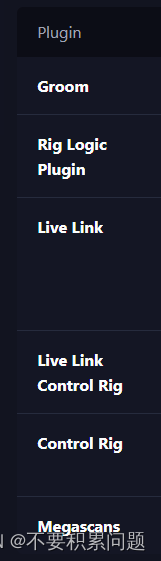

所需插件

阿光的数字人教程

照片生成数字人(Agisoft Metashape/Blender插件/RealityCapture)

推荐Blender插件

软件:Agisoft Metashape

1.拍摄一个物体不同角度的照片

2.在软件里上传照片

3.生成点云,删除多余的点云

4.生成网格

5.生成纹理,调整贴图的大小

6.导出模型

记得勾选导出纹理

Blender插件FaceBuilder

【Blender】图像建模,真人写实还原(FaceBuilder)_哔哩哔哩_bilibili

导入fbx模型和贴图

导入MetaHuman ID

在MetaHuman导入mesh

摄像机视野推荐:20

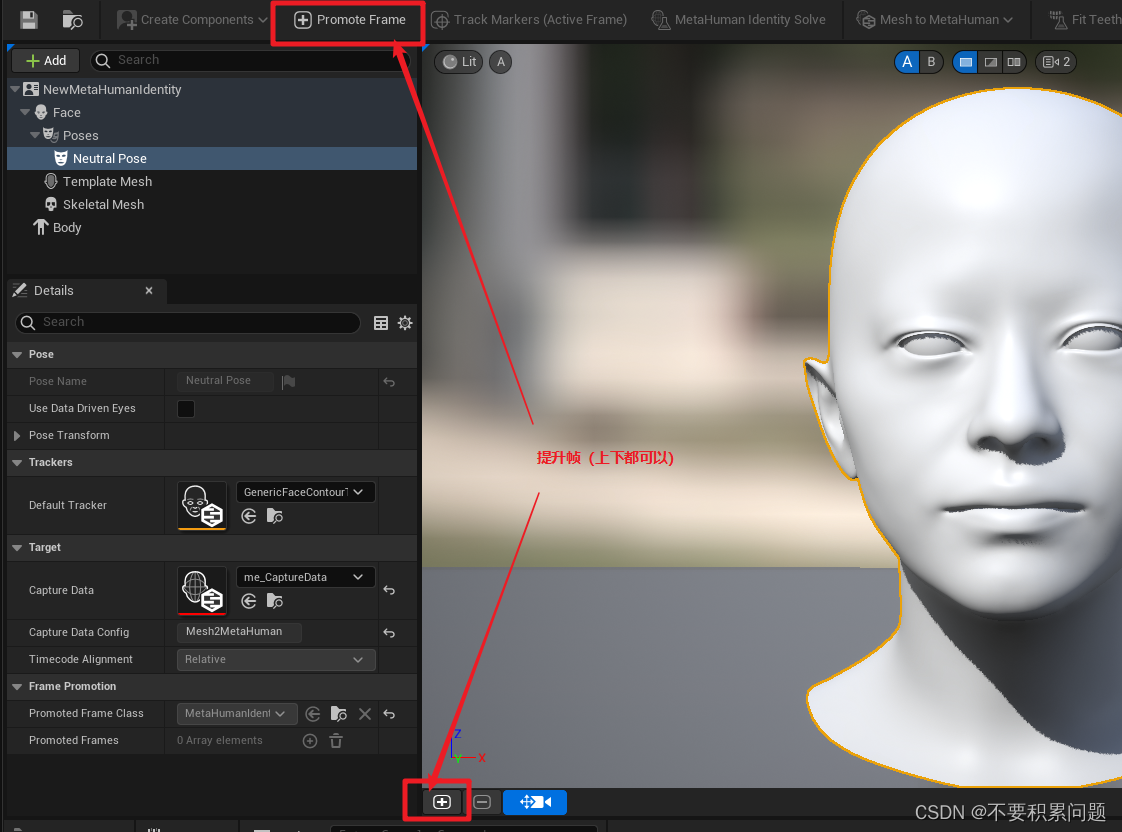

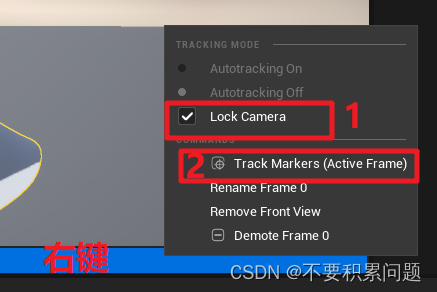

选中Neutral Pose点击提升帧

点击MetaHuman本体测试

选择身体

模型转到MetaHuman(选择第二栏)

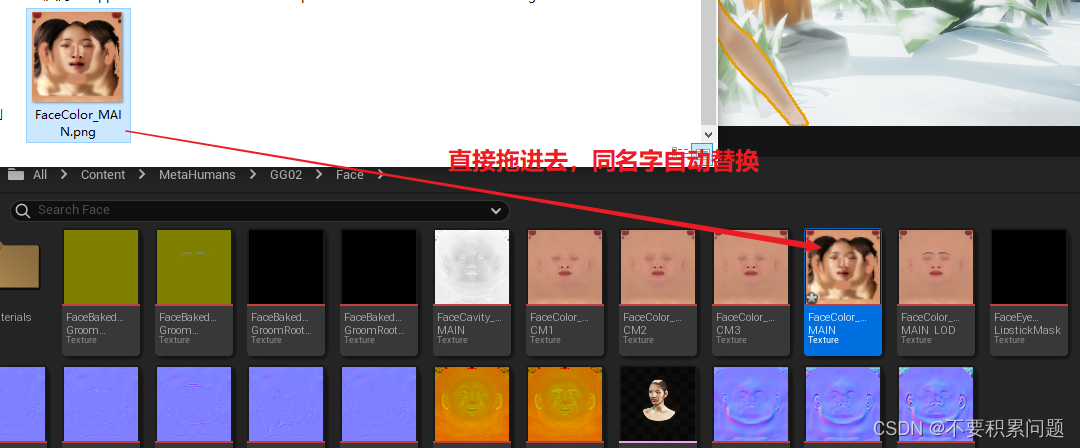

置换Blender里导出的真实贴图

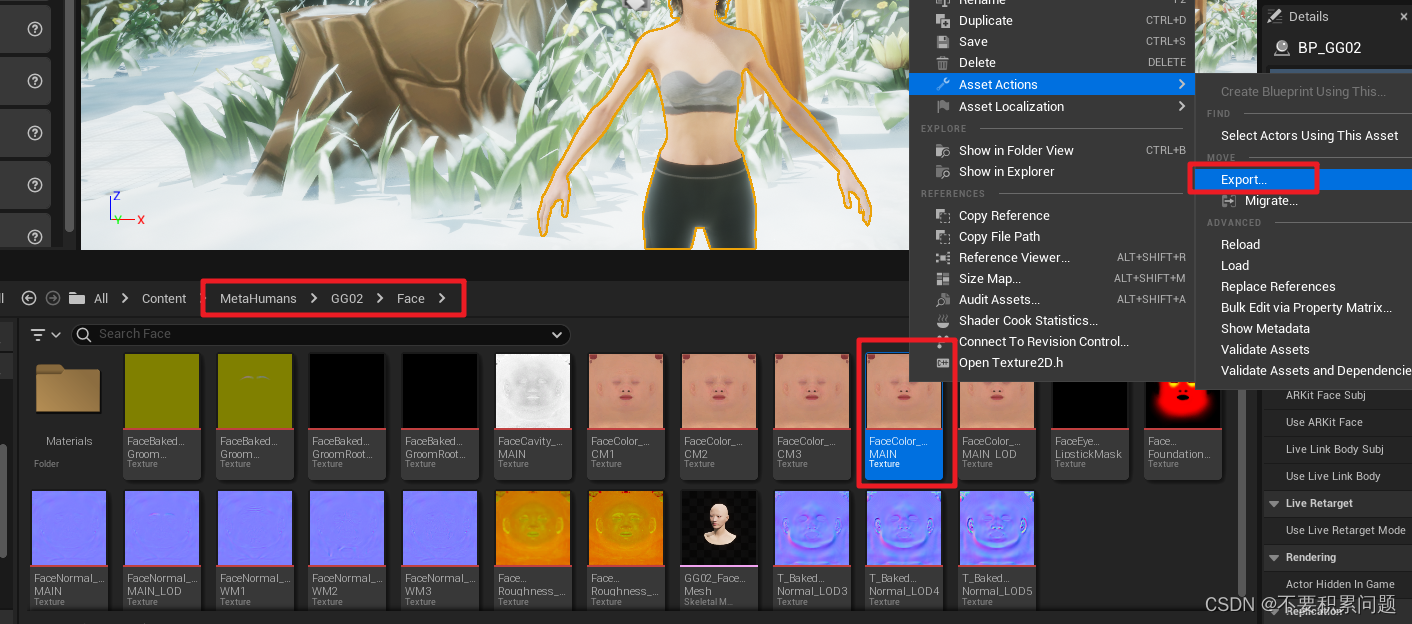

先导出MH里带的脸部贴图作为参考

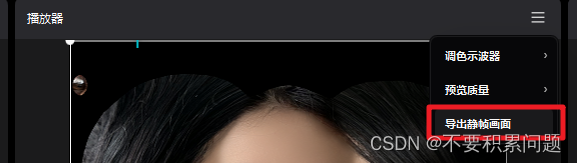

对我们自己Blender导出的贴图做皮肤均匀肤色、调整色调、磨皮等处理(剪映和ps,具体可以看阿光的教程),导出图片(可以选4k的)

【UE】【PS】Metahuman还原真人面部_哔哩哔哩_bilibili

再导出和UE的贴图相同的尺寸,重命名为相同的名字(便于后面替换)

去掉近景修剪,以便近距离观察

去掉近景修剪,以便近距离观察

cmd输入:

r.SetNearClipPlane 0.00001

眼睛和脖子,嘴巴里面部分可以用MH的,剩下脸的部分用blender的贴图

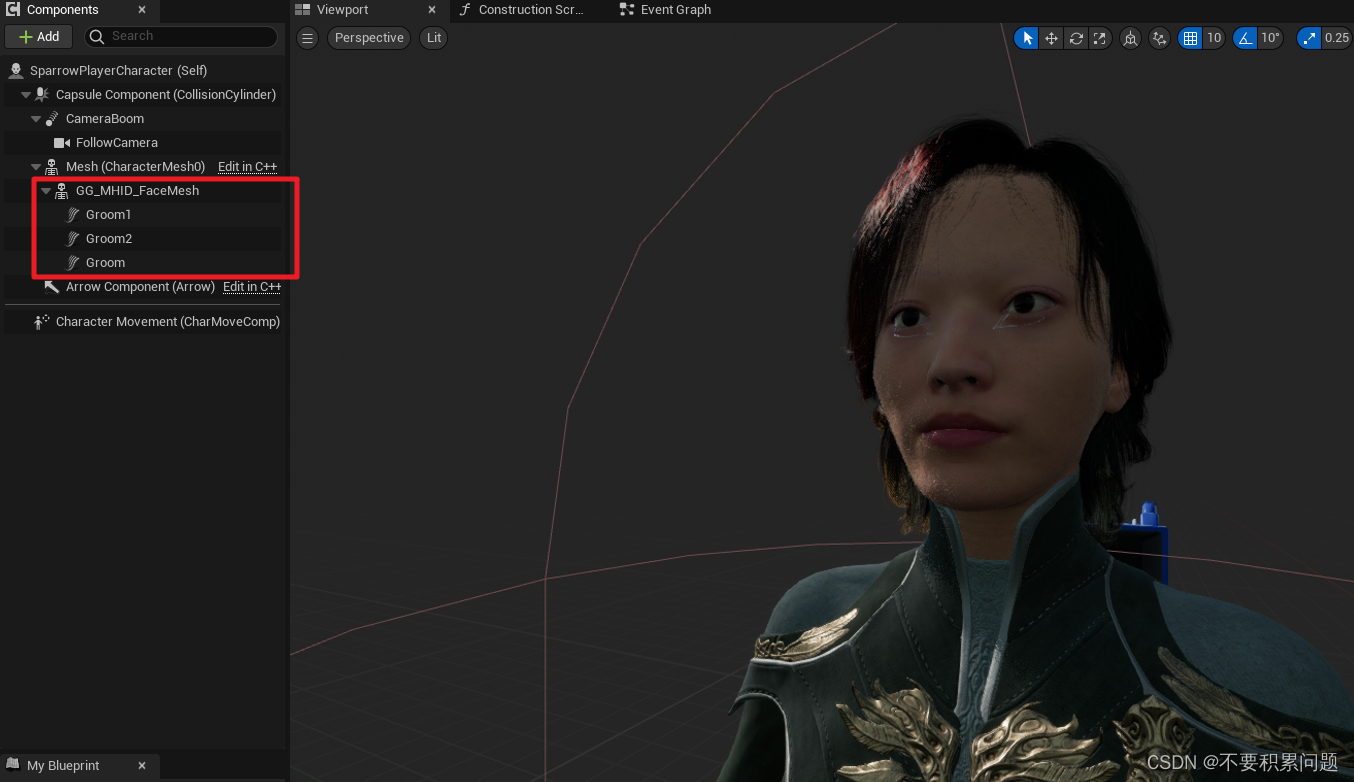

让自己的MetaHuman以第三人称动起来

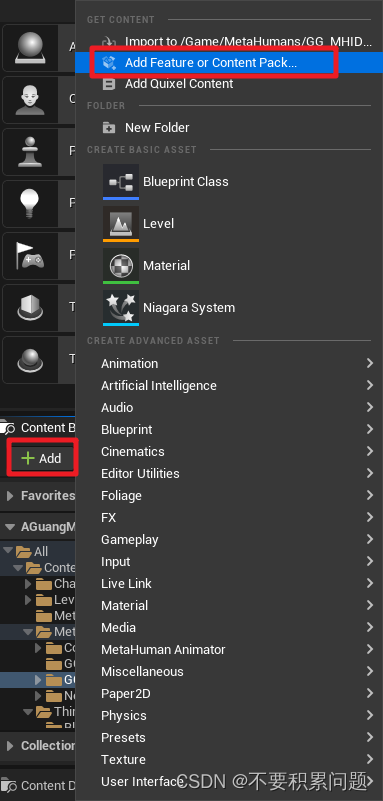

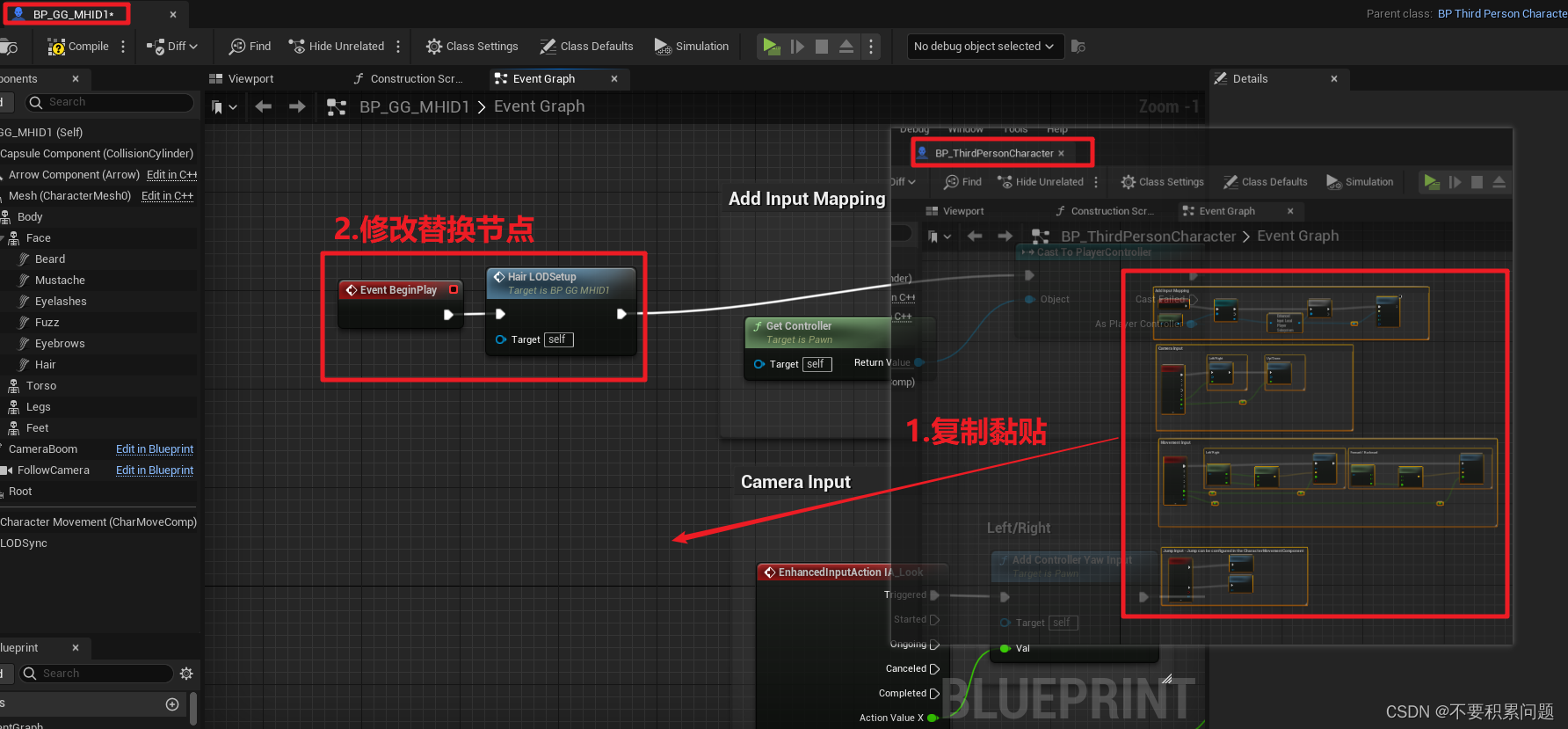

在UE5工程里导入一个第三人称的新手包

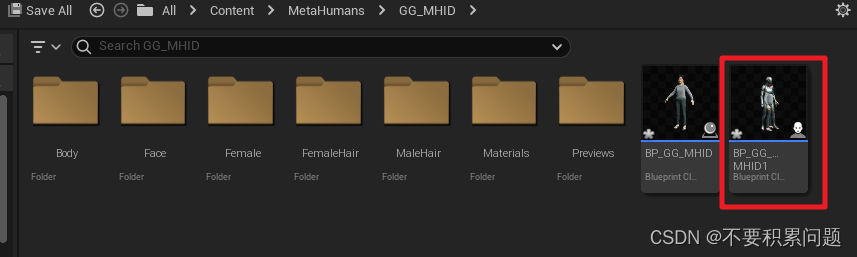

在UE5的虚幻引擎里下载加载自己的MetaHuman,复制一个双击打开

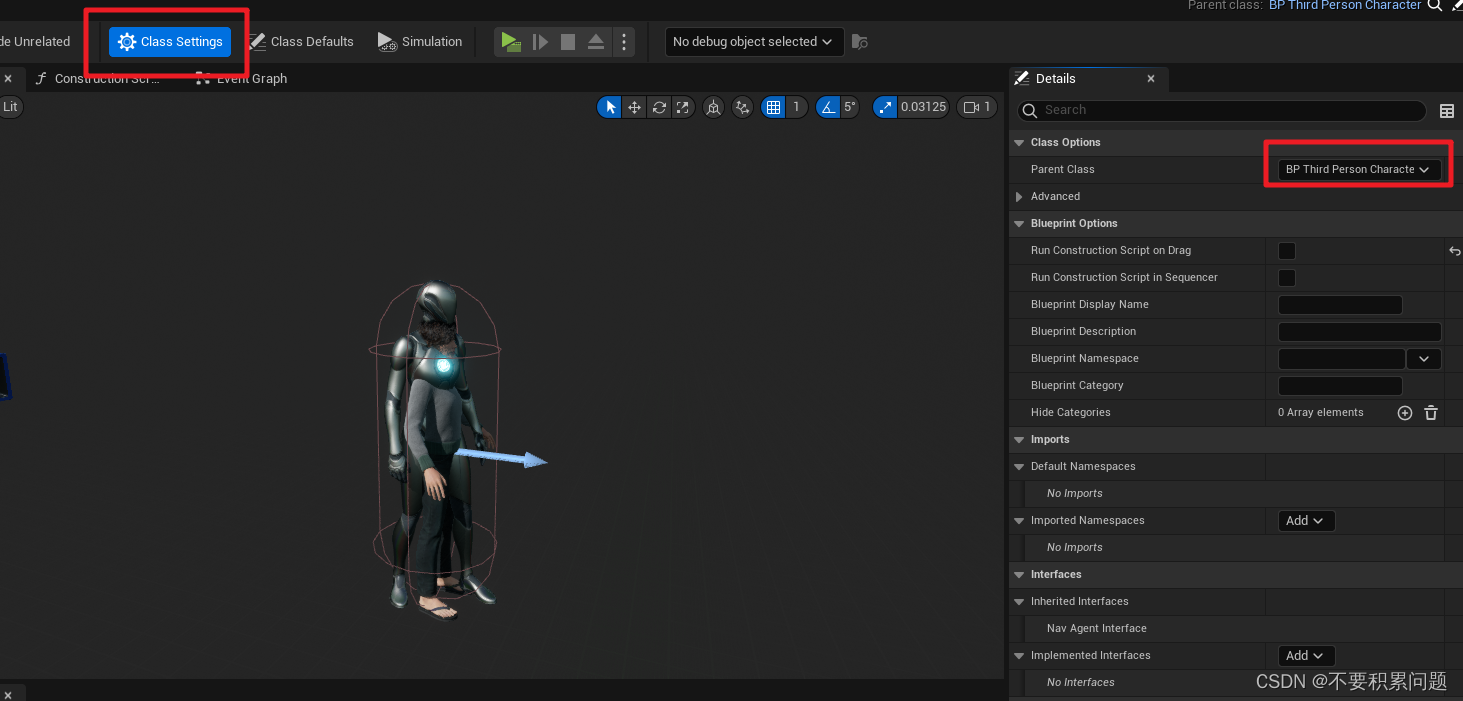

在class setting中加载第三人称蓝图,并把第三人称的body作为MetaHuman的子集归零

在class setting中加载第三人称蓝图,并把第三人称的body作为MetaHuman的子集归零

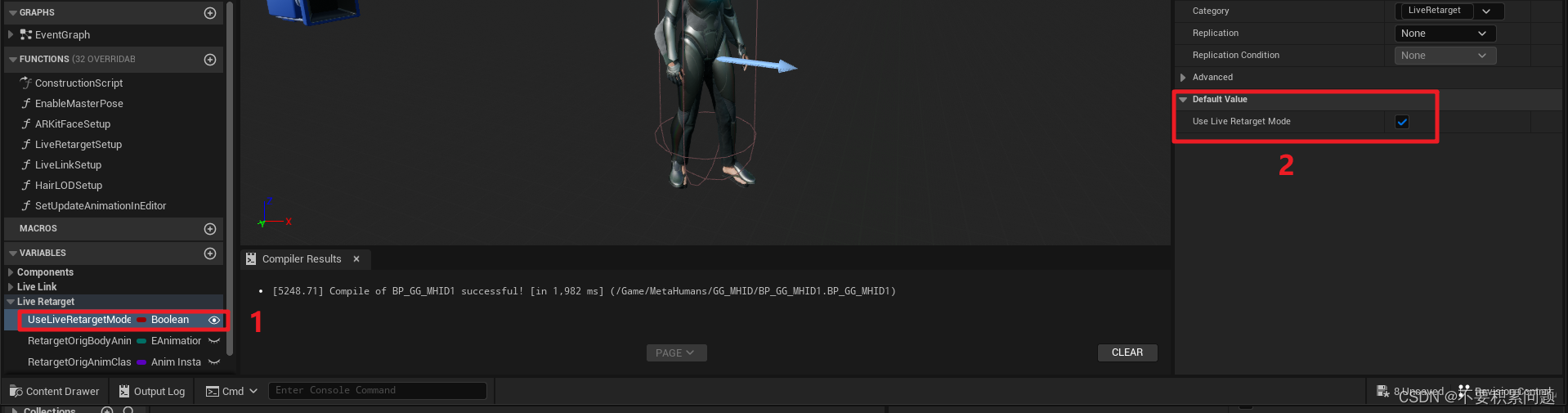

设置重定向

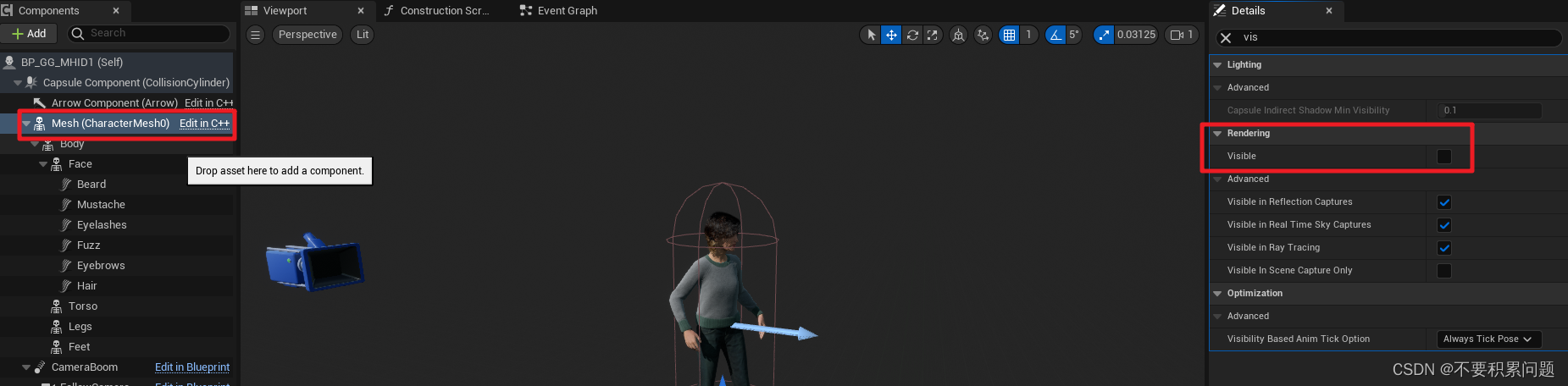

点击mesh隐藏网格体

点击mesh隐藏网格体

将默认的第三人称的蓝图复制黏贴到我们复制出来的数字人蓝图中,修改替换一个节点

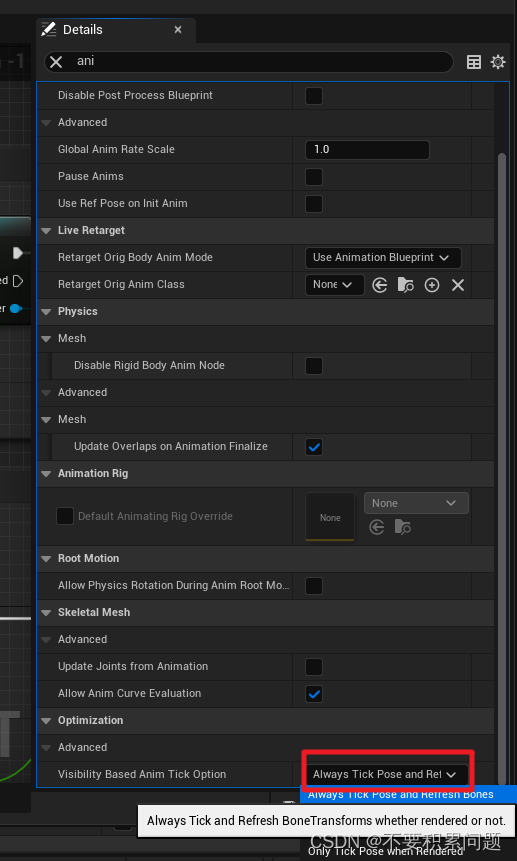

对于visibility based anim tick option改为刷新骨骼

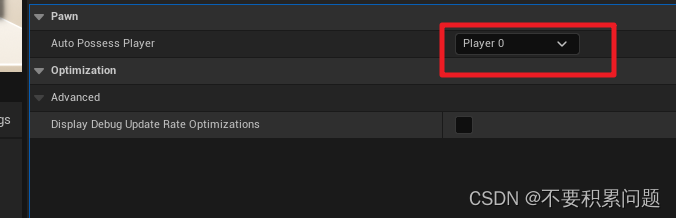

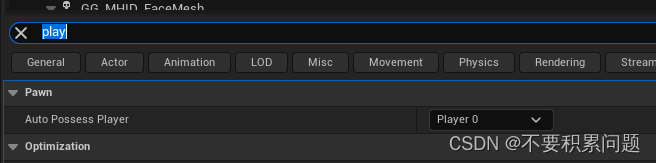

对数字人的pawn改成player 0

最后编译,将数字人拉进level,启动。可以看到可以用第三人称的办法操作数字人。

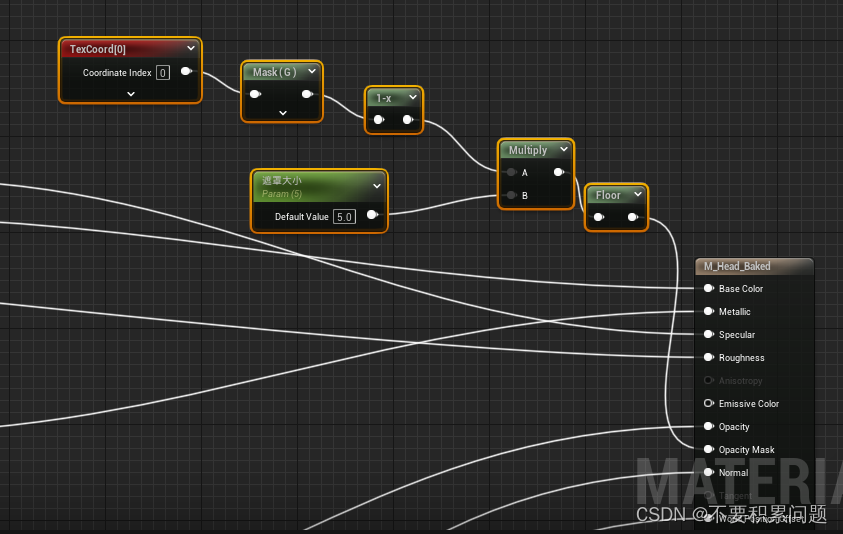

一招白嫖虚幻商城各种服装

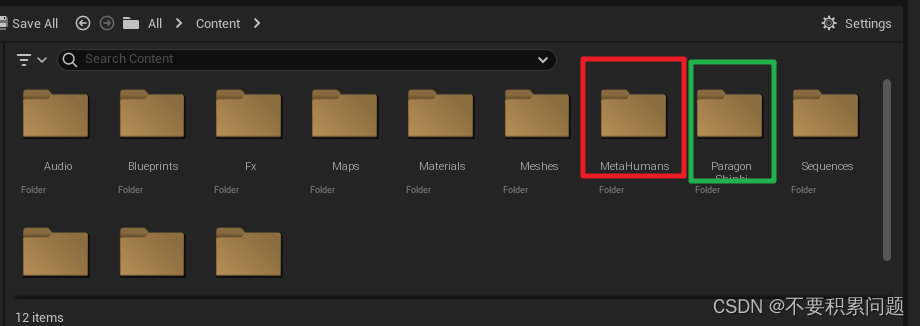

将虚幻商城找到的角色和数字人都放到相同的UE5工程中

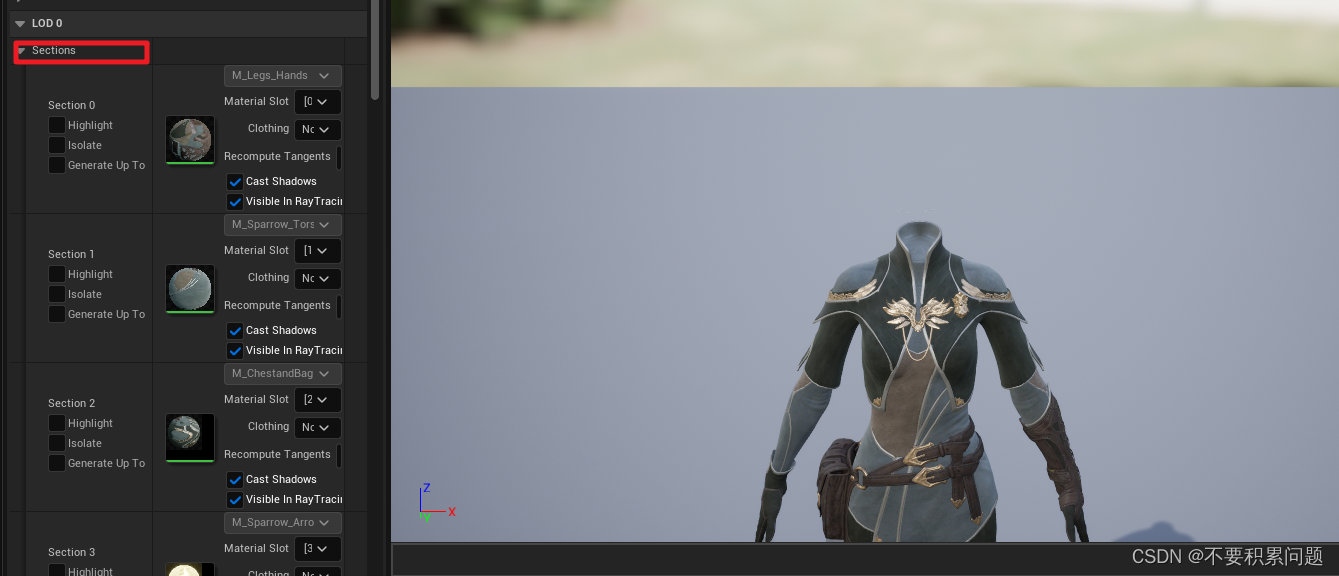

在模型里的sections中将头的零件右键禁用disable掉

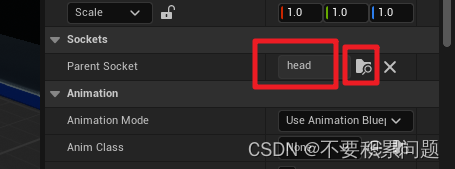

将数字人的脸部组件放入

将数字人的脸部组件放入

给数字人的脸部皮肤材质(父级材质) 添加遮罩的算法节点

给数字人的脸部皮肤材质(父级材质) 添加遮罩的算法节点

记得把数字人改为player 0

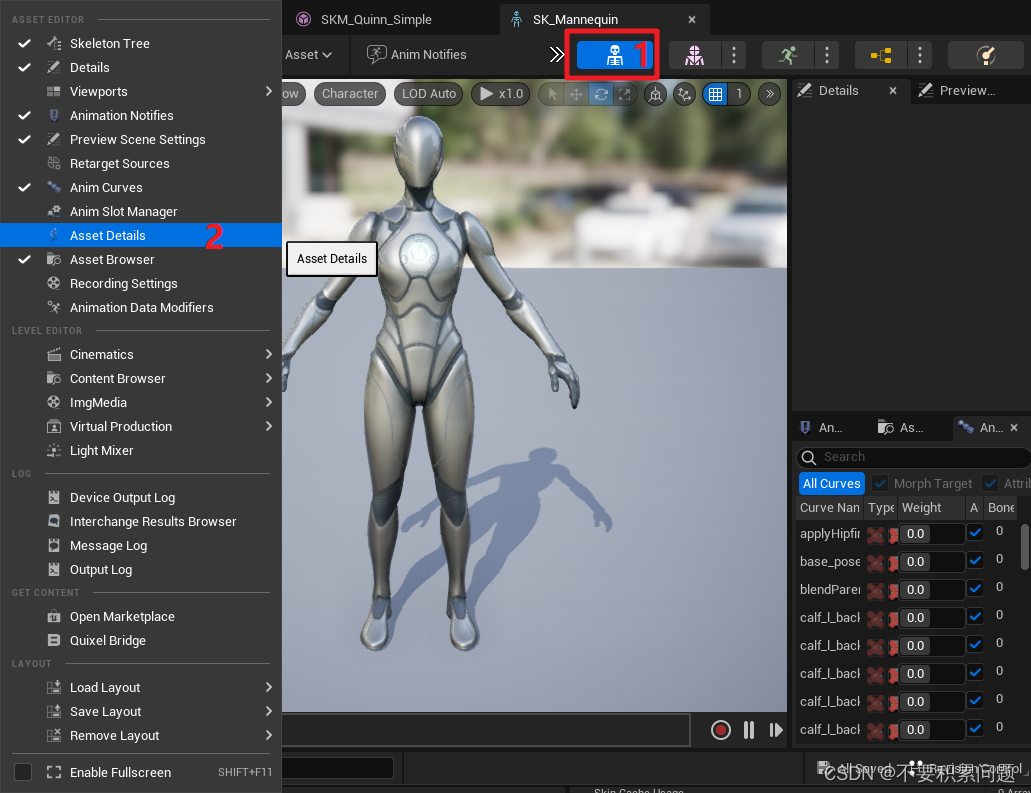

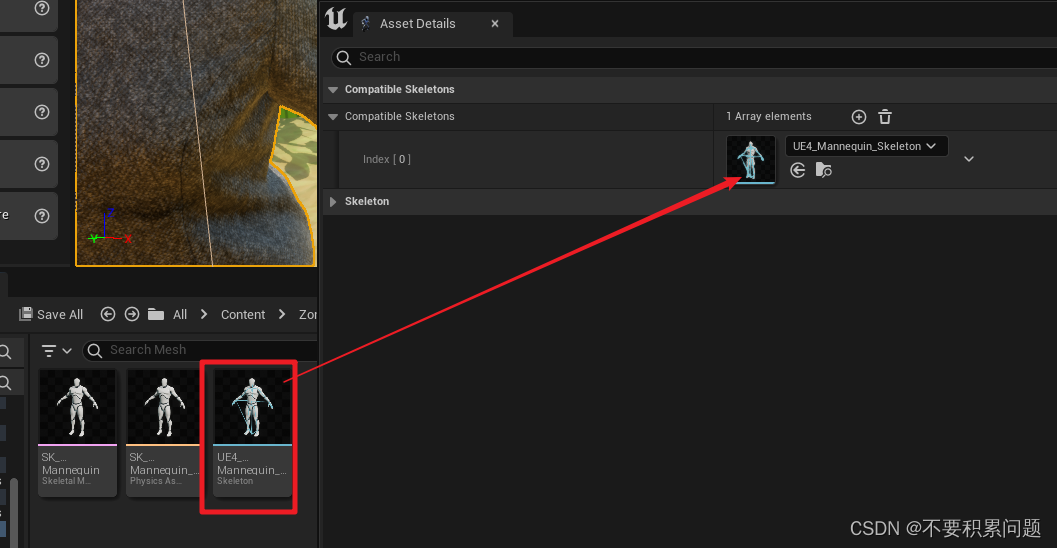

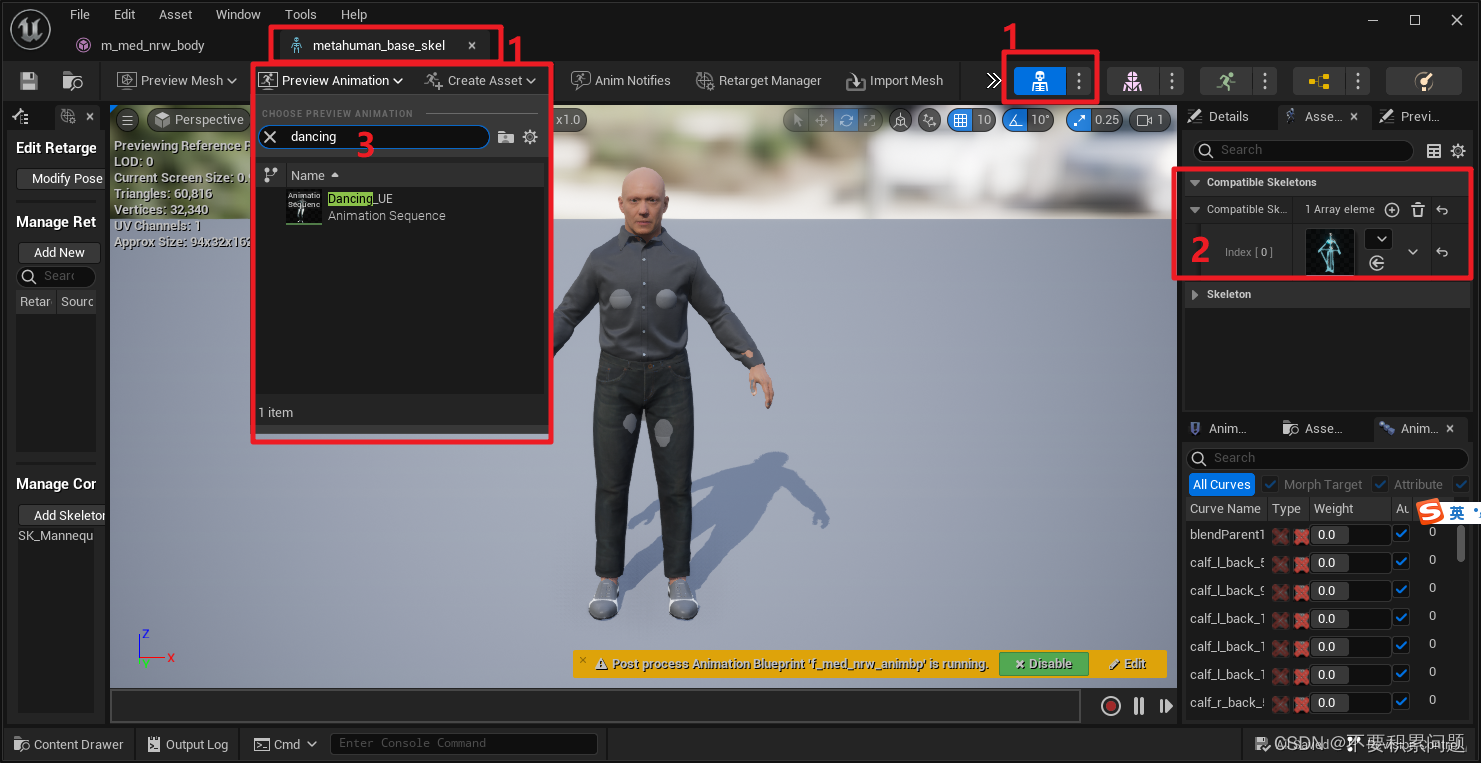

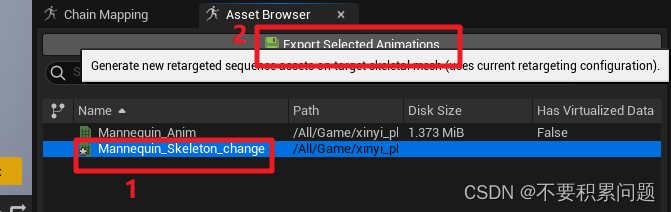

兼容骨架动画

打开数字人骨骼里的资产详情

将丧尸的骨骼放入新的资产

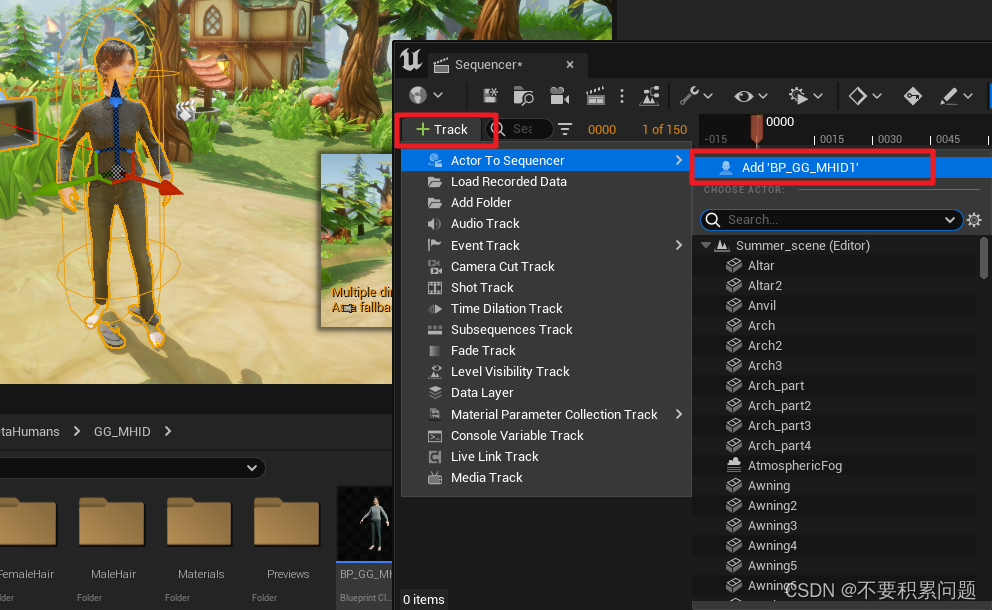

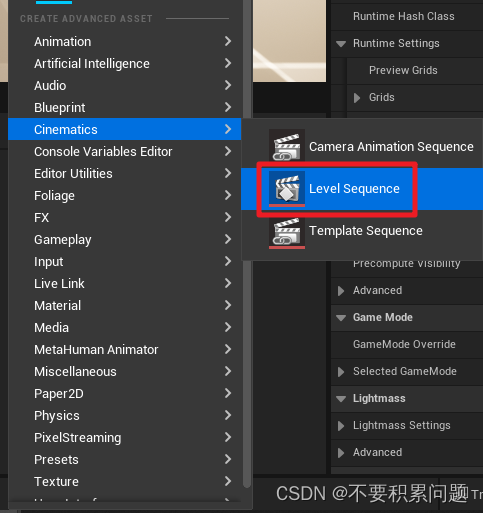

添加关卡序列

添加关卡序列

选中数字人,在 轨道上选择添加到关卡

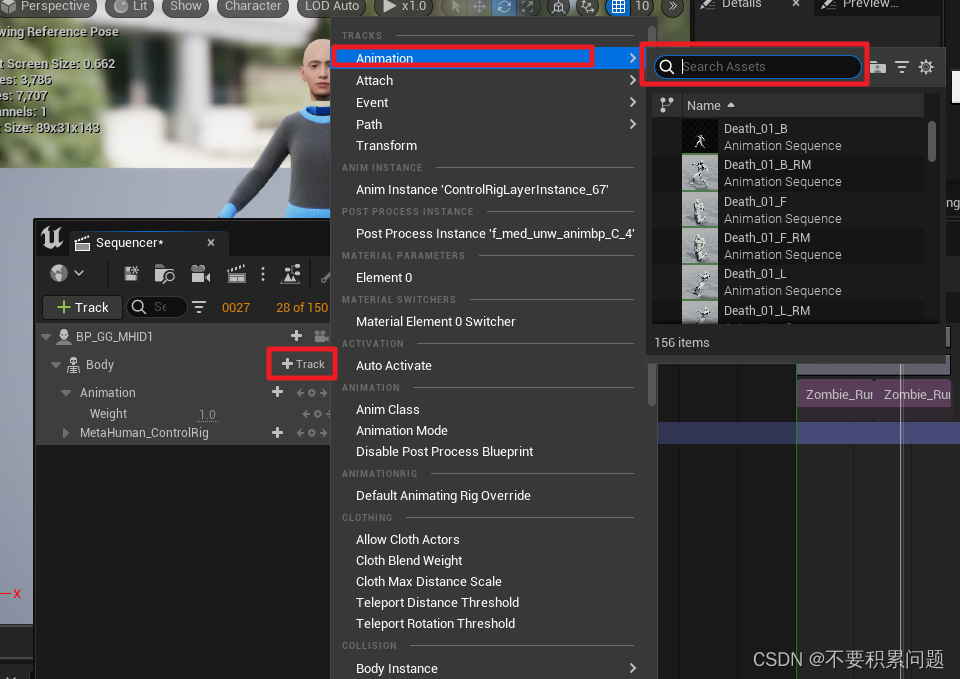

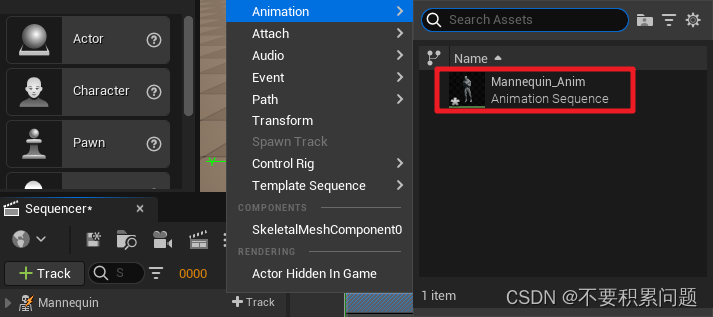

去掉body以外其他没有必要的东西,如下添加动画

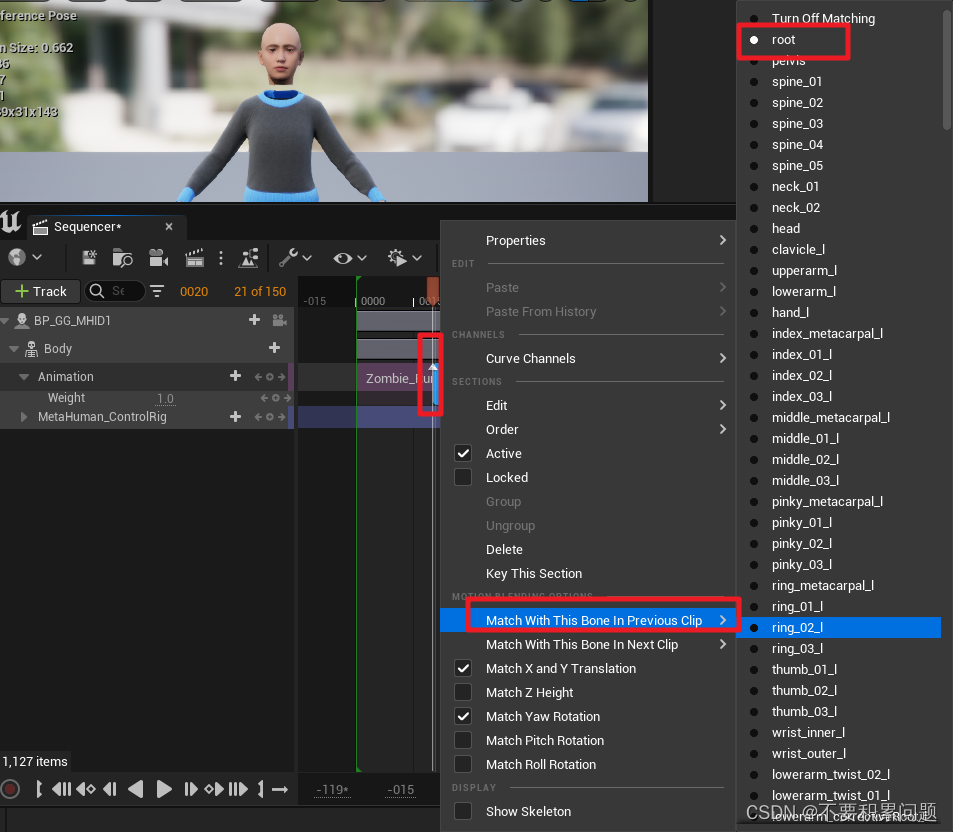

如果要重复多条相同的跟动画,把时间线拉倒两条动画的衔接处,右键↓↓如图所示

如果要重复多条相同的跟动画,把时间线拉倒两条动画的衔接处,右键↓↓如图所示

用Udraper为Metahuman换装更加丝滑

uDraper - 虚幻引擎实时布料模拟插件与3D服装设计软件

1.注册这个网站并得到许可证

2.挑选一些衣服买下来

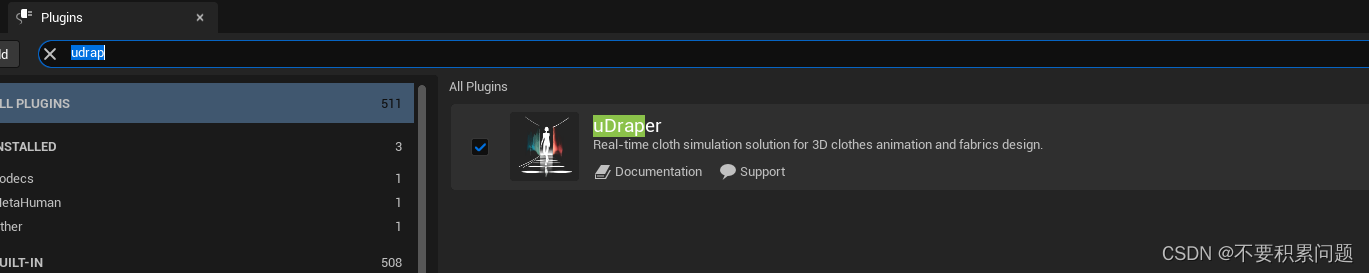

3.在虚幻引擎里添加Udrap的插件

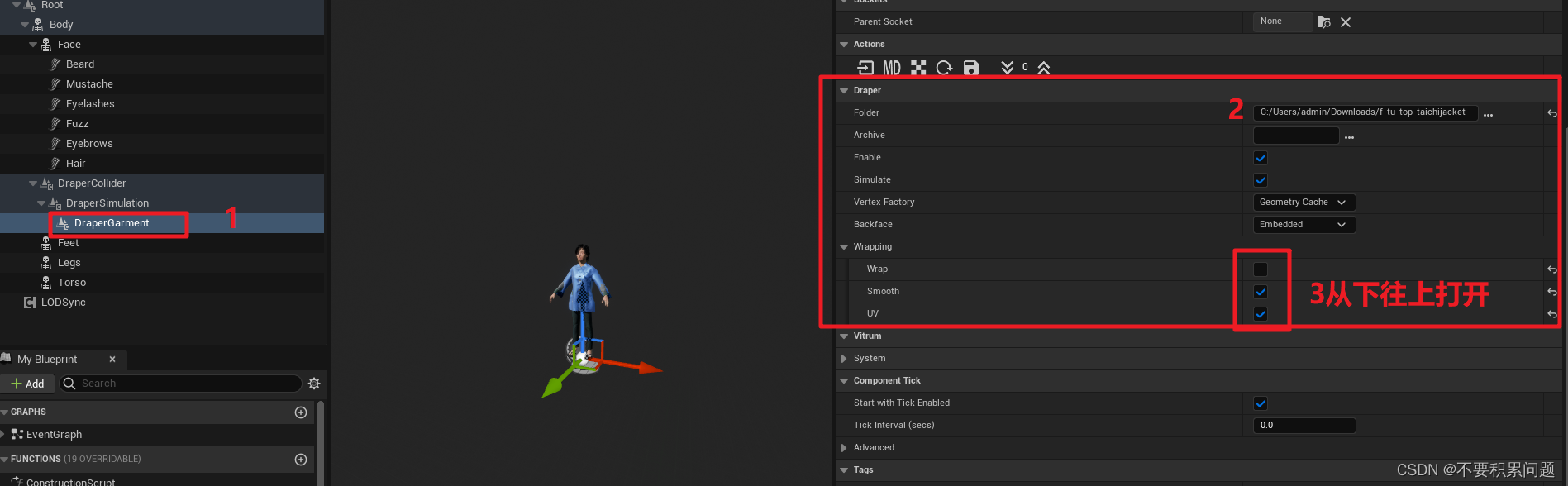

4.打开数字人的蓝图,底下的body有个drap的按钮

1.点击选择

2.放入下载好的衣服

3.将衣服对好位置,从下往上打钩

关卡序列动画示例:UDraper服装+Mixamo动作

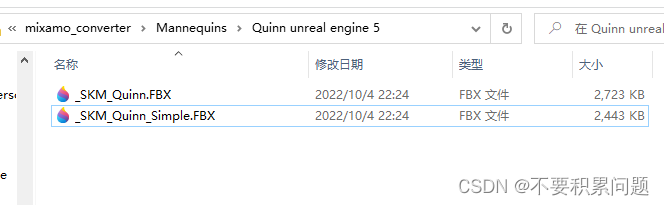

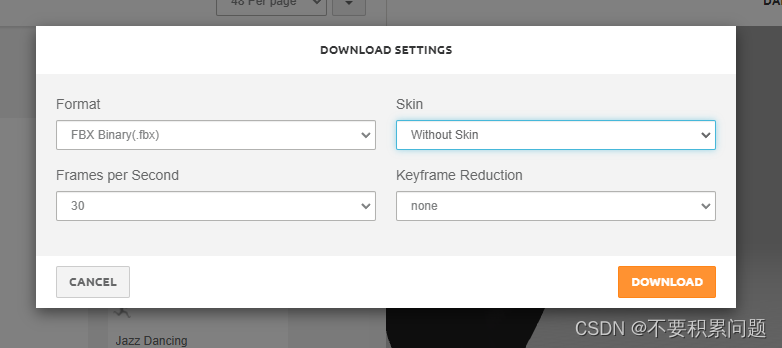

1.在mixamo网站中导入我们的虚幻阴影角色

选择一个舞蹈动作,并下载,蒙皮选择 否

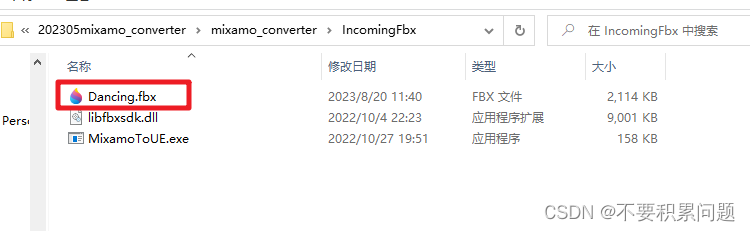

将dancing放入IncomingFbx文件夹

将dancing放入IncomingFbx文件夹

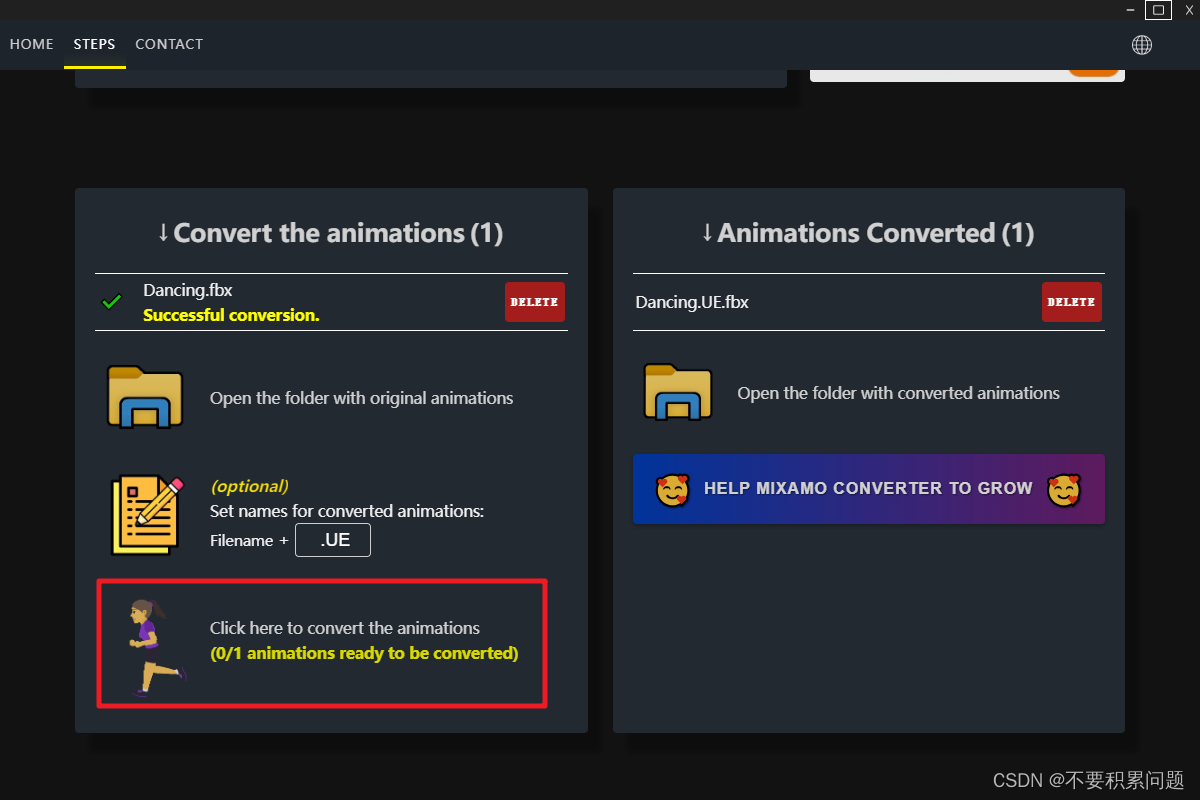

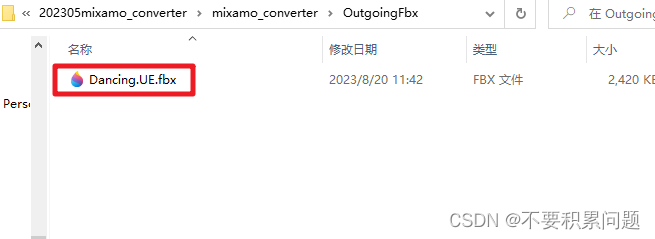

点击上述转换键之后,可以在OutgoingFbx文件夹中找到转换好的模型

点击上述转换键之后,可以在OutgoingFbx文件夹中找到转换好的模型

将刚导出好的舞蹈fbx和Metahuman全部放入c4d,

点击数字人的身体(通用部分:手、皮肤等),再找到骨骼

接下来就和《兼容骨架动画》那节的教程比较相似,添加关卡序列动画

动作捕捉(Plask)

动作捕捉

Plask网站:Plask Motion: AI-powered Mocap Animation Tool

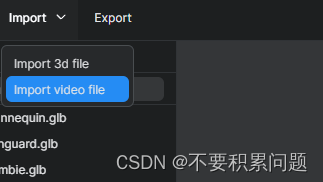

导入需要被捕捉动作的参考视频

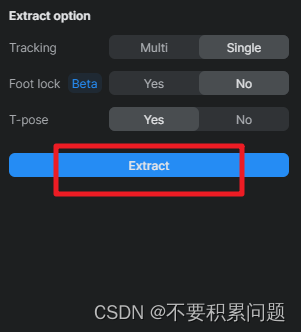

点击 extract提取

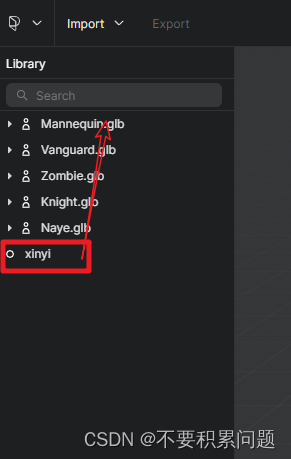

可以把提取的动作拉到任意一个模型身上,如下

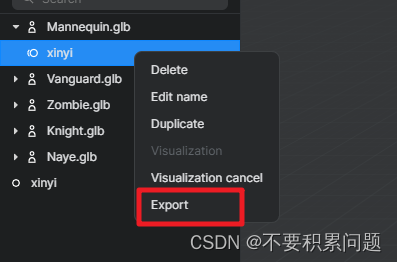

选择模特,点击导出,选择 fbx(Game engine)

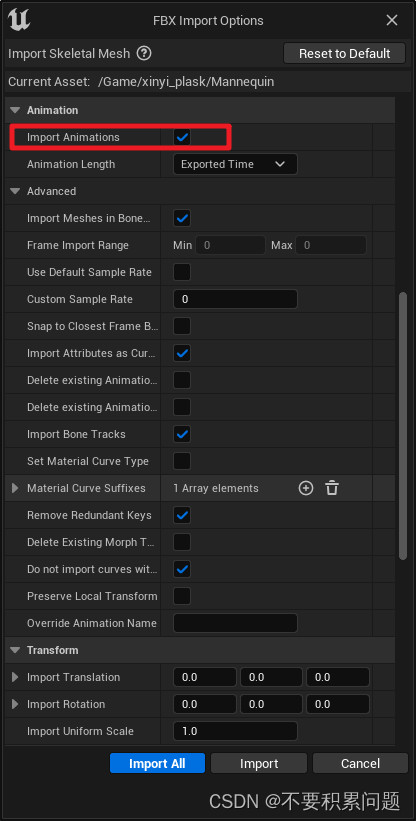

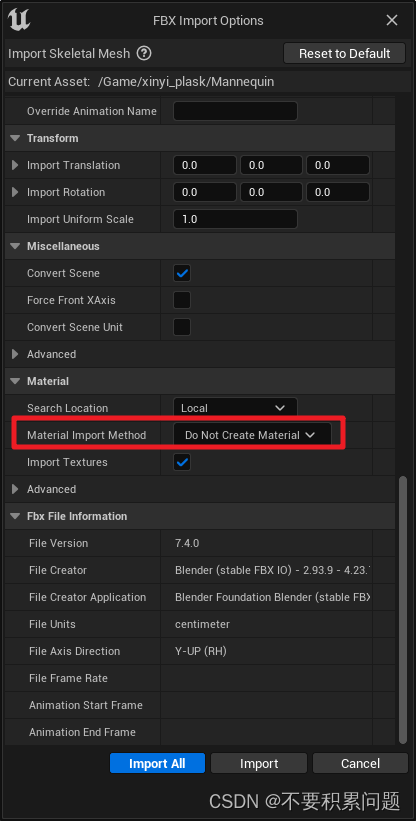

在虚幻引擎里导入动画,记得勾选√导入动画,不需要导入材质

IK重定向

要实现IK重定向,需要三个条件

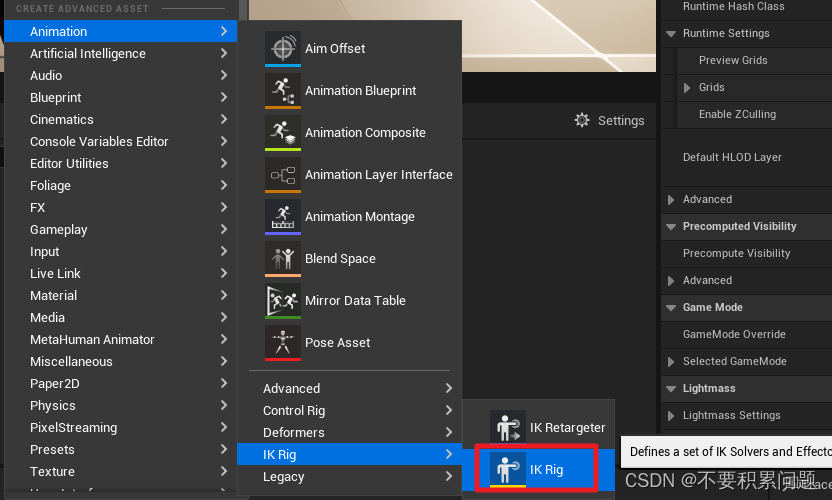

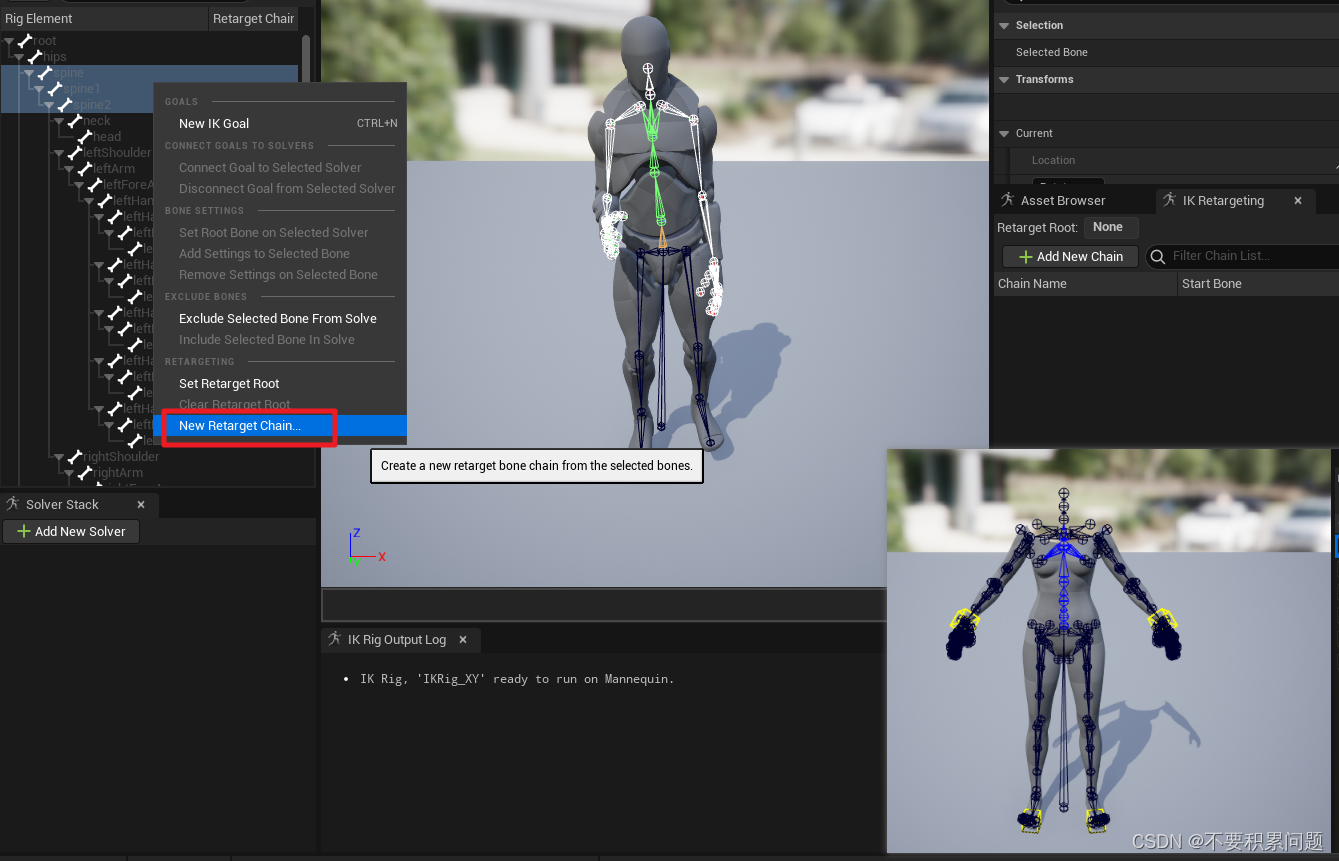

新建IK Rig

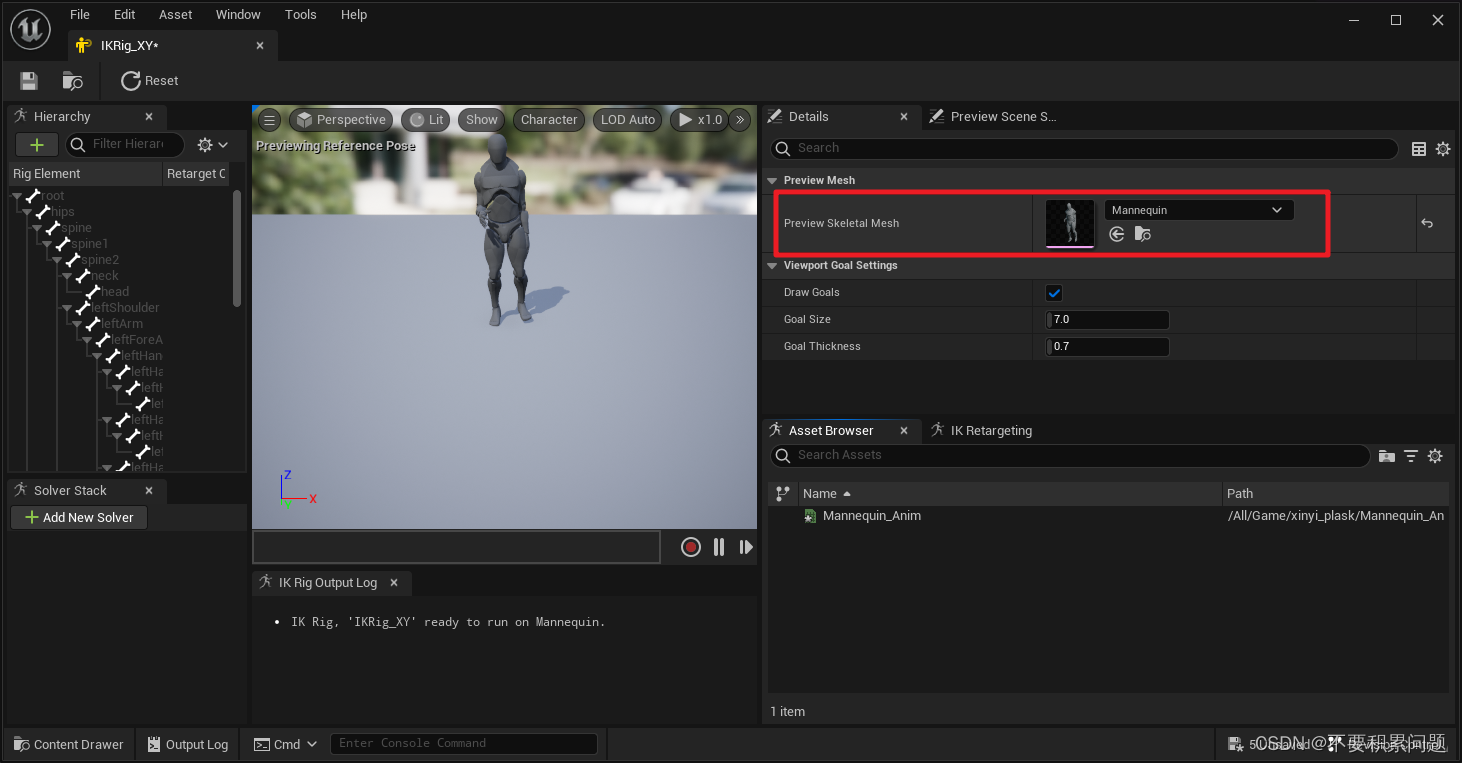

打开之后,选择xinyi那套骨架

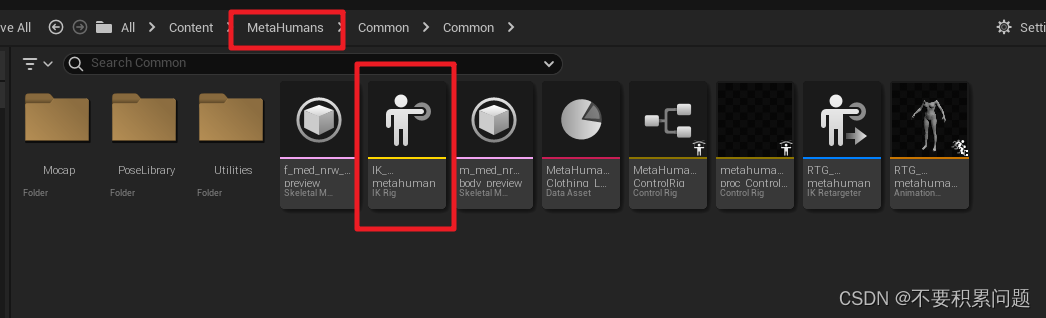

Metahuman的IK绑定,已经默认创建好了的

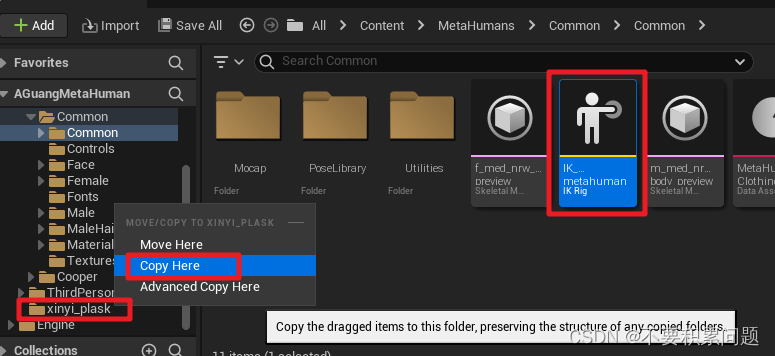

复制一份数字人的IK绑定

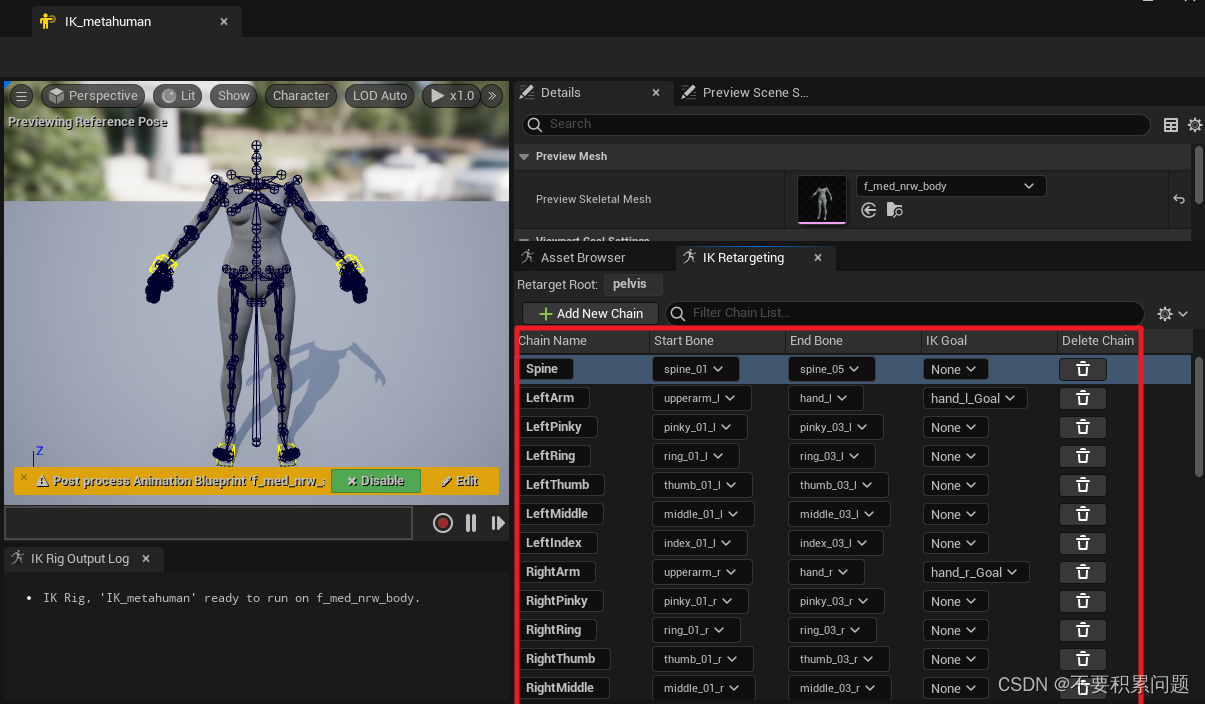

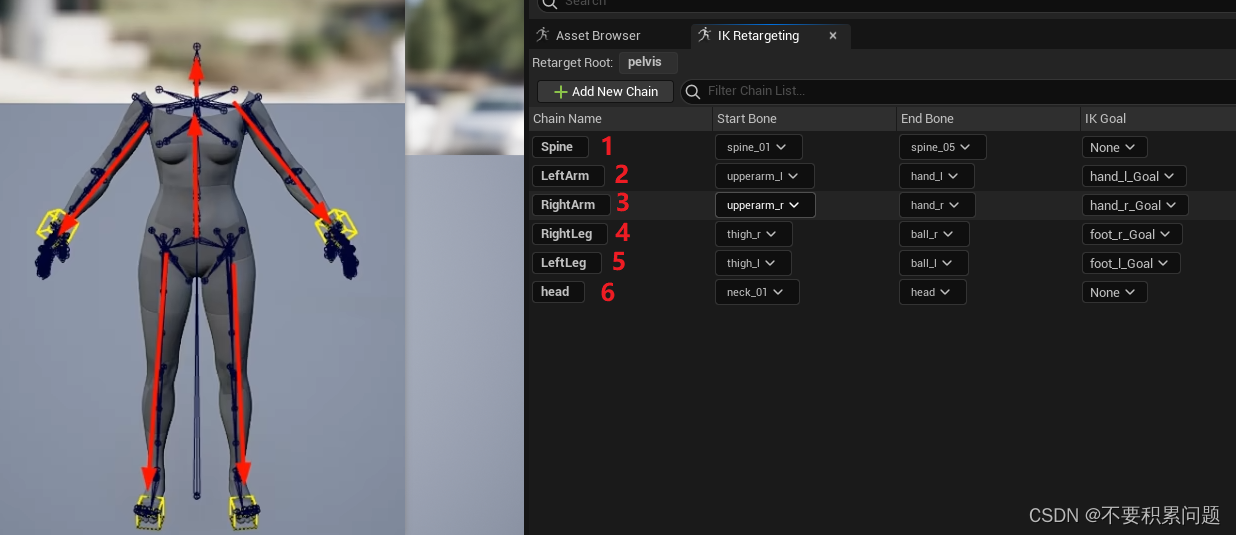

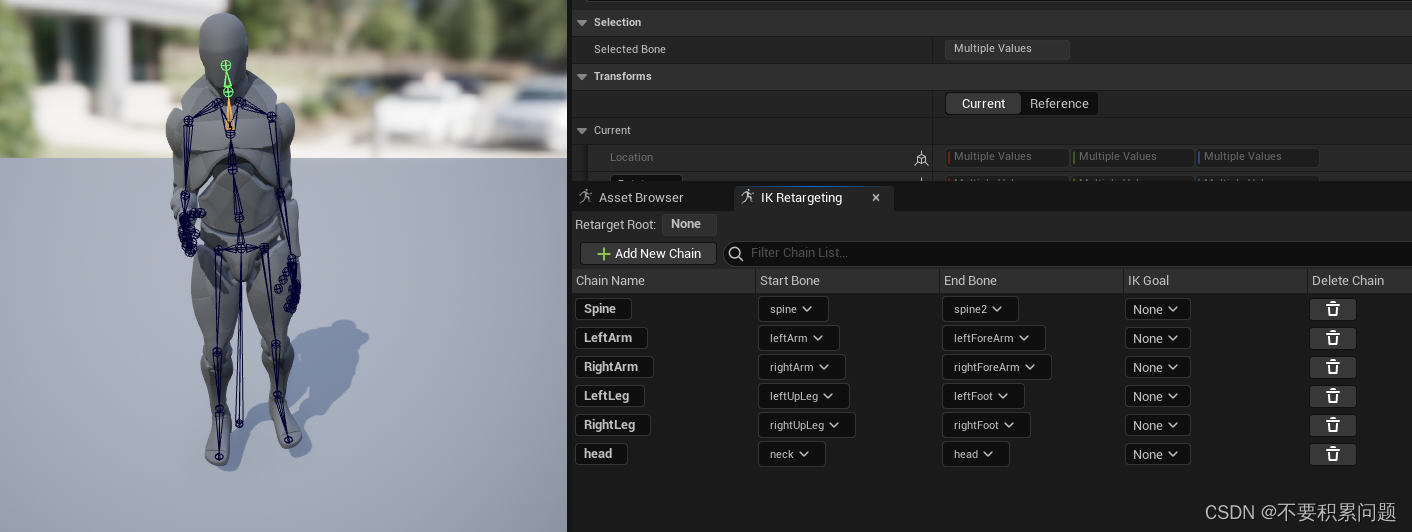

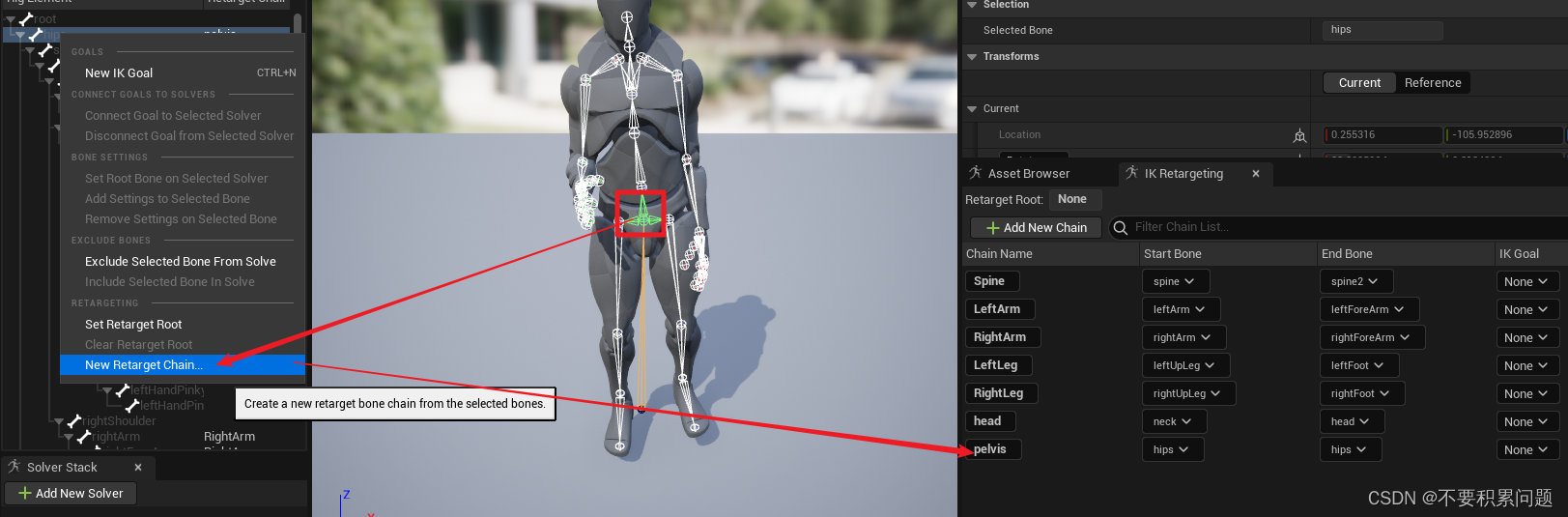

复制过来的IK绑定,保留关键的6条骨骼链,其余的删去(如下图)

对照上图,对我们xinyi的新建IK绑定也创立相同的6条骨骼链,IK目标都选择无

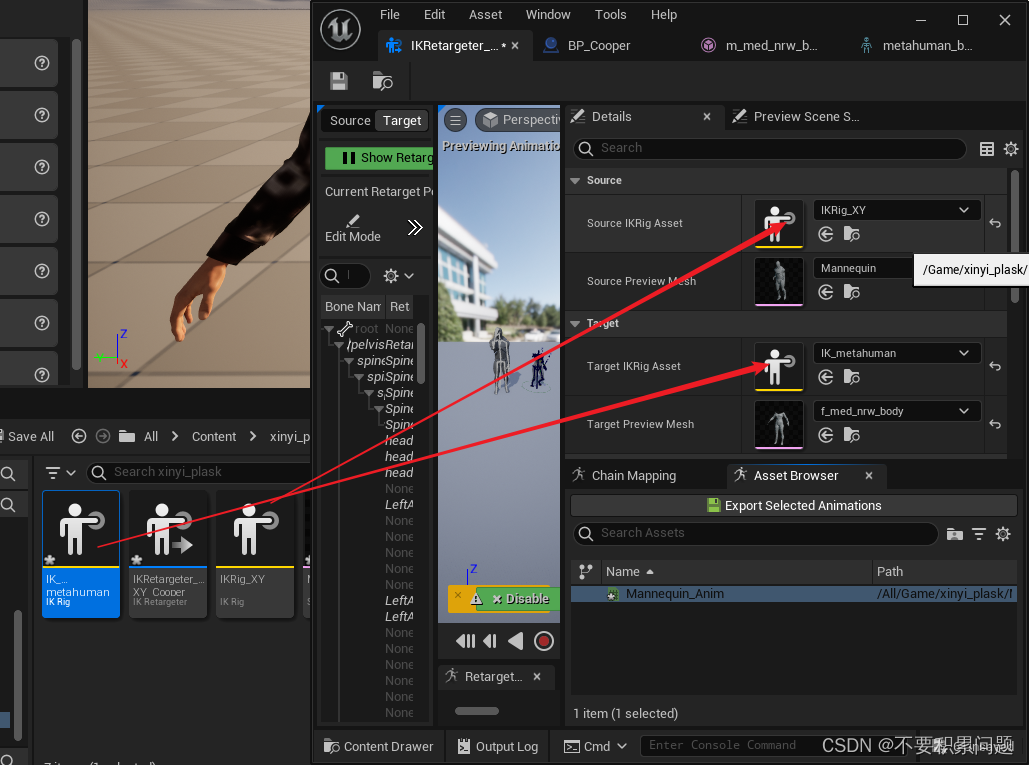

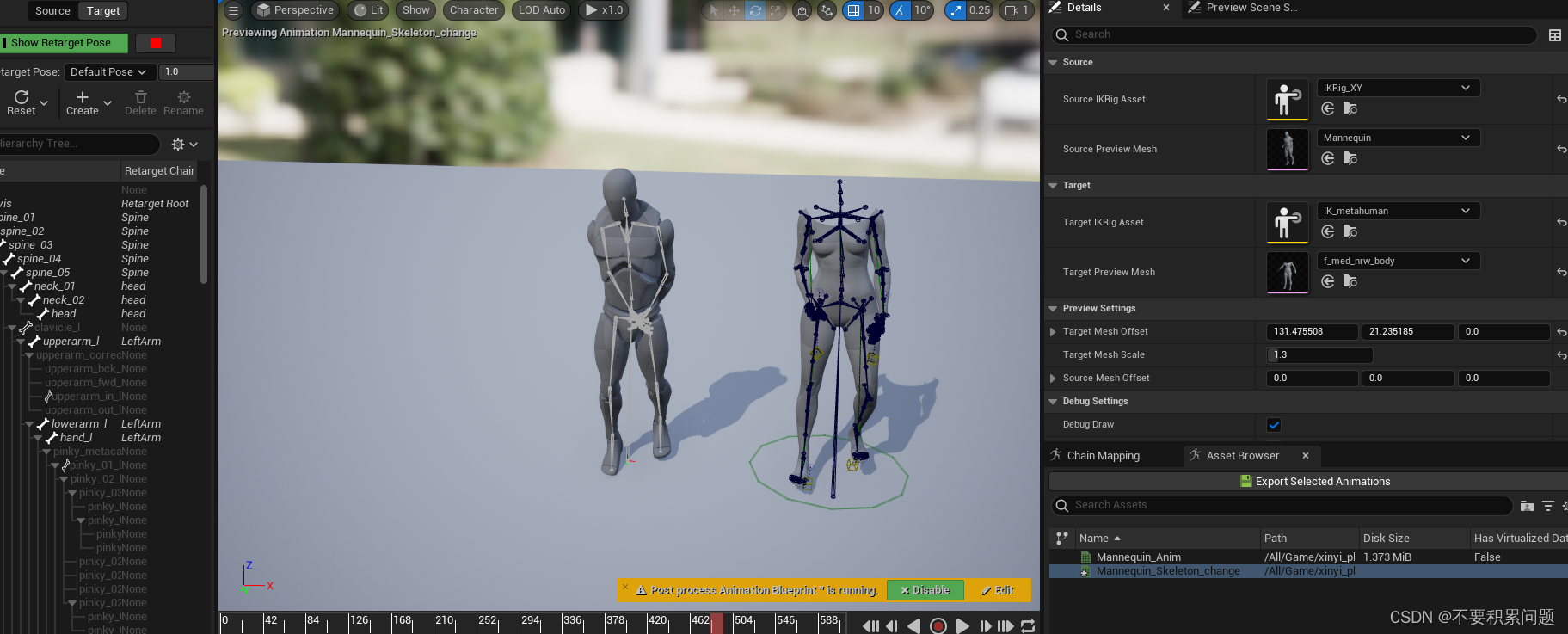

新建一个IK重定向器,重命名IKRetargeter_XY_Cooper

去除动捕之后,人物位置忽上忽下 的问题

去除动捕之后,人物位置忽上忽下 的问题

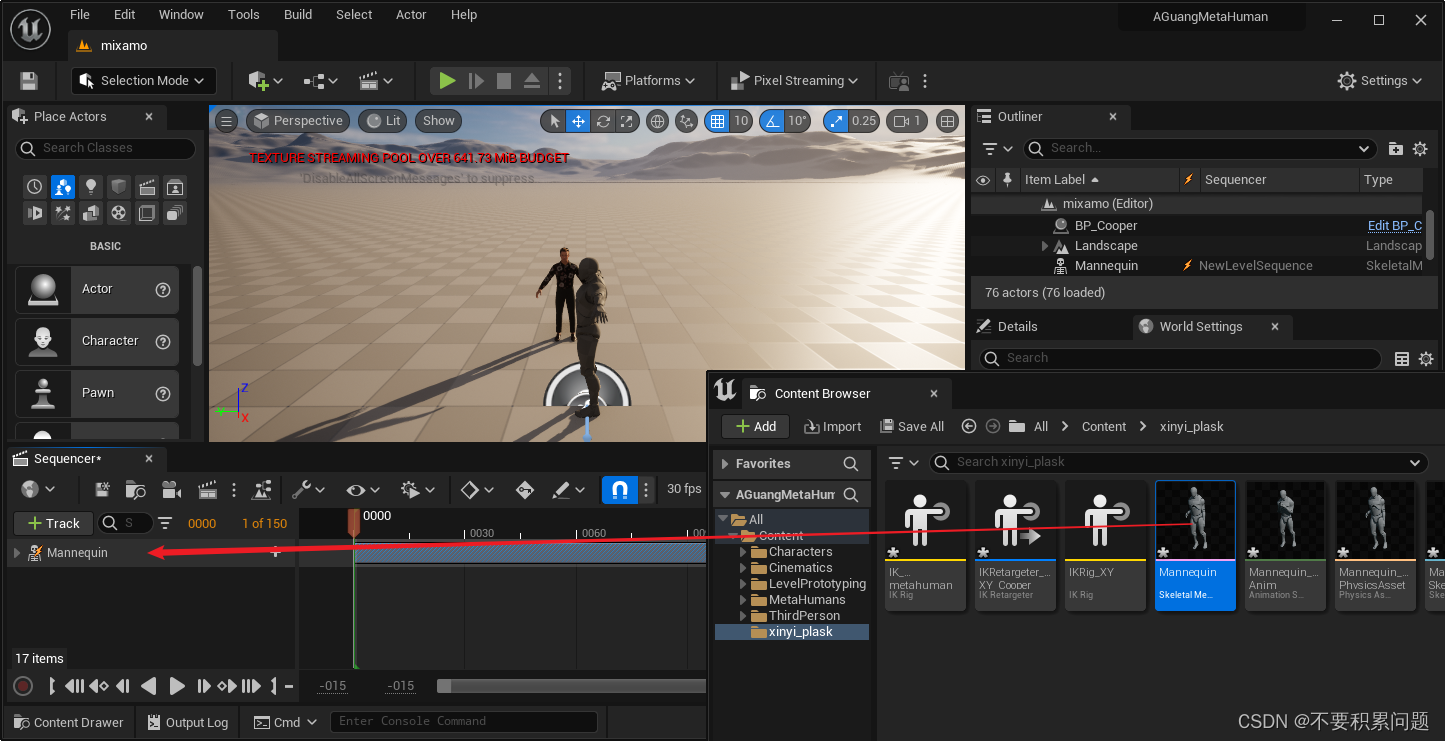

新建一个关卡序列

将动捕模型拉进关卡,添加动捕动画

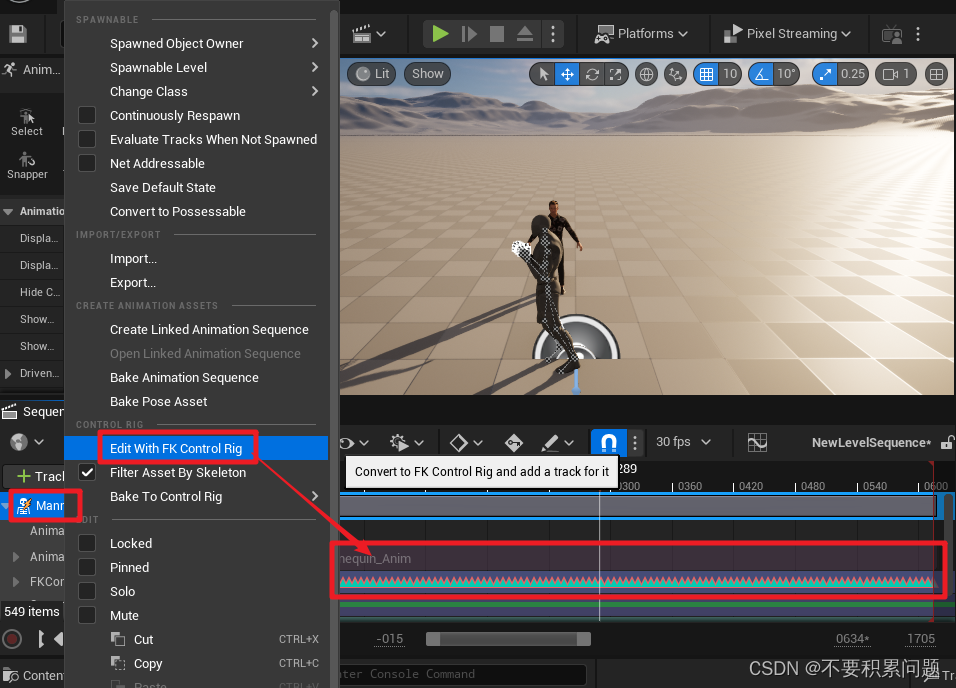

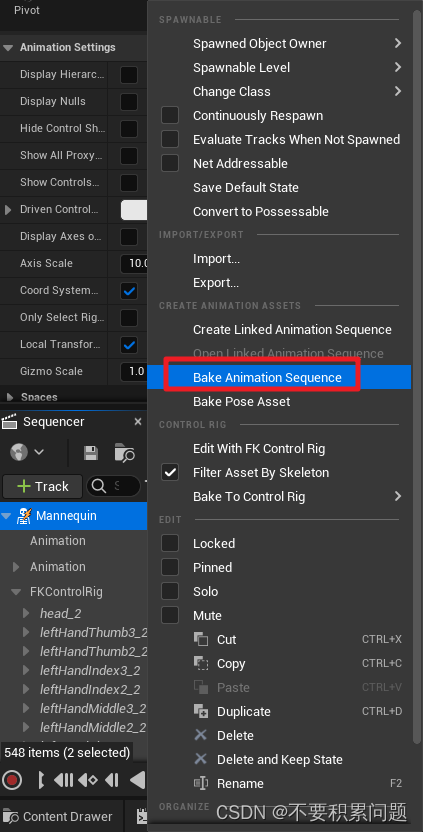

点击主体,右键(Edit With FK Control Rig)烘焙动画

点击主体,右键(Edit With FK Control Rig)烘焙动画

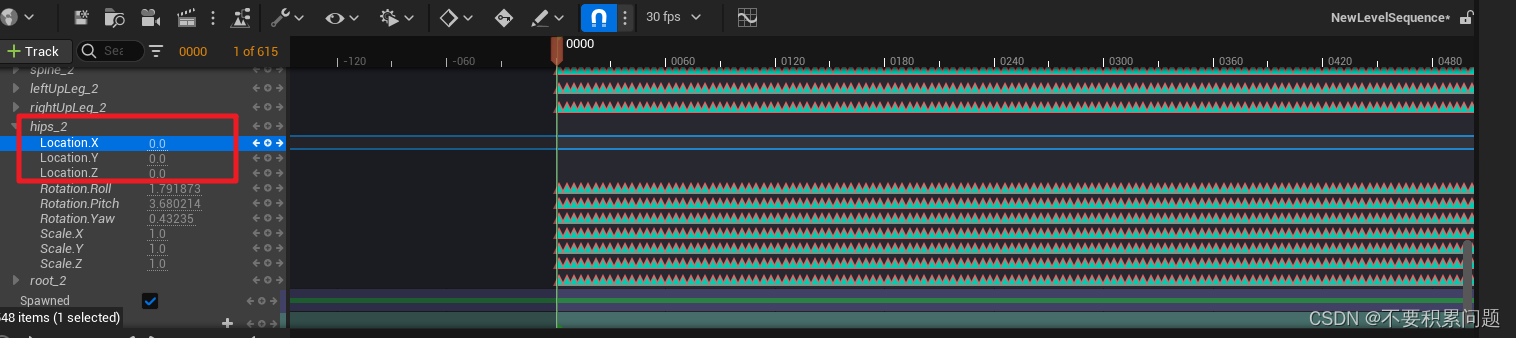

把hips的位移动画帧全选删掉重置为0

把hips的位移动画帧全选删掉重置为0

烘焙动画

换上刚刚新烘焙出来的新的动画序列,继续修复动画

对IK_Rig_XY的hip骨骼新建一个骨骼,重命名为pelvis

对IK_Metahuman也做如上相同的操作

然后链接pelvis

选择新的动画,导出~

文字/语音驱动数字人口型动画(Metahuman SDK)【未完成】

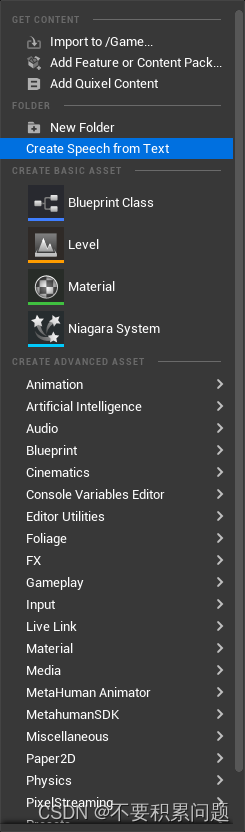

右键创建“speech from text”

如果出现下图的提示,可以先点击“open personal account”

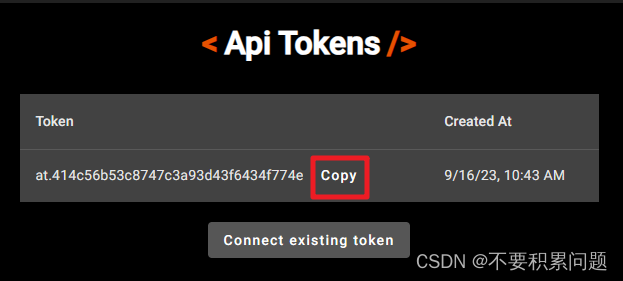

进入这个网页新建一个token复制一下

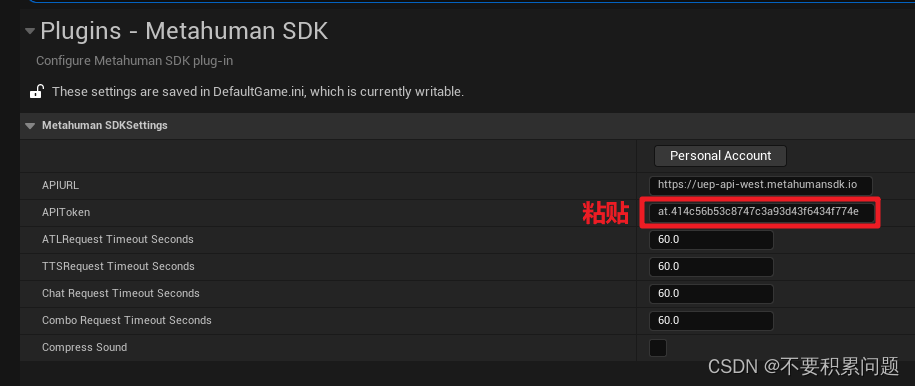

回到虚幻引擎,打开工程设置-插件-metahuman sdk,粘贴刚刚的token。问题就解决了。

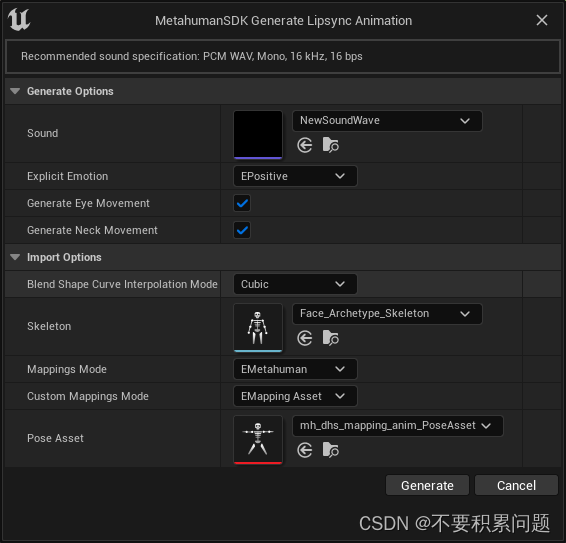

右键生成的音频,点击“Create Lipsync Animation”

【SoVits】AI声音克隆

【UE】【Blender】Metahuman个性化发型制作全流程(13分钟)

教程

【UE】【Blender】Metahuman个性化发型制作全流程_哔哩哔哩_bilibili

在UE里面导出一个metahuman的头,右键-资产管理-导出

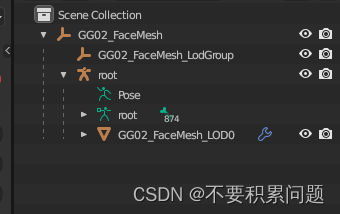

在blender中导入这个头部fbx

删掉出LOD0以外的模型

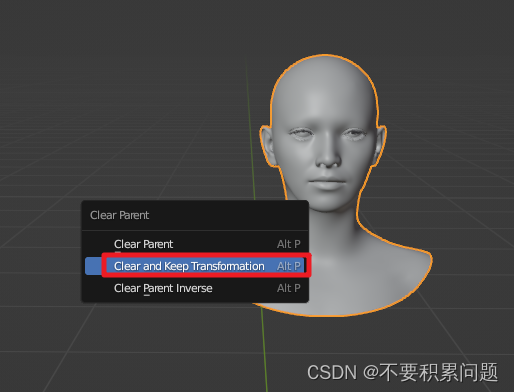

在blender窗口界面选中模型,快捷键alt+p选择中间的clear and keep transform,解除父子集之后再删除除了模型以外的东西

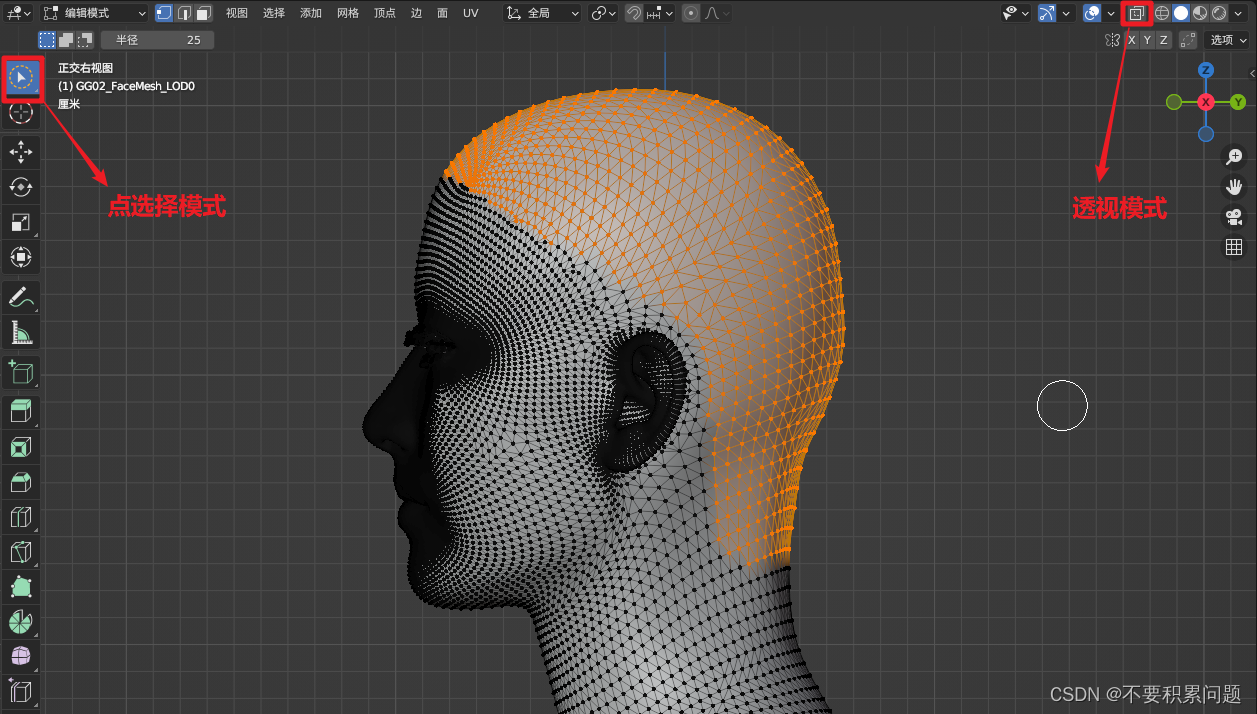

点选择长头发的区域

点选择长头发的区域

shift + d 复制

p 分离 选中项

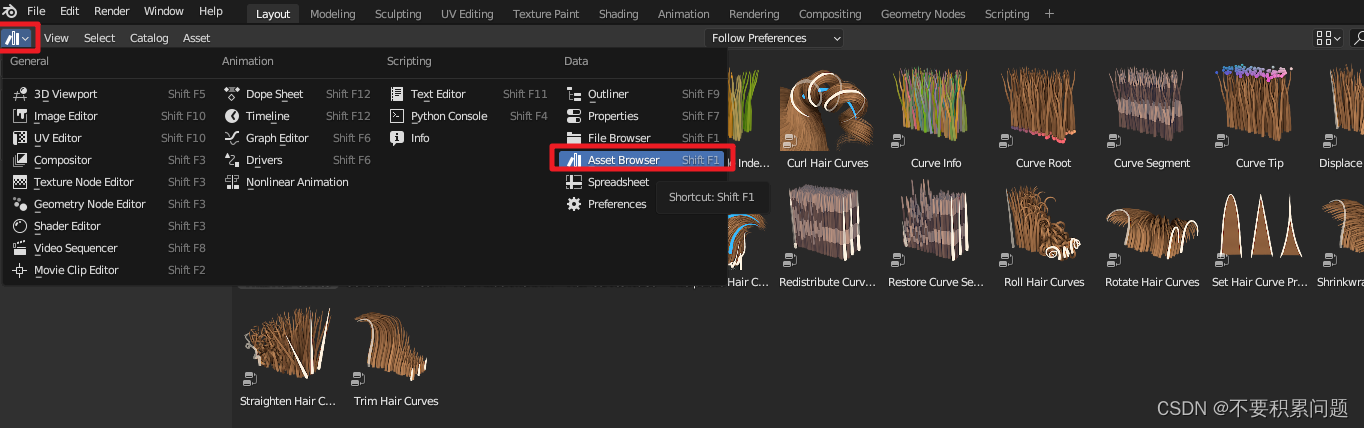

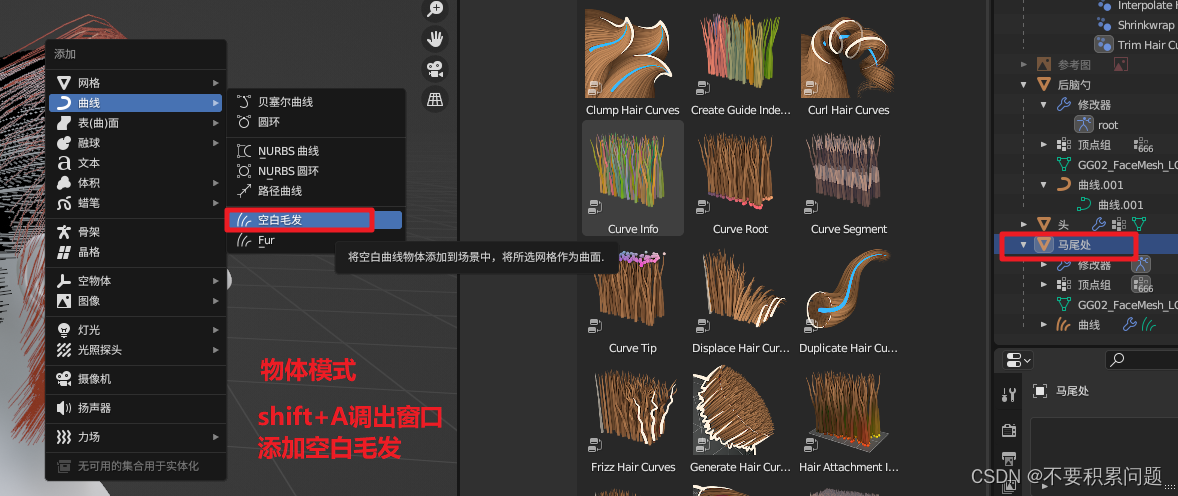

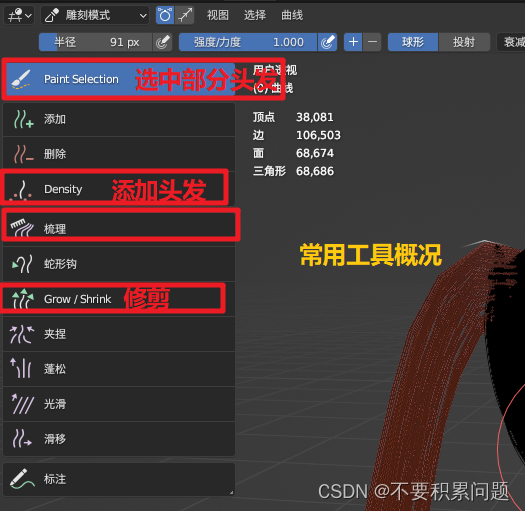

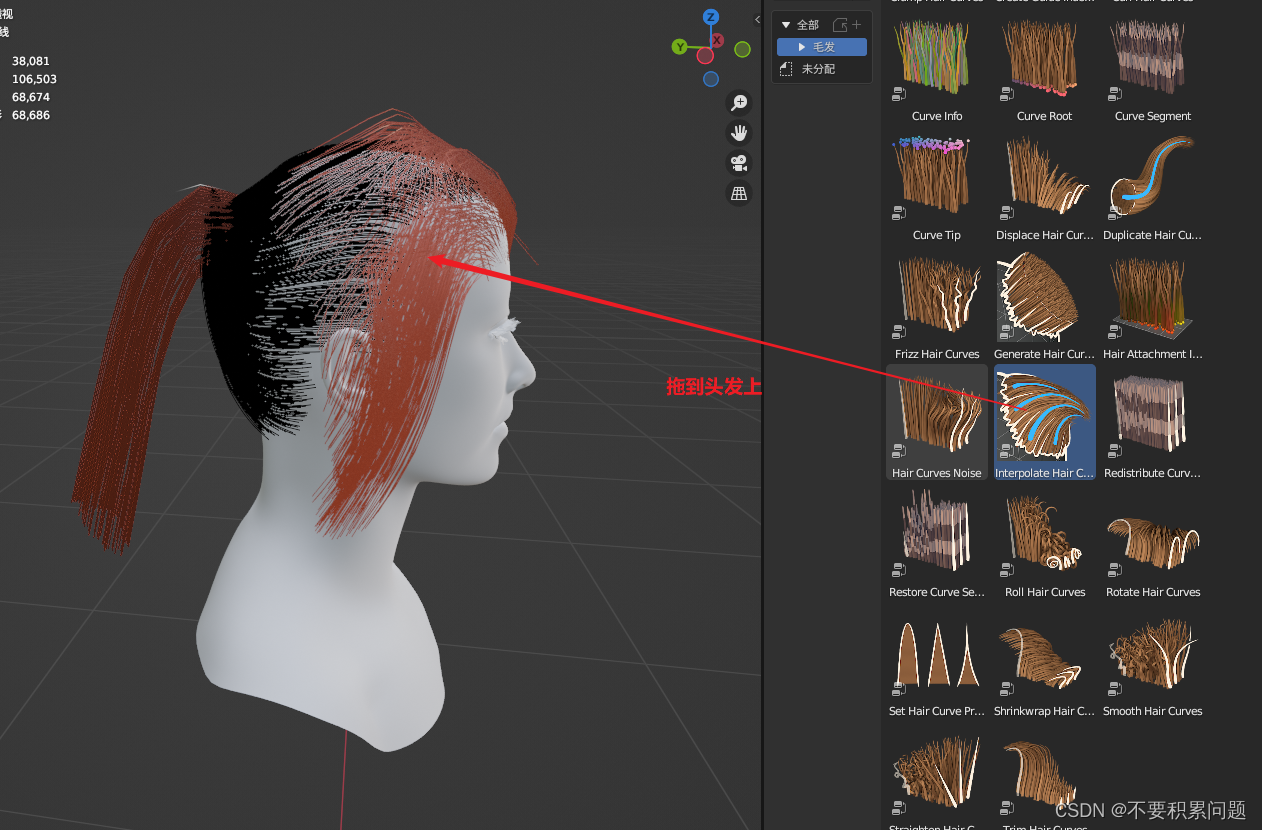

点击曲线改为毛发的雕刻模式

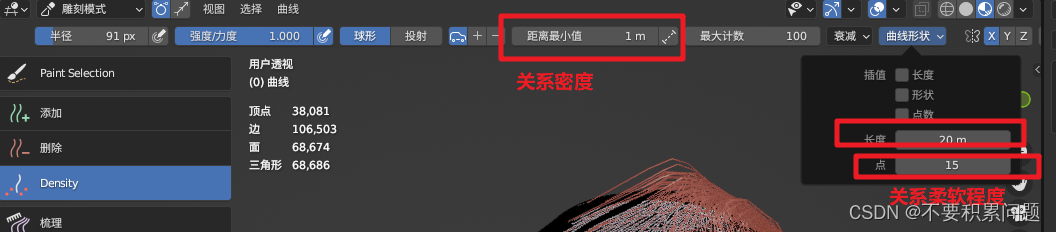

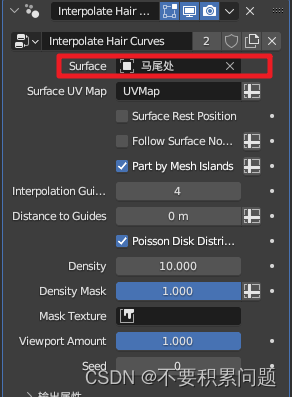

生成头发

在修改器里选择头发面片

在修改器里选择头发面片

导出头发

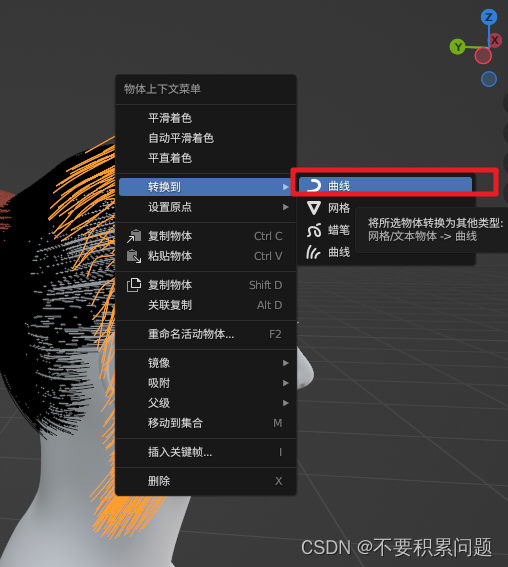

物体模式下选中头发转换为网格

再转化为曲线

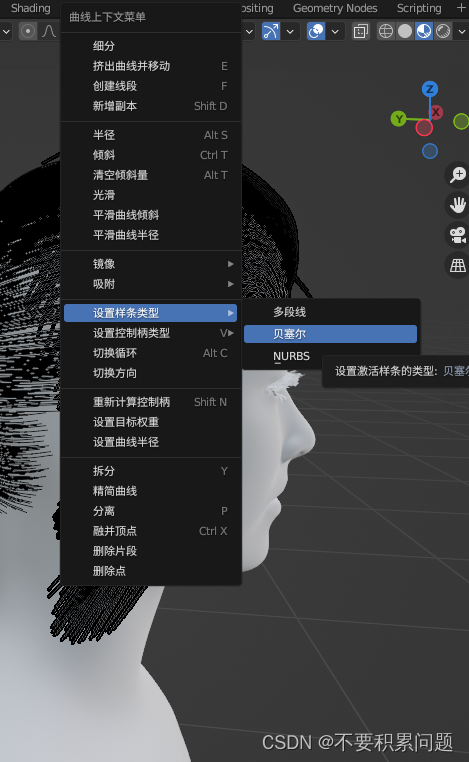

设置样条属性为贝塞尔

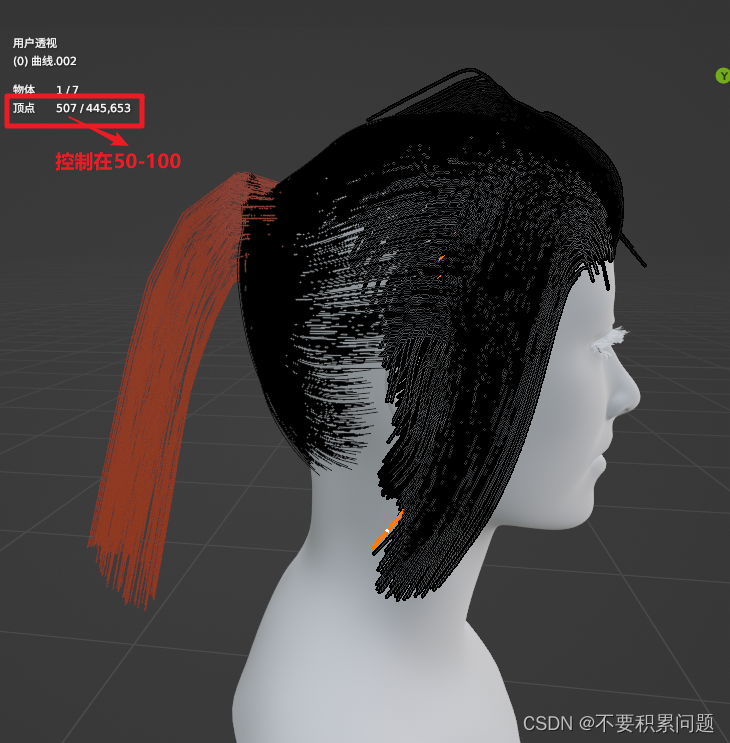

编辑模式下,选中头发的一个点,ctrl+L选中一个,观察顶点数

接下来精简顶点数量,每根控制在50-100左右

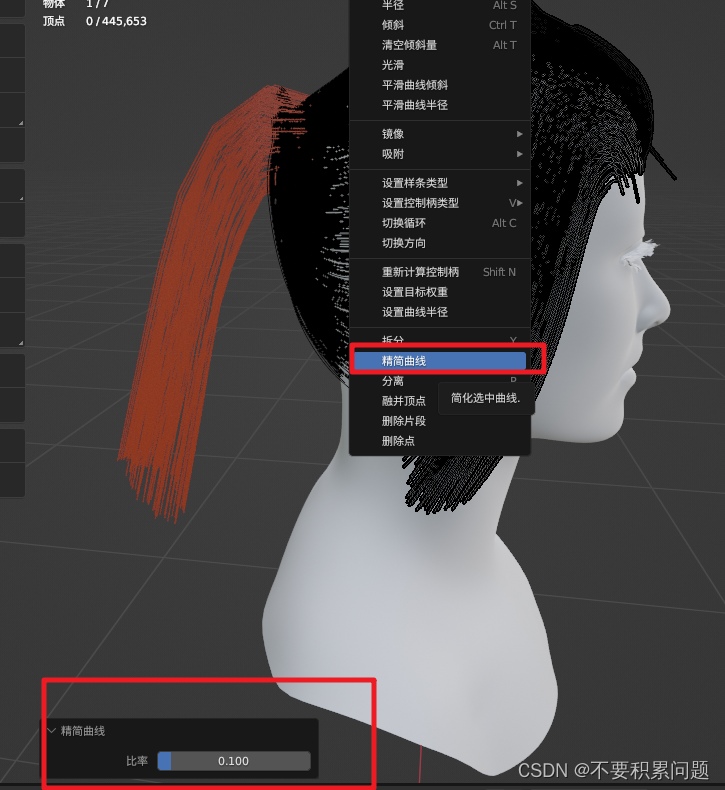

右键全选头发精简曲线,调整精简比例

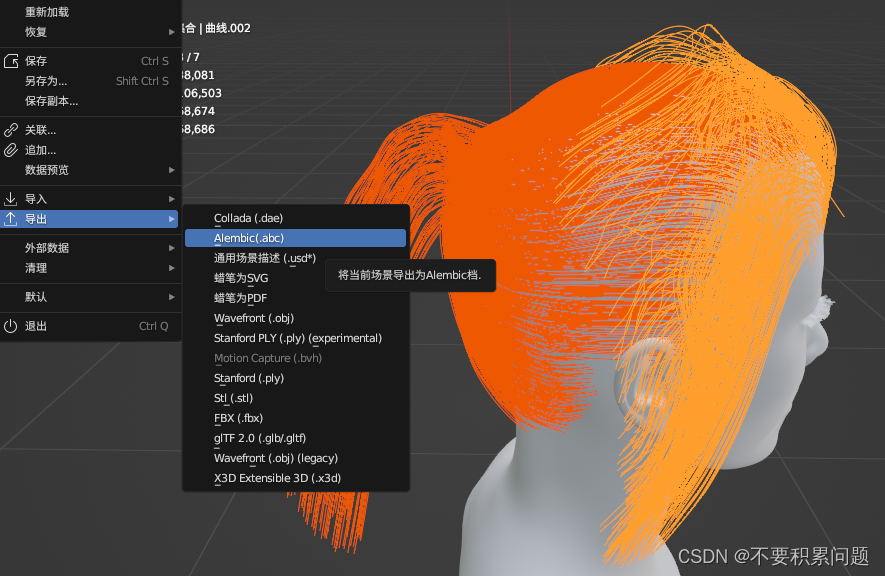

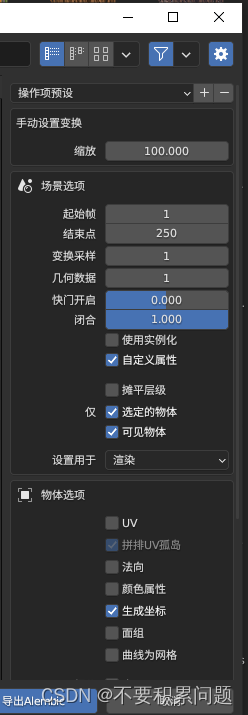

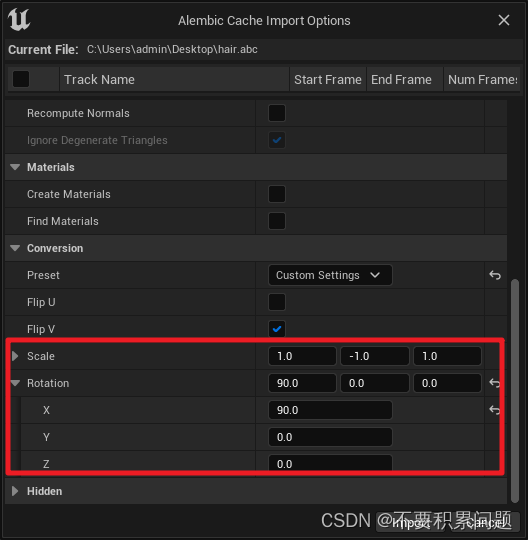

全选导出,设置参数如下

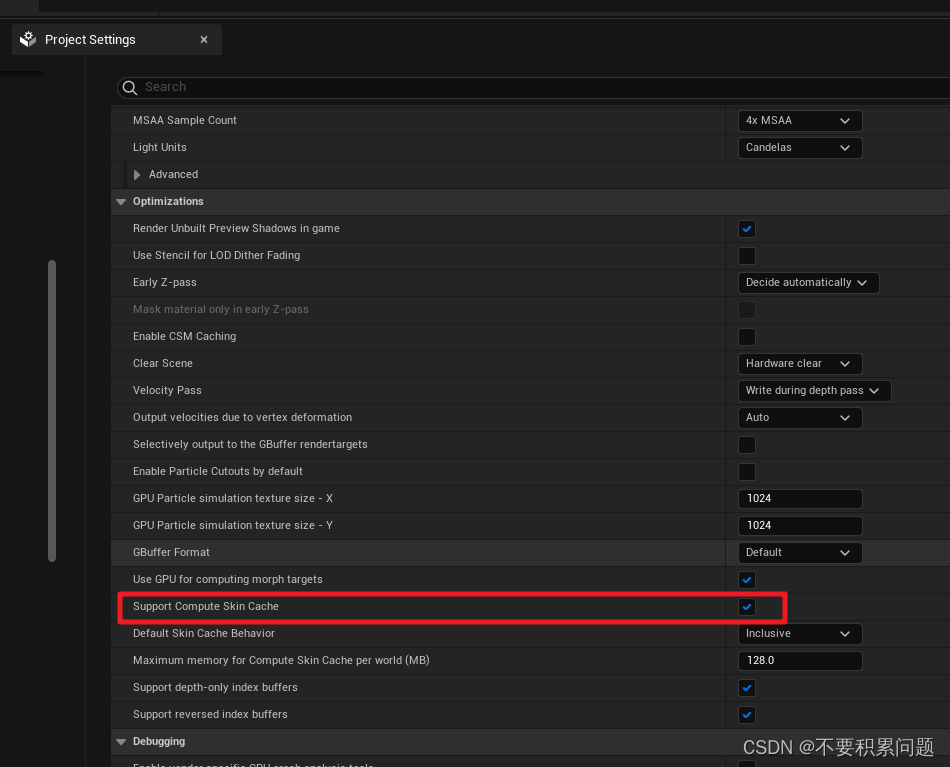

导入头发,打开头发的(重力)模拟

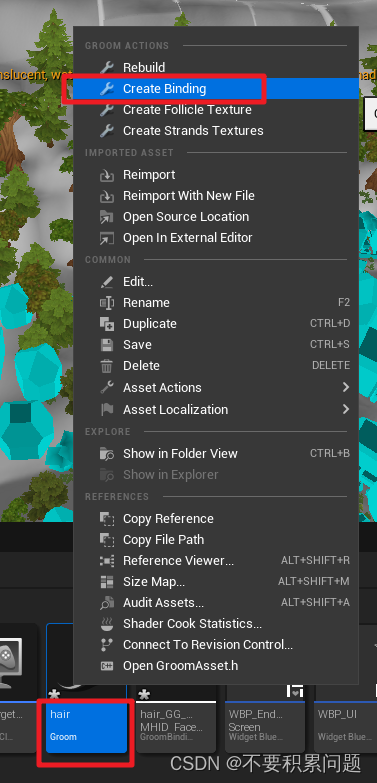

连上相应的数字人的头部模型

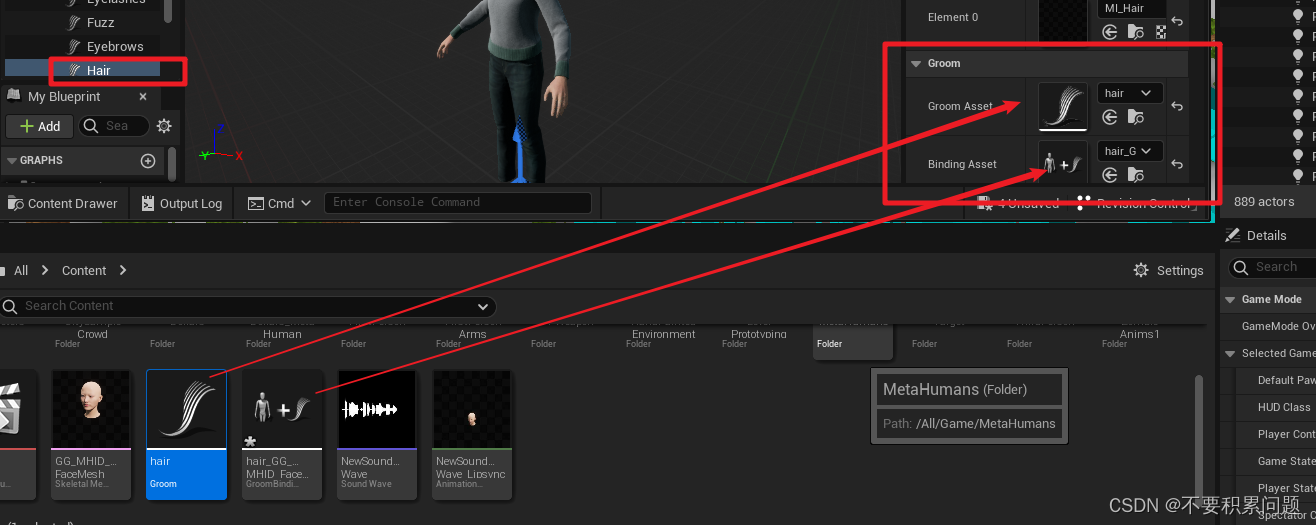

打开数字人,换上新的头发

588

588

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?