(ST-MOE是针对encoder-decoder结构的,对于LLM时代的decoder only,这些实验的结论是否依旧生效,这是一个问题【不一定对】)

1 背景

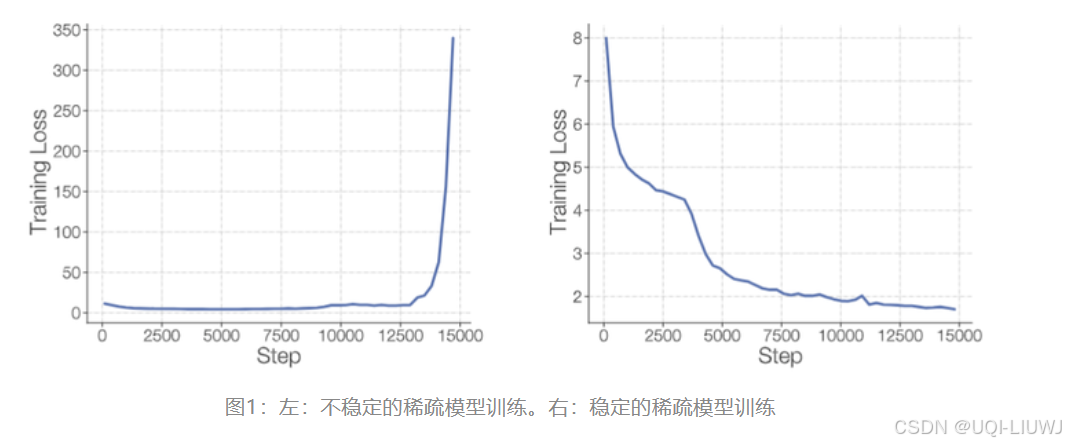

1.1 稀疏模型的训练稳定性

- 稀疏模型通常会受到训练不稳定性的影响,比稠密模型稳定性差

1.2 Transformer结构的改进 对于 稳定性的影响

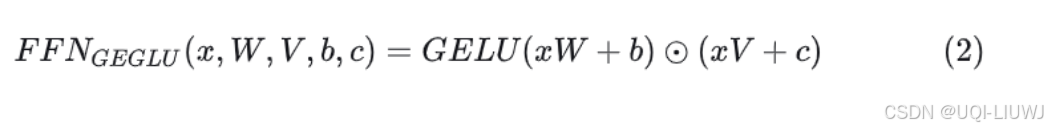

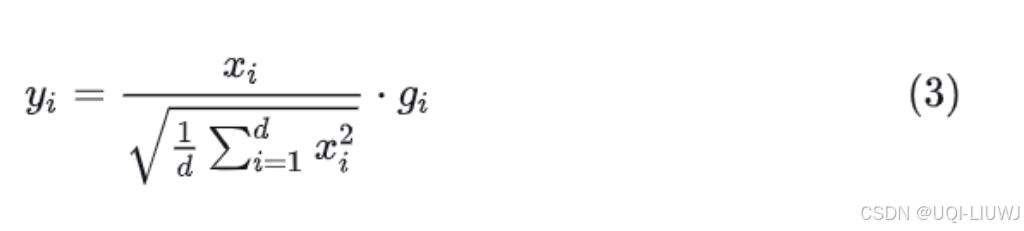

1.2.1 GELU和RMSNorm

LayerNorm换RMSNorm

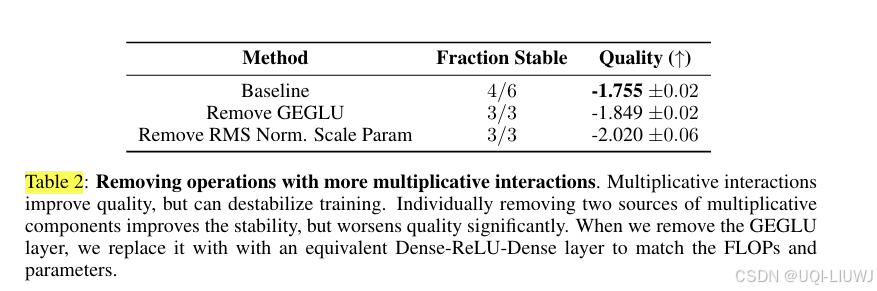

- "Fraction Stable" 表示在实验中成功稳定运行的比例

- 去掉 GEGLU 层,或者是 RMSNorm都会提升训练的稳定性,但是会很大程度地影响模型的质量

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1463

1463

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?