2023 10 arxiv

1 intro

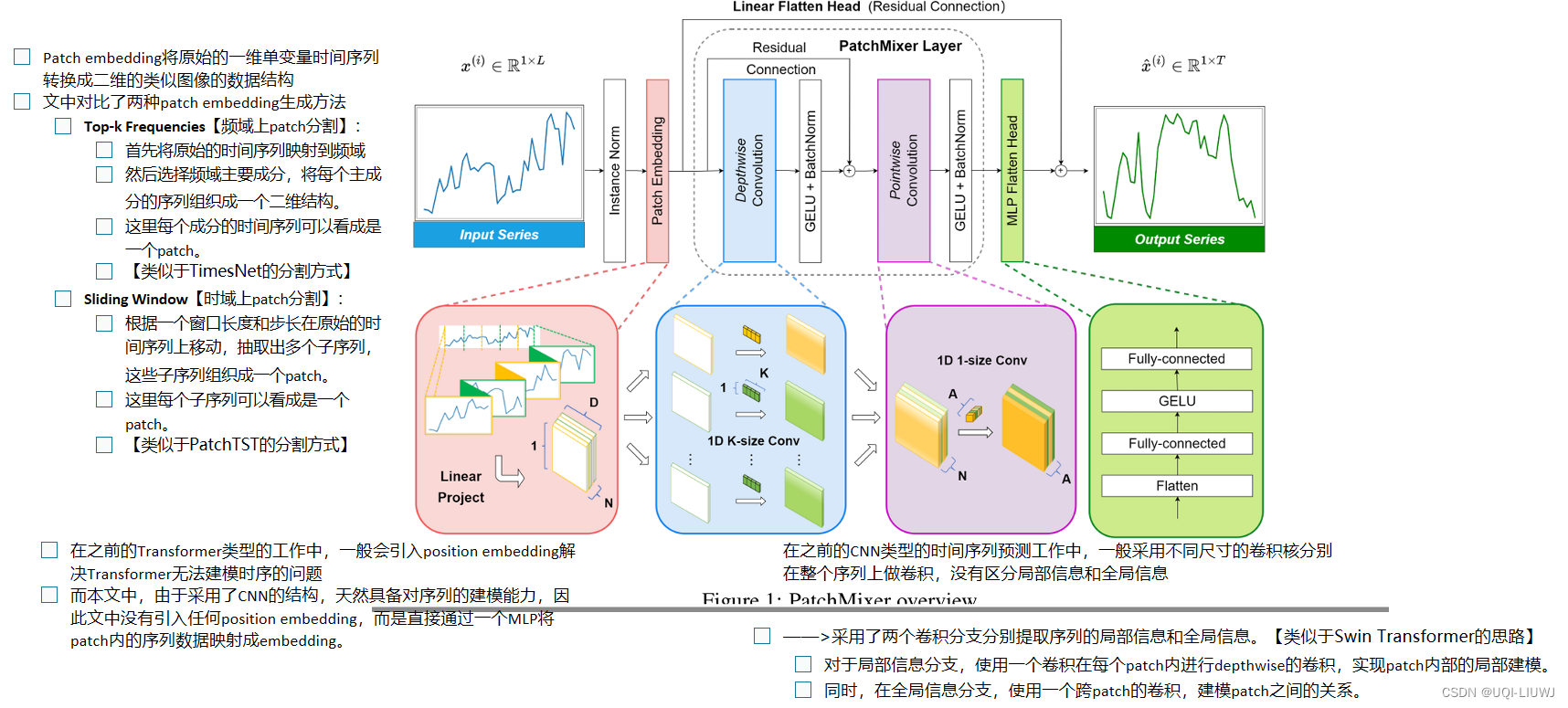

- 对于目前时间序列预测模型中基于Transformer的SOTA 模型来说,他们一般都采用Patch的方式进行数据组织

- 即将时间序列分成多个patch,每个patch通过MLP编码后,输入到Transformer中。

- 很多之前的工作证明了这一种效果的优越性

- ——>但是这种优越性是来自于Transformer还是切Patch呢?

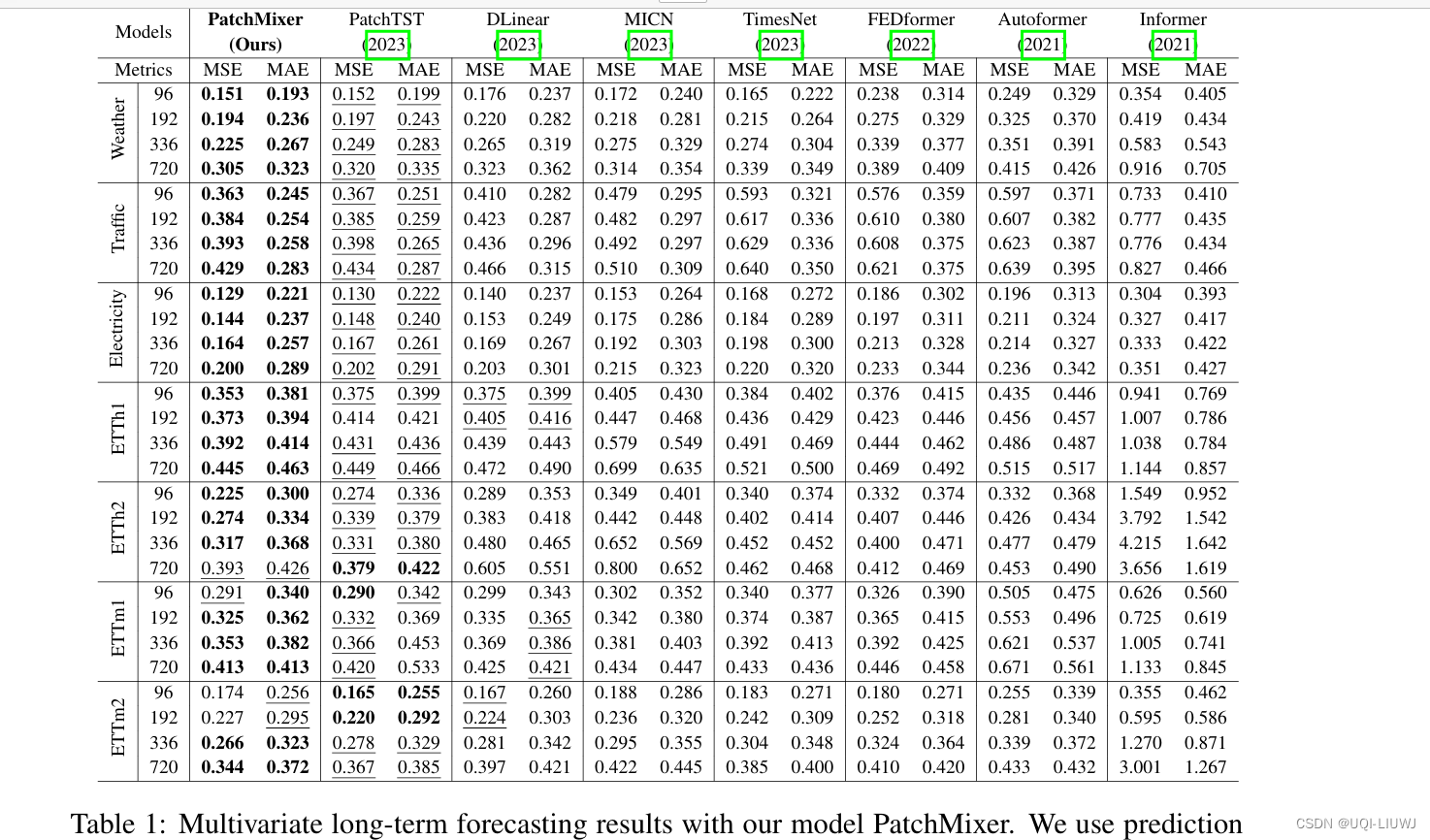

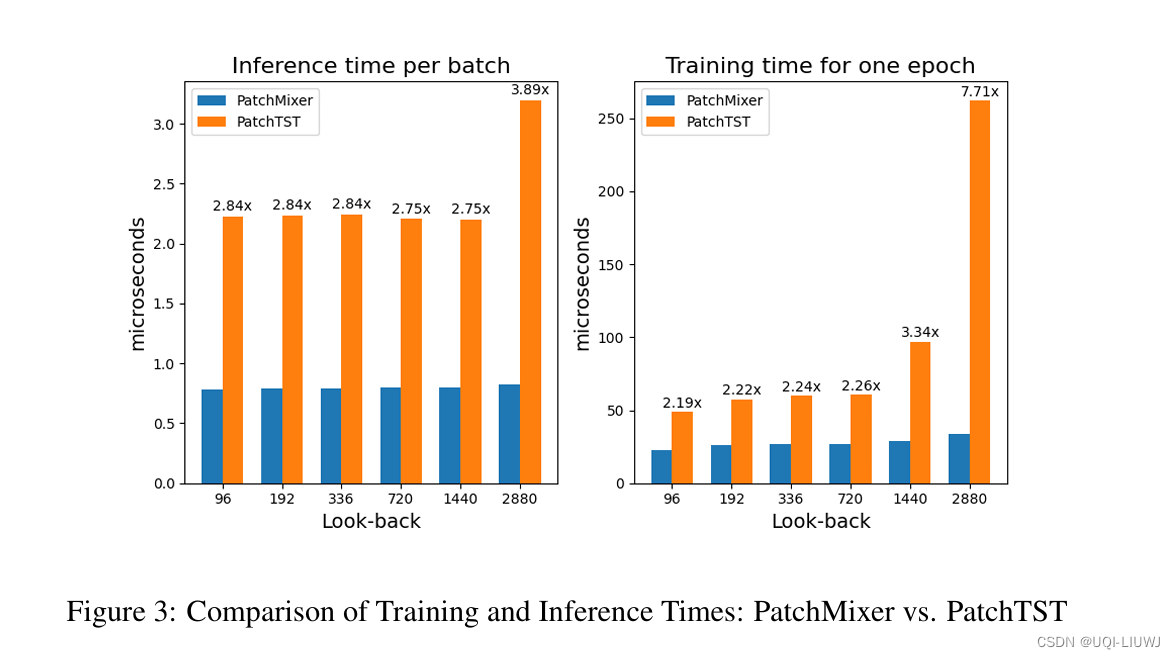

- 本篇论文提出了一种Patch+CNN的模型结构,打败了Transformer模型,取得了SOTA效果(相当于说明了效果的优越性主要来自于切Patch)

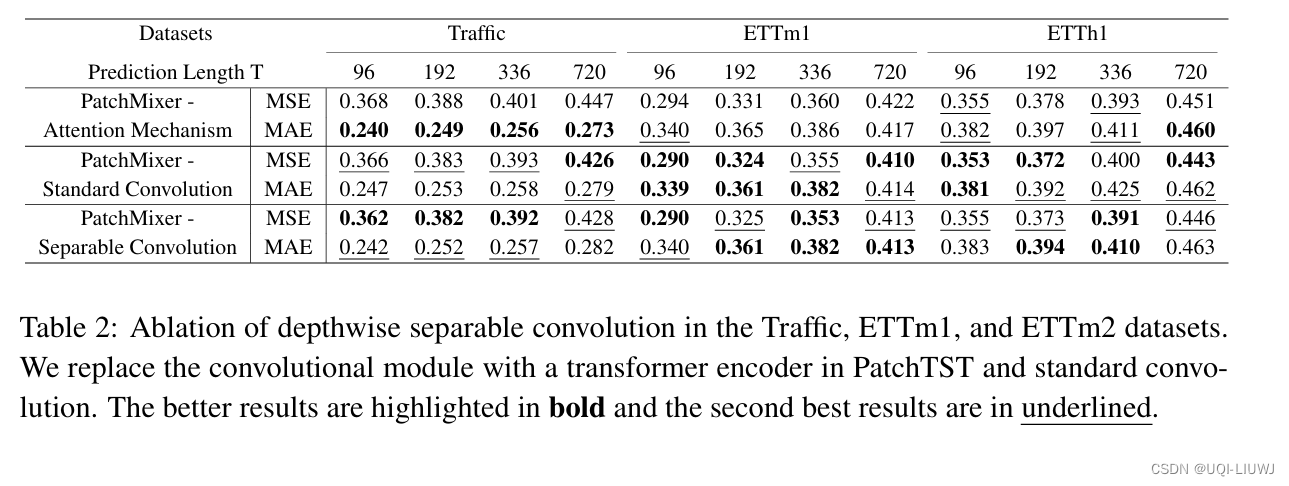

2 方法

3 实验结果

2571

2571

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?