0. 论文信息

标题:Self-Supervised Any-Point Tracking by Contrastive Random Walks

作者:Ayush Shrivastava, Andrew Owens

机构:University of Michigan

原文链接:https://arxiv.org/abs/2409.16288

代码链接:https://github.com/ayshrv/gmrw

官方主页:https://www.ayshrv.com/gmrw

1. 引言

寻找时空对应关系的问题是许多计算机视觉任务的基础。最近关于跟踪任意点(TAP)问题的研究工作已经解决了在长时间范围内进行跟踪的特定挑战:即估计视频中任何给定物理点所有未来和过去的位置。这个问题解决了传统长距离跟踪方法(如链式光流和稀疏跟踪)的局限性,使得其在动画和机器人技术等领域有了应用的可能。然而,获取带标签的训练数据的难度限制了这些模型的能力。因此,现有的模型仅限于在小型的合成数据集上进行训练。

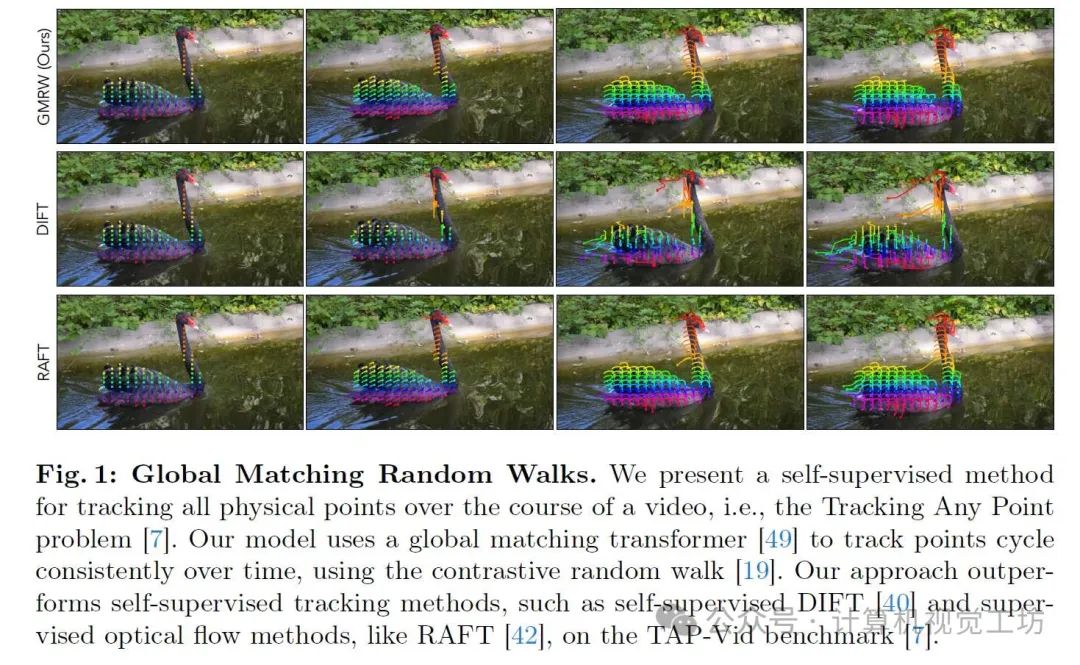

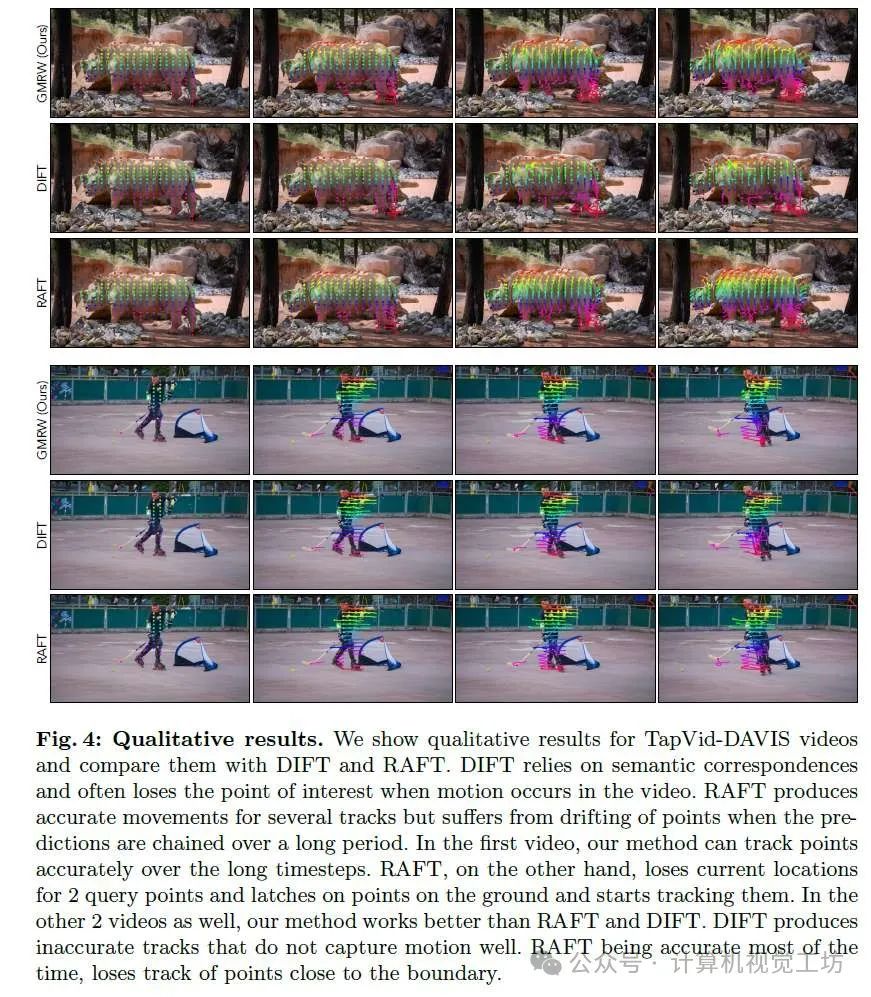

这与计算机视觉的许多其他领域形成了鲜明对比,在这些领域中,自监督方法已经成为一种从未标记数据中学习的强大方式。虽然已经提出了许多用于时空对应关系的自监督方法,但这些方法并不适合长时间范围内跟踪物理点的挑战,这是跟踪任意点(TAP)问题的核心挑战(如图1所示)。例如,自监督光流方法虽然能获得密集的短距离运动场,但在长时间范围内进行跟踪时却会遇到困难;而擅长语义跟踪的方法,如最近一些利用文本到图像扩散特征的新方法,它们将属于同一对象类别的点匹配在一起,但并不一定对应于相同的物理点。

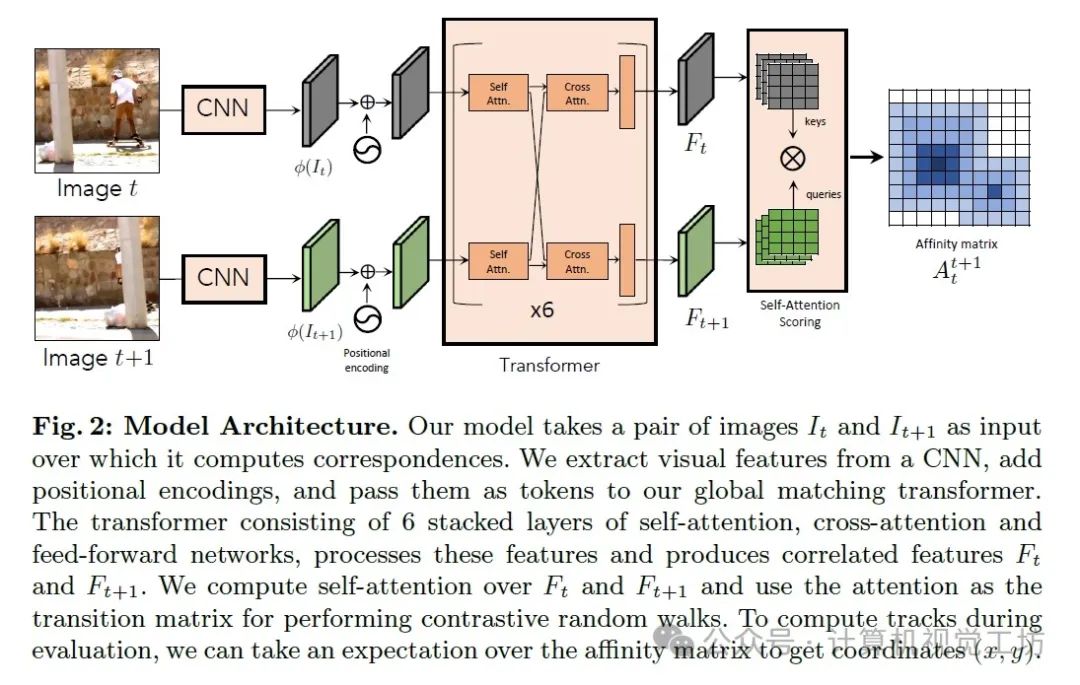

在本文中,我们提出了一种简单而有效的自监督方法来解决跟踪任意点问题。我们调整了全局匹配变换器架构,通过循环一致性进行学习:即先向前跟踪,然后再向后跟踪,应该能回到起点。在没有标记数据的情况下,我们通过对比随机游走来监督模型,利用全局匹配的自注意力来定义随机游走的转移矩阵,该随机游走在相邻帧的点之间移动。这种“所有对”匹配机制使我们能够定义转移矩阵,同时考虑大量的点,从而提高了空间精度,并使我们能够通过考虑在随机游走所执行的时空图上的大量路径来获得更丰富的学习信号。此外,我们还发现全局匹配架构容易受到捷径解决方案的影响(例如,由于它们使用了位置编码),而之前提出的解决这些捷径的方法并不足够。因此,我们提出了一种数据增强方法,以消除这些捷径。

2. 摘要

我们提出了一个简单的,自我监督的方法来跟踪任意点(TAP)问题。

我们训练一个全局匹配转换器,通过对比随机行走在视频中寻找循环一致的轨迹,使用转换器的基于注意力的全局匹配来定义时空图上随机行走的转移矩阵。在点之间执行“所有对”比较的能力允许模型获得高空间精度并获得强对比学习信号,同时避免了最近方法的许多复杂性(例如从粗到细的匹配)。为此,我们提出了许多设计决策,允许通过使用周期一致性的自我监督来训练全局匹配架构。例如,我们发现基于转换器的方法对快捷解决方案很敏感,并提出了一个数据扩充方案来解决它们。

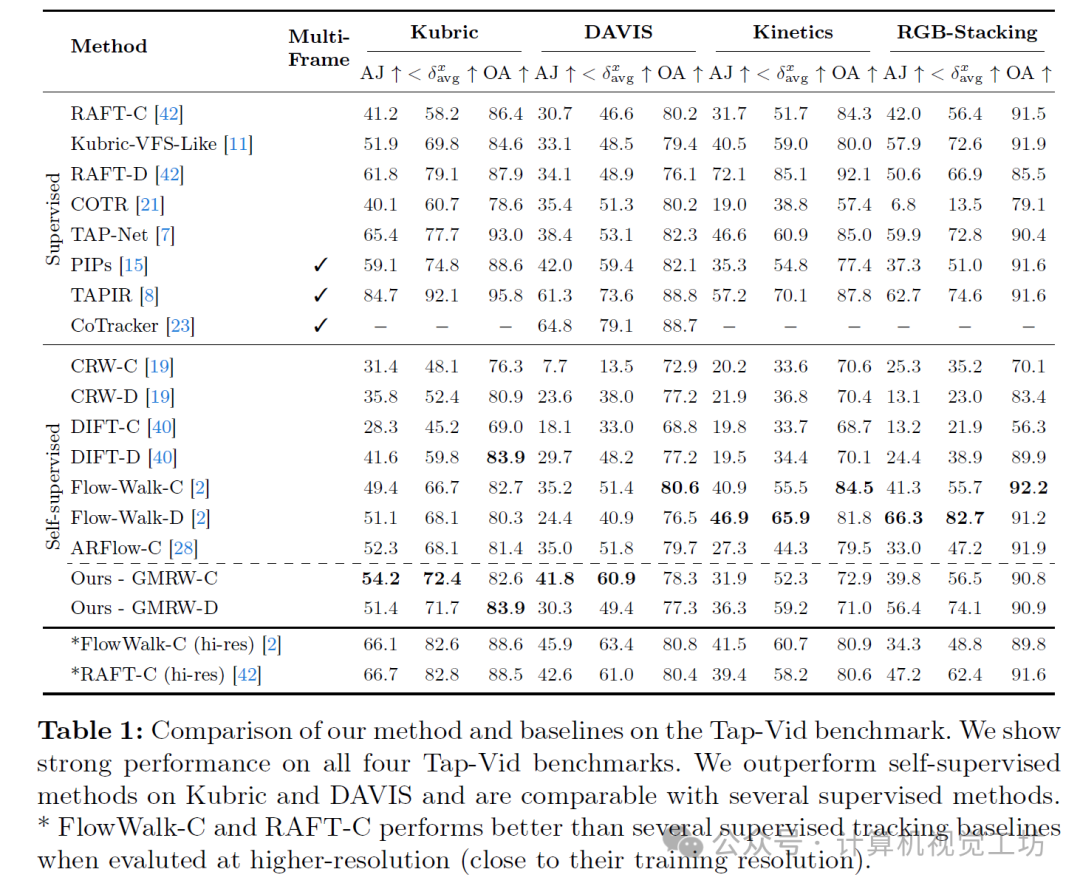

我们的方法在TapVid基准上取得了很好的性能,优于以前的自我监督跟踪方法,如DIFT,并且与几种监督方法具有竞争力。

3. 效果展示

我们提出了一种自监督方法,用于在视频全程中跟踪所有物理点,即跟踪任意点问题。我们的模型使用全局匹配变换器并通过对比随机游走在时间周期上保持一致地跟踪点。在TAP-Vid基准测试上,我们的方法优于自监督跟踪方法(如自监督DIFT)和监督光流方法(如RAFT)。

4. 主要贡献

我们的方法在TAP-Vid基准测试中获得了优异的性能,在TAPVid-DAVIS和Kubric数据集上显著优于之前的自监督跟踪方法。通过实验,我们证明了:

• 自监督模型在跟踪任意点任务中能够获得强大的性能,例如,在许多指标上与TAP-Net竞争。

• 对比随机游走可以成功地扩展到长距离点跟踪。推荐课程:聊一聊经典三维点云方法,包括:点云拼接、聚类、表面重建、QT+VTK等。

• 全局匹配变换器可以通过循环一致性进行训练。

• 数据增强可以消除循环一致性训练中的捷径解决方案。

5. 方法

我们提出了一种简单有效的自我监督方法来跟踪任意点问题。我们调整全局匹配变压器架构,以通过周期一致性进行学习:即,在时间上向前跟踪,然后向后跟踪,应该将我们带回到我们开始的地方。代替标记数据,我们通过对比随机行走来监督模型,使用来自全局匹配的自我注意来定义在相邻帧中的点之间移动的随机行走的转移矩阵。这种“所有对”匹配机制允许我们定义一次考虑大量点的转移矩阵,从而提高空间精度,并使我们能够通过考虑执行随机行走的时空图中的大量路径来获得更丰富的学习信号。此外,我们发现全局匹配架构易受快捷方式解决方案的影响(例如,由于它们使用位置编码),并且以前提出的解决这些快捷方式的方法是不够的。因此,我们提出了一种消除这些捷径的数据扩充类型。

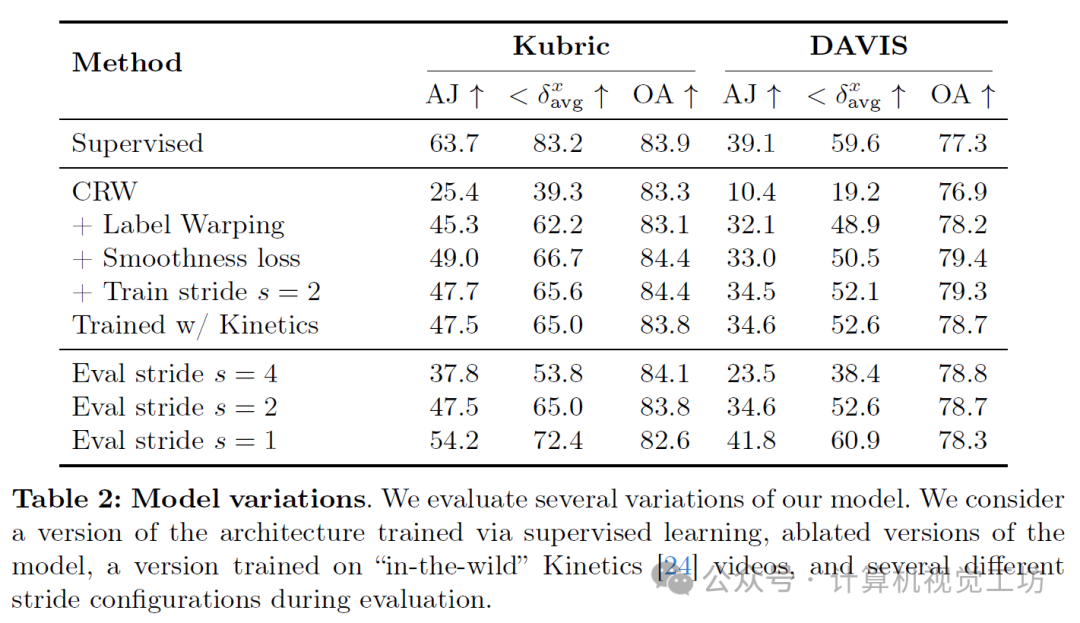

6. 实验结果

7. 总结 & 未来工作

在本文中,我们提出了一种简单的自监督模型,用于解决“跟踪任意点”(Tracking Any Point)任务中的长距离跟踪问题。我们通过对比随机游走的方式,将全局匹配Transformer架构应用于训练。我们的方法在TAP-Vid基准测试中显著优于之前的自监督方法,在某些指标上的表现接近监督式TAP-Net。虽然我们的模型可以利用循环一致性在一定程度上处理遮挡问题,但我们并未明确设计模型来处理遮挡。此外,它也不具备通过遮挡跟踪像素的能力。我们认为这项工作是在构建使用自监督学习训练的跟踪方法方面迈出的一步,也是创建能够从未标记数据中大规模学习的计算机视觉模型的一个尝试。

对更多实验结果和文章细节感兴趣的读者,可以阅读一下论文原文~

3D视觉交流群

目前我们已经建立了3D视觉方向多个社群,包括2D计算机视觉、最前沿、工业3D视觉、SLAM、自动驾驶、三维重建、无人机等方向,细分群包括:

工业3D视觉:相机标定、立体匹配、三维点云、结构光、机械臂抓取、缺陷检测、6D位姿估计、相位偏折术、Halcon、摄影测量、阵列相机、光度立体视觉等。

SLAM:视觉SLAM、激光SLAM、语义SLAM、滤波算法、多传感器融合、多传感器标定、动态SLAM、MOT SLAM、NeRF SLAM、机器人导航等。

自动驾驶:深度估计、Transformer、毫米波|激光雷达|视觉摄像头传感器、多传感器标定、多传感器融合、自动驾驶综合群等、3D目标检测、路径规划、轨迹预测、3D点云分割、模型部署、车道线检测、Occupancy、目标跟踪等。

三维重建:3DGS、NeRF、多视图几何、OpenMVS、MVSNet、colmap、纹理贴图等

无人机:四旋翼建模、无人机飞控等

2D计算机视觉:图像分类/分割、目标/检测、医学影像、GAN、OCR、2D缺陷检测、遥感测绘、超分辨率、人脸检测、行为识别、模型量化剪枝、迁移学习、人体姿态估计等

最前沿:具身智能、大模型、Mamba、扩散模型等

除了这些,还有求职、硬件选型、视觉产品落地、产品、行业新闻等交流群

添加小助理: dddvision,备注:研究方向+学校/公司+昵称(如3D点云+清华+小草莓), 拉你入群。

520

520

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?