2025深度学习发论文&模型涨点之——SHAP可解释性学习+聚类分析

SHAP(SHapley Additive exPlanations)是一种基于博弈论的可解释性方法。它将机器学习模型的输出解释为特征对输出的贡献值。SHAP值是根据Shapley值(来自博弈论)计算得到的,能够衡量每个特征在模型预测中所起的作用大小。

-

在博弈论中,Shapley值用于公平地分配合作博弈中的收益。例如,假设有一群人合作完成一项任务并获得收益,Shapley值可以确定每个人对收益的贡献程度。在机器学习模型中,特征就像是合作的“玩家”,模型的输出(如预测结果)是“收益”。

-

Shapley值的计算考虑了所有可能的特征组合。对于一个有n个特征的模型,需要考虑2n种特征组合情况。不过,SHAP通过一些优化算法(如SHAP的TreeSHAP算法针对树模型进行优化)来高效地近似计算Shapley值。

小编整理了一些SHAP可解释性学习+聚类分析【论文】合集,以下放出部分,全部论文PDF版皆可领取。

需要的同学扫码添加我

回复“SHAP可解释性学习+聚类分析”即可全部领取

论文精选

论文1:

Beyond explaining: XAI-based Adaptive Learning with SHAP Clustering for Energy Consumption Prediction

超越解释:基于XAI的自适应学习与SHAP聚类用于能源消耗预测

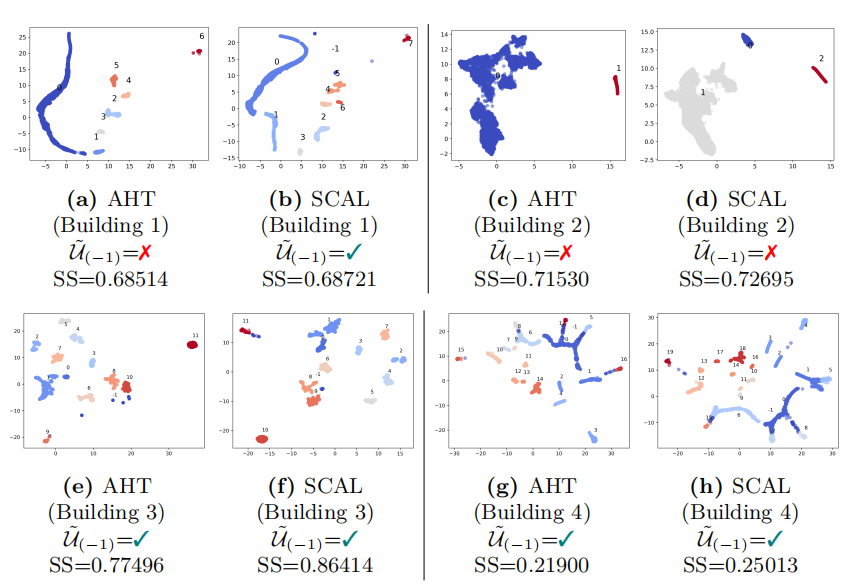

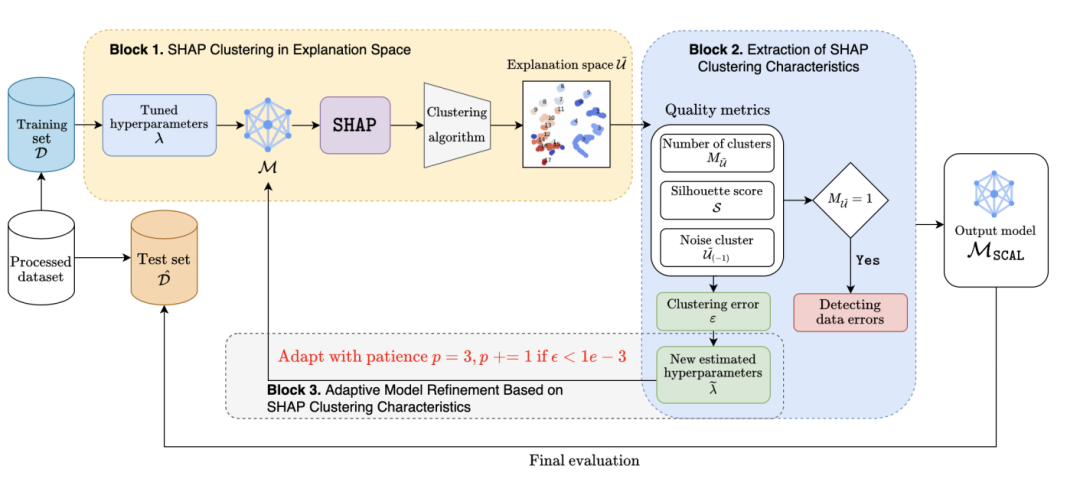

方法

-

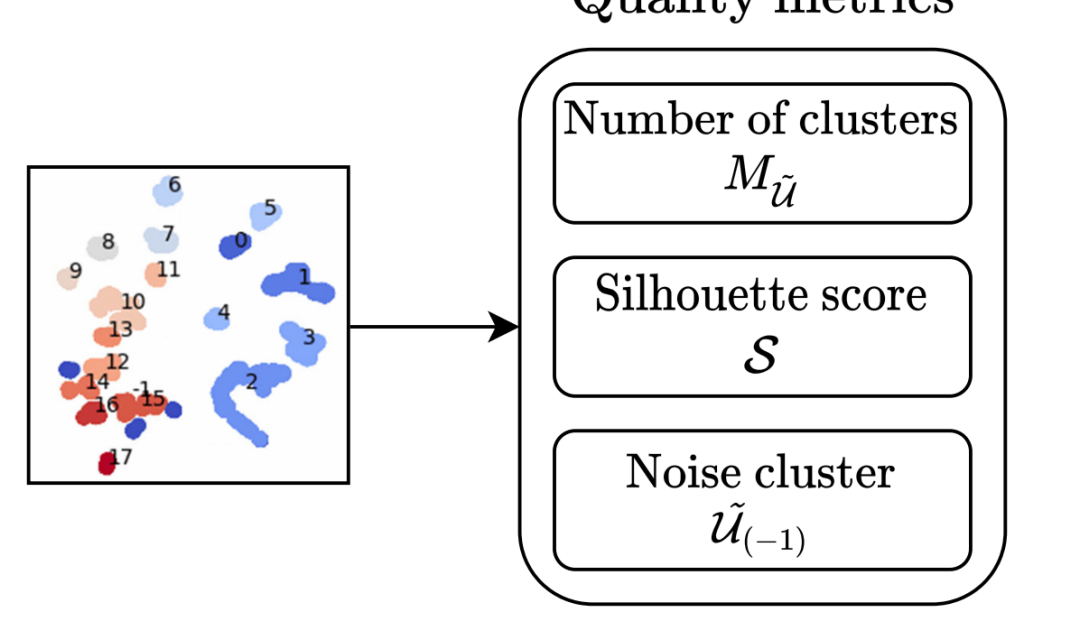

SHAP值计算:利用SHapley Additive exPlanations (SHAP)计算每个特征对模型预测的贡献值,为模型解释提供基础。

聚类分析:通过DBSCAN算法对SHAP值进行聚类,识别数据中的不同模式和异常点。

模型自适应调整:根据聚类结果调整模型的超参数,如最大深度和正则化参数,以提高模型对数据分布变化的适应性。

自动化超参数调整:结合自动化超参数调整算法(AHT),优化模型的初始参数设置。

创新点

-

SHAP聚类:将SHAP值与聚类分析结合,为模型预测提供可解释性的同时,识别数据中的不同模式,提升模型对数据分布变化的适应性。

性能提升:实验表明,该方法在测试集上的均方根误差(RMSE)和决定系数(r2)指标上优于传统自适应超参数调整方法(AHT),具体表现为更低的RMSE和更高的r2值。

模型复杂性与性能平衡:通过迭代调整模型的超参数,如最大深度和正则化参数,有效平衡了模型复杂性与预测性能,减少了过拟合的风险。

跨领域适用性:该方法不仅适用于能源消耗预测,还成功应用于金融困境预测和电力消耗预测等其他领域,展示了其广泛的适用性。

论文2:

Combining SHAP-driven Co-clustering and Shallow Decision Trees to Explain XGBoost

结合SHAP驱动的共聚类和浅决策树来解释XGBoost

方法

-

SHAP值计算:利用SHAP框架计算每个特征对XGBoost模型预测的贡献值。

共聚类分析:通过基于Goodman-Kruskal τ的共聚类算法对数据实例和特征进行同时聚类,优化特征和数据实例之间的关联。

浅决策树生成:针对每个聚类生成浅决策树,使用聚类中最重要的特征子集进行训练,以提供简洁的决策路径。

局部解释:通过SHAP值将新数据实例映射到最近的聚类,并使用对应的浅决策树提供局部解释。

创新点

-

SHAP驱动的共聚类:首次将SHAP值与共聚类结合,为XGBoost模型提供全局解释,通过共聚类优化特征和数据实例之间的关联。

性能提升:在多个数据集上,该方法的保真度(fidelity)与现有方法相当,但决策路径的平均长度显著缩短,具体表现为比现有方法XGBTA和MaSDT更短的决策路径。

简洁性与可解释性:生成的浅决策树具有更高的可解释性,能够以简洁的决策路径形式提供局部解释,满足法律透明度要求。

模型无关性:该方法不仅适用于XGBoost,还可以扩展到其他基于梯度提升树的模型,具有广泛的适用性。

论文3:

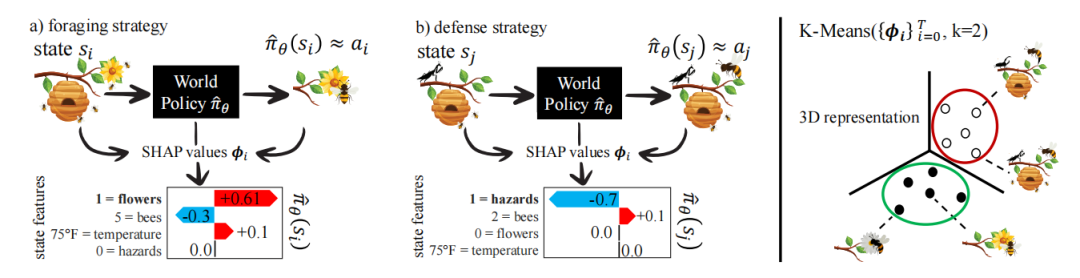

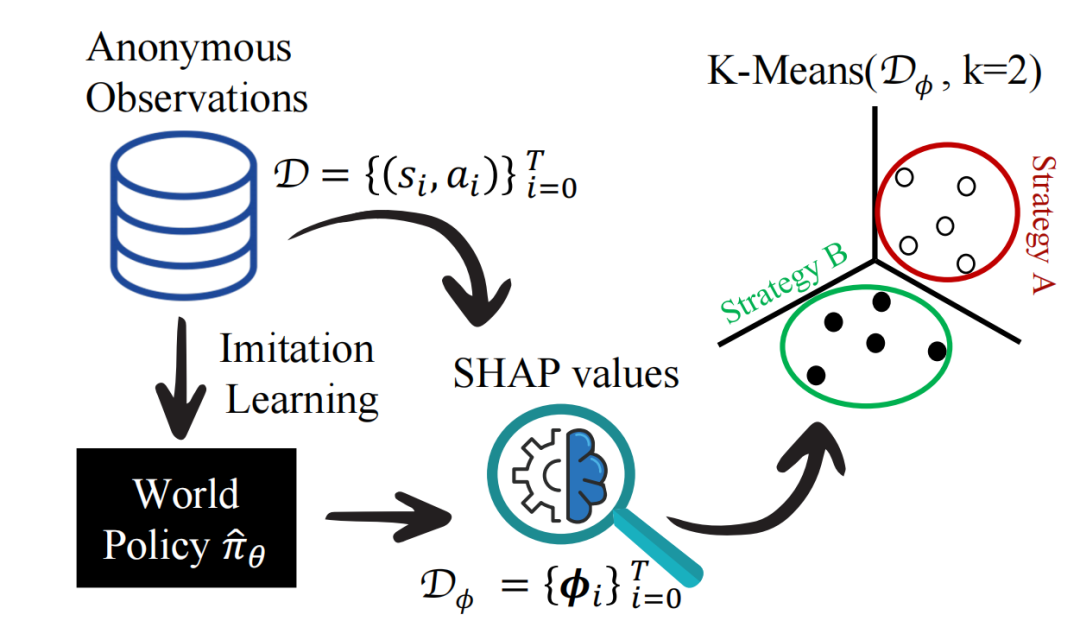

K-SHAP: Policy Clustering Algorithm for Anonymous Multi-Agent State-Action Pairs

K-SHAP:匿名多智能体状态-动作对的策略聚类算法

方法

-

世界策略学习:将问题建模为模仿学习任务,学习一个世界策略来模拟所有智能体的行为。

SHAP值计算:利用SHAP值解释世界策略的预测,将每个状态-动作对的SHAP值作为新的特征空间。

K-Means聚类:在SHAP值空间中应用K-Means算法,将匿名状态-动作对聚类到不同的策略簇中。

策略识别:通过聚类结果识别不同的智能体策略,为每个簇分配相应的策略标签。

创新点

-

匿名状态-动作对聚类:首次提出针对匿名多智能体状态-动作对的策略聚类方法,解决了在金融等领域的匿名数据问题。

性能提升:在合成市场数据和真实金融市场数据上,K-SHAP的聚类性能显著优于现有方法,如K-Means、ClusterGAN和DCN等,具体表现为更高的ARI、NMI和纯度分数。

策略识别能力:能够有效识别不同的智能体策略,为市场参与者的行为分析和策略研究提供了新的工具。

适应性:该方法适用于不同的市场场景和智能体行为模式,具有广泛的适用性和适应性。

论文4:

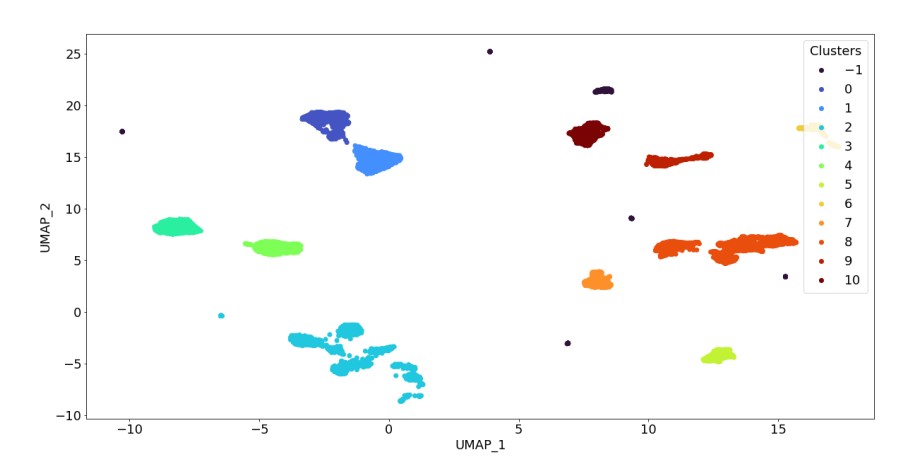

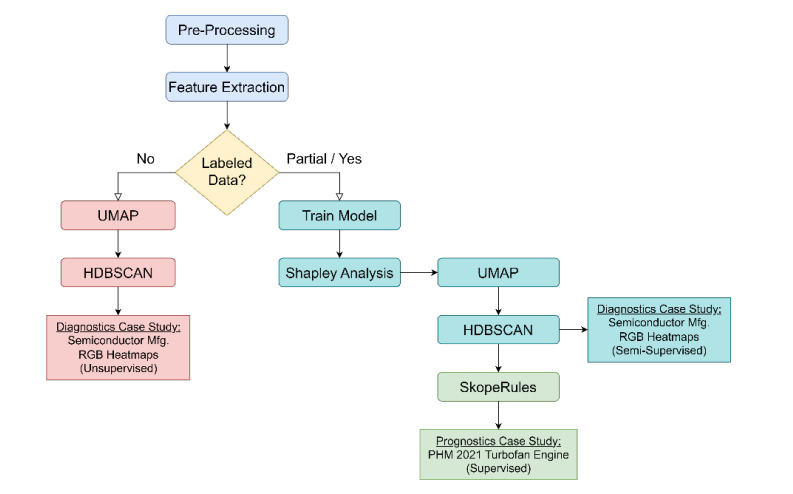

Shapley-based Explainable AI for Clustering Applications in Fault Diagnosis and Prognosis

基于Shapley值的可解释人工智能在故障诊断和预测中的聚类应用

方法

-

Shapley值计算:利用SHAP和蒙特卡洛采样方法计算Shapley值,为模型预测提供特征贡献度量。

降维与可视化:通过UMAP(Uniform Manifold Approximation and Projection)技术进行降维,以便于聚类和可视化。

密度聚类:使用HDBSCAN(Hierarchical Density-Based Spatial Clustering of Applications with Noise)算法进行聚类,识别数据中的密集区域。

规则生成:利用SkopeRules生成高精度的决策规则,以描述聚类结果。

创新点

-

半监督聚类:提出了基于Shapley值的半监督聚类框架,适用于部分标记数据集,解决了实际工业应用中数据标记不完整的问题。

性能提升:在半导体制造热图数据集上,半监督Shapley聚类相比于无监督聚类,显著提高了聚类质量,减少了未聚类样本的比例,具体表现为更高的NMI值和更低的未聚类样本比例。

高精度规则生成:生成的聚类规则具有高精度,能够以简洁的形式描述聚类结果,为故障诊断和预测提供了可解释的依据。

多视角分析:在涡扇发动机预测案例中,该方法不仅能够预测当前健康状态,还能预测故障组件和剩余使用寿命,为预测性维护提供了全面的决策支持。

小编整理了SHAP可解释性学习+聚类分析论文代码合集

需要的同学扫码添加我

回复“ SHAP可解释性学习+聚类分析”即可全部领取

4528

4528

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?