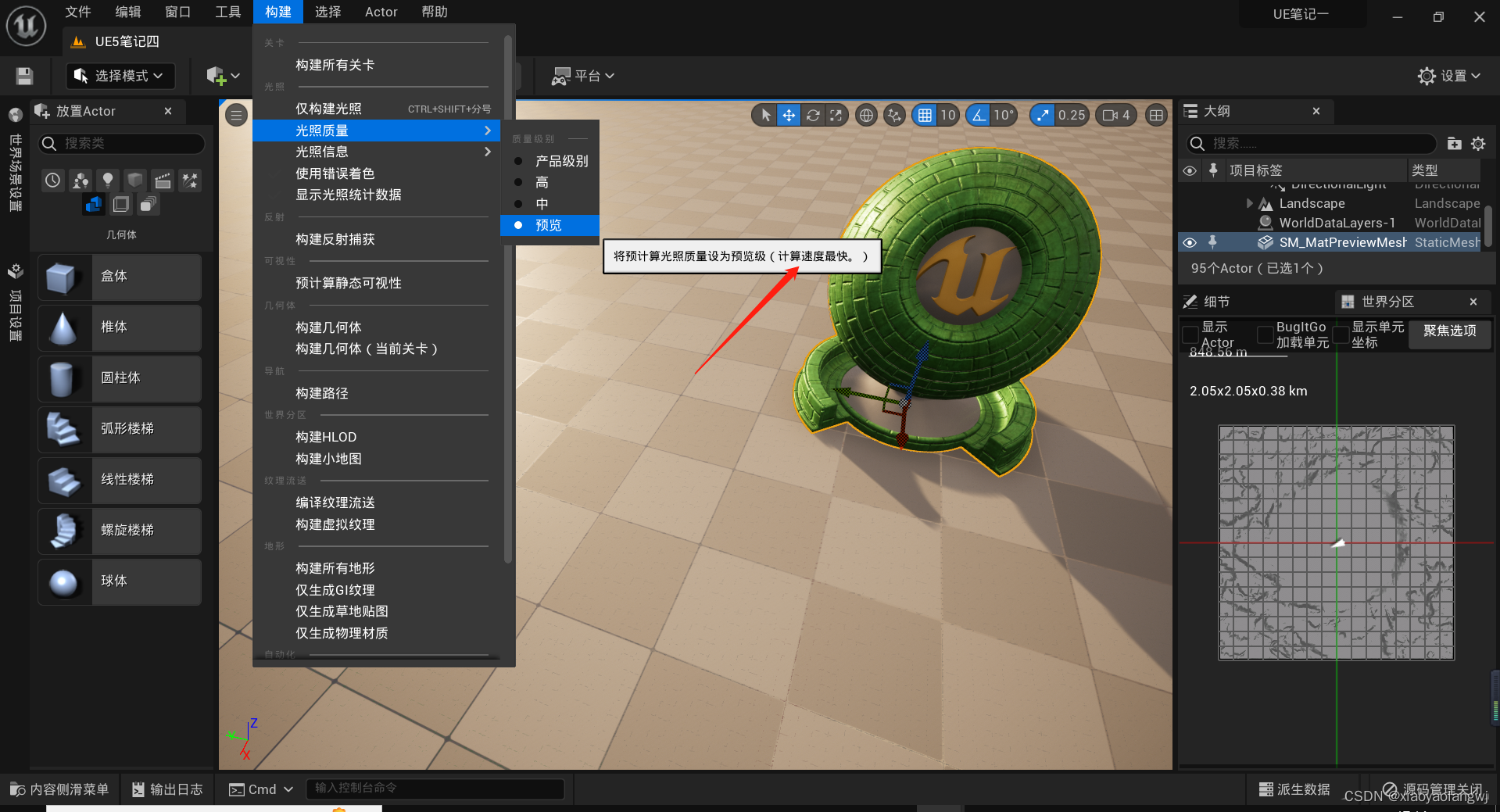

设置光线重载质量模式为预览:可以加快重构速度。

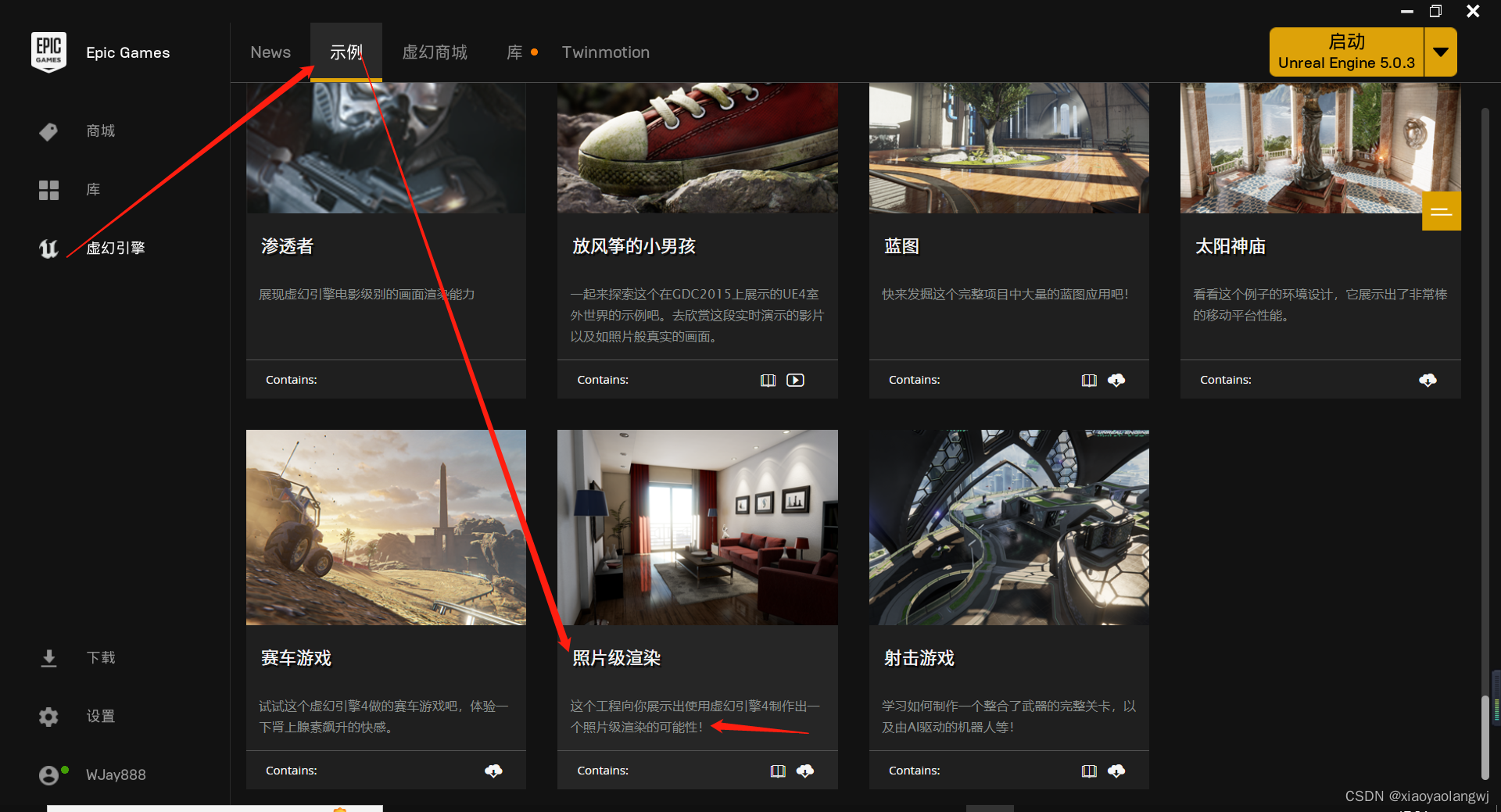

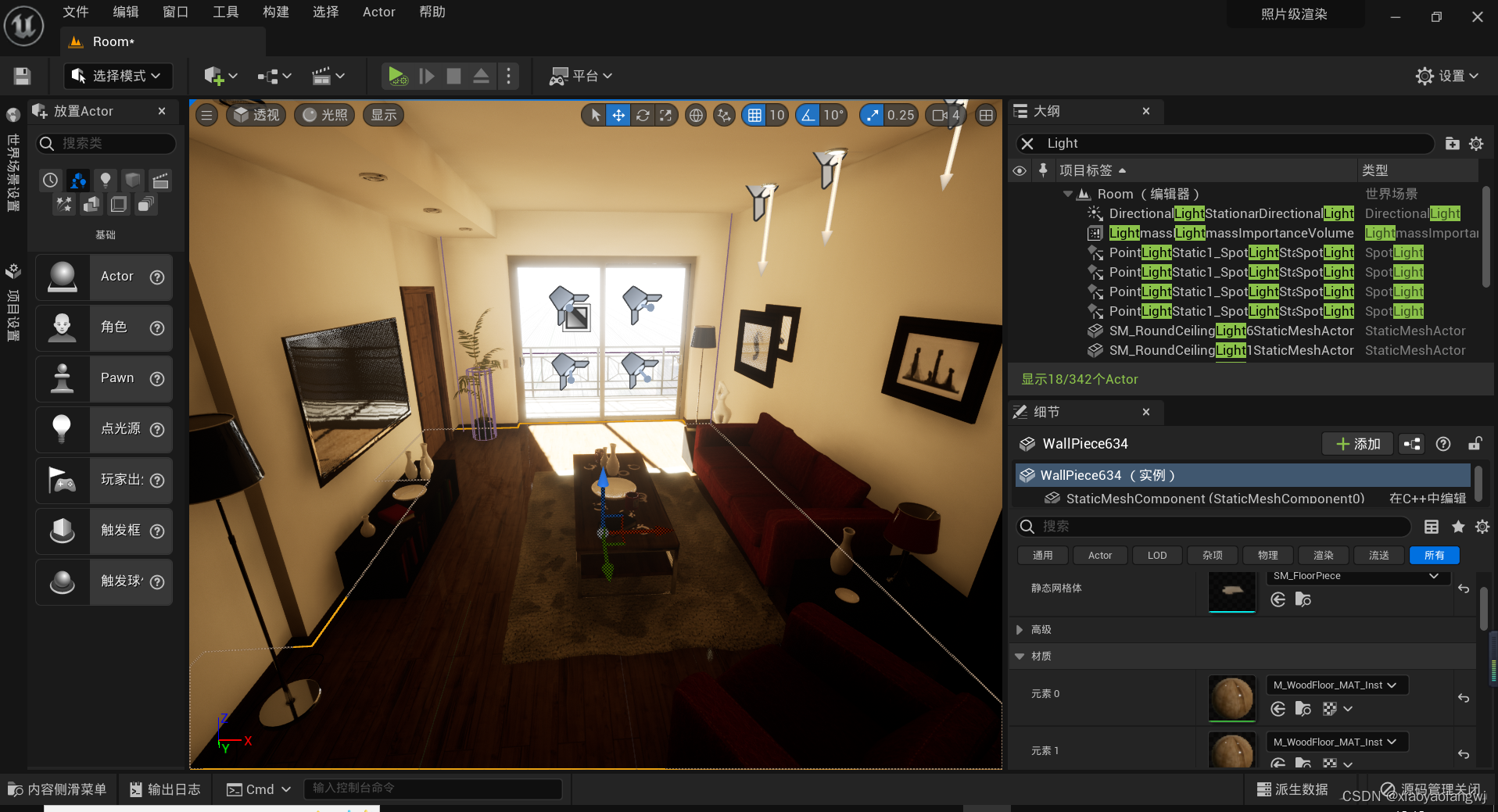

为了更快速高效的学习,直接查看别人已经建好的素材实例。

在EpicGames启动器中打开示例,找到这个照片级渲染。查看别人建好的效果图。

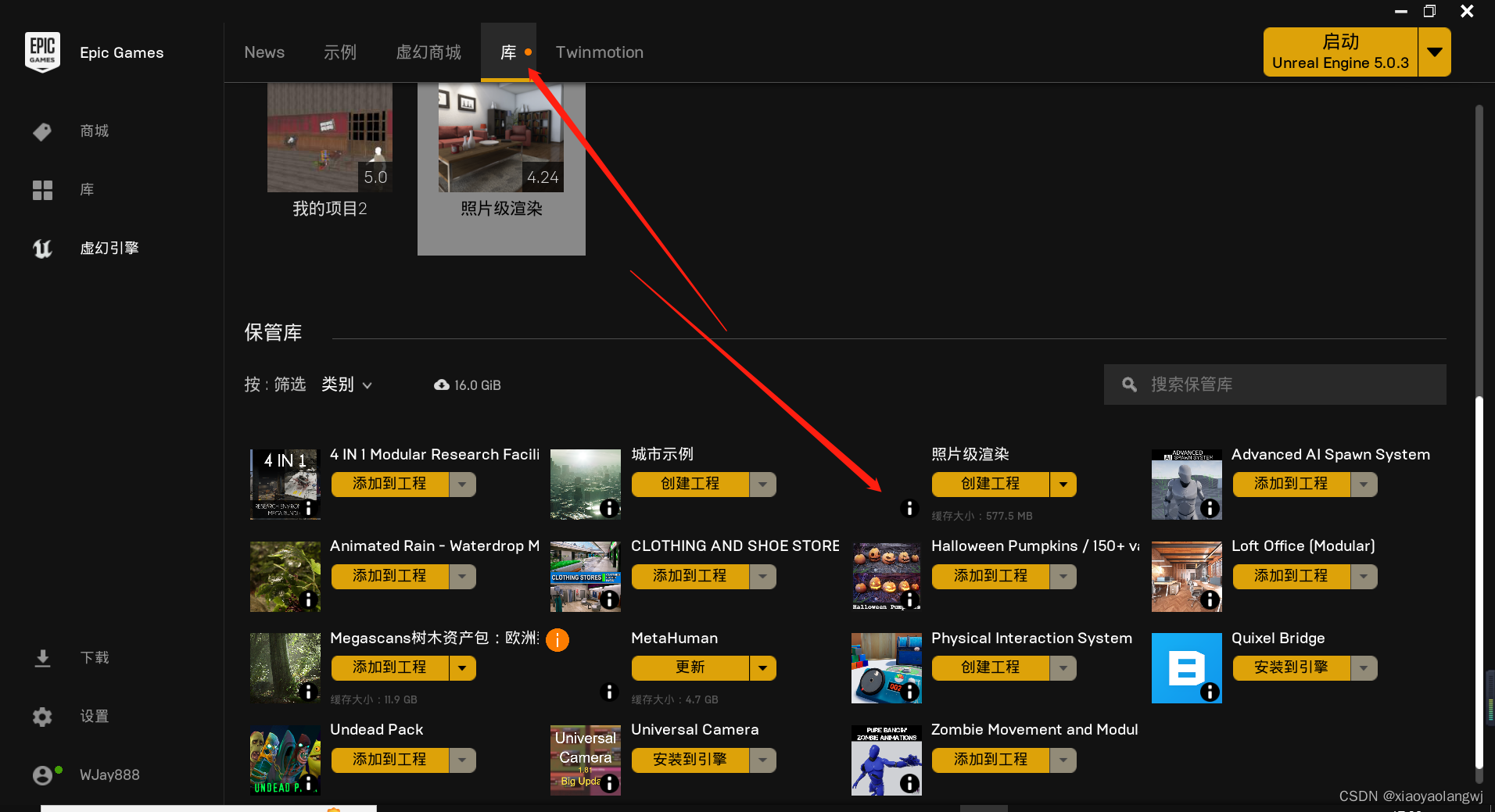

创建工程以UE5版本打开。进入查看。

观察Baked和碰撞测试。

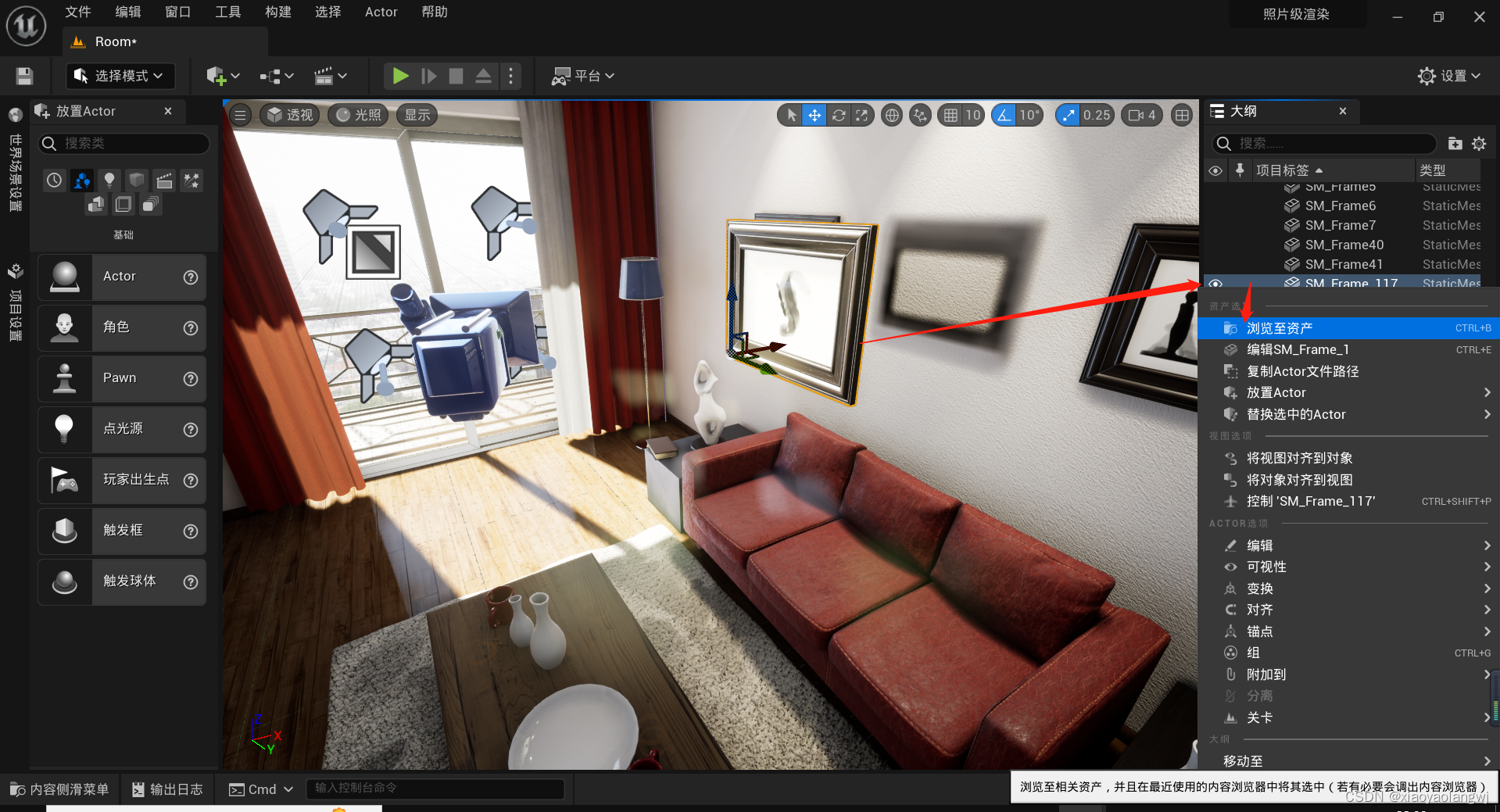

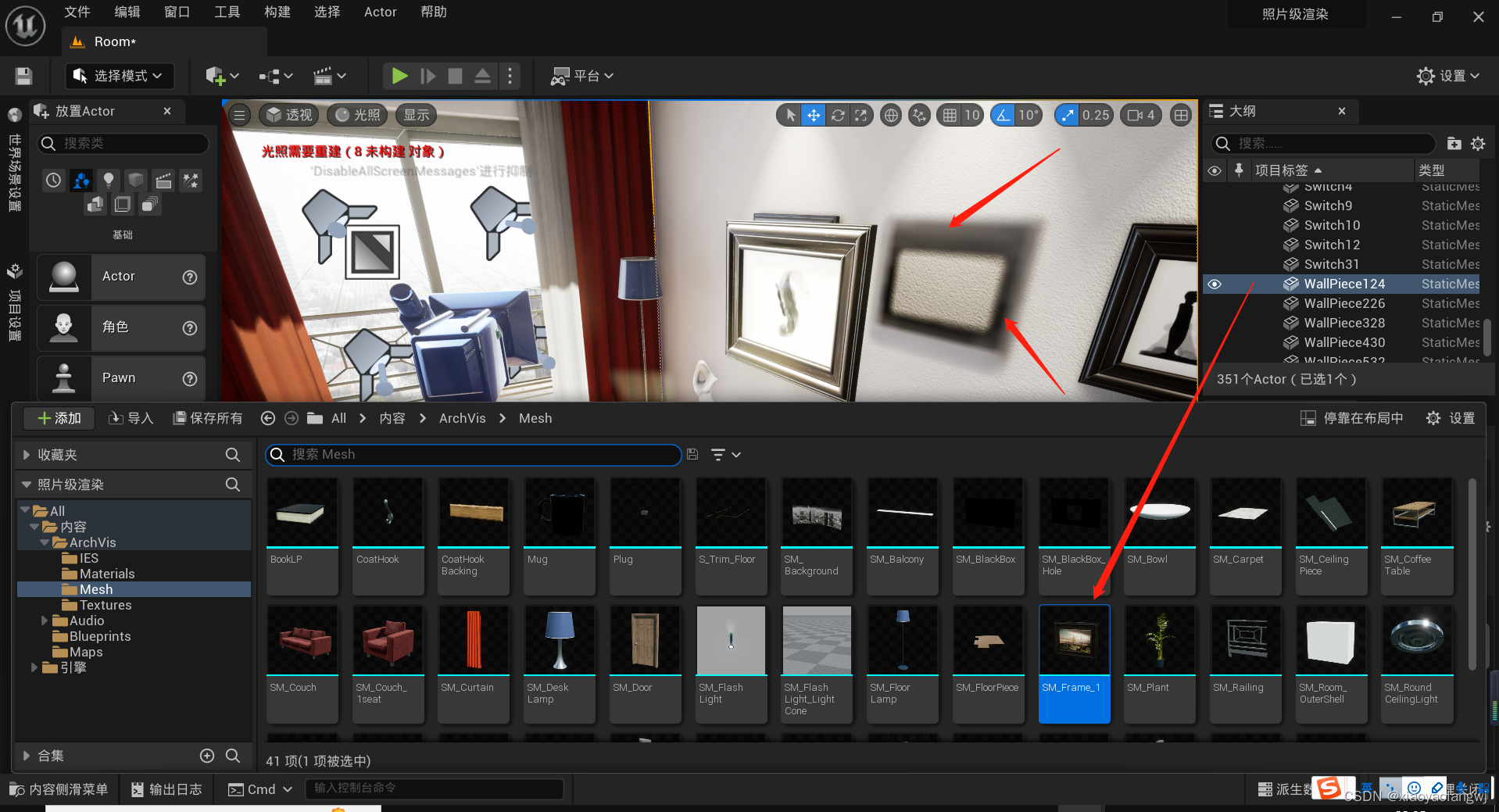

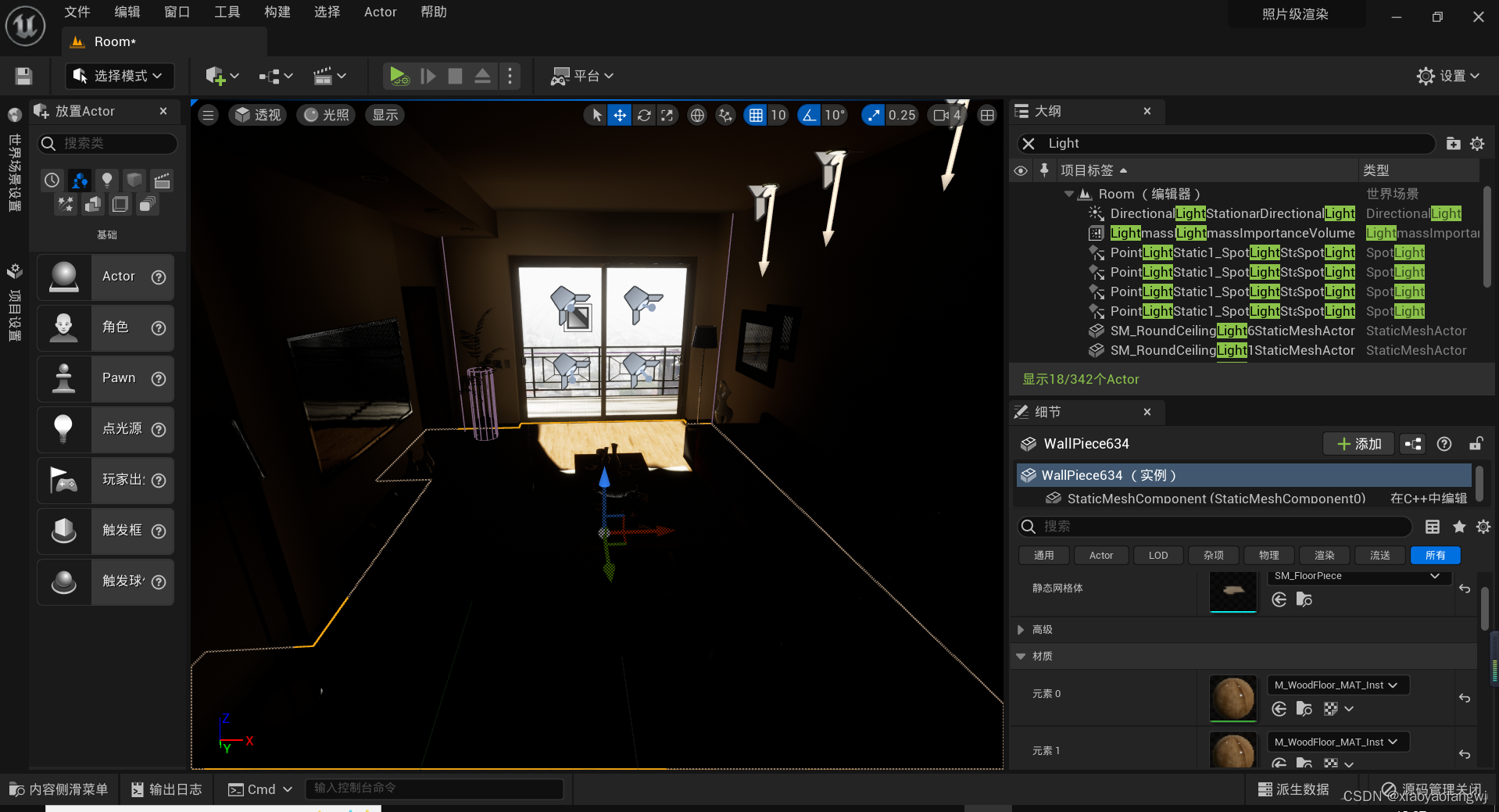

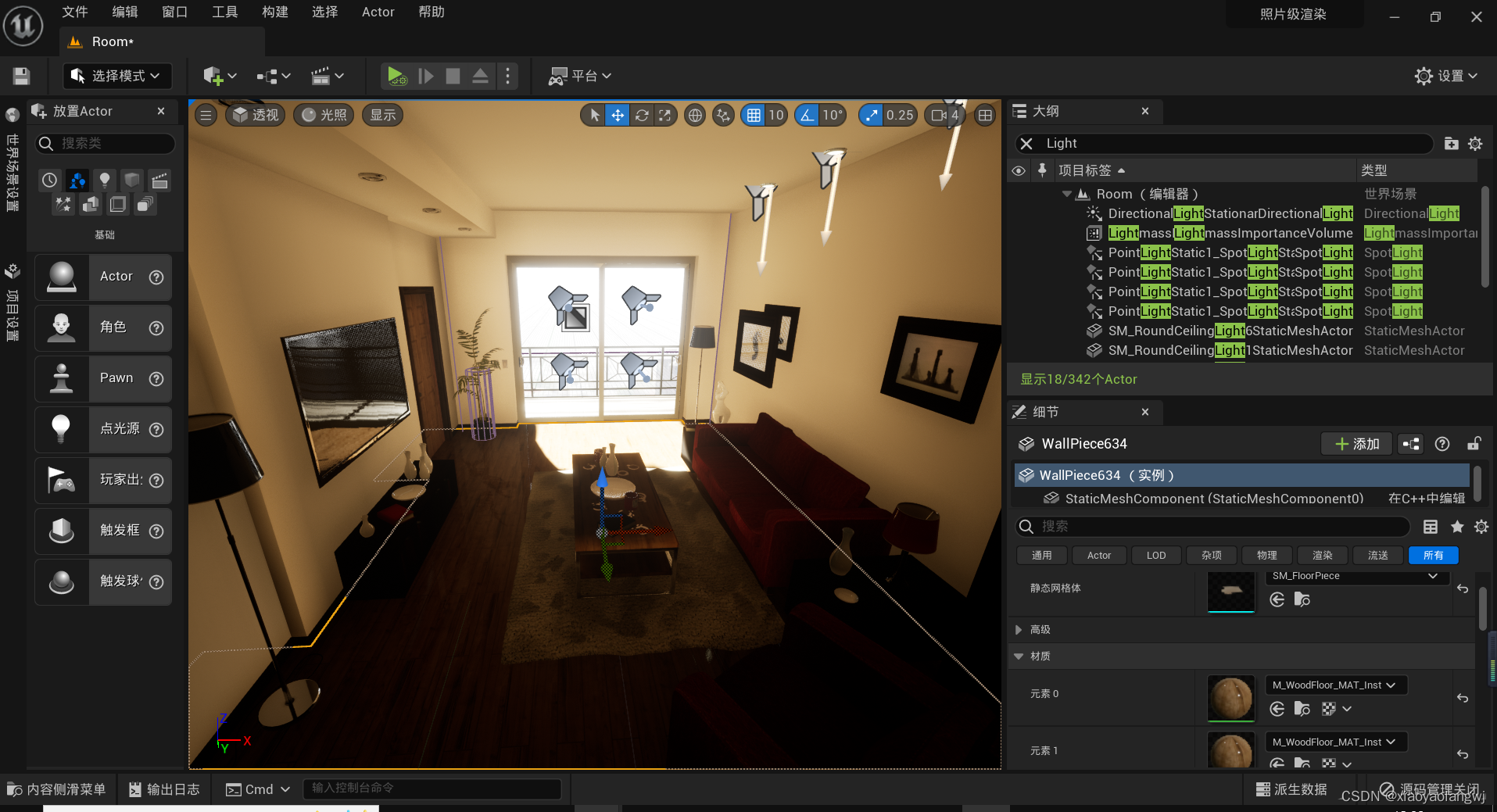

将墙上的一个相框从墙上移动出来。然后可以看到墙上留有就像是火烧过的痕迹。这就是光照中提到的Baked。是因为光照中我们选择了静态光照产生的。

右键这个对象,然后浏览至资产。

然后在资产中双击打开。

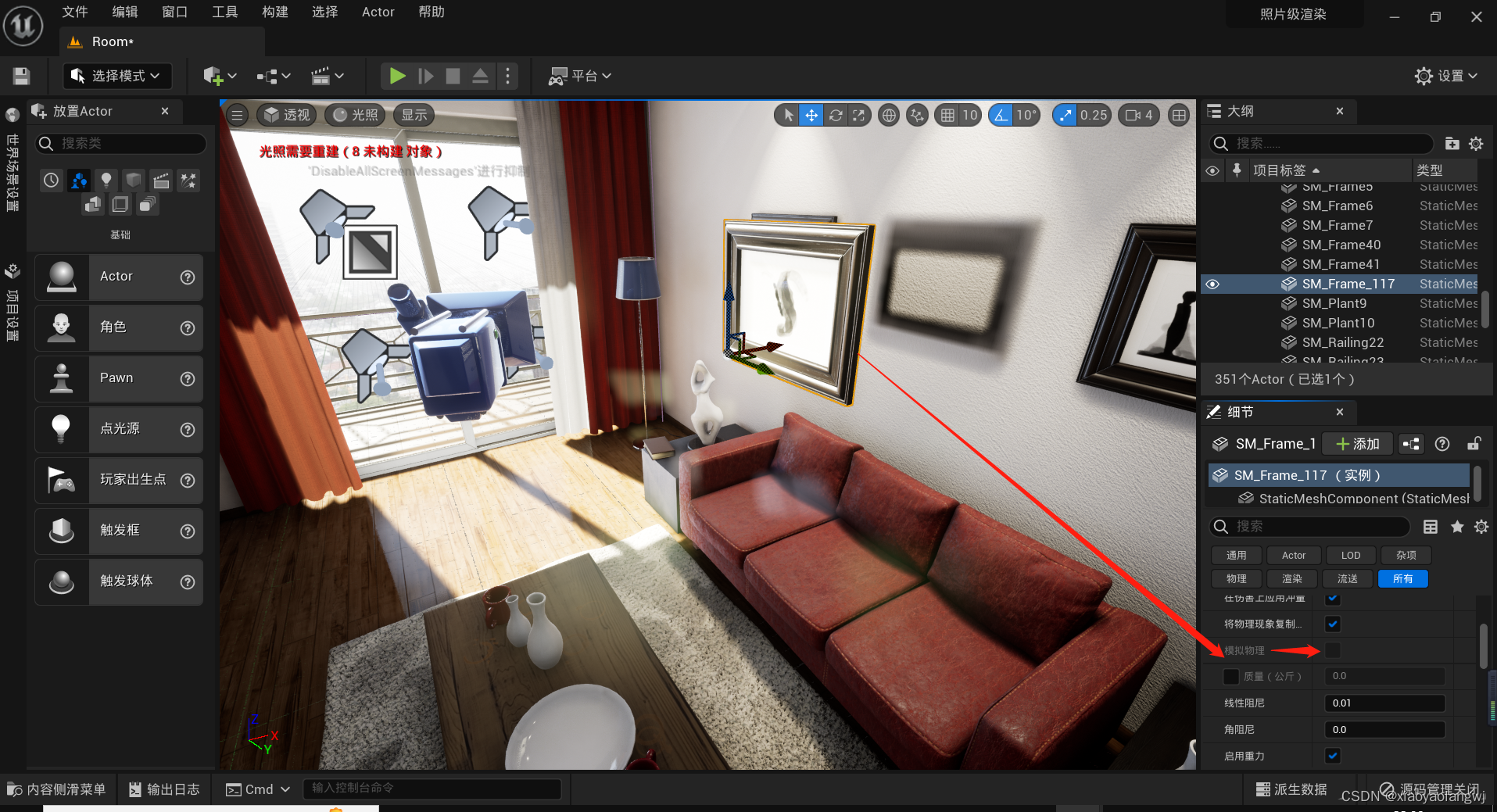

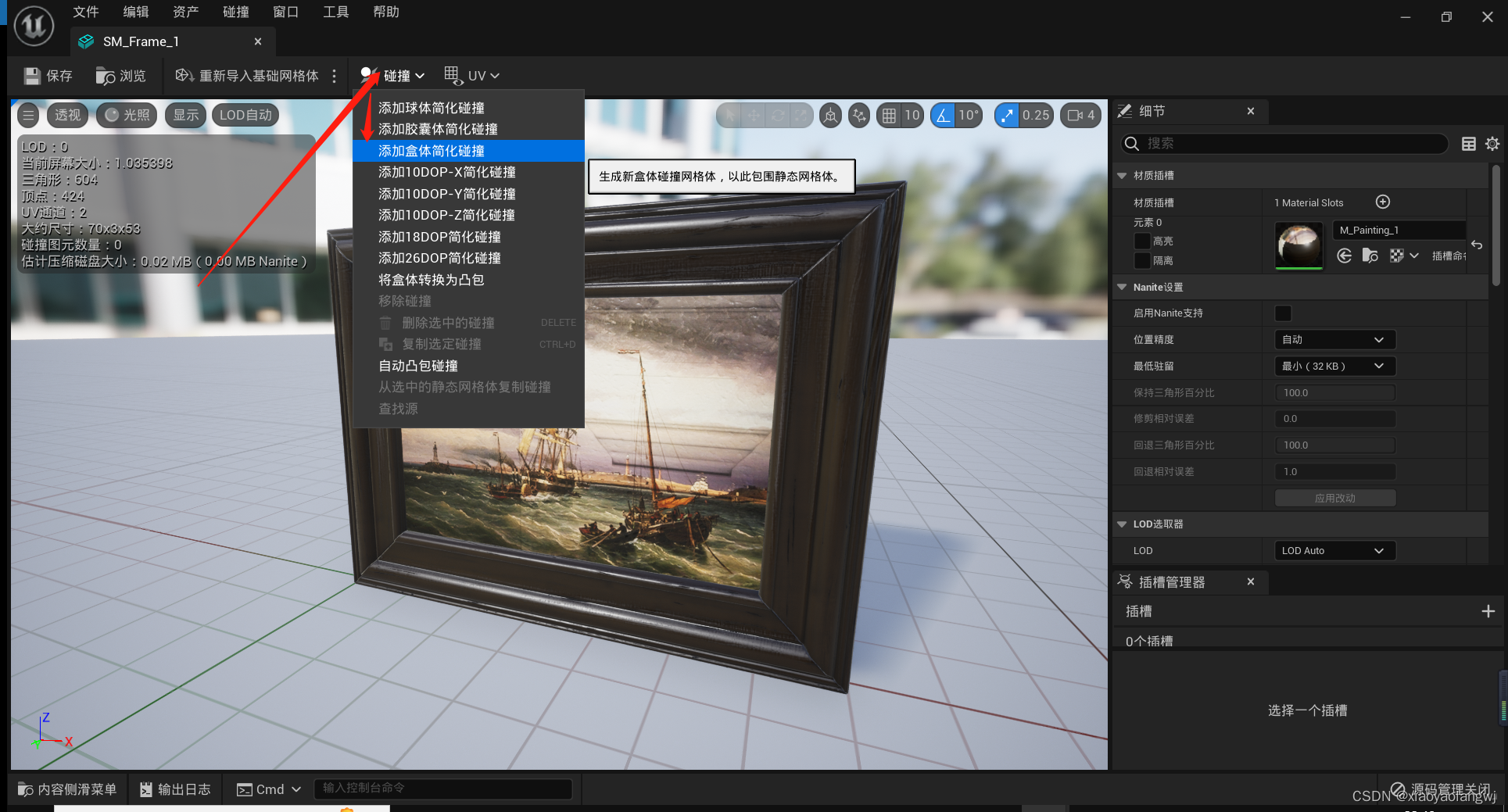

我们要模拟这个物体物理降落的过程。需要启动模拟物理。原来这个模拟物理这个项是不能勾选的。

我们在材质中设置启动这项。

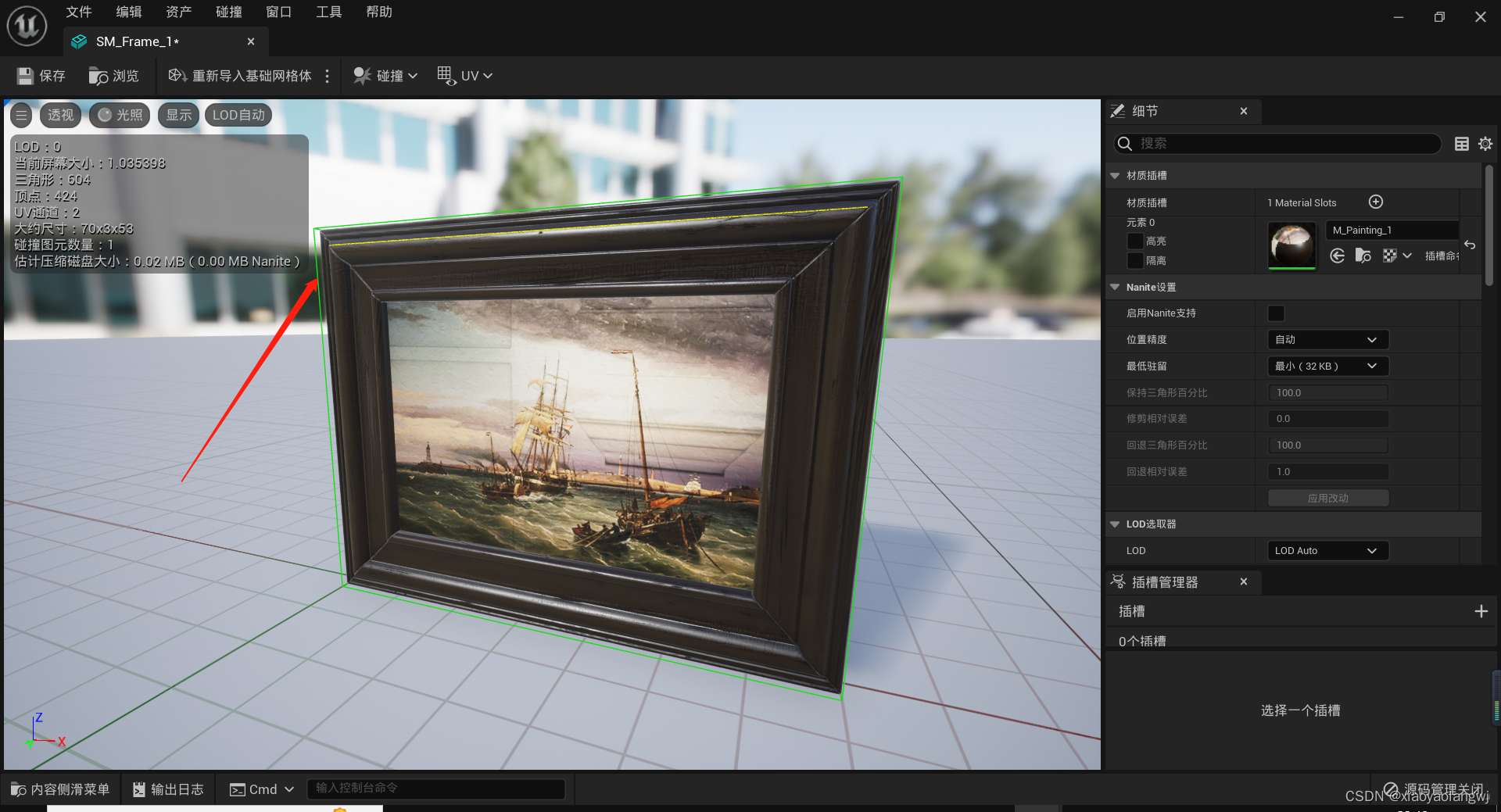

此时物体外面就有了这个方框。就可以变成一个简化版本的物理实体了。

点击保存,然后到关卡中。

此时这个模拟物理可以勾选了。

点击开始模拟游戏按钮。

物体掉落,此时注意观察物体掉落的影子。

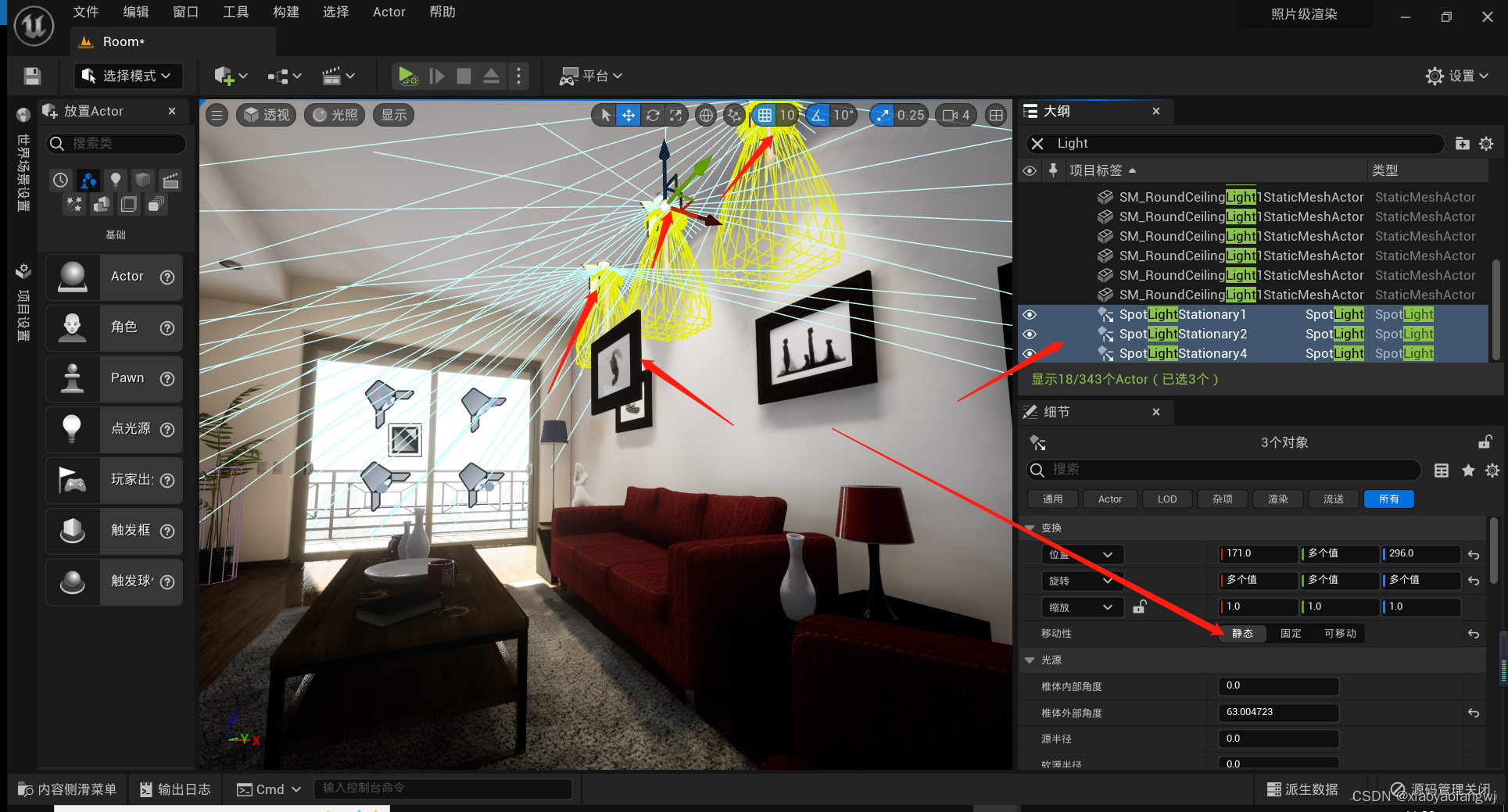

我们调整光源的移动性,观察物体掉落时阴影的变化。

相框的影子主要受上面三个SpotLight光源的影响,我们将三个光源设置为静态,然后

重新构建。

观察,物体掉落时,并没有影子。

然后分别修改为固定和可移动,然后构建,再观察。

三种移动性,静态效果占用系统资源最少,然后固定次之,可移动最消耗系统资源。

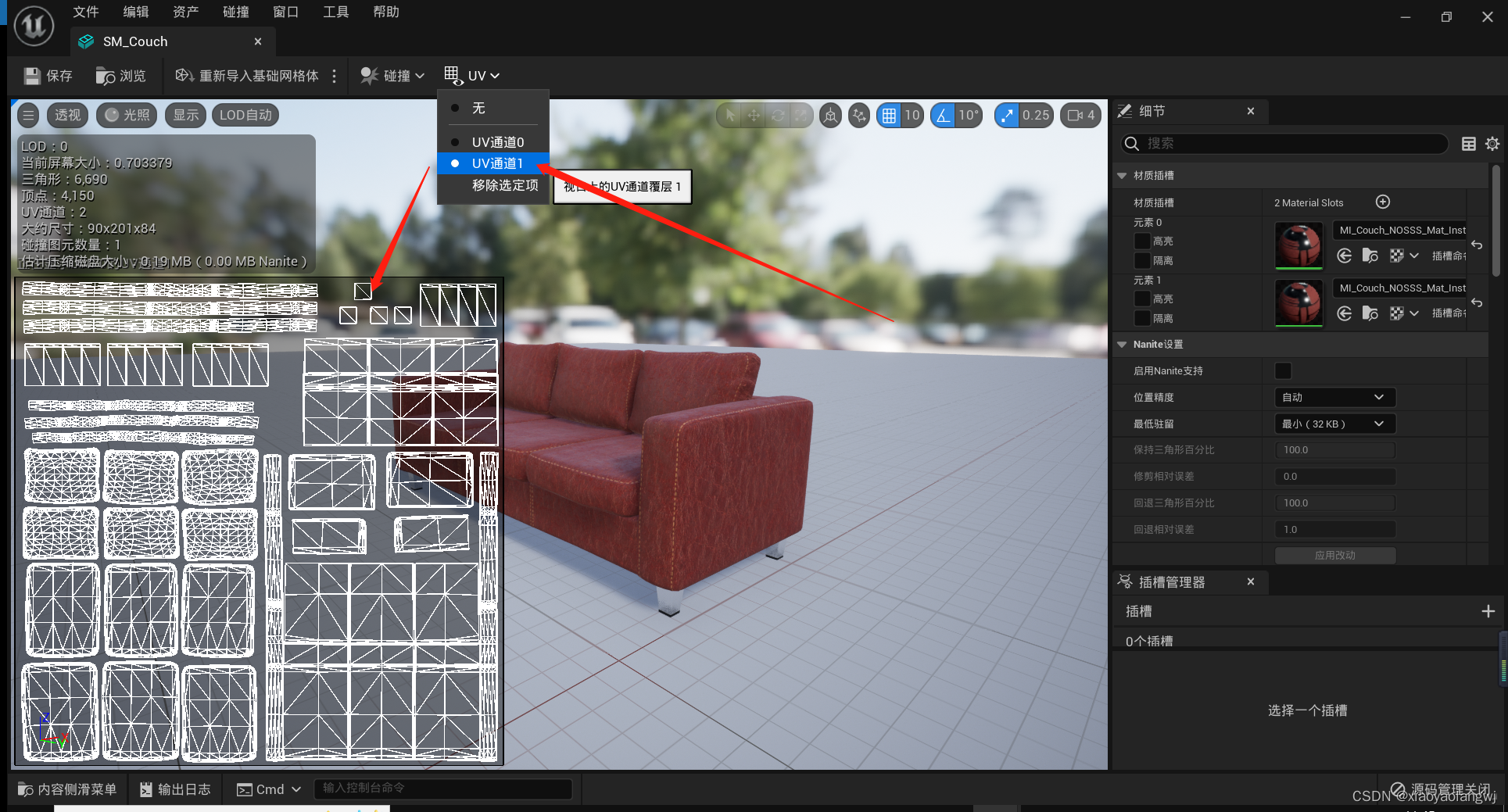

LightMaps,光照贴图。

关于沙发的照明数据在哪里呢?

在资源抽屉中,将其双击打开,其光照信息在UV的两个通道中。

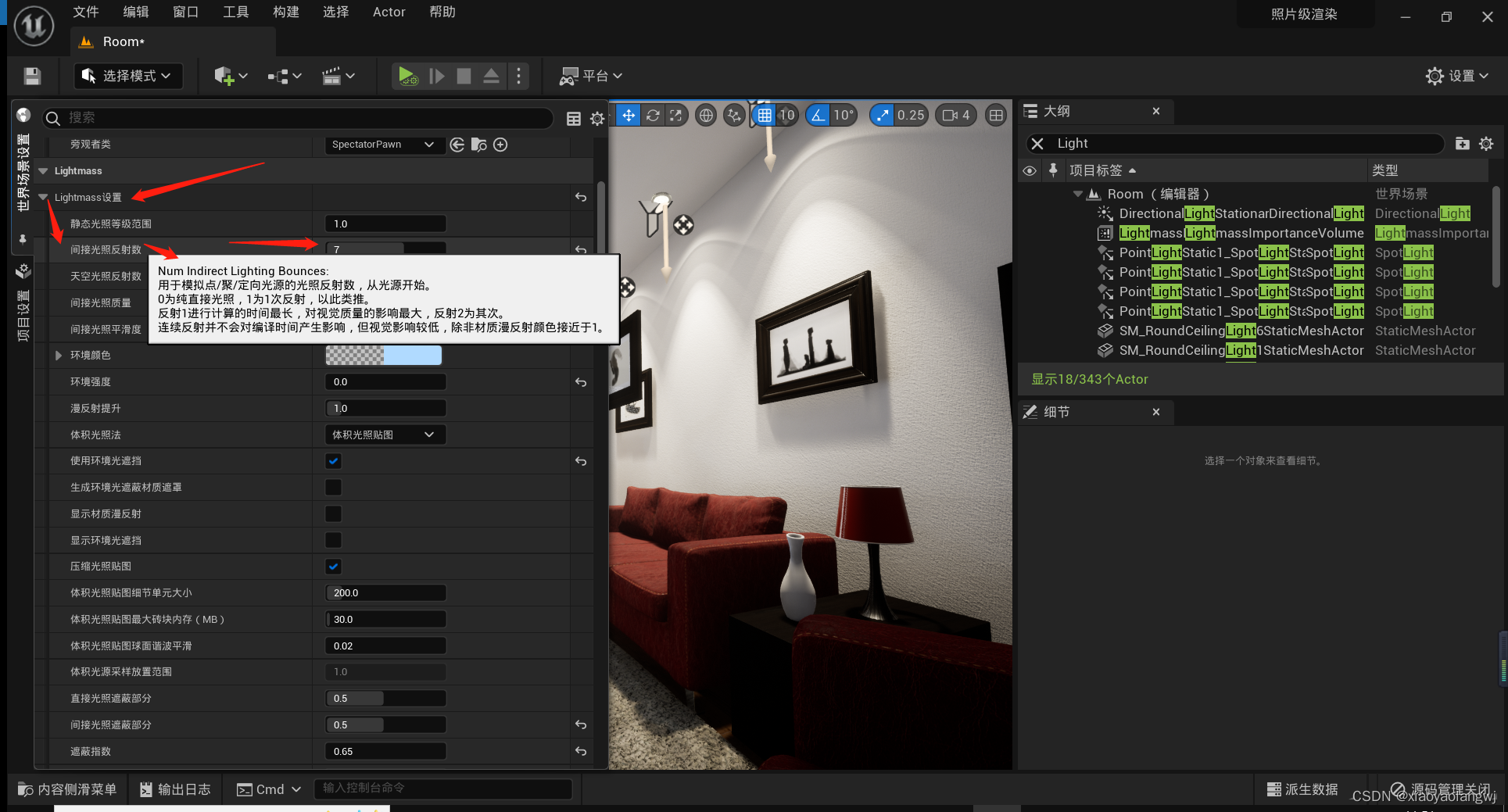

光线设置:

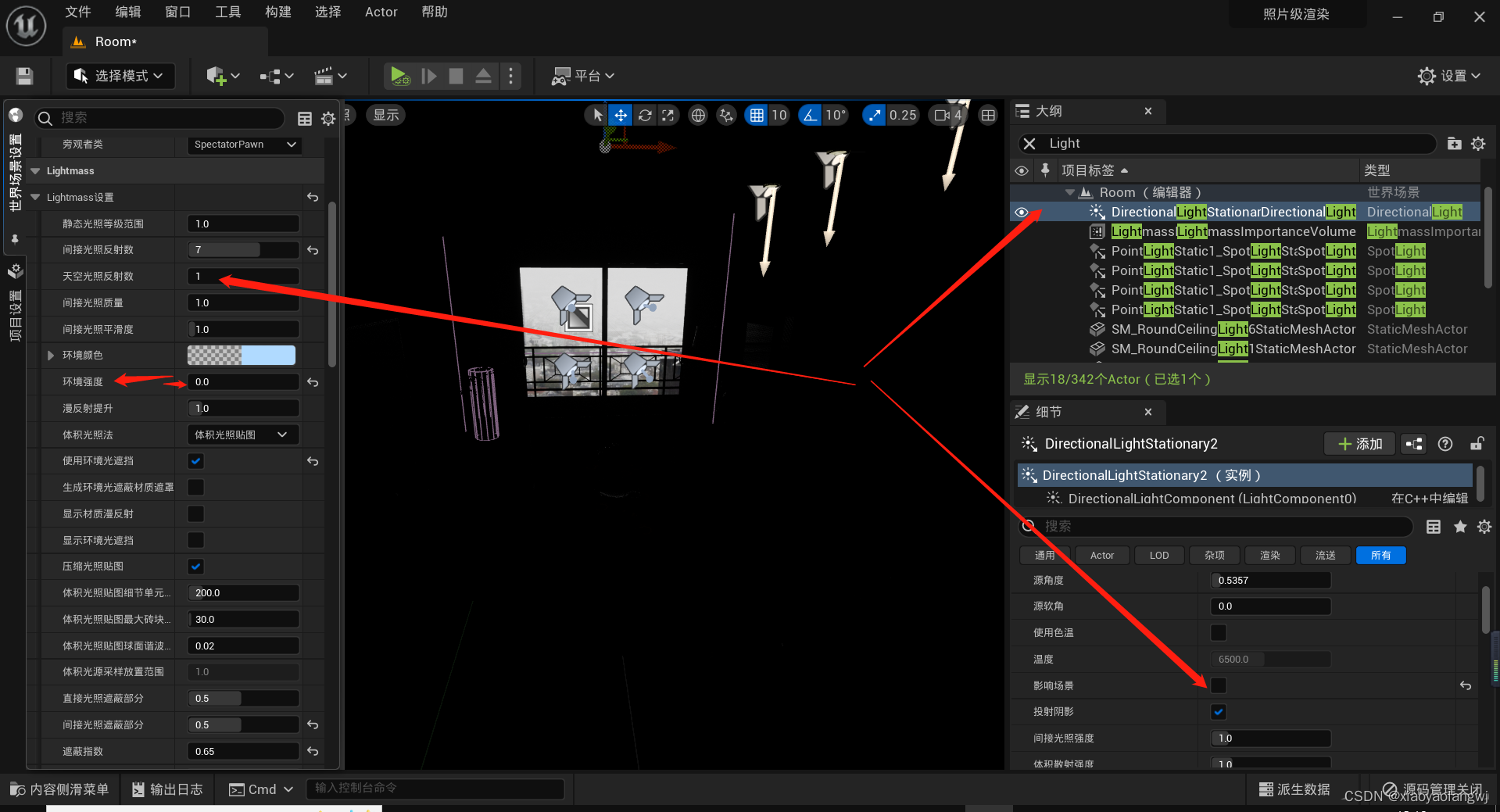

间接光照反射数

光线通过多少次反射进入到不能直达的地方,导致其对应角落亮度不同。

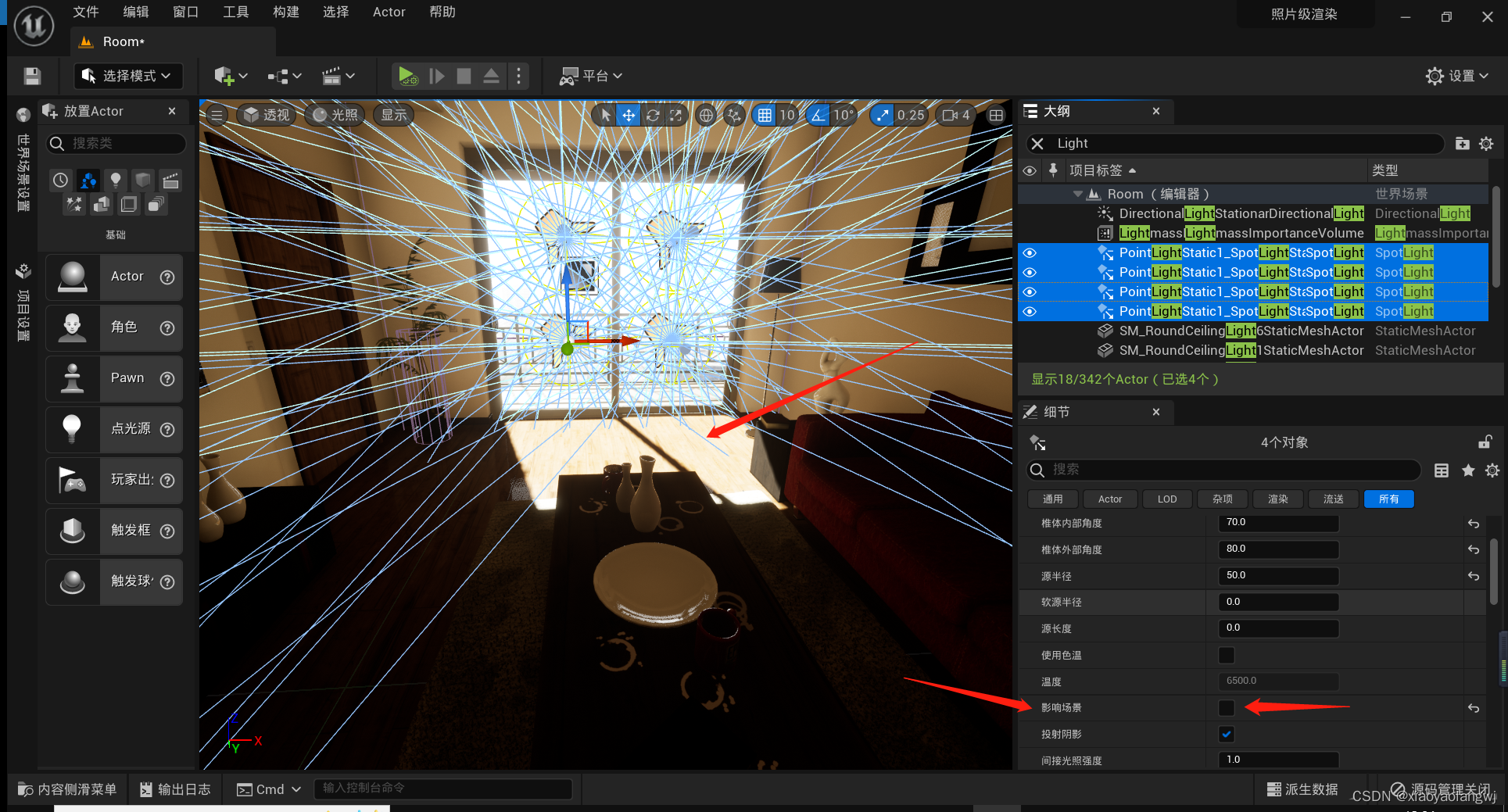

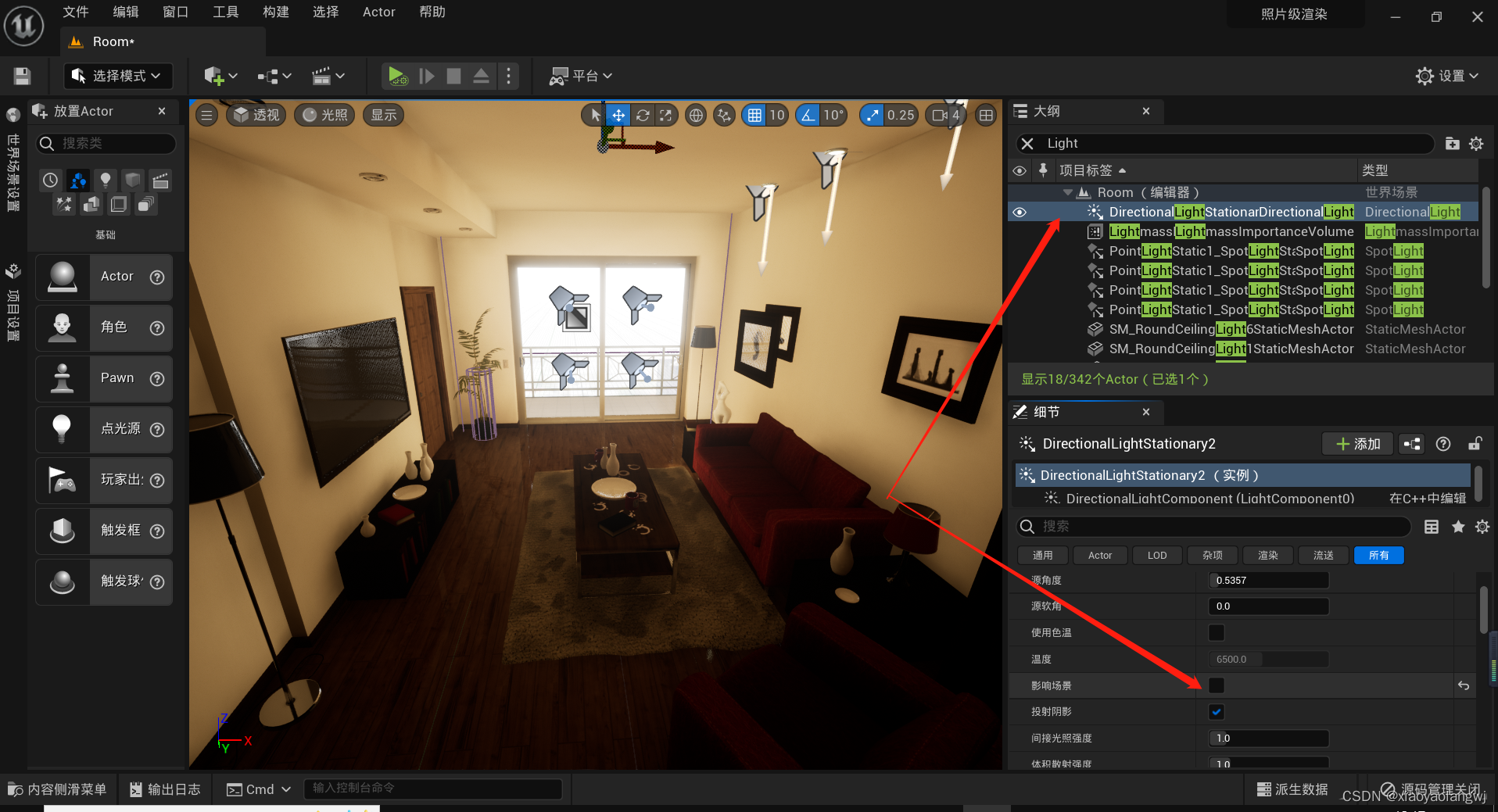

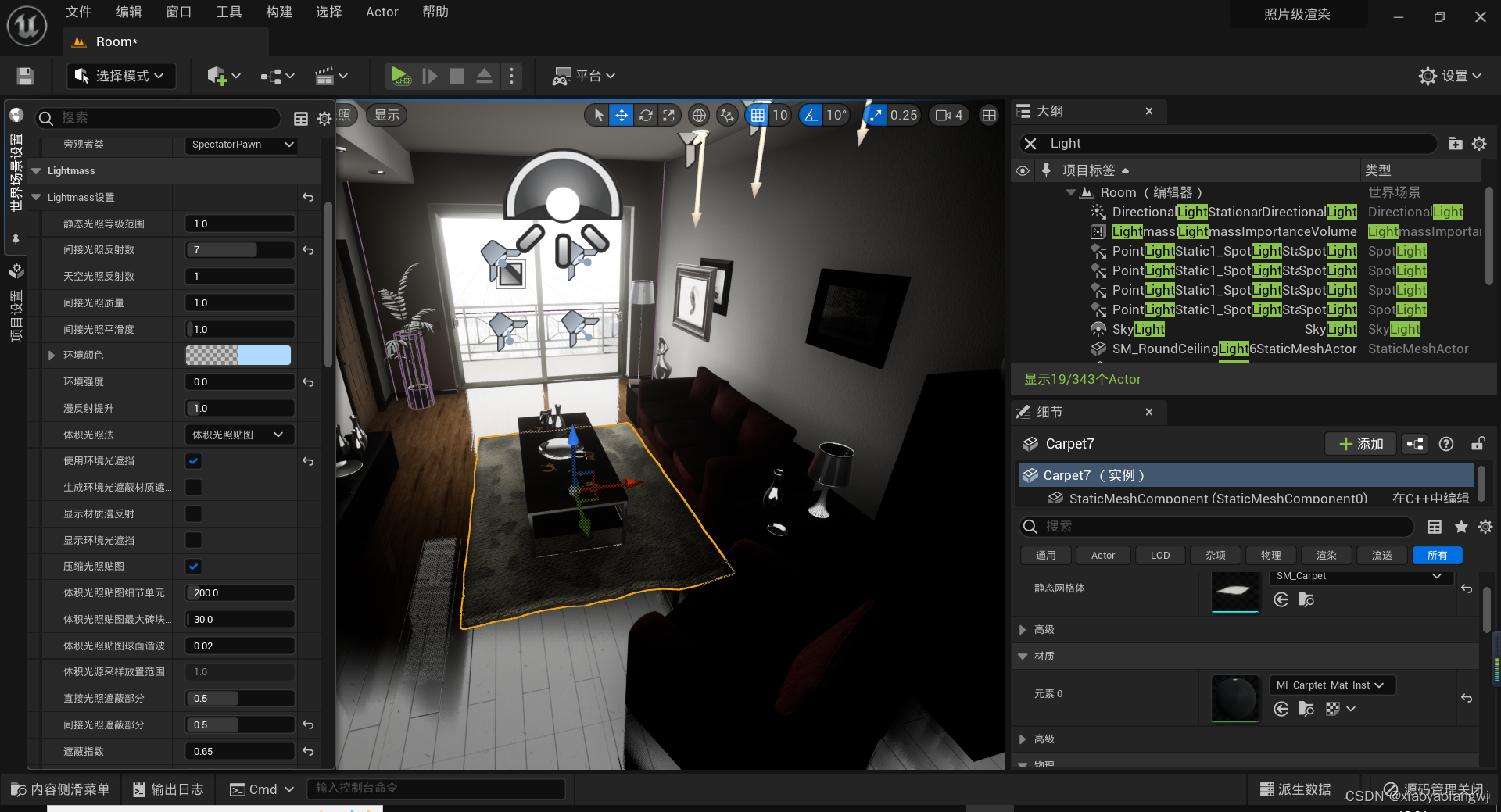

我们把除了太阳光,以外的灯源先暂时关闭。

只剩下一个太阳光,我们调节反射次数,看看对场景的影响。

只剩下一个太阳光,我们调节反射次数,看看对场景的影响。

当间接反射次数为1时:

当间接反射次数为5时:

当间接反射次数为5时:

当间接反射次数为10时。

当然反射次数越多,场景内光照越亮,相对的此时的消耗的系统资源更多。

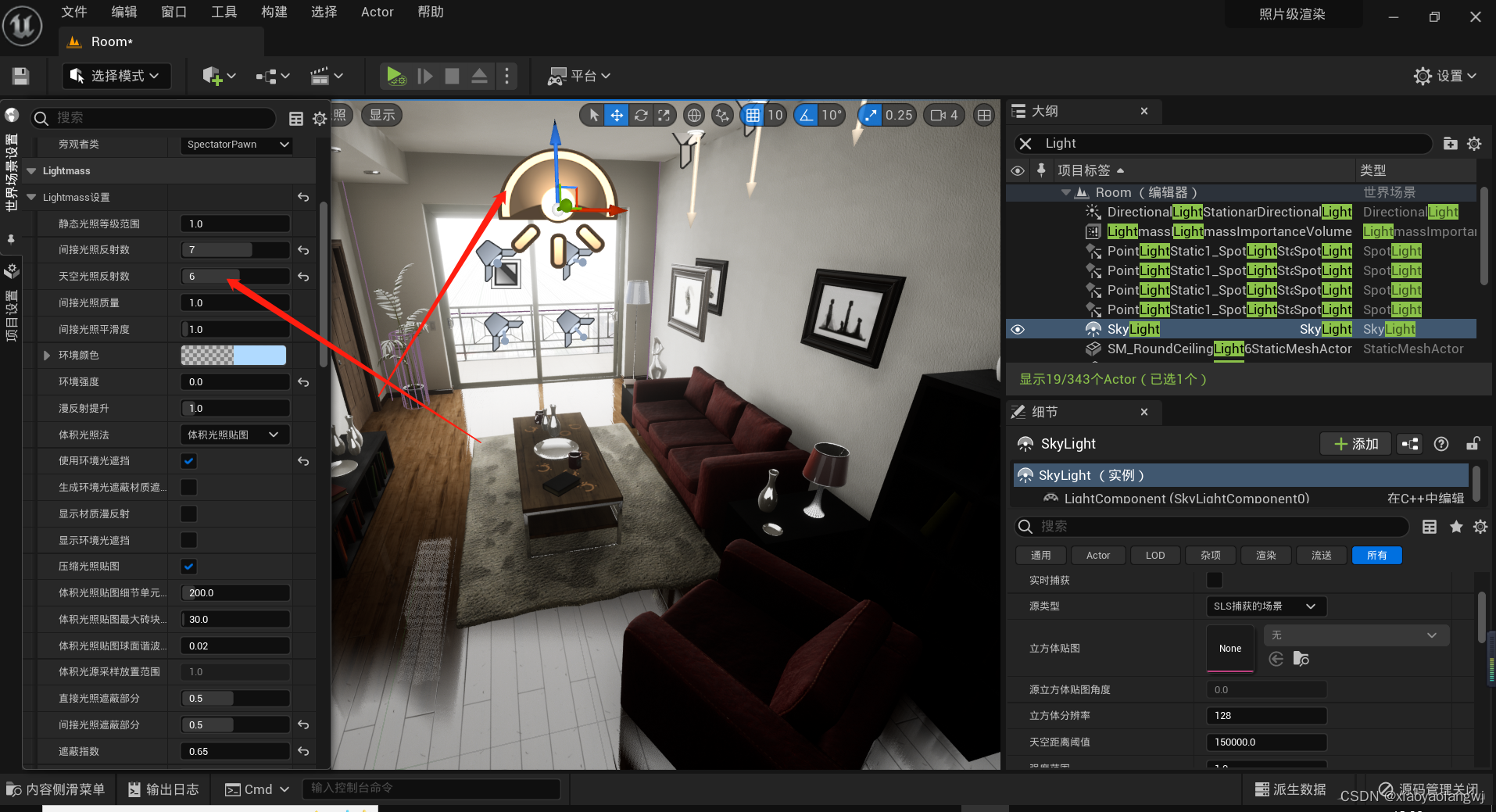

num Sky Lighting Bounces天空光照反射数

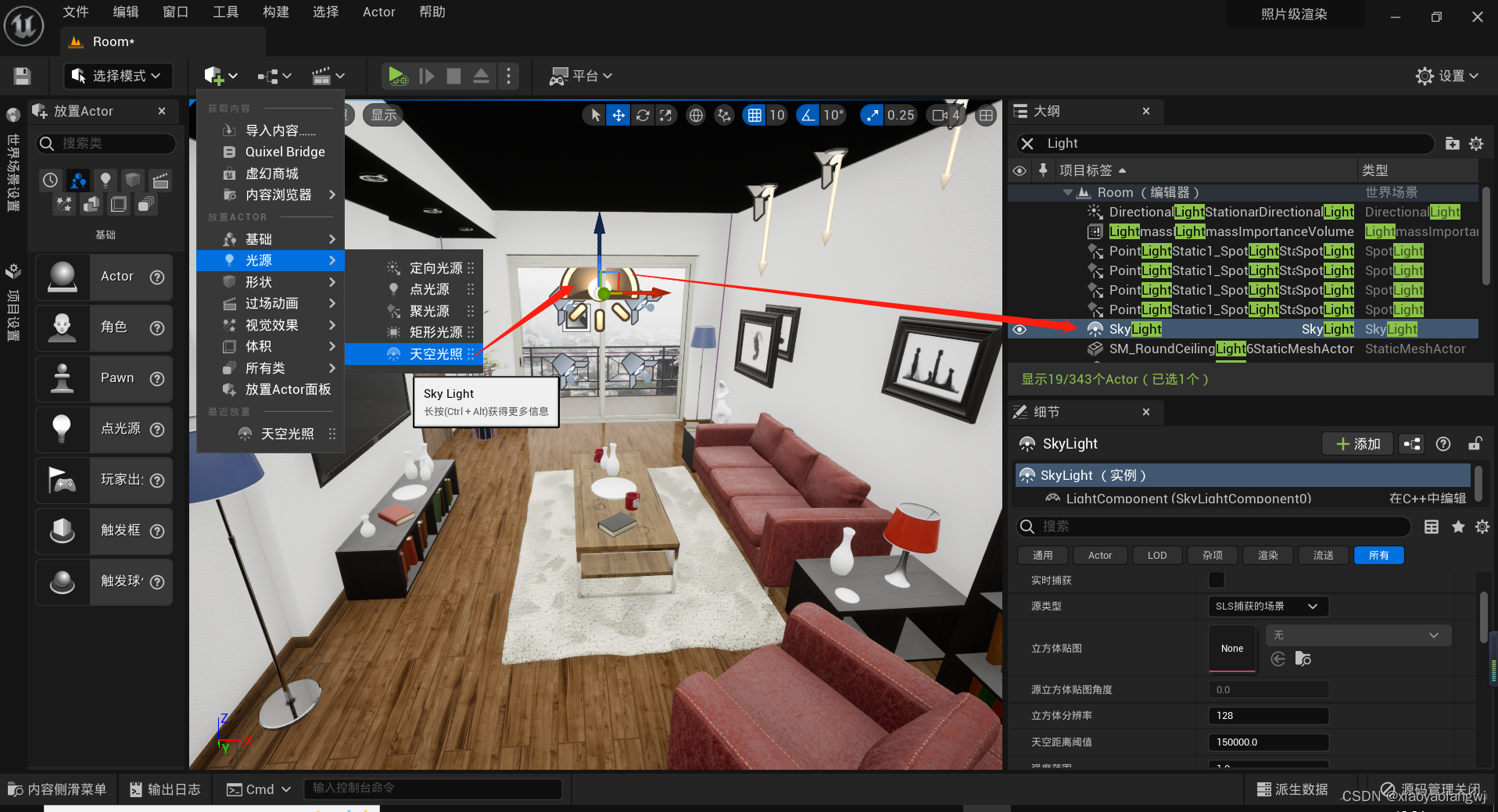

我们把最后一个光源太阳光也关闭了,现在查看SkyLighting影响效果。

我们把最后一个光源太阳光也关闭了,现在查看SkyLighting影响效果。

场景中新建一个SkyLight

当NumSkyLightingBrounce =1时:

每一次修改光线的参数都需要重新构建一次光线。

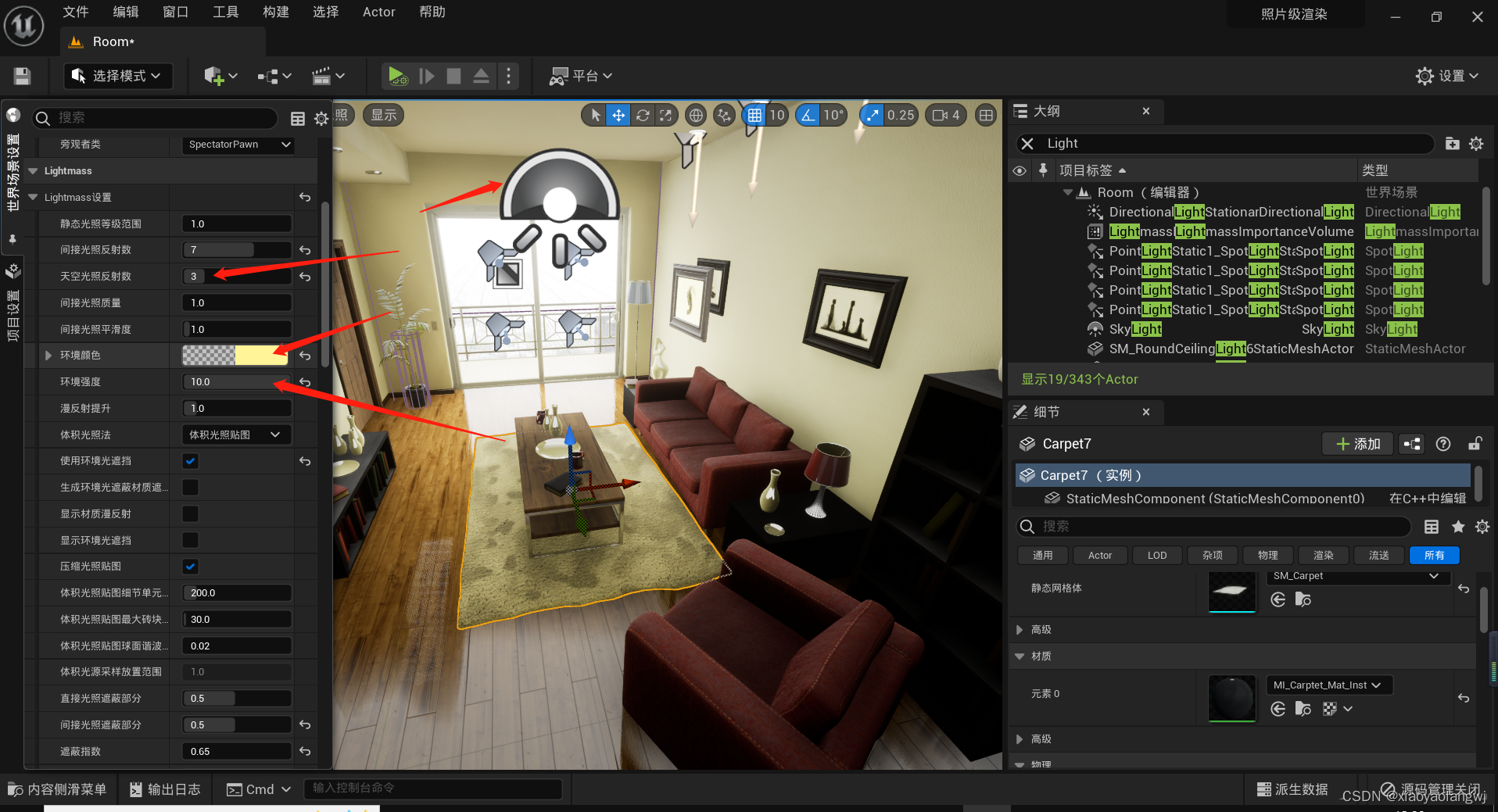

当NumSkyLightingBrounce = 6时:

仅仅只用一个天窗反射光SkyLighting时,我们调整环境强度和环境颜色(有一点偏向金色时)就可以产生一个很好的光照效果。

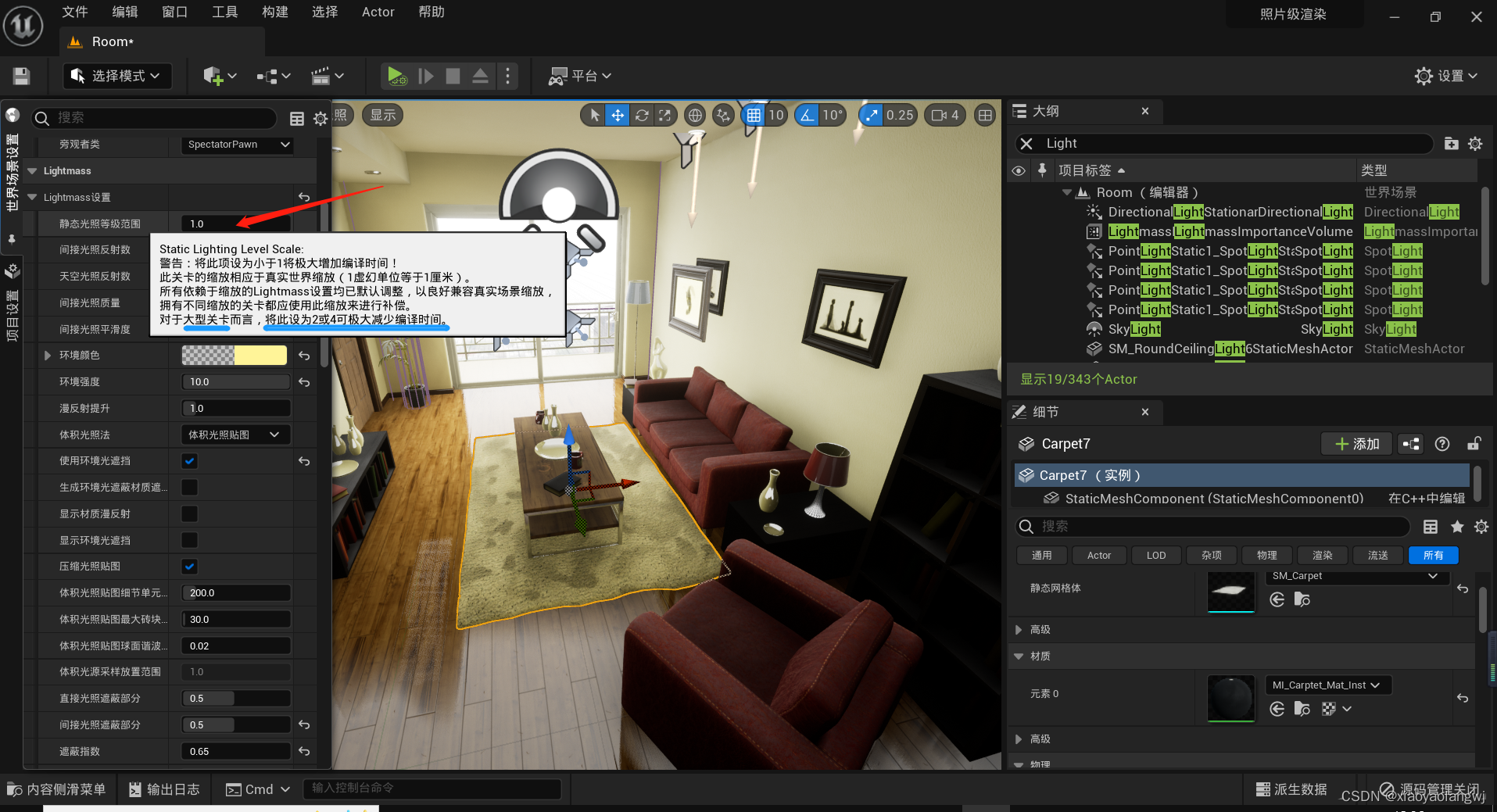

静态光照等级范围:

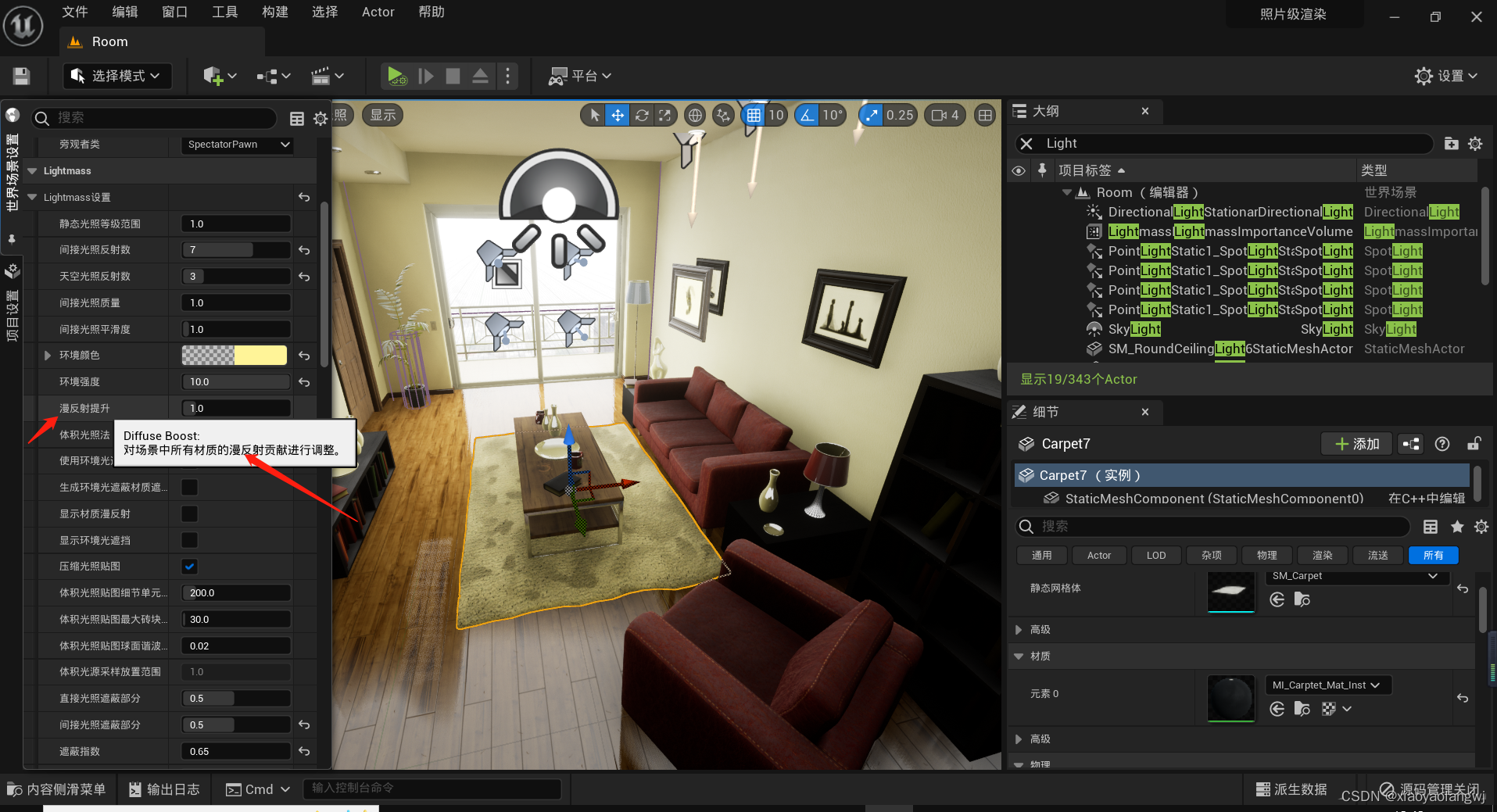

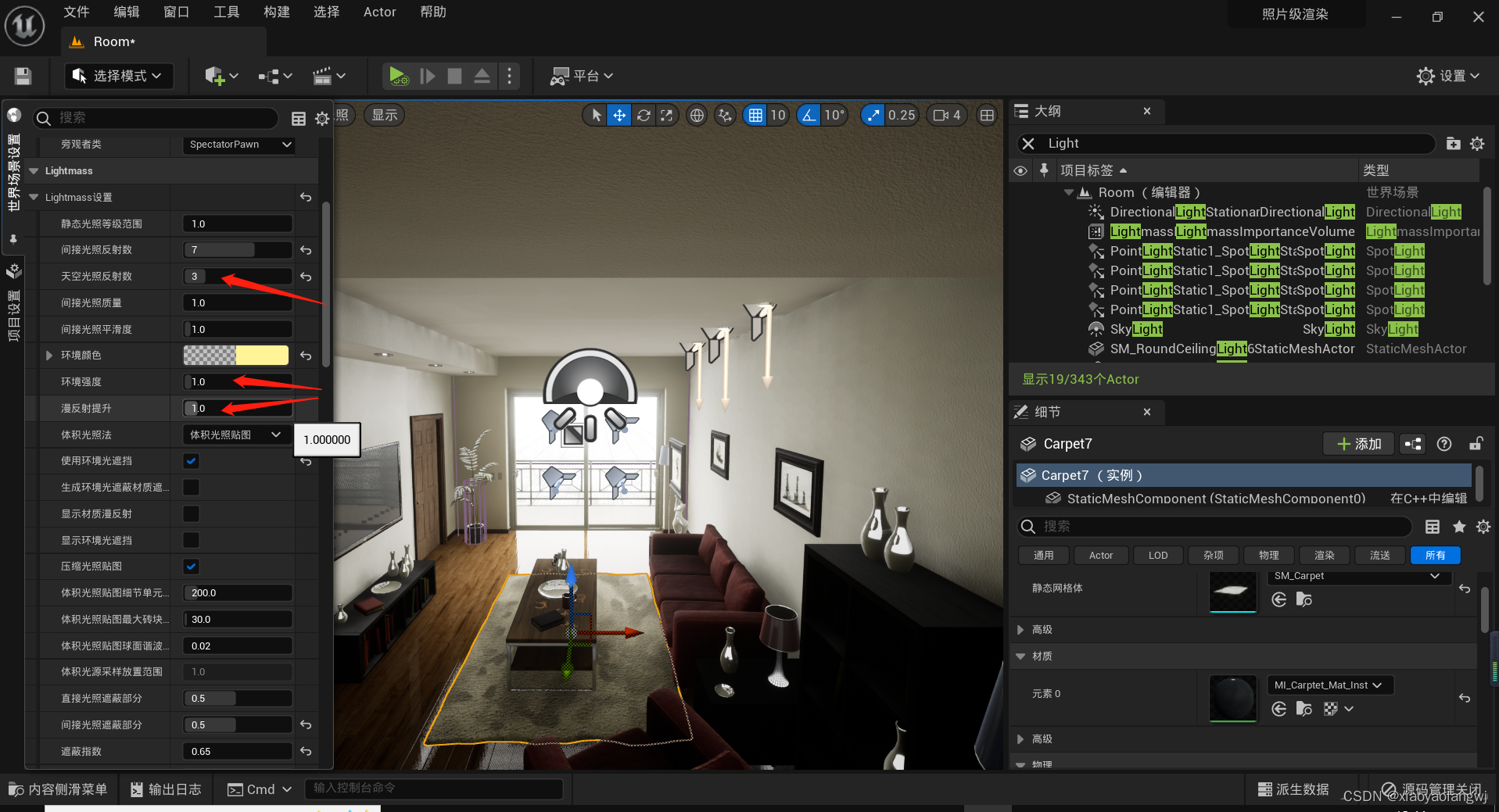

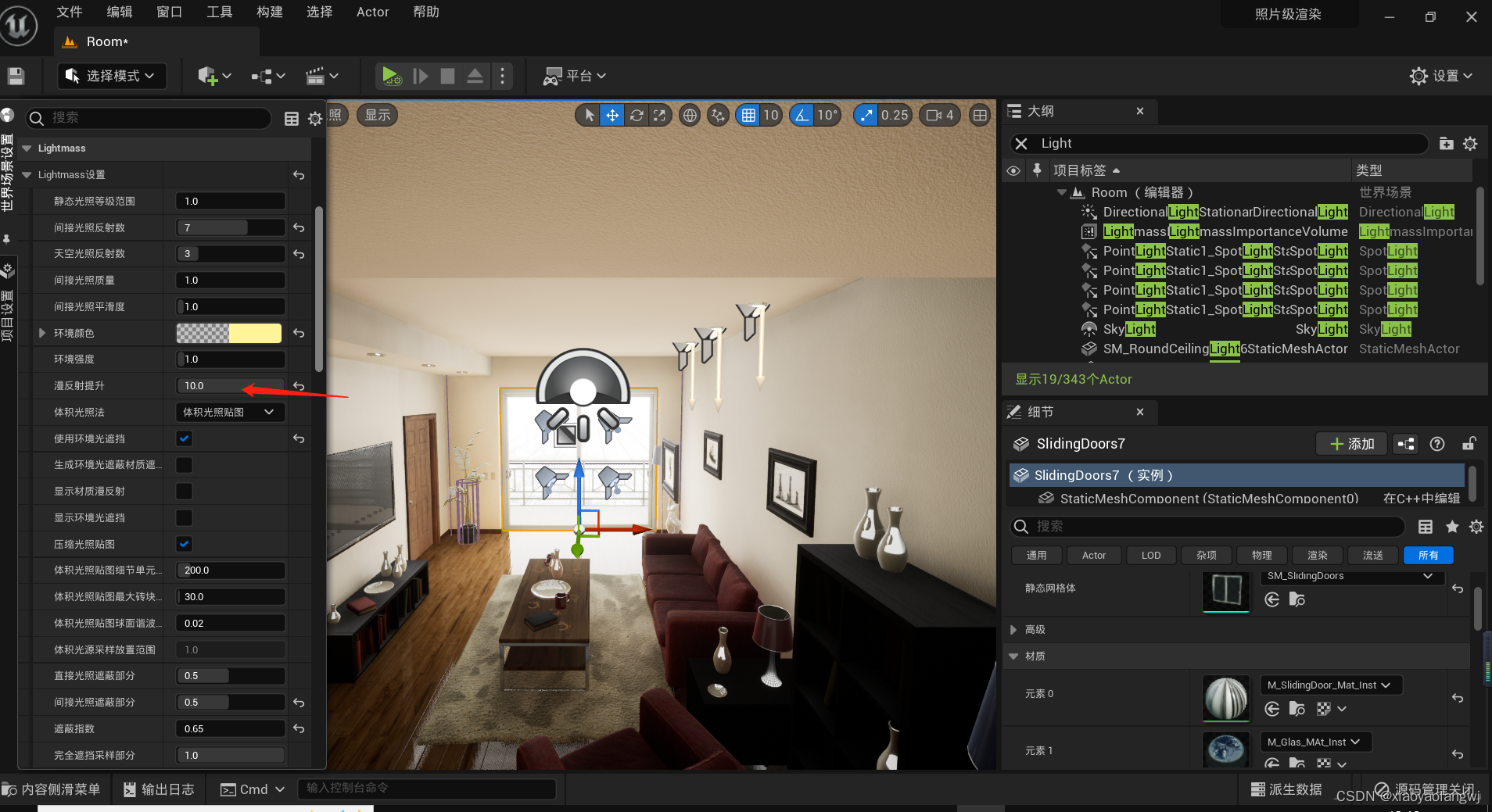

漫反射

Diffuse Boost:

当漫反射为默认值1时:

当漫反射为默认值10时:

提升了场景整体亮度。

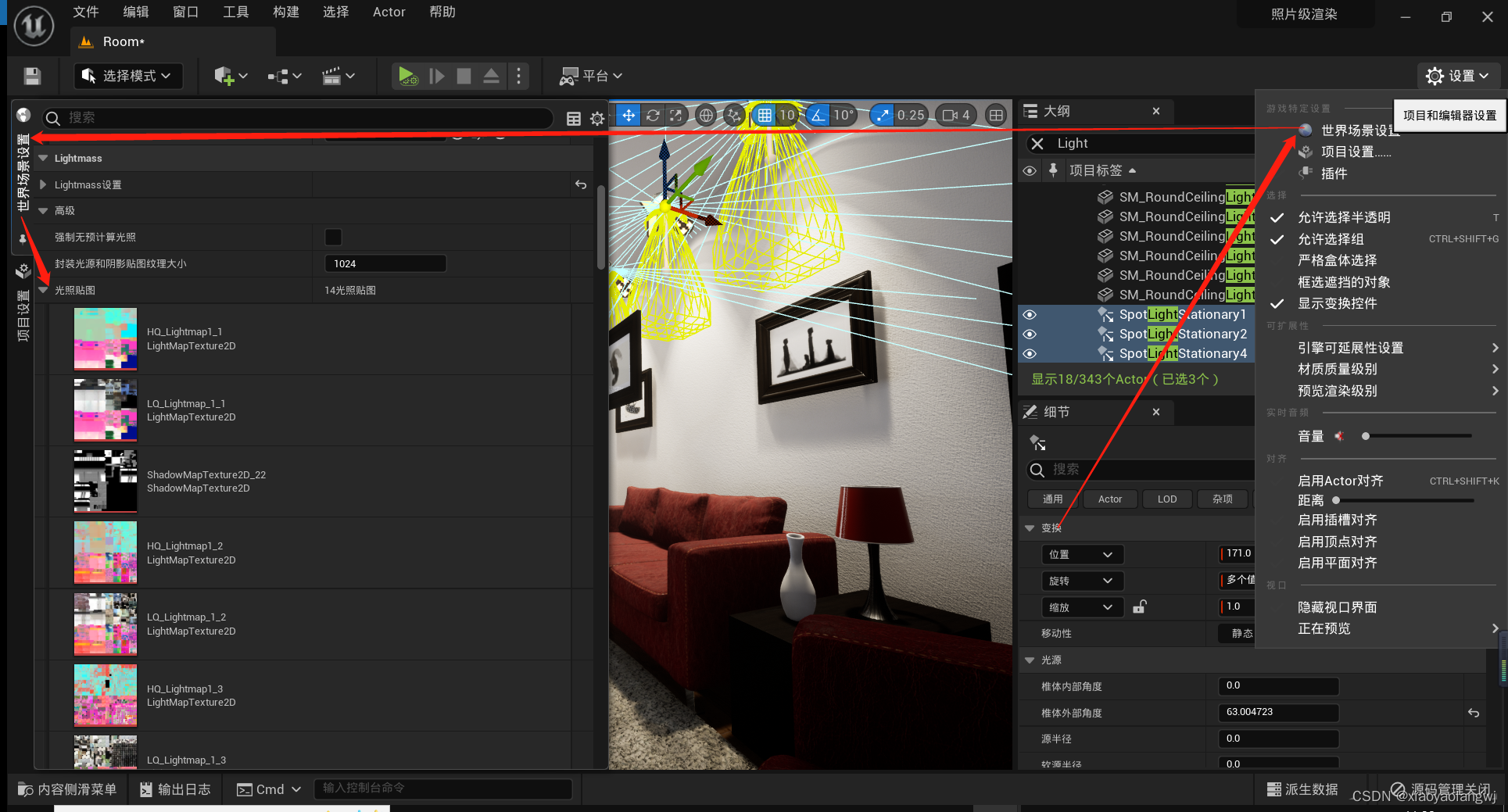

修复LightingMap问题。

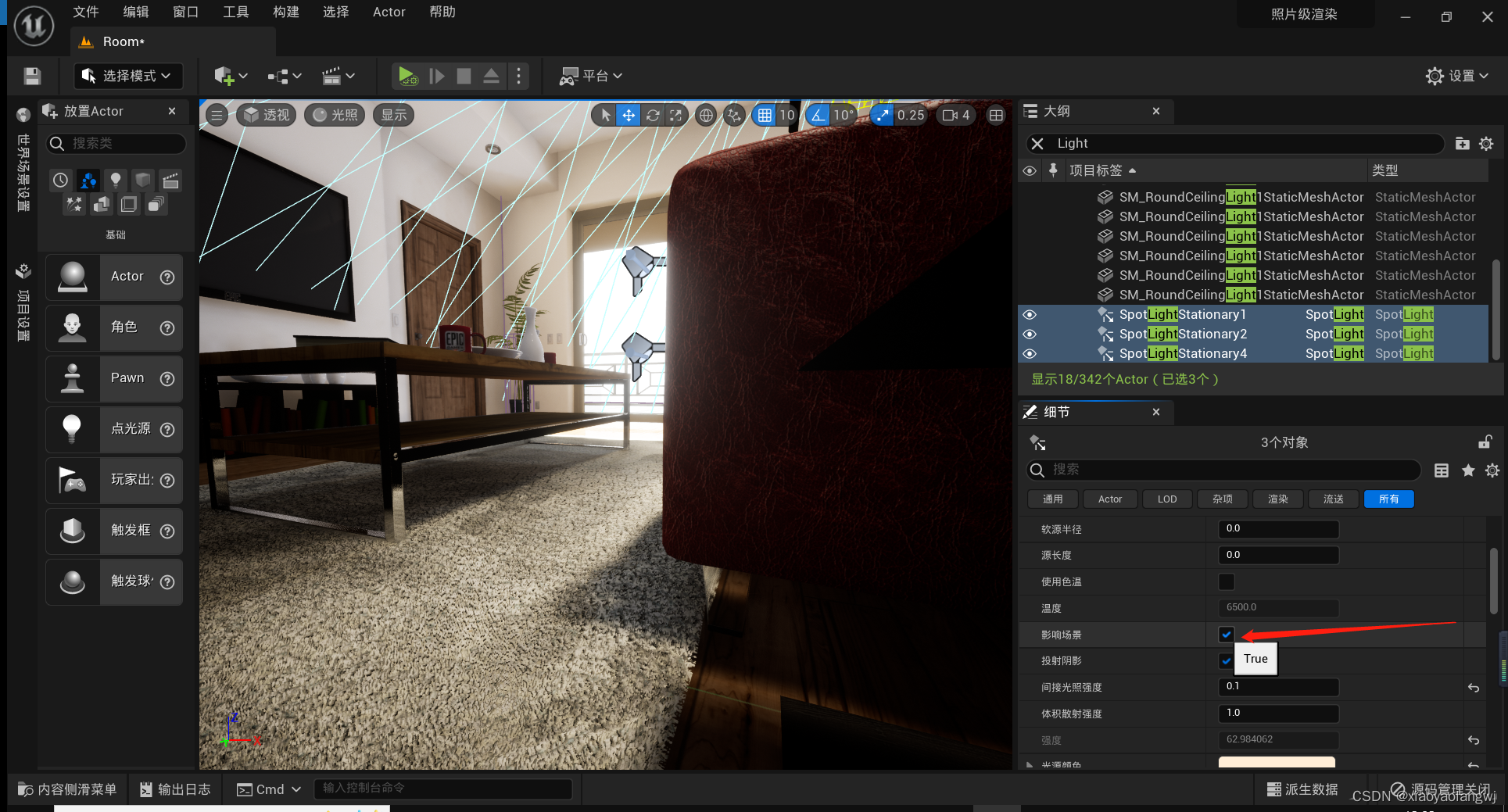

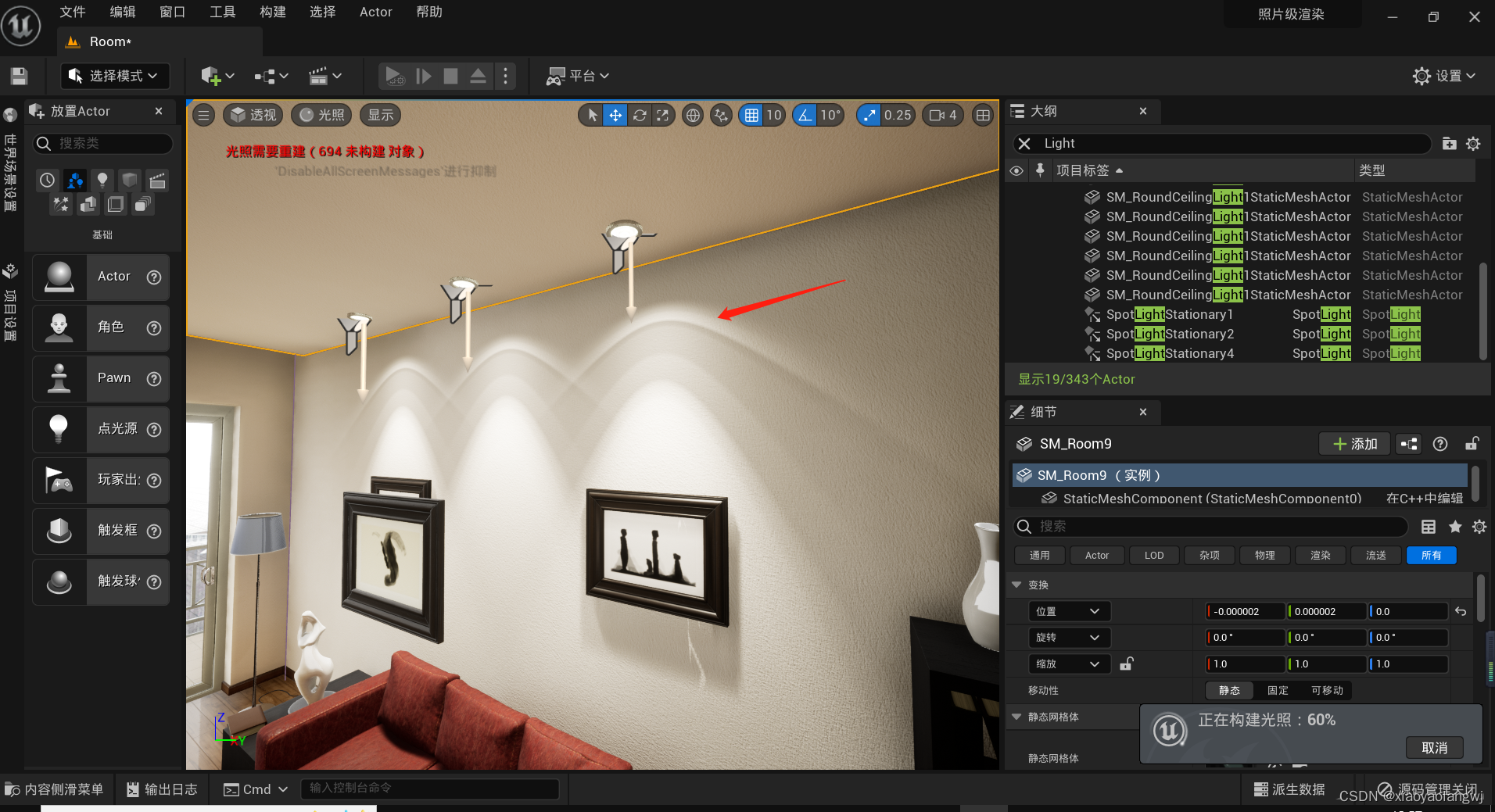

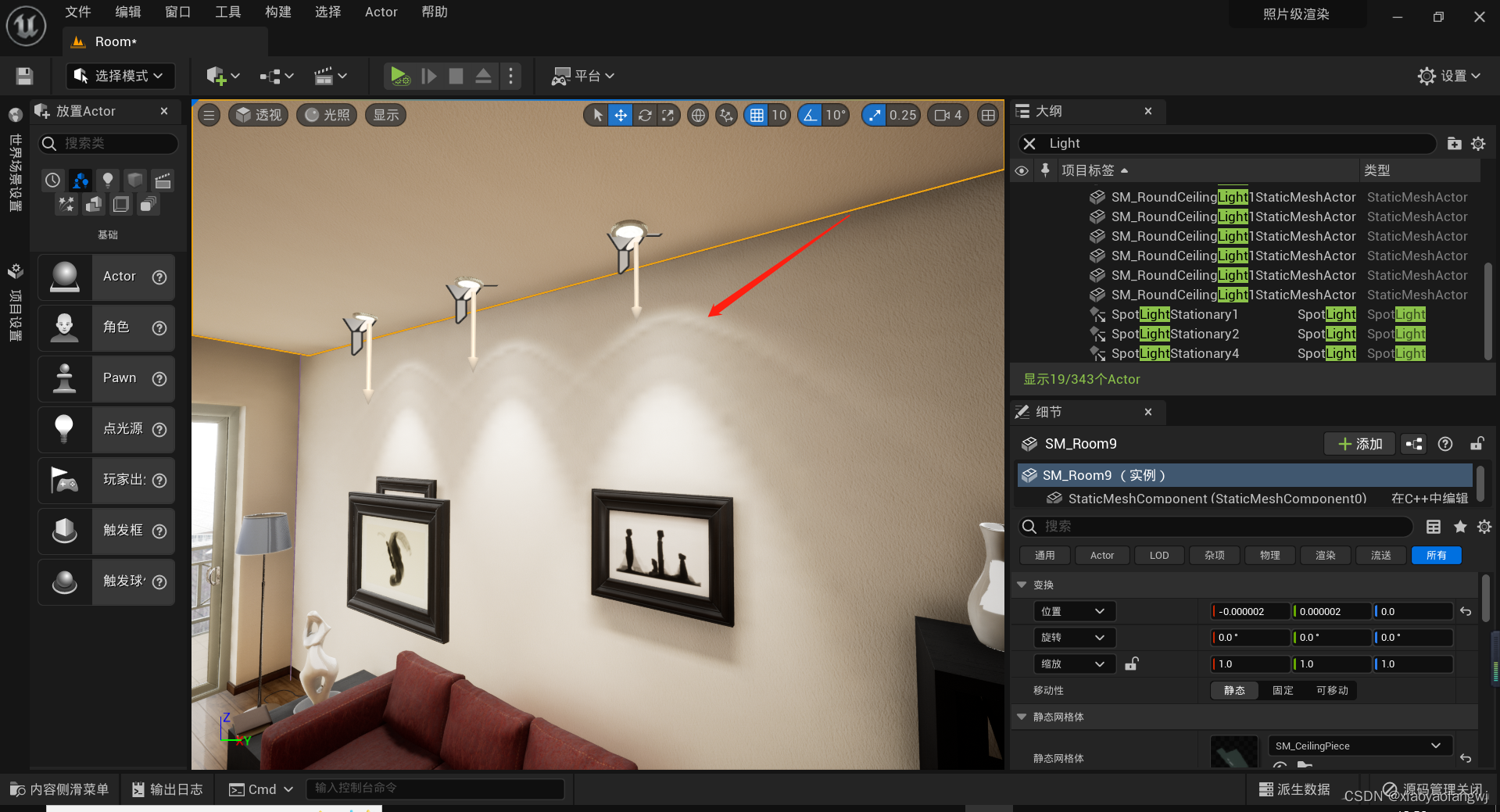

我们将上面是哪个Spotlight启动,使其影响场景,然后观察墙上的光晕效果。此时他们的移动性为固定。

当我们将其转为静态时,发现墙上的光晕看起来有点假,有点脏。

是什么原因导致的呢?

问题是在这面墙上覆盖的光贴图太小了。他需要变得更大,在技术上,在实际的网格上拓展更多的区域。

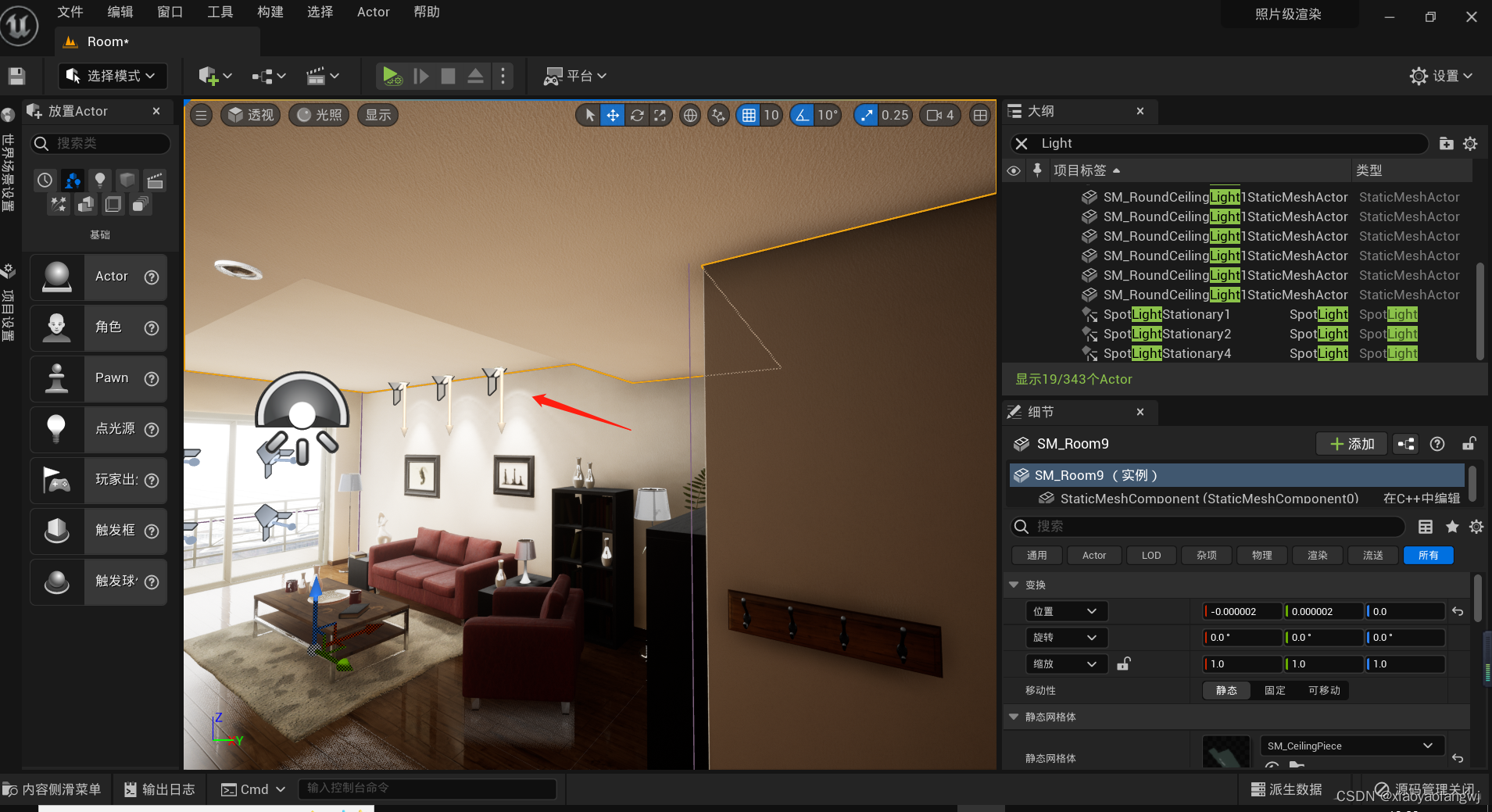

当我们离墙远一些再来观察:

离墙远了,看起来就没有那些脏点了。靠近了,场景延伸到墙上,需要更高分辨率的光照贴图。

这个就跟看图像一样,我们正常看很高清,但是当我们拉近放大细节时,全是斑点。

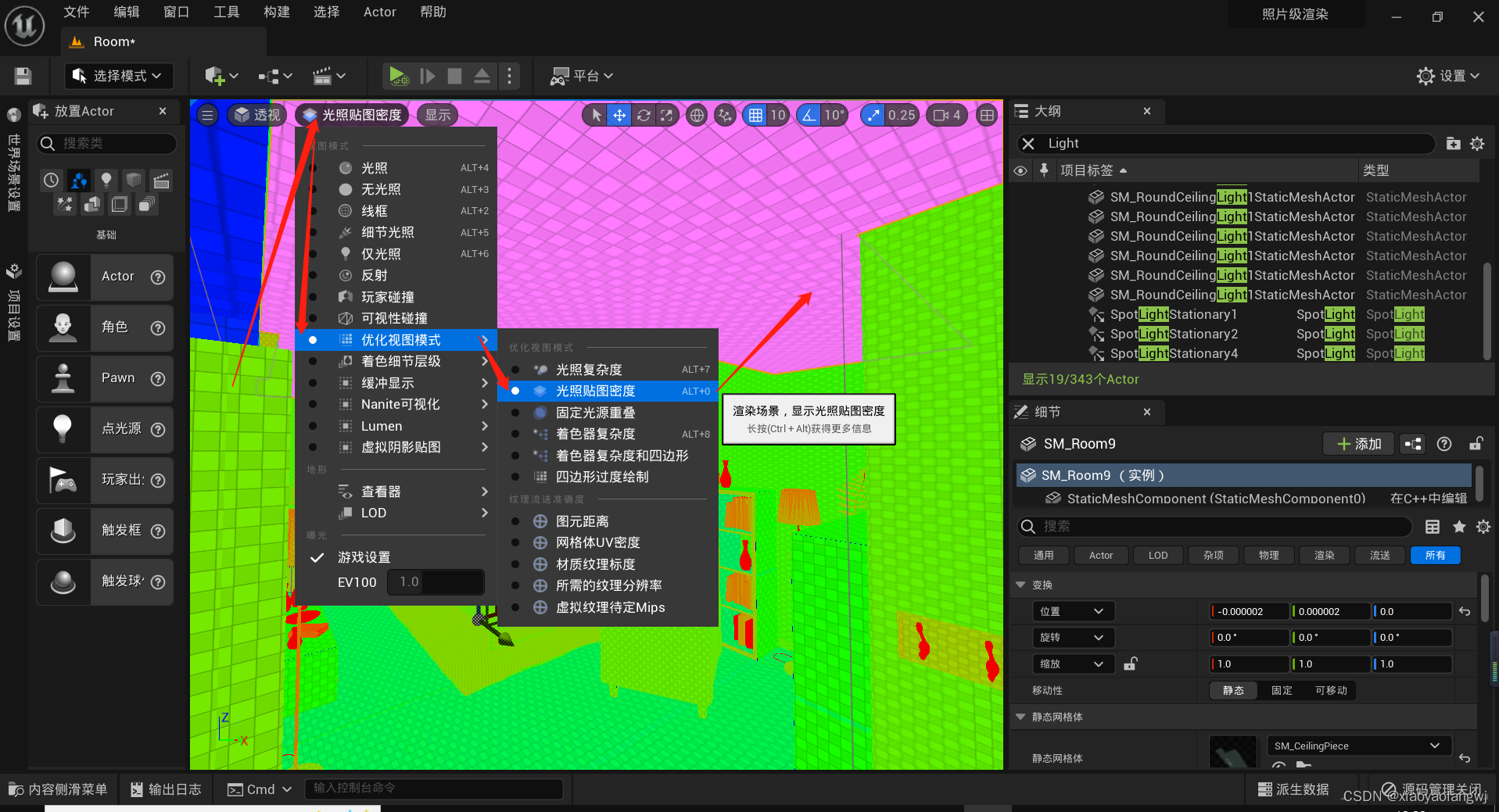

如何确定我们的场景中是否有这些光线贴图分辨率问题的潜在问题呢?

蓝色是浅色地图的最低分辨率,红色是很高的分辨率。红色的一般光地图没有问题。

顶部蓝色的一般都有问题。特别是一些角落中,光地图往往密度很低。

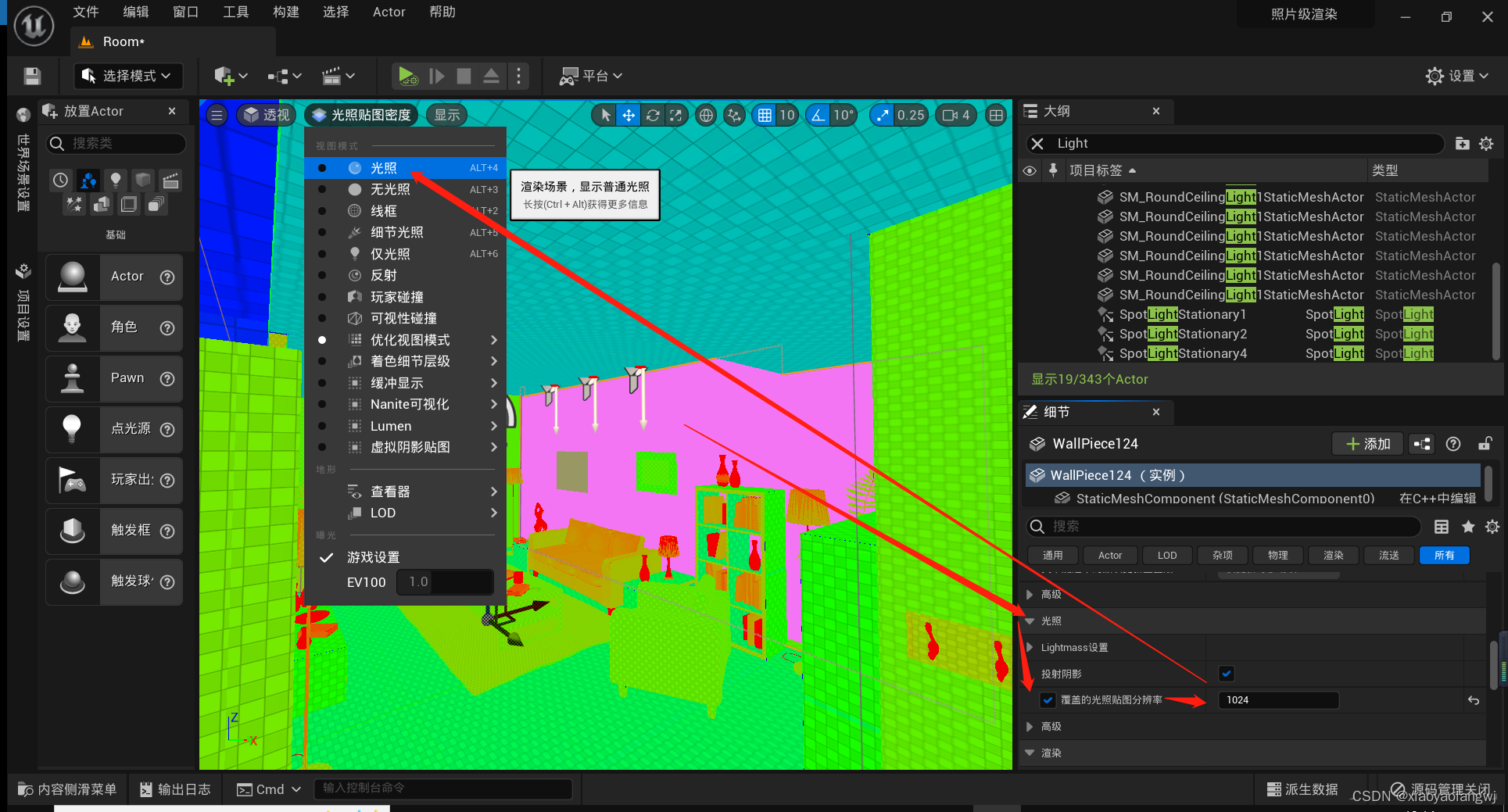

我们将光地图分辨率提高到1024,然后回到光照下,然后重新构建光照。

1024电脑构建很慢,修改为256,效果恢复了。

1539

1539

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?