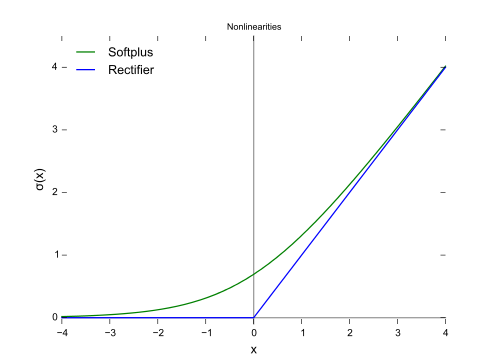

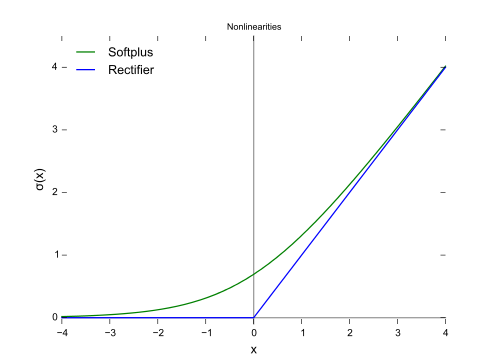

rectifier

f(x)=max(0,x)

softplus

f(x)=ln(1+ex)

softplus vs sigmoid

f′(x)=ex1+ex=11+e−x

说明

softplus 是对 ReLU 的平滑逼近的解析函数形式。

softplus 是对 ReLU 的平滑逼近的解析函数形式。

3865

3865

7万+

7万+

1234

1234

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?