为什么说神经网络是黑箱子模型,我刚刚有了新的感悟。

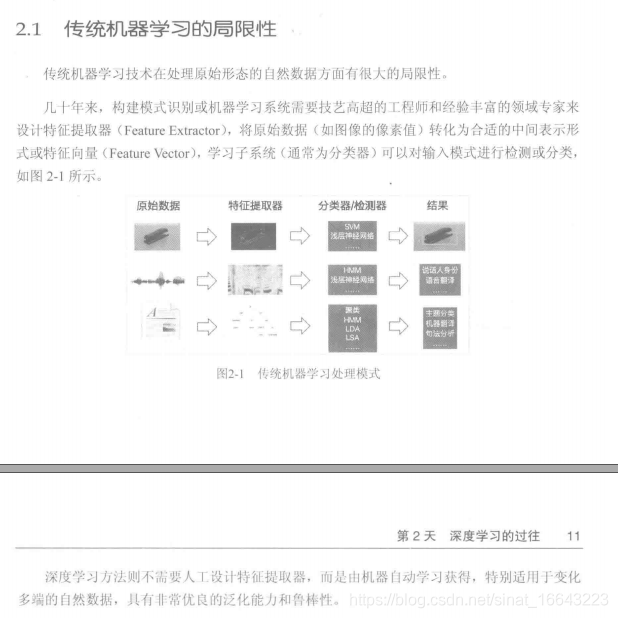

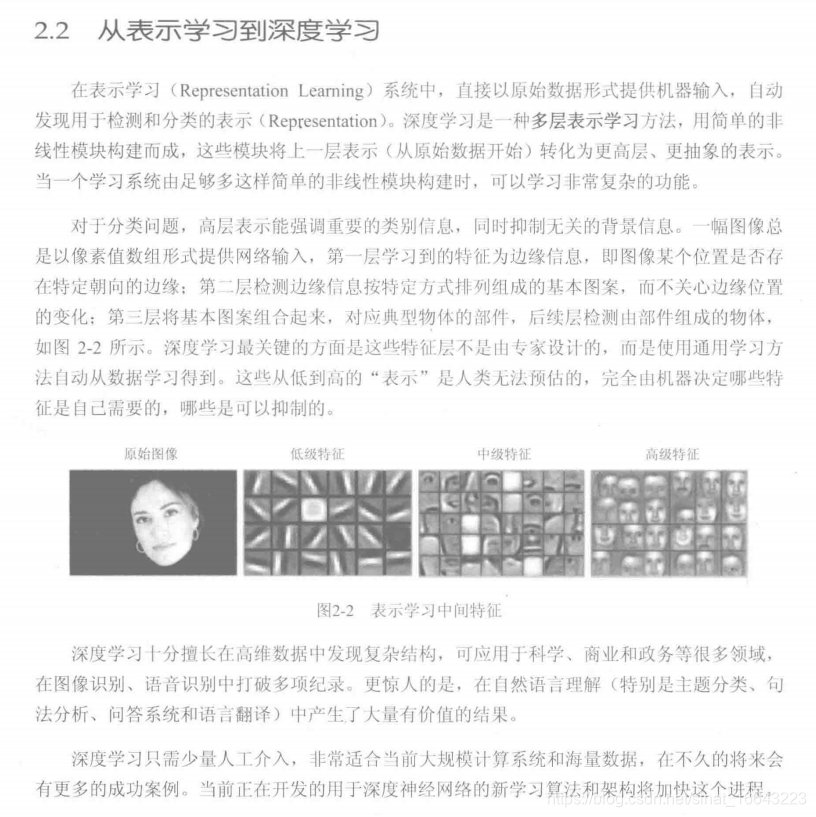

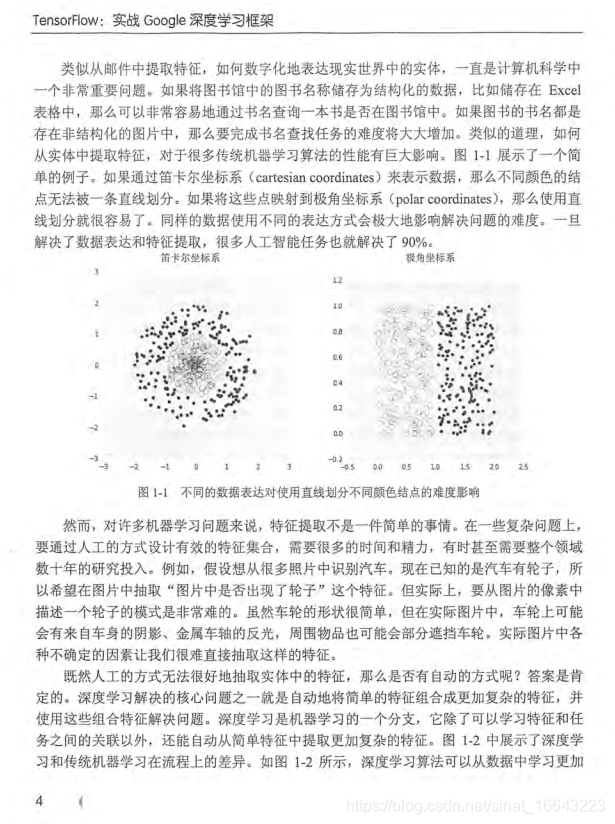

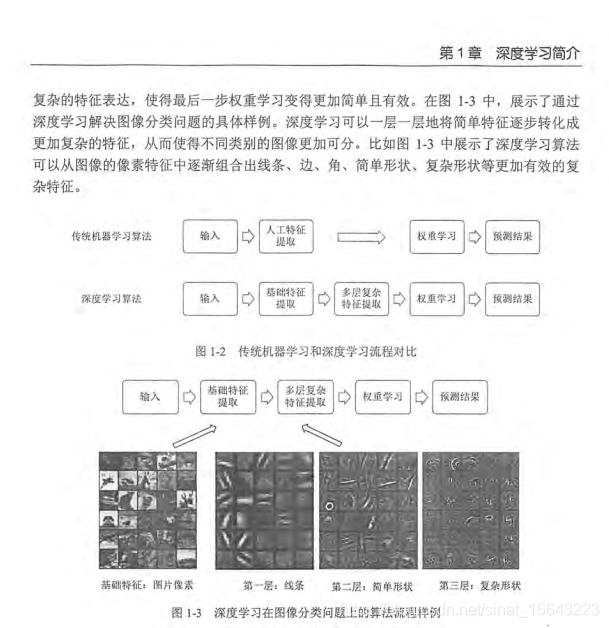

深度神经网络是自动提取特征,不同于以往的人工提取特征。

人工提取特征他是知道为什么提取这个特征的,而神经网络,则是通过训练去尽可能贴近训练集,它确实也是做到了,但是你说不出为什么,它为什么是这样弄,说不出它的权重为什么是这样,所以你也没法很好地手动去改去让它变得更好,它是自动提取特征你也说不清楚它提取了哪些特征。感觉更像是一种非线性洗呢,它是综合出来地效果,你没法去把它内部拆开一个个分析其内部的一部分的功能。它是一个整体的综合性的体现。

当然我理解也可能有误,但至少是我目前的理解。

但有个比如卷积神经网络它每一层都可以把图像,直到最后确实是可以提取出特征的这个怎么解释。

它这里确实解释出来了,那说深度学习不可解释是为什么呢?

下面的截图来自《tensorflow实战google深度学习框架》

刚刚看了这个youtube视频,把神经网络为什么是黑盒讲得很清楚,也让我弄清楚了我上面写的疑惑

https://www.youtube.com/watch?v=Yp29JqL_dd4

3384

3384

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?