抱抱脸24小时复刻Deep Research,一个团队完成一个OpenAI~

原创 猕猴桃 探索AGI 2025年02月05日 15:56 湖北

嘿,大家好!这里是一个专注于AI智能体的频道~

24 小时极限开发的 Agent 能跑多快?

昨天凌晨,HuggingFace 又一次扔下重磅炸弹——宣布开源名为「Open Deep Research」的自主研究智能体。

直接对标 OpenAI 闭源 Deep Research,这个从立项到发布仅用 24 小时的项目,正在用开源社区的闪电速度改写 AI 工具生态。

🔥 开源特攻队的极限时速

故事要从 OpenAI 前天发布的 Deep Research 说起(能自动爬取全网信息、生成研究报告的智能体)。很强,但每月 200 美元的订阅费与闭源模式门槛也不低。

HuggingFace 实验室的科学家们直接拍板:「24 小时内,我们要用开源复刻这个产品!」

这个疯狂的计划最终演变成:

-

凌晨 2 点完成基础架构设计

-

早上 7 点接入 OpenAI 的 o1 模型

-

下午 3 点突破网页自主滚动技术

-

晚间 9 点实现文件动态解析模块

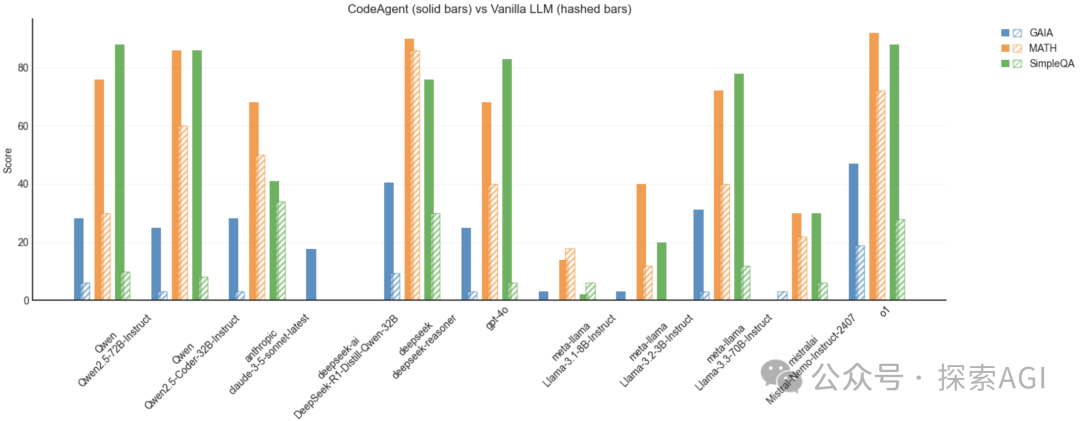

在GAIA基准测试中,获得了非常优异的成绩!

-

OpenAI的Deep Research:67.36%

-

抱抱脸开源版本:54%

-

普通GPT-4(无Agent):7%

🕵️ 解剖这只「开源猎豹」

项目完全开源,代码地址:

https://github.com/huggingface/smolagents/tree/gaia-submission-r1/examples/open_deep_research

内核使用他们自家的CodeAgent,相比于输出一堆的json,用代码对模型来说更顺畅,之前写过这个框架的教程,可以再公众号首页标签中找到。

第一个版本,使用纯文本浏览器,绕开渲染开销 ,页面元素自动转 Markdown 格式 。

使用一个解析器自动读取文本,支持 PDF/CSV/JSON 自动转换, 数学引擎能处理复杂公式推导 。

记忆模块保留跨会话上下文。

模型使用o1,为什么不用o3-mini?

官方回应: 它真的很快,但性能不如 o1 和 gpt-4o。我觉得模型太小了,对于困难任务还不够。

试过用 Deepseek R1 做这个吗?

官方回应: 试过,但没有 o1 那么好。这不是像许多 LLM 那样能力不行的问题,更多的是缺乏对框架指南的适应。所以我们正在考虑微调来解决这个!

最后,官方博客中提到:「o1 模型的 API 调用费已超过实验室咖啡预算,但我们需要证明开源框架的上限」。

🌱 当开源遇见 AGI 竞赛

比起 OpenAI 的「黑箱魔术」,开源智能体正在打开另一种可能:

项目发布后,立马有开发者用 Rust 重写了核心模块,将响应速度提升 3 倍;另一位贡献者则接入了 Wolfram Alpha,赋予其符号计算能力。这种「众人拾柴」的生态,或许正是超越闭源巨头的关键变量。

此刻,Hugging Face 的 GitHub 仓库仍在疯狂刷新提交记录。当我们问及「24 小时开发是否太冒险」时,项目负责人回复了一条 commit message:

git commit -m "冒险是开源者的勋章,而社区是我们的时光机"

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?