"Pre Norm 和 Post Norm 各自的优缺点?" 学妹这么回答

原创 看图学 看图学 2024年07月08日 07:55 山西

![]()

题目:

Pre Norm 和 Post Norm 各自的优缺点?

答案

这个问题其实还蛮难回答的,因为目前并没有特别好的理论来解释清楚。

我们先按时间顺序来梳理一下关于 Pre-Norm 和 Post-Norm 的研究。

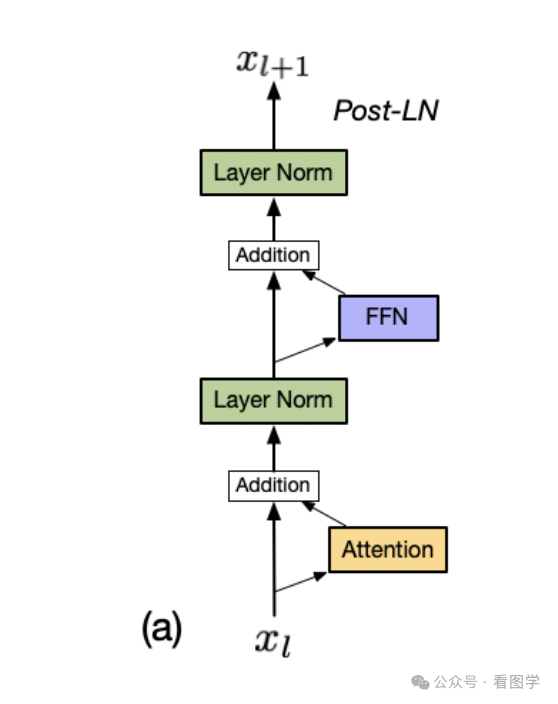

Pre Norm 和 Post Norm 的区别 Layer Norm 和 Residual connections 组合方式的不同。

2017 Attention is All your Need

在原始的 Transformers 论文中,使用的是 Post Norm,如下所示。

Post Norm 用公式可以表示为:

![]()

每一层的输入先与 Attention 相加,然后才计算 Layer Norm。早期的很多模型都用的是 Post Norm,比如著名的 Bert。

Post Norm 之所以这么设计,是把 Normalization 放在一个模块的最后,这样下一个模块接收到的总是归一化后的结果。这比较符合 Normalization 的初衷,就是为了降低梯度的方差。但是层层堆叠起来,从上图可以看出,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1672

1672

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?