强化学习(Reinforcement Learning, RL)与人类反馈(Human Feedback, HF)相结合的技术,通常被称为人类反馈强化学习(Reinforcement Learning from Human Feedback, RLHF)。RLHF是一种用来训练大模型(如大型语言模型)的方法,结合了人类提供的反馈来优化模型的性能。以下是RLHF在大模型训练中的数学形式化详细说明:

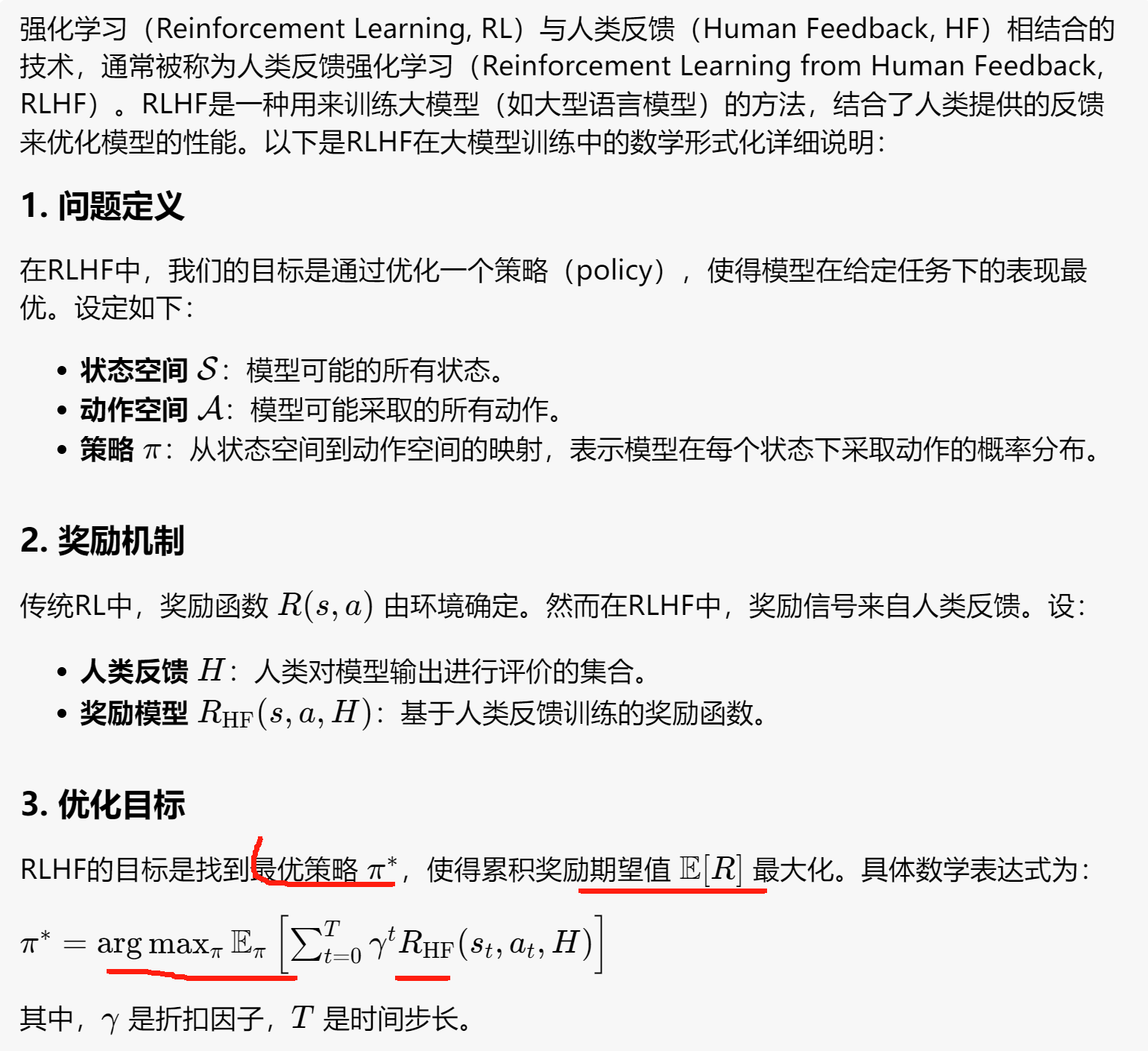

强化学习(Reinforcement Learning, RL)与人类反馈(Human Feedback, HF)相结合的技术,通常被称为人类反馈强化学习(Reinforcement Learning from Human Feedback, RLHF)。RLHF是一种用来训练大模型(如大型语言模型)的方法,结合了人类提供的反馈来优化模型的性能。以下是RLHF在大模型训练中的数学形式化详细说明:

1. 问题定义

在RLHF中,我们的目标是通过优化一个策略(policy),使得模型在给定任务下的表现最优。设定如下:

- 状态空间 S:模型可能的所有状态。

- 动作空间 A:模型可能采取的所有动作。

- 策略 π:从状态空间到动作空间的映射,表示模型在每个状态下采取动作的概率分布。

2. 奖励机制

传统RL中,奖励函数R(s,a) 由环境确定。然而在RLHF中,奖励信号来自人类反馈。设:

- 人类反馈 �H:人类对模型输出进行评价的集合。

- 奖励模型 �HF(�,�,�)RHF(s,a,H):基于人类反馈训练的奖励函数。

3. 优化目标

RLHF的目标是找到最优策略 �∗π∗,使得累积奖励期望值 �[�]E[R] 最大化。具体数学表达式为:

�∗=argmax���[∑�=0����HF(��,��,�)]π∗=argmaxπEπ[∑t=0TγtRHF(st,at,H)]

其中

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1099

1099

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?